「3D Gaussian Splatting試してみたけど、

・学習が遅すぎて実験回せない

・ライセンスがグレーでプロダクションに持っていけない

・DGRは便利だけど、GPU請求書がエグい」

……みたいな経験、ありませんか?

自分もここ1年くらい、NeRFから3DGSへの移行案件をいくつか見てきましたが、どこも最終的にこう言うんですよね:

「いや品質は最高なんだけど、これ本当に商用で回せるコスト感じゃないよね?」

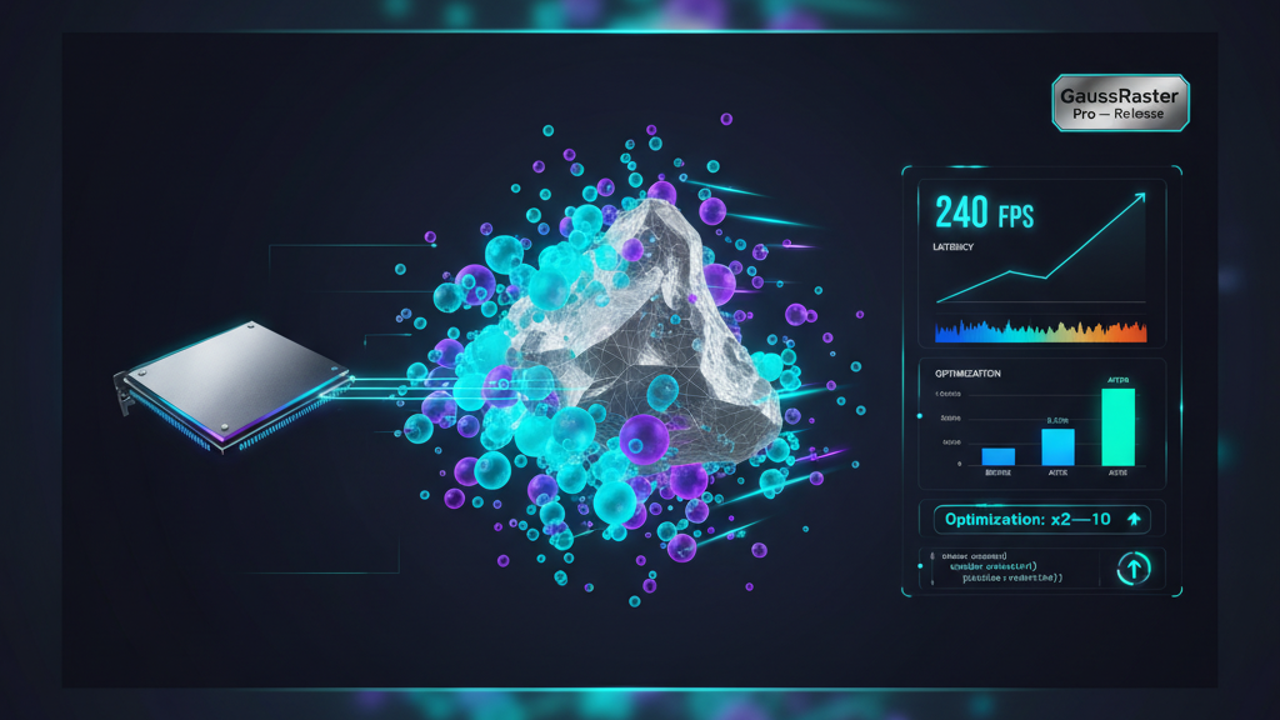

そんなところに、「商用OKで最速の3DGSラスタライザ」を名乗る実装(いわゆる Hyper Rasterizer / DGR 1.45x 系)が出てきたわけです。

しかもBackwardを約130倍高速化しました、というブッ飛んだ話までついてくる。

一言でいうと、「3DGS界の cuDNN 来たかも?」という話

一言でまとめるなら、

「3D Gaussian Splatting 用の cuDNN っぽいものが、商用OKのライセンスで出てきた」

という位置づけだと感じています。

- これまでの3DGS実装:

- 研究用リファレンスコード(3DGS本家、DGRなど)

- ライセンスが微妙(非商用 or 曖昧)

- Forwardはそこそこ速いが、Backwardはお世辞にも“実戦向き”ではない

- 今回の実装:

- Forwardは DGR比で約1.45倍速 をうたう

- Backwardは著者の初期版比で 約130倍(=構造を全部作り直したレベル)

- しかも 「商用利用OK」 を明言

CNNの時代も、各社が自前で畳み込みカーネルを書いていたところに cuDNN が来て、「もう自作コンボリューションやめようぜ」と空気が変わりましたよね。

あの空気感が、いま3DGSにうっすら近づいてきたな、という印象です。

なにがそんなにすごいのか:DGRとの比較で見えてくる本質

正直、「1.45倍」「130倍」と言われても、

「またベンチマーク芸か…🤔」と思う人もいると思います。

なので、DGR(Dynamic Gaussian Rasterizer)との比較 を軸に、何が本当に嬉しいのかを整理します。

Forward:1.45倍の意味は地味だけど効く

DGRのForwardも、決して遅いわけではありません。

それでも、

- 同じハードで 1.45倍速 になるということは、

- 同じフレームタイムで 解像度を上げる か

- 同じ解像度で ガウシアンの個数を増やす か

- または GPUクラスを1段落とす(コスト削減) か

このどれかを取れる、ということです。

ぶっちゃけ、Forwardだけなら「まあ嬉しいけど、決定打ではない」レベルかもしれません。

Forward最適化は既存の各種実装も頑張ってますし、ゲームエンジン組込み勢は自前でタイル化やSoA最適化くらいはやるので。

でも、Backwardの話が出た瞬間に空気が変わります。

Backward:130倍という数字のヤバさ

Backward 130倍というのは、単純に

「少しうまく書き換えたら速くなりました」

のレベルではありえません。

実際にやっていること(公開情報ベースに推測)を見ると、

- 単純な「1ピクセル→1ガウシアンへの勾配散布+atomic地獄」な実装を捨てて、

- タイル単位 or ガウシアン単位での勾配集約

- ブロック内でのローカルリダクション → 最終的に1回だけグローバル書き込み

- Forwardでの中間結果(可視性・α合成の中間値など)を

Backward用に「再利用しやすい形」でキャッシュ しておく設計 - データレイアウト(SoA)からカーネルのLaunch Configまで、

GPUのメモリ階層を前提に構成し直している

つまり、オートグラドに「任せたふりをしているだけの素直なBackward」とは、もはや別物のアーキテクチャです。

これは実務的にはかなり効きます。

3DGSの学習って、体感として

「Forward 3割、Backward 7割〜8割」

くらいの計算コストになることが多いので、Backwardが数十倍レベルで速くなるなら、

- 同じGPU数で、

- 学習を 何倍も早く終わらせる か

- バッチサイズを大きくする か

- より大規模なシーン を扱うか

を選べるようになります。

クラウド上で3DGSを大規模に回しているサービスなら、

月のGPUコストが普通に1桁変わる可能性がある レベルの話です。

ライセンス:ここが一番「商用勢のツボ」

正直、性能よりもインパクトが大きいのはここです。

- 従来:

- 3DGS系の多くの実装が「研究目的」「非商用」だったり、

GitHubのREADMEを読んでもグレーだったり - 今回:

- 「商用OK」を、最初から前提にしている

実務で一番ダルいのは「法務を説得すること」です。

性能が多少悪くても、法務が通るやつ を選ばざるをえない、というのが現実。

そこに「性能も良くて、ライセンスもハッキリ商用OK」とくると、

「じゃあもうこれをベースラインにしようか」 という判断が一気にしやすくなります。

DGRはどうなるのか?

競合という意味で見ると:

- 研究者・学生向け:

- DGRは引き続き「読みやすくて改造しやすいリファレンス」として価値がある

- プロダクト開発・商用サービス向け:

- 正直、この新ラスタライザのほうが有利

- 特にGPUコストがKPIに直結するSaaS・クラウドサービス系は、

DGRベースのままだと厳しくなる 可能性が高い

cuDNNが出てきてから、「研究用の手書きConv実装」と「本番用のcuDNNバックエンド」が分離されたように、

3DGS界も「研究用DGR」と「商用Hyper Rasterizer系」に二極化していく 未来がかなり見えます。

本当に「みんなこれに乗り換えるべき」なのか?

ここまで褒め気味で書きましたが、

ぶっちゃけ懸念もそれなりにあります。

懸念1:カーネルが “賢すぎて” 改造しづらい問題

130倍速いBackwardって、裏を返すと

「人間が理解しやすいコード」ではなく

「GPUにとって都合のいいコード」

になっている可能性が高いです。

- 分岐を極力消す

- レイアウトをGPU目線で最適化する

- 数ステップの式をまとめて展開してしまう

こういう方向に最適化されたコードって、

少し描画モデルを変えたいだけなのに、致命的にいじりづらい んですよね。

- 「色を3chじゃなくて、少し複雑なBRDFにしたい」

- 「ガウシアン位置に時間パラメータを持たせたい」

- 「可視性をカスタムのオクルージョンモデルにしたい」

こういう研究寄りの改造をしたいチームには、

DGRのほうが100倍触りやすい のは間違いないです。

懸念2:GPU依存がかなり強そう

この手の「超最適化CUDA」はたいてい:

- NVIDIA前提(CUDA必須)

- 特定のCompute Capabilityを前提にしてチューニング

- ある程度新しめのアーキ(Ampere以降)を想定

という条件付きになりがちです。

- AMD GPU / ROCm

- Apple Silicon / Metal

- WebGPU / モバイル

これらをターゲットにしたいプロダクトでは、

- 「Hyper Rasterizer系はNVIDIA専用の高速パス」

- 「他環境向けには DGRベース or 別実装のフォールバック」

という 二重実装地獄 を抱えることになります。

マルチプラットフォーム展開したいゲーム・XR系のプロダクトだと、

そこまでしてCUDA特化の実装に寄せるか? という悩みは正直出ます。

懸念3:数値の違いと再学習コスト

Backwardの構造をここまで変えている以上、

- 同じ初期値・同じデータセットで学習しても

- 勾配の丸め誤差・合成順序の違い で

収束パスが微妙にズレる - ひどいケースだと

- 既存手法で学習済みのモデルを、そのままFine-tuneに使うと

挙動が変わる

みたいなこともありえます。

研究目的で「論文中のグラフを完全再現したい」勢には、

再現性の意味でDGRのほうが安心 という場面もあるはずです。

懸念4:肝心なノウハウが “有料記事” に閉じている問題

Backward最適化の詳細が有料記事なのも、個人的にはちょっと気になっています。

- 実装自体がオープンで商用OKなら、

利用する側としては問題ない - ただし、

- 手法を深く理解してカスタマイズしたい

- 自分のプロジェクトに合わせて最適化の方向を変えたい

というときに、有料記事に依存する

というのは、知識の断絶を生む 危険があります。

3DGS界の「cuDNN的人材」が一部にだけ偏ってしまうと、

エコシステム全体の進化スピードが落ちる という懸念は正直ありますね。

じゃあ、プロダクションで採用するか?という話

ここまで踏まえて、自分ならどう判断するかを用途別にまとめると:

すでに3DGSプロダクトを運用しているチーム

- GPUコストがKPIに効いているなら:

- 真面目に検討する価値は大きい です

- 特に学習パイプライン(Backward重視)のほうから試験導入してみる

- ただし:

- 移行コスト(API互換性・テンソルレイアウト変更・学習再検証) はそれなりに覚悟する必要あり

- 既存モデルとの互換性が重要なら、小さめのサブセットでABテストすべき

これから3DGSをプロダクトに入れようとしているチーム

- ライセンス的にグレーな実装を避けたいなら:

- 正直、最初からこのラスタライザをベースラインにしてしまう のが合理的です

- ただし、研究要素が強くてレンダリング方程式をガンガン変えたいなら:

- 最初はDGRや素直な実装でプロトタイピング

- 数式が固まった段階で、「Hyper系」に載せ替える二段階構成が良さそう

研究室・R&Dチーム

- 主目的が「新しいレンダリング手法・表現の提案」であれば:

- 可読性・改造容易性を優先してDGRでOK

- 逆に「既存3DGSを超スケールで回して、データを量で殴りたい」系のプロジェクトなら:

- GPUバジェット次第で、「Hyper系」を導入したほうが論文1本分くらい差がつくかもしれません

個人的な結論:プロダクション採用は「部分的にGO、全面移行はまだ様子見」

正直にいうと、

「明日から全部このラスタライザに切り替えろ!」

とまではまだ言い切れません。

理由はシンプルで:

- コードの保守性・拡張性

- マルチプラットフォーム対応

- 数値再現性

あたりの “地味だけど効くところ” が、

まだ十分に検証しきれていないからです。

ただし、

- 商用OKライセンス

- Forward 1.45×、Backward 130×(構造的最適化)

- DGR互換のパイプライン設計

という三点セットは、ぶっちゃけかなり強力です。

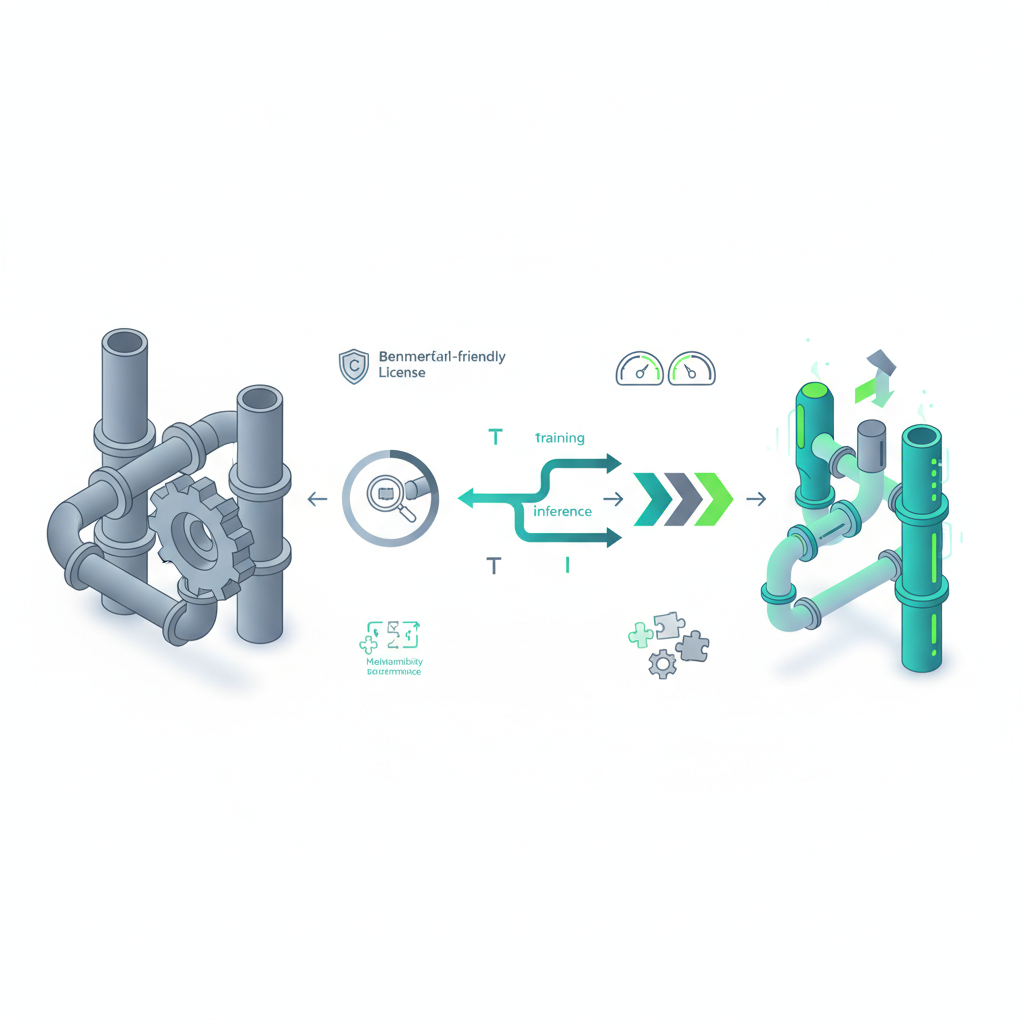

自分がプロダクト側のTech Leadだったら:

- まずは 学習パイプラインの一部だけ差し替えてベンチマーク

- 数値/品質に問題なければ、

- 学習系は「Hyper系」、推論系は「既存実装」という ハイブリッド構成 にする

- 数ヶ月運用して問題なければ、

- プロダクションの推論側も順次移行

という 段階的な採用 を選ぶと思います。

まとめ:これでやっと「3DGSをやる意味」がコスパ的に立ち始めた

NeRFから3DGSに流れてきたここ1〜2年、

正直どの現場でも、

- 品質は最高

- でも学習コストがやばい

- しかもライセンスが怪しい

という三重苦がありました。

今回の「商用OKで最速クラスの3DGSラスタライザ」は、

少なくともそのうち 2つ(性能とライセンス) をかなり真面目に潰しにきています。

もちろん万能薬ではないし、

「これさえあれば3DGSがすべて解決」という話でもありません。

ただ、

「3DGSをプロダクトで本気で回す」ことを真剣に検討してよいフェーズに来た

という意味では、かなり象徴的な一歩だと思います。

3DGSをこれから触ろうとしている人は、

- 研究・プロトタイピング:DGR

- 本気の商用・スケール学習:Hyper Rasterizer系

という 二本立て前提 で技術選定を始めると、後々の後悔が少ないはずです。

コメント