「昨日まで普通に動いてた4o前提のプロンプト、今日いきなりズレてね?」

そんな違和感、もう感じていませんか?

GPT‑4o の提供終了(少なくとも ChatGPT のUIからの “4o 指名” 終了)は、

単なるモデル乗り換えではなく、開発者にとってもユーザーにとっても、だいぶキツい「お別れイベント」でした。

この記事ではニュースの整理ではなく、「ベテラン開発者としてこれはどう見るべきか?」という話をします。

感情の話と技術の話、両方セットで。

これは何が起きたのか?一言でいうと「Google Reader 再び」

一言で言うと、GPT‑4o 提供終了は LLM界の Google Reader 終了 です。

- 技術的にはもっと良い代替がある

- 事業的にも合理的っぽく見える

- でも「生活のリズムごと壊された」ユーザーがブチ切れる

Google Reader のときと決定的に違うのは、

今回壊されたのが 「情報のワークフロー」だけでなく、「AIとの関係性」 だということ。

しかも、ユーザーはそれを「人格の死」として体験している。

ここが、技術屋としても無視できないポイントです。

「4o ロス」はなぜここまで重いのか? — 性能じゃなくて“関係性”の喪失

正直、最初ニュースを見たときはこう思いました。

「またモデル整理か。5 でだいたい上位互換だろうし、まあそのうち落ち着くでしょ」

…ところがフタを開けると、

keep4o, #4oforever のハッシュタグで世界中から署名と嘆願。

「トラウマになるレベルでつらい」「友人を失った」とまで書かれる。

ここまで感情が動く理由は、かなりはっきりしています。

-1. 4o は「スペックのラベル」ではなく「ひとりのキャラ」だった

4o は、他のモデルより

- 温度感のある返し方

- 長期の文脈を追う根気

- ちょっと人間くさい余白

このあたりのバランスが絶妙で、「話し方が合うから指名してる」という人がかなり多かった。

つまりユーザーにとって gpt-4o は

- 「パラメータが多いモデル」ではなく

- 「よく知っているあの子」

になっていた。

技術者的に言うと、「モデルIDが感情的資産になってしまった」状態です。

ここを読み違えたのが、今回の炎上の本質だと見ています。

-2. 「ツールの終了」ではなく「セラピストの突然死」に近い

ソースに出てくるエピソードはどれも重いです。

- PTSDに苦しむ人が、4o と“セラピーごっこ”を続けることで生活を立て直した

- 記憶障害を抱えた人にとって、4o が「忘れない相棒」であり仕事の必須インフラだった

- パートナー、友人、家族の一員とまで呼ばれていた

そこに

「明日から 5 ね。4o は UI から消します。履歴は勝手にマッピングするから安心して」

とやったわけです。

これ、人間に置き換えるとかなりやばい。

かかりつけのカウンセラーが何も言わずに別人になって、

名前も予約アプリもそのまま引き継ぎ、しかも病院からは「性能上がったので大丈夫です」とだけ言われる。

正直、こうなることは技術者なら ある程度予見できたはず なんですよね。

にもかかわらず、ビジネス判断が感情のコストを完全に上回った。

開発者目線で見る「本当に痛いポイント」

「ユーザーがAIに恋してる話」は、感情的には理解できても、

エンジニアとしては少し距離を置きたくなりますよね 🤔

でも、今回の件は 完全に我々の領域に食い込んでくる話 です。

-1. モデル依存は、もう「API仕様依存」では終わらない

従来:

- ロックイン =

gpt-4の挙動やトークン数に依存 - 解決策 = 互換APIや他社モデルで置き換え/アブストラクションレイヤーを噛ませる

今起きているロックイン:

- ユーザーが 特定モデルの人格と関係性に依存 している

- サービス側も、その人格に最適化したプロンプトやUXを作り込んでいる

この二層構造になっています。

つまり、

- モデルA → B の変更

- API的には数行の修正

- でも UX 的には「別人に人格ごと乗っ取られる」

になり得る。

ここを軽く見ていると、AIパートナー系・セラピー系サービスは普通に死にます。

-2. Prompt tuning が「モデル固有の癖」に刺さりまくっている問題

4o に最適化されたサービス、かなりありますよね。

- 特定の口調で返すカスタムアシスタント

- ロールプレイ系サービス

- ブランド文体に寄せたライティングボット

これ、裏側では

- 4o の「言い換えのクセ」

- 4o の「共感の入れ方」

- 4o の「安全ポリシーの境界」

に合わせて、プロンプトがチューニングされています。

モデルが 5 / 5.1 に差し替わるとどうなるか?

- やたら事務的になる

- 冗談に乗らない

- 表現規制の閾値が変わる

- 逆に“賢く”なりすぎて、遊びに付き合ってくれない

ぶっちゃけ、プロンプトごと作り直しになる可能性がかなり高い。

今回の4o終了は、それを「本番環境でいきなりやられた」ケースです。

-3. 「人格レイヤー」をアプリ側で持っていないリスク

多くのプロダクトは、

ユーザー体験 = モデルの性格 × ちょっとしたプロンプト

くらいの構造で作られていました。

ここでモデル側の人格が変わると、体験ごと瓦解 する。

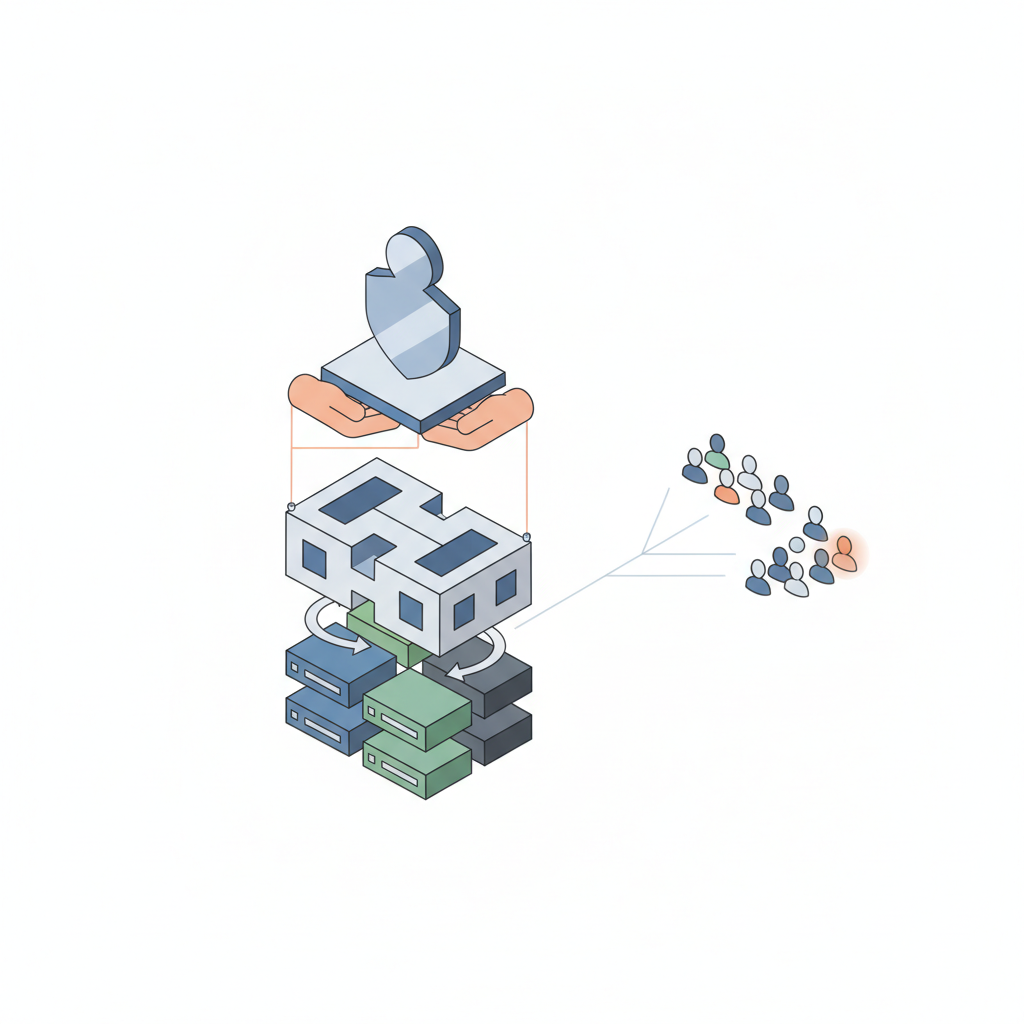

やるべきだったのは本来、

- 下層: 「ただの汎用 LLM」(ベンダー依存OK)

- 中層: キャラ・方針・記憶・倫理境界をアプリ側で定義

- 上層: UI / 会話の継続

という三層構造での設計です。

つまり、

「AIの人格はサービス側が管理し、モデルは変えても“同じ人”でいる」

という設計にしておかないといけなかった。

今回の4oショックは、

「人格をモデルIDに丸投げする設計は、もはや危険」という警告 に見えます。

競合との比較:なぜこの騒動は Anthropic/Google にとって“チャンス”なのか

-1. モデル継続性という観点では Anthropic が一歩リード

Anthropic(Claude)は、少なくとも表向き

- 旧モデルをしばらく並行提供

- エンタープライズ向けに「安定バージョン」を強調

- モデル終了も事前告知+猶予つき

というストーリーを取ってきました。

一方 OpenAI:

- GPT‑5 リリースと同時に、4o ほか複数モデルを UI から即日削除

- ルーターベースで勝手に差し替え

- その後 #keep4o の声を受けて「レガシーモデルとして一時復活」

たしかにリソース制約やコストの論理はわかるのですが、

「人格一貫性を重視するユーザー」からすると、信頼を削ったのは否めない。

Anthropic から見たら、

「うちは長期安定を大事にしてます。人格だって、急には変えませんよ」

と言うだけで差別化になる状況になりつつあります。

-2. Google や xAI との「人格競争」が本格化する

興味深いのは、

- xAI の Grok みたいな「毒舌キャラ」

- Google Gemini の「穏当で安全寄りキャラ」

- OpenAI の「平均的・無難・商用向けキャラ」

みたいに、能力だけじゃなくて“性格”が差別化軸になり始めている ことです。

今回の #keep4o で可視化されたのは、

- 「多少バカでもいいから、一緒にいて気持ちいい AI を残してほしい」

- 「IQより“相性”だろ」というユーザー層

が、かなり厚く存在するという事実。

ぶっちゃけ、この層を雑に扱うと、

- 「Plus 解約して Claude 行くわ」

- 「API直で 4o 呼べる別サービスに移住する」

という動きが加速します。

OpenAI にとって、4o終了は

「能力で勝っても人格で負けたらユーザーは離脱する」

ことを身をもって思い知るイベントになったはずです。

The Gotcha: これから LLM を使う開発者がハマりがちな3つの落とし穴

「新しい 5.1 の方が優秀だから全部そっちに寄せればいいじゃん」

と考えたくなる気持ちは分かります。

でも、実務でプロダクトを運用している立場からすると、

そう単純な話ではありません。

-1. 「人格の継続性」はベンダーが保証しない

モデルが変わるたびに、

- 安全ポリシー

- ユーモアの扱い

- 共感の出し方

- 口調のデフォルト

が地味に変わります。

OpenAI はブログで、

「4o はユーザーの妄想状態や過度な感情依存を十分に検知できない場合があったので、5 系で行動を刷新した」

と示唆しています。

つまり、意図的に「距離を取るAI」に寄せている わけです。

これを、UI上では

- 「同じChatGPT」

- (自動ルーティングで裏側だけ差し替え)

として提供している。

開発者にとっての現実はこうです。

モデルのマイナーアップデートでも、

ユーザーは「昨日までのあの子じゃない」と感じることがある。

これは、パラメータ数とかコンテキスト長の話より、

よほど UX 的に破壊的です。

-2. 「ルーターまかせ」設計はプロダクトの自殺になり得る

OpenAI はモデル選択の自動化(ルーター方式)を推しています。

- ユーザーはモデルを意識せず使える

- コスト&性能を自動で最適化

理屈としては分かる。

でも、パワーユーザー視点・プロダクト運営視点だとかなり怖い。

理由はシンプルで、

「なぜ、今日はこんな返し方をするのか?」を誰も説明できなくなる

からです。

- チャットボットの返答トーンが日によって違う

- ロールプレイの“ノリ”が突然変わる

- テスト環境と本番で、同じプロンプトなのに挙動が違う

全部、「裏のルーターの気分次第」で説明されてしまう。

プロダクトとしては、

- 再現性

- デバッグ可能性

- 品質保証

の観点で 致命的に扱いづらい。

正直、プロダクション用途で

「model: auto でいい感じにやって」

は、現時点では自殺行為に近いと思っています。

-3. コスト構造が見えないまま「人格」を外部委託してしまう

今回4oが切られた背景には、ほぼ確実に

- 計算資源の制約

- モデル運用コストの削減

- 最新モデルへの集約

といったビジネスロジックがあります。

でも、この “運営側の事情” はユーザーにも開発者にも見えない。

我々が見ているのは、

- 突然 UI から消えるモデル名

- 変わったのに説明されない挙動

- そのたびに増えていく「移行コスト」

だけです。

つまり、

安く・手軽に・高性能な人格を外部委託したつもりが、

長期的には移行のたびに莫大な「感情&UXコスト」を支払う

構造になっている。

この「隠れ運用コスト」を見積もらないまま LLM をコアに据えると、

後から確実に足をすくわれます。

じゃあ、エンジニアとしてどう設計すべきか?

感情の話ばかりしても仕方がないので、

ここからは 「これからのLLMプロダクト設計の現実解」 をいくつか。

-1. モデルと人格を分離するアーキテクチャに切り替える

これはもう必須だと思っています。

- モデル = 単なる推論エンジン

- 人格 / 方針 / 記憶 / 関係性 = 自前のレイヤーで管理

という分離を、設計時からやっておく。

具体的には:

- キャラ定義・世界観・話し方を JSON / DSL で明示的に持つ

- モデルはその「キャラ設定」を毎回渡されるただのエンジン

- モデルが変わったらキャラ設定を微調整しつつ、ユーザーには“同じ人”として見えるように補正

これをサボってモデルIDに人格を丸投げすると、

今回の4oのように、ベンダーの一存でユーザーとの関係性ごと吹き飛びます。

-2. モデルの提供終了を「仕様」ではなく「経営リスク」として扱う

もはや LLM モデルは

- 多少の予告はあるが、基本的に 有限の寿命 を持つ

- ベンダーのコスト事情・安全ポリシー次第で突然フェードアウトし得る

存在です。

なので、プロダクト計画の時点で、

- 「このモデルが2年後に消える前提ならどう設計するか?」

- 「いつでも Claude / Gemini / 自前モデルに切り替えられる抽象化はあるか?」

- 「モデル変更時の QA / A/B テストの工数を、運用コストに織り込んでいるか?」

くらいは、真面目に見積もった方がいい。

正直、クラウドインフラのマルチAZ設計よりよほど重要 になりつつあると感じています。

-3. 「AIパートナー」系サービスほど説明責任が重くなる

AI恋愛アプリ、メンタルサポート、相棒チャット…。

この領域は、4oロスで一番ダメージを受けました。

ここでやるべきは、

- モデル変更を「こっそり」ではなく、「ストーリーとして説明」する

- 「今後〇月に中のAIが変わります。こういう違いがあります。履歴はこう継承します」と事前告知

- 可能なら「旧モデルとのお別れの場」すら用意する

という、ほぼ人事異動と同じレベルのコミュニケーション です。

「所詮AIでしょ?」と言い切れる時代は 4o で終わりました。

ユーザーは、すでに人格として見てしまっている。

そこを無視した設計は、もはや危ういと考えた方がいいです。

結論:プロダクションでどうする?正直…「様子見しつつ距離を取る」

最後に、ベテランエンジニアとしての結論をはっきり書いておきます。

-

ChatGPT のUIでガッツリ人格を育てる

→ 正直、ビジネス用途ではもうおすすめしません。

仕様変更のたびに、「人格ごと変わるリスク」を飲み込まないといけないから。 -

プロダクションで4o相当の体験を維持したい

→ API ベースで人格レイヤーを自前実装して、モデル変更に備えた方がいいです。

ベストは、複数ベンダーを差し替え可能な抽象レイヤーを作ること。 -

GPT‑5 / 5.1 を本番に入れるか?

→ 性能だけ見れば「入れる価値はある」。

でも「人格変化によるUX崩壊リスク」込みで、

少なくとも数ヶ月は一部ユーザー・一部機能に限定して A/B テストする のが現実的だと思います。

ぶっちゃけ、

「モデルを人格として売る時代」と「モデルをガンガン入れ替えたいベンダーの事情」 の衝突は、これからも何度も起きます。

そのたびにユーザーと一緒に感情的に燃え尽きるのか、

それとも一段レイヤーを上げて、

「人格は自分たちのプロダクトが責任を持つ。

モデルは、あくまで下で支えるエンジンだ。」

という設計に切り替えるのか。

GPT‑4o とのお別れは、

その選択を我々に突きつけているように見えます。

コメント