「昨日の続きから頼めるAI」が欲しい——そう思ったこと、ありませんか?

毎回長文のプロンプトを書いて、過去の経緯を全部説明して、「で、どこまで話したっけ?」から始める。

LLMと仕事していると、この“会話のリセット地獄”にうんざりした人は多いはずです。

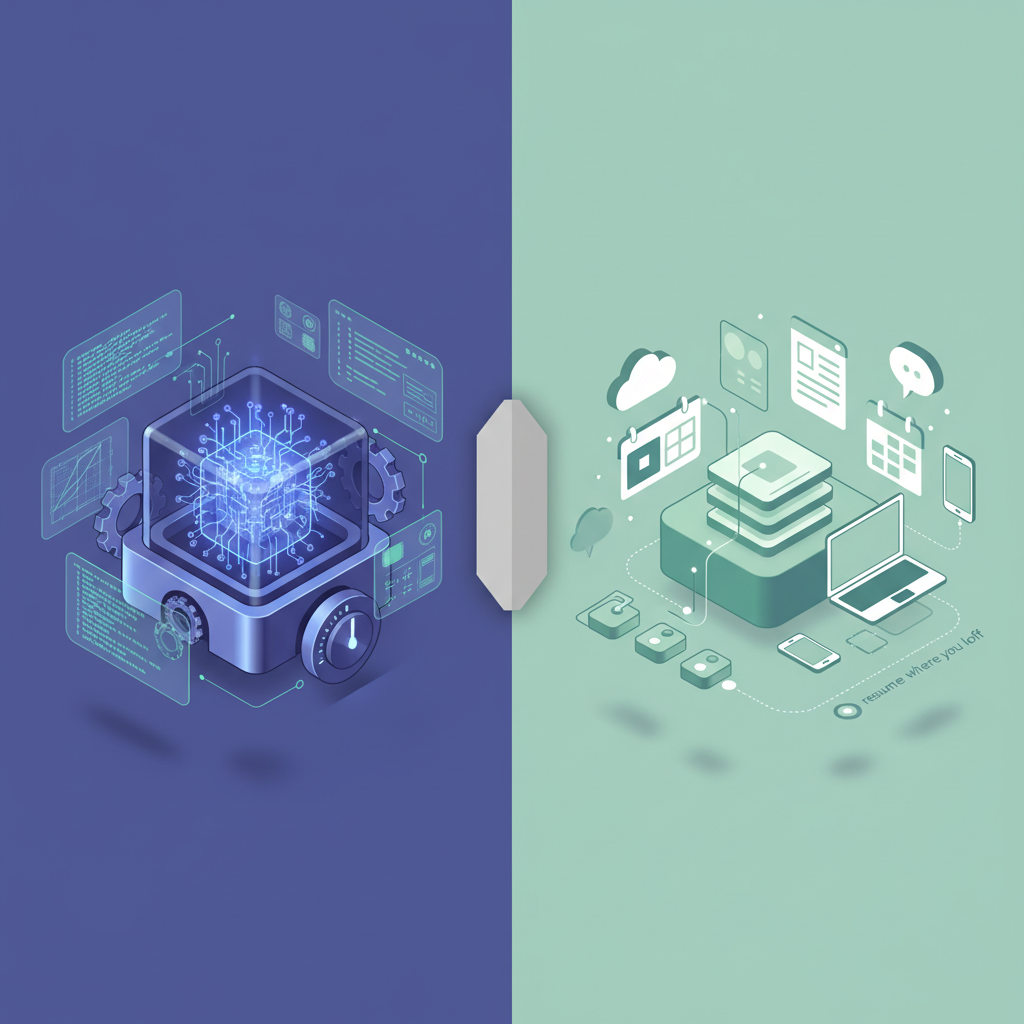

その文脈で、GPT‑5とGemini 2.5(特にDeep Think)は、単なる「ちょっと賢くなった新モデル」ではなく、AI推論そのものの前提をひっくり返しに来ていると感じています。

一言でいうと:「Docker時代が終わって、いきなりKubernetesを渡された」感覚

ニュースを雑にまとめると:

- GPT‑5:

- 軽量モデルでプランニング → 専用モデルやツール呼び出し → 長時間推論スロット

- これら一式が「1つのAPI契約」の中に埋め込まれた設計

-

reasoning_mode="deep"的なモードで、「思考時間そのもの」に課金する世界観 -

Gemini 2.5 Deep Think:

deepThink: true/ 月額$249 tier で、長時間・高精度推論に特化task_idを軸に「昨日の続きから考えさせる」ような持続推論を前提化- 推論キャッシュで、「同じドキュメントを何度も読ませない」方向性

一言でいうと、

「単発プロンプトで完結するモデル」から、「タスク単位でオーケストレーションする推論プラットフォーム」への移行です。

これ、歴史的にはまさに「Docker → Kubernetes」転換期とよく似ています。

- 昔:

- 1モデルをどううまく叩くか(= 1コンテナをどううまく起動するか)

-

Prompt Engineering が Dockerfile職人芸のポジション

-

これから:

- 複数モデル+ツール+長期タスクを、どうオーケストレーションするか

task_id,reasoning_budget,session/stateを設計するAI SRE/Architectが主役

正直、「またモデルが一個増えただけ」と思っていると痛い目を見ます。

本当にヤバいのは「Deep推論」そのものじゃない

「1リクエスト完結」から「タスク志向の継続推論」へ

GPT‑4/4.5やGemini 1.xまでは、基本的な前提がこうでしたよね:

「良いプロンプトを書けば、1レスポンスで“なるべく完結した答え”を返してくれる」

それに対して、GPT‑5とGemini 2.5がやろうとしているのは明らかに違います。

- 問題分解

- 計画立案

- 実行・検証

- その続きの深掘り

を1回のAPIで“全部やる”発想から、「同じタスクIDで何度も往復して育てる」前提に変えにきている。

Gemini 2.5のtask_idは、その象徴ですし、GPT‑5側もセッション+推論モードを組み合わせる方向に寄せてきています。

これはデベロッパー視点だと、次のようなインパクトがあります。

- ❌ 「とりあえずチャットUIにgpt-5差し替えとけばOK」

- ✅ 「タスク単位で状態を管理するアプリ設計に変える」必要が出てくる

タスク管理SaaSを作ってるつもりはなくても、

内部的には「AI用タスク管理システム」を必ず持つことになる、ということです。

LangChain的な“自前オーケストレーション”の意味が変わる

これまでのベストプラクティスはだいたいこんな感じでした:

- 軽量モデルでプロンプトリライト・プランニング

- ヘビーなモデルで本番推論

- 外部ツール(RAGやブラウザ、コード実行)との連携をフレームワークで管理

つまり、アプリ側が「ミニKubernetes」を書いていたような状態。

GPT‑5/Gemini 2.5は、ここにかなり踏み込んできます。

- モデル側が内部で

- どのツールをいつ呼ぶか

- どこまで深く考えるか

- 途中結果をどこまで再利用するか

を勝手に決めてくれる方向

ぶっちゃけ、

「ツールを並べてチェイン書くだけ」のフレームワークは、価値が一段削られると思っています。

逆に、これから価値を持つのは:

- 企業データ統合

- トレーサビリティ / 監査ログ / オブザーバビリティ

- 権限管理・コンプラ・セキュリティ

といった“AIをプロダクションで安全に回すための土台”側です。

「LangChainが終わる」ではなく、

「LangChain“まで”やってるところは終わる」に近いニュアンスですね。

GPT‑5 vs Gemini 2.5:何が違って、どこで使い分けるべきか

コミュニティの空気感も含めて整理すると、両者はかなりキャラが違います。

GPT‑5:エンジニア・アーキテクト向けの“思考エンジン”

- code / architecture / エージェント系の推論に強い描写

gpt-5-reasoningやreasoning_mode="deep"で、

「思考時間そのものをパラメータとして扱う」設計- OpenAI/Azureエコシステムとの互換性を重視

コミュニティでは、

- 「創作・長文・高度推論での伸びが大きい」

- 「AGI議論の象徴として期待されている」

といった評価が多く、

“ハードな思考タスクを押し込むエンジン”としてのポジションを取りに来ている印象です。

Gemini 2.5 Deep Think:業務フローに埋め込まれた“しつこいアシスタント”

task_idベースで、「昨日の議論の続き」から再開できる持続推論- 推論キャッシュにより、同じドキュメントを何度も読む無駄を削る設計

- Google Workspace / Meet / Docs / Androidなど、既存業務ツールとの一体化が前提

実際、

「Gemini 3(2.5世代以降)を使って、複数のタスク管理バックエンド(vikunja, CalDAV)をAIツールとして統合するプロジェクトを2日で作った」という報告も出てきていて、

これはもう「チャットボット」ではなく、

ワークフローオーケストレーションの“脳”として使われているフェーズ

に入りつつあります。

正直な使い分けの肌感

-

すでにGoogle Cloud / Workspace が社内標準 →

Gemini 2.5 Deep Thinkを中核に据えた方が総コストは安い可能性が高い -

API中心で、SaaS連携は自前でガンガンやる →

GPT‑5のほうが“素の思考エンジン”として扱いやすい

そして、多くの開発者がすでに気づき始めていますが:

どっちかを捨てる話ではなくて、

「ユースケースごとに両方使う」時代に入った

というのが現実的な落とし所だと思います。

ただ、懸念点もあります…「深く考えさせる」のはタダではない

コスト爆発:Deep Think全開は確実に破綻する

Deep/Reasoningモードは、

- 時間も

- トークンも

- (おそらくは)中間キャッシュ用ストレージも

全部食います。そして全部、請求書に乗ります。

Gemini Deep Thinkの月額$249は“入場料”にすぎず、

実運用では中規模チームでも月数千〜数万ドル級になりかねません。

ぶっちゃけ、

「全部 deepで回しとけば賢くなるでしょ」

という設計は、ほぼ確実に死にます。

必要なのは:

- どのエンドポイント/どの画面からの操作は通常モードで十分か

- どの条件を満たしたときだけ deep/reasoning に切り替えるか

- 有料ユーザー/重要タスクだけ deepを許可するのか

といった「推論モードのポリシー設計」です。

ここをサボると、あとでFinOps地獄が待っています。

ベンダーロックイン:推論パイプラインまで囲い込みに来る

GPT‑5もGemini 2.5も、

- 推論パイプライン

- タスク継続

- 推論キャッシュ

を**クラウド側の“ブラックボックス”として提供してきます。

これにベタ乗りすると、将来こうなります:

- ある日、別のLLMプロバイダに乗り換えようとする

- しかし…

task_idの意味- reasoningモードのふるまい

- 内部キャッシュの仕様

を完全に再現できない - 結果、「動くけど前と同じ挙動にならない」という最悪パターン

正直、

AIプラットフォームにオーケストレーション層まで明け渡してしまう設計は、

長期的にはけっこうリスキーだと感じています。

対策としては、地味ですが、

- 自前のService層 / SDK層を必ず挟む

- アプリからは

reasoning_modeやdeepThinkのようなベンダー固有フラグを生APIで直叩きしない- 「タスク」「セッション」「メモリ」の概念を、

できるだけ自分たちのドメインモデル側に寄せておく

といった“逃げ道”設計が重要になります。

デバッグ難易度:Kubernetes初期の悪夢ふたたび

モデルが内部で勝手に

- 「こう問題を分解して」

- 「このツールを呼んで」

- 「こういう思考ステップを踏んだ」

という世界になると、

どこでミスったのかを追いかけるのが一気に難しくなります。

記事ベースでは、

- 思考トレースの可視化

- 推論ステップのログビューア

のようなダッシュボードが出てくる気配はありますが、

現場のエンジニア目線でいうと、

「Kubernetes初期のトラブルシュート」をもう一回やる

くらいの学習コストは覚悟したほうがいいです。

結局、プロダクションで使うか?正直、こう考えています

「全部置き換え」はしない。段階的な“併用”から入るべき

個人的な結論としては:

- ✅ 新規プロジェクトで、一部のハードな推論タスクに GPT‑5 / Gemini Deep Think を刺す

- ✅ 既存GPT‑4/Gemini 1.xベースのアプリは、

いきなり全差し替えではなく、“Deepスロット”を追加する形から始める - ❌ 「チャット画面のモデル名をとりあえず gpt-5 に変える」だけで本番投入

という進め方を推します。

Deep/Reasoningモードは「局所的に」使うときに真価を発揮する

Deepモードを使うべきなのは、例えばこんなケースです:

- 大規模リファクタリングの設計レビュー

- 数百ページクラスの仕様書をまたいだ影響範囲分析

- 長期タスク(数週間単位)のアーキテクチャ検討の“継続思考”

- 多数のツールを含むエージェントに「本番決定権」を持たせる前の最終検証

逆に、

- FAQボット

- 簡単なリライト

- ちょっとしたコードスニペット生成

- 会議メモの要約

レベルでDeepモードを常用するのは、

コスト的にも、設計的にも割に合わないと考えています。

まとめ:これからの「AIエンジニア」は、推論パイプラインのアーキテクトになる

GPT‑5とGemini 2.5がもたらしている変化は、

「モデルがちょっと賢くなりました」ではありません。

- 単発プロンプト → タスク継続推論

- アプリ側オーケストレーション → モデル内オーケストレーション

- プロンプト職人 → 推論パイプラインアーキテクト

という、かなり大きなパラダイムシフトです。

正直、

この波に乗り遅れると、「プロンプトうまい人」でキャリアが止まるリスクがあります。

これから必要になるのは:

- どのタスクを、どのモード(通常 / deep)で、どのベンダーに任せるか

- タスクID / セッション / メモリ / キャッシュの設計をどうするか

- ベンダーロックインとオブザーバビリティをどうバランスさせるか

といった“AI SRE/Architect”的な視点です。

GPT‑5かGemini 2.5か、で迷う前に、

「自分たちのプロダクトにおける“AI推論パイプライン”の設計図」を一度描き直してみる——

2026年の今、それが一番リターンの大きい投資だと感じています。

コメント