結論(忙しい方向け)

- Gemini 3.1 Proは重い推論と長文コンテキスト処理が得意で、設計レビューや要件からのテスト観点抽出に向く。

- 導入は段階的に:まずAI Studioで検証→Gemini APIで小さなPoC→問題なければVertexで本番化。

- 価格はフラグシップとして割安感あり。ただし現状はプレビューのため本番投入は慎重に。

想定読者: エンジニア

「また新しいLLM?」「Gemini 3.1 Pro?もう名前からしてお腹いっぱいなんだけど…」

そんな人向けに、このページだけで「Gemini 3.1 Proを、現場でどう使うか」まで一気に整理できるようにしました。

この記事を読むと、ざっくりこんなリターンがあります。

- ARC-AGI-2の77.1%という数字を、「だから現場で何が変わるのか」まで腹落ちさせられる

- ChatGPT / Claude / Gemini 3.1 Proの住み分け方を、感覚じゃなく判断軸で説明できる

- 日本の開発現場で刺さる3つのユースケース+プロンプト+疑似コードをそのまま試せる

- コスト・安定性・コンプラを踏まえた「小さく始めて炎上しない導入パターン」が分かる

「とりあえず触ったけど、結局どこで本気投入すればいいの?」とモヤっとしている人は、最後まで読めば「明日これから試すか」が1つ決まるはずです。

- もうモデル戦争追うのしんどい人へ:Gemini 3.1 Proが“スルーできない理由”

- 5分で押さえるGemini 3.1 Proのツボ:スペック表より“使いどころ”をイメージする

- 【ガチ比較】Gemini 3.1 Pro vs ChatGPT vs Claude:日本のエンジニアが選ぶならどれ?

- 日本の開発現場で刺さる3つの使い方:明日から試せるプロンプト&コード断片付き

- 本番導入で泣かないためのチェックリスト:コスト・安定性・ガバナンスのリアル

- 【Q&A】Gemini 3.1 Proを触る前にエンジニアが気にしがちな6つの疑問

- まとめ:Gemini 3.1 Proは“チートコード”じゃないけど、開発チームの地力を底上げする

もうモデル戦争追うのしんどい人へ:Gemini 3.1 Proが“スルーできない理由”

-1. 「最強モデル出すぎ問題」に疲れてるあなたのための現実チェック

「また新モデル?」「名前に数字とProとUltra付きすぎて、もはや呪文なんよ…」

正直、僕もここ1〜2年ずっとそんな気持ちです。

- ChatGPT 4.1 / 4.5 / 5.0 / 5.2…

- Claude 3 / 3.5 / 4.6 Sonnet / Opus…

- Gemini 1.5 / 2.0 / 2.5 / 3 / 3.1 Pro…

毎月どころか数週間おきに「過去最高」「LLM戦争に終止符」とかいう見出しが飛んできて、最初はワクワクして追ってたのに、だんだん「はいはい、また王座交代ね」くらいのテンションになってきた人、多いと思います。

しかも日本の開発現場だと、だいたいこんな流れになりがちじゃないですか?

- 情シスか誰かが「新しいAIがすごいらしい」とSlackにリンク貼る

- 有志がPoCして「これは未来だ!」ってスライドを作る

- 部長クラスの承認フローで数カ月溶ける

- 気づいたら、そのモデルが「一世代前」扱いになってる

結果として、

- 「精度より、とにかく安定して動いてくれ」

- 「ベンチマークの数字より、どれだけ工数削ってくれるかが知りたい」

- 「どうせまたすぐ次の出るんでしょ?今これ覚える意味ある?」

みたいな空気になりがちです。

これ、かなり多くのチームで共通してる「モデル疲れ」だと思います。

じゃあ、そんな状況でGemini 3.1 Proはスルーしていいのかというと、ここはちょっと立ち止まったほうがいいかも、というのが今回のテーマです。

理由を先にざっくり言うと、Gemini 3.1 Proは「スコアが上がりました!」って話だけじゃなくて、エンジニアの“地味だけど重い仕事”をだいぶ楽にしうる方向に振れているからです。

具体的には、こんなタイプのタスクに効いてきそうなモデルです。

- 「この設計方針で行くと、数カ月後にどこが破綻しそう?」みたいな設計レビュー

- if地獄+グローバル変数祭りのレガシーコードのリファクタ相談

- 日本語でダラッと書かれた要件書からのテスト観点洗い出し

- 大量ログを眺めながらの「そもそも何を調べるべき?」レベルの仮説出し

どれも「ちょっとコード書きます」より、“考える工数”がバカにならない部分ですよね。

残業の8割を占めてるのは、だいたいここらへんの作業じゃないかと。

Gemini 3.1 Proが面白いのは、この「考える工数」にだいぶ寄せてきているところです。

- ARC-AGI-2っていう「暗記で誤魔化せない推論テスト」で77.1%(前世代の2倍以上)という数字を出してきた

- 出典: AI-Papers「Google、Gemini 3.1 Proを発表 — ARC-AGI-2で前世代比2倍超の推論性能を達成」

(https://ai-papers.net/google-gemini-3-1-pro-complex-reasoning-flagship) - 中身に「Deep Think」系の、“ちゃんと腰を据えて考える”アーキテクチャが入っている

- しかも料金は前世代と同じで、入力$2.00 / 100万トークン据え置き

- 出典: 「Gemini Developer API の料金」(https://ai.google.dev/gemini-api/docs/pricing?hl=ja)

つまり、「よく考える頭脳をそのままレンタルできるのに、値段は据え置き」という、わりと反則気味なアップデートなんですよね。

もちろん、「はい今日から全部Gemini 3.1 Proに乗り換え!」みたいなチートコードではないです。

- Claudeのほうが人間っぽい日本語文章はうまい場面もあるし

- ChatGPTのほうが既に社内で浸透してて、教育コストが低いケースも多いし

- プレビュー版なので、本番ワークロードにガチ投入するのは様子見が必要

でも、「設計・レビュー・要件詰めみたいな“頭を使う系の作業”を、どのモデルに振るか?」という視点で見ると、Gemini 3.1 Proはかなり有力な候補になってきた、というのがこの記事で伝えたいポイントです。

このあとは、

- モデル戦争に振り回されないための「判断軸」

- そのうえで、Gemini 3.1 Proが現場のどこを変えうるか

を、できるだけ自分ごととしてイメージできるように整理していきます。

「ベンチマークはもういいから、結局どの仕事が楽になるの?」という人こそ、この先も読んでもらえると嬉しいです。

5分で押さえるGemini 3.1 Proのツボ:スペック表より“使いどころ”をイメージする

-1. Gemini 3.1 Proってどんなやつ?エンジニア目線の“ざっくりスペック表”

まずは「どこで触れて、何ができるのか」だけサクッと押さえておきます。

マーケっぽい説明は全部削って、エンジニア語に翻訳するとこんな感じです。

エンジニア視点のざっくりスペック

| 項目 | 内容 |

|---|---|

| 名前 | Gemini 3.1 Pro(プレビュー版) |

| 提供開始 | 2026年2月20日頃〜(日本からも利用可) |

| 触れる場所 | Google AI Studio / Gemini API / Vertex AI |

| モデルID | gemini-3.1-pro-preview / gemini-3.1-pro-preview-customtools |

| 得意分野 | 推論・複雑な問題解決・エージェント系タスク |

| 入力できるもの | テキスト / コード / 画像 / 音声 / 動画 / PDF(〜約1,000ページ) |

| コンテキスト | 入力 最大約100万トークン / 出力 最大約64Kトークン程度 |

| 価格(API) | 入力 $2.00 / 100万トークン、出力 $12.00 / 100万トークン(200Kトークン以内の場合)※出典: 「Gemini Developer API の料金」(https://ai.google.dev/gemini-api/docs/pricing?hl=ja) |

| 日本語 | 公式にも多言語強化をうたっていて、日本語もかなり実用レベル |

| ステータス | プレビュー(本番SLA前提のガチ運用はまだ様子見推奨) |

雑に一言でいうと、

“重めの思考”担当の、大型・多才な相棒

みたいなポジションです。

- さくっとメール文を1通書く

- 軽めのアイデアブレストをする

みたいなライトタスクだけなら、もっと安いモデル(Gemini Flash系とかGPT-5.2とか)でも正直十分なんですよね。

逆に、Gemini 3.1 Proが輝きそうなのは、

- 「仕様書+既存コード+設計メモ」をまとめて読ませて、筋の悪い設計を指摘してもらう

- 初見のCSVやログ束を投げて、“そもそも何を分析すべきか”の仮説を洗い出してもらう

- 長めの日本語要件から、テスト観点やエッジケースを掘り起こす

みたいに、「とにかくインプットが多くて、考えるステップも多いタスク」です。

100万トークンというバカでかいコンテキストがあるので、

- 仕様書(数万文字)

- 関連するコード断片

- 過去の議事録

- 既存のテストケース

このへんを1ショットでまとめて投げて、「この状態でおかしなところを洗い出して」というのが現実的にできます。

ここは、40万トークンクラスのモデル(例: GPT-5.2)と比べても、かなり効いてくるポイントです。

「スペック表」より「どこで使うか」で覚えたほうが早い

数字を全部覚える必要はなくて、まずは次の3つだけ頭に入れておけばOKだと思っています。

- 重い推論が得意

- ARC-AGI-2で77.1%と、人間にかなり近いレベルのスコア

- 「見たことないパターンを、自力で理解して解く」のがうまい

-

出典: AI-Papers「Google、Gemini 3.1 Proを発表 — ARC-AGI-2で前世代比2倍超の推論性能を達成」

https://ai-papers.net/google-gemini-3-1-pro-complex-reasoning-flagship -

とんでもなく長いコンテキストを飲み込める

- 入力100万トークンクラス

- PDF千ページでも「まあ入るよね」というサイズ感

-

複数ファイルや長期プロジェクトの文脈を一気に持たせられる

-

料金は“フラグシップ級としては安め”

- 入力$2 / 100万トークン、出力$12 / 100万トークン(標準API)

- Claude Opus 4.6の約40%程度の入力単価

- 出典: note「Gemini 3.1 Pro完全解説 — 推論性能2倍超・価格は競合の半額。」(https://note.com/ai_driven/n/nf2ad56809e0f)

- バッチAPIならさらに半額(入力$1 / 100万トークン)

この3つをセットで考えると、

「1回の呼び出しはちょっと重いけど、たくさんの情報を一気に投げて、でっかい“考える仕事”を任せるとコスパが良いモデル」

として使うのがハマりどころかな、という印象です。

「どの環境から触るか」の現実的な選びかた

エンジニア的には、「まずどこで触るのが一番ラクか?」も気になるところですよね。

個人的には、階段を3段くらいに分けて考えると楽です。

- お試し:Google AI Studio(ブラウザ完結)

- アカウントさえあればすぐ使える

- プロンプトを試しながら「Gemini 3.1 Proっぽいクセ」を掴むフェーズ

-

コードが書けないビジネスメンバーにもデモしやすい

-

小さめ実装:Gemini API(サーバーサイドから直叩き)

- Node / PythonからREST or SDKで呼び出し

- 社内ツール / バッチ処理 / Slackボットみたいな“半分本番”な用途にちょうどいい

-

料金・レート制限はGoogle AI for Developersの「料金」「レート制限」ドキュメントを参照

- https://ai.google.dev/gemini-api/docs/pricing?hl=ja

- https://ai.google.dev/gemini-api/docs/rate-limits?hl=ja

-

ガチ本番:Vertex AI(GCPインフラに組み込む)

- GCP上の既存システムと統合しやすい

- IAM / VPC / 監査ログなどガバナンス周りをきっちりやれる

- 将来的にVeo(動画生成)やImagen 4(画像生成)とも組み合わせやすい

最初からVertex AIに全振りするより、

AI Studioでプロンプト設計 → Gemini APIで小さくPoC → いけそうならVertexで本番化

くらいの3ステップで進めるのが、個人開発でも企業でも現実的かなと思います。

このセクションのポイントは3つです。

- Gemini 3.1 Proは「重い思考タスクの担当モデル」として覚える

- 推論強い+コンテキストでかい+価格はフラグシップにしては安い、の三点セット

- まずはAI Studioで“人力レビューのつもりで相談してみる”ところから始める

このあとで、「なぜ推論が強いと言えるのか?」の根拠としてよく出てくるベンチマーク比較と、ChatGPT / Claudeとの住み分けを見ていきます。

【ガチ比較】Gemini 3.1 Pro vs ChatGPT vs Claude:日本のエンジニアが選ぶならどれ?

「結局どれが一番強いの?」

ここをハッキリさせたくて記事を開いた人も多いはずなので、先に結論から言います。

最強モデルは決まらないけど、“用途別の指名打者”はかなりハッキリしてきた

です。

- よく考える係 → Gemini 3.1 Pro

- 人間っぽく、長文をきれいに書く係 → Claude(特にOpus系)

- とりあえずどこでも動く便利屋&エコノミー枠 → ChatGPT(GPT-5.2など)

このイメージを頭に置きつつ、数字と“現場の体感”ベースで整理してみます。

-1. ベンチマークでは“ほぼトップクラス”だけど…16テスト中13勝の読み解きかた

note記事「Gemini 3.1 Pro完全解説」(https://note.com/ai_driven/n/nf2ad56809e0f)でまとめられている第三者ベンチマークを見ると、ざっくりこんな感じです(抜粋・要約):

- ARC-AGI-2(抽象推論)

- Gemini 3.1 Pro: 77.1%

- Claude Opus 4.6: 68.8%

-

GPT-5.2: 52.9%

-

GPQA Diamond(難しめの科学知識)

- Gemini 3.1 Pro: 94.3%

- Claude Opus 4.6: 91.3%

-

GPT-5.2: 92.4%

-

LiveCodeBench Pro(コーディングElo)

- Gemini 3.1 Pro: 2,887

-

GPT-5.2: 2,393

-

SWE-Bench Verified(実GitHub Issue修正)

- Gemini 3.1 Pro: 80.6%

-

Claude Opus 4.6: 80.8%(わずかに勝ち)

-

MMMLU(マルチモーダルな知識テスト)

- Gemini 3.1 Pro: 92.6%

- Claude Opus 4.6: 91.1%

- GPT-5.2: 89.6%

この辺りをまとめると、

16個ある主要ベンチマークのうち、13個でGemini 3.1 Proがトップ(出典: 同note記事)

という、かなり派手な成績表になっています。

「じゃあもうGeminiで全部よくない?」と言いたくなるところですが、ここで一回落ち着きたいポイントが2つあります。

ポイント1:ベンチマークは“用意されたテストでの模試偏差値”にすぎない

SmartScopeの分析記事

「Behind Gemini 3.1 Pro's '13 out of 16 Wins'」

(https://smartscope.blog/en/generative-ai/google-gemini/gemini-3-1-pro-benchmark-analysis-2026/)でも指摘されていますが、

- どのベンチマークを選ぶか

- どういう設定(ツールあり/なし等)で走らせるか

で、結果はだいぶ変わります。

しかも、現場でやりたいことってだいたい、

- TypeScriptとGoの混在コードベースを読み解いて設計をコメントするとか

- 自社のドメイン知識+日本語で書かれた仕様+過去のトラブル事例を踏まえて提案をするとか

要するに「ベンチマークに出てこない、お作法ガン無視のタスク」なんですよね。

なので、数字はあくまで「思考系タスクに強いポテンシャルがある」という目安。

それ以上でもそれ以下でもない、くらいに見ておくのがちょうどいいです。

ポイント2:実務寄り評価では、むしろClaudeが勝っているところも多い

同じnote記事から、もう一つ重要な数字を拾います。

- GDPval-AA Elo(実務タスクの総合評価)

- Gemini 3.1 Pro: 1,317

- Claude Sonnet 4.6: 1,633

- Claude Opus 4.6: 1,606

- GPT-5.2: 1,462

ここではClaude勢が圧勝してます。

つまり、

「学術寄り・推論寄りのテストではGemini 3.1 Proが強いけど、

“実務でどう感じるか”に近い評価だとClaudeがまだリード」

という構図になっているわけです。

これは肌感としてもけっこう納得感があって、

- Gemini:めちゃくちゃ頭いい先輩エンジニア。考察は鋭いけど、ときどき返答が硬かったり、挙動が重かったりする

- Claude:話が通じやすい日本人の先輩。説明も丁寧で、文章の“行間”もいい感じに埋めてくれる

- ChatGPT:ツールチェインとの相性がよく、プラグインやサードパーティ連携も豊富な「なんでも屋」

という印象を持っている人も多いと思います。

-2. どこでClaudeに軍配が上がる?長文・ニュアンス勝負の世界

じゃあ、Gemini 3.1 ProではなくClaudeを選んだほうがいい場面ってどこなのか。

自分の利用経験と公開情報をまとめると、このあたりは今でもClaudeのほうに1票入れたくなります。

長文ドキュメントの読解&“いい感じの要約”

例:

- 5万文字級の仕様書を読ませて、仕様の要点&暗黙の前提を整理させる

- サービス規約・法務文書・監査レポートなど、お堅い日本語ドキュメントの要約+注意点抽出

この手のタスクで、

- 「読みやすさ」

- 「日本語の自然さ」

- 「表現の角の取れ具合」

まで含めて見ると、現時点ではまだClaudeが一枚上手だなと感じる場面が多いです。

特に、

- 「社外向け提案資料のたたき台」

- 「コンプラに配慮したお知らせ文」

- 「上長に送る“怒られない”説明メール」

みたいな、人間のメンタルコストが高い系のテキストは、Claudeに投げてしまうと精神衛生が良いです。

日本語での「ニュアンス調整」が必要なとき

例:

- 「ちょっとだけカジュアルだけど、砕けすぎない」

- 「相手を責めずに、しかし問題点はハッキリ伝える」

- 「若干ポジティブ寄りにトーンを調整して」

みたいな微妙なトーン調整。

Gemini 3.1 Proも十分賢いんですが、「この文章、機械翻訳感ちょっとあるな」と感じることがまだゼロではありません(※ここは今後のアップデートでかなり変わる可能性もあります)。

一方でClaudeは、日本語のスタイル指定をしたときの「ちょうどよさ」がかなり高くて、

- 「30代のエンジニアが同僚にチャットで送る感じで」

- 「社外向けだが、フランクすぎないライトな口調で」

みたいな注文に、かなりちゃんと応えてくれます。

仕様書や設計メモはGemini、

お客様向けメールや社外プレゼン資料はClaude、

みたいな役割分担がしやすいです。

-3. 用途別“ざっくり指名表”:コード・設計・文章、それぞれ誰にお願いする?

ここまでの話を、現場のタスクにそのままマッピングしてみます。

あくまで僕の感覚+公開情報ベースの暫定評価ですが、ざっくりこんな感じです。

◎/○/△くらいのノリで比較してみる

| 用途 | Gemini 3.1 Pro | ChatGPT(GPT-5.2系) | Claude Opus / Sonnet |

|---|---|---|---|

| コード生成・デバッグ | ◎(難しめのバグ調査・リファクタ相談に強い) | ○(補完・典型パターン生成は十分) | ○(コードも強いがやや保守的な印象) |

| 設計レビュー・アーキ検討 | ◎(推論系ベンチマーク高&長コンテキスト) | △(やれなくはないが、議論が浅くなりがち) | ○(設計意図の言語化はかなり得意) |

| データ分析の仮説出し | ◎(「そもそも何を調べるべき?」が得意) | ○(軽めの分析なら十分) | ○(説明の分かりやすさは高い) |

| ドキュメント整備(仕様書・議事録) | ○(構造化・観点出しは強い) | ○(スピード重視で使い勝手よし) | ◎(読みやすい日本語で整形してくれる) |

| 日本語ライティング(社外向け) | ○(十分実用、やや機械感残るケースあり) | ○(カジュアル文面は得意) | ◎(トーン調整・丁寧さのバランスが優秀) |

| 日本語チャット(日常ユース) | ○ | ◎(エコシステム含めて便利屋ポジション) | ○〜◎(対話の自然さはかなり高い) |

| コスト効率(性能あたり) | ◎(競合比で“半額クラス”のことが多い)※ | ○(モデルを選べばかなり安い) | △(Opus系は高価、Sonnetは中間) |

※価格比較は、note記事 & Google公式「Gemini Developer API の料金」(https://ai.google.dev/gemini-api/docs/pricing?hl=ja)などを参考。

実際どう使い分けるのが現実的か

少なくとも2026年2月時点での僕の答えはこれです。

- 「重い思考」タスクはGemini 3.1 Proに振る

- レガシーリファクタ設計の相談

- 要件→テスト観点の洗い出し

- 初見データの仮説出し

-

長い仕様+コードを一気に食わせる系

-

「人に読ませる長文」はClaudeに任せる

- 顧客向けメール・提案資料

- 社内規程やルール説明文

-

ネガティブなお知らせ文のトーン調整

-

「ライトタスク&ツール連携」はChatGPT系で回す

- ちょっとしたスクリプトの雛形

- JSON整形・正規表現チェック

- Notion / Slack / GitHub Apps等との既存連携をそのまま使う部分

この3枚看板で、

タスクの“重さ”と、“誰に見せる文章か”で、担当モデルを決める

というのが、今いちばんコスパがいいやり方かなと感じています。

「全部Geminiに寄せる」はアリか?

正直、小〜中規模の開発チームであれば、Gemini 3.1 Pro一本足打法も現実的になってきました。

- 推論系タスクの強さ

- 価格の安さ(特に大量トークンを投げるとき)

- Google WorkspaceやVertex AIとの統合

を考えると、

- すでにGCPを使っているチーム

- Google Workspace前提で仕事している会社

なんかは、「まずGemini前提で設計する」という選択肢も全然アリです。

とはいえ、文章のトーンや日本語の“気持ちよさ”みたいなところは、まだClaudeのほうに軍配が上がる場面も多いので、

- コアの開発フロー:Gemini 3.1 Pro

- 外向きの文章:Claude

- 雑用&既存連携:ChatGPT

みたいに役割を分けるハイブリッド構成が、しばらくは現実的な最適解かな、というのが僕の結論です。

この「よく考える係」であるGemini 3.1 Proを、日本の開発現場でどんなタスクに突っ込むと一番うま味があるのか。

次のセクションで、3つのユースケースに絞って掘っていきます。

日本の開発現場で刺さる3つの使い方:明日から試せるプロンプト&コード断片付き

ここからが一番おいしいところです。

「で、結局うちの現場で何に使えばいいの?」という問いに、

“明日ちょっと試せるレベル”まで落とし込んだユースケースを3つに絞りました。

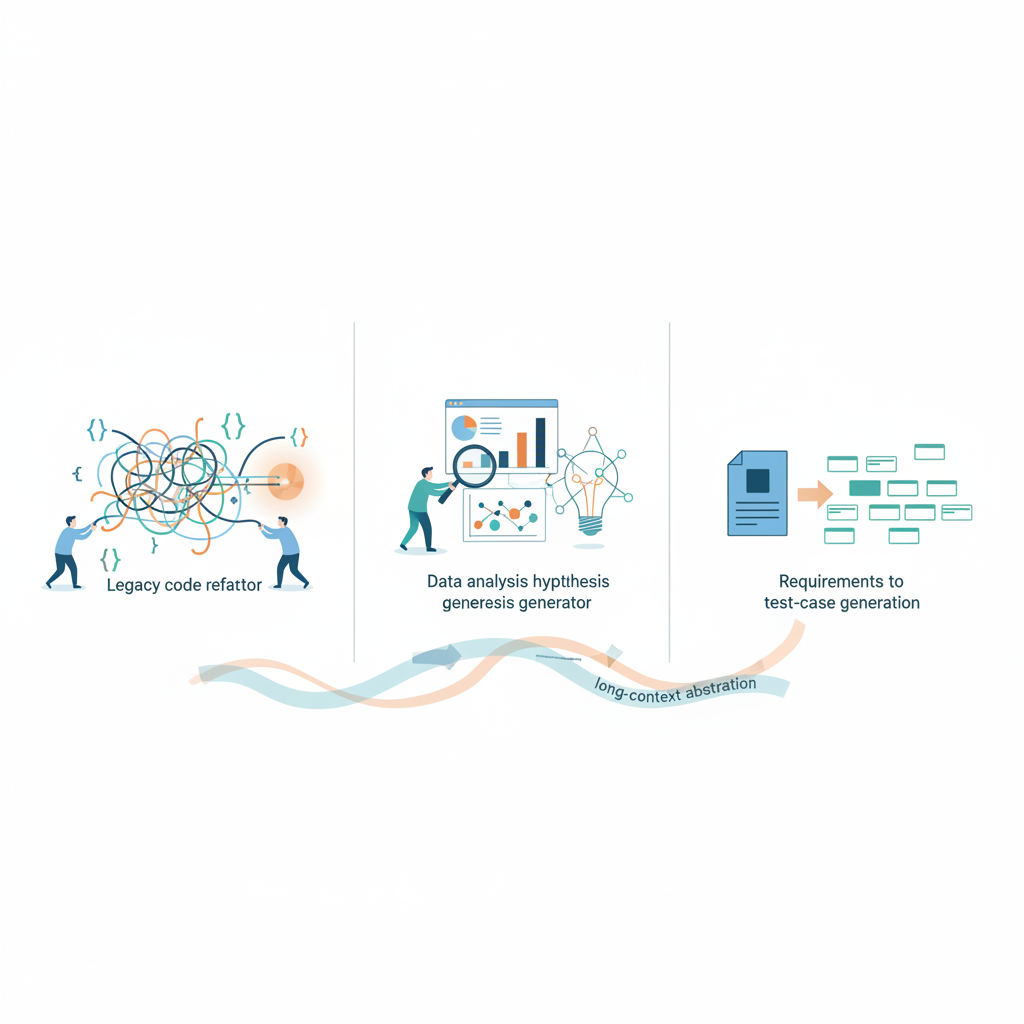

- ユースケース1:レガシーコードのリファクタ設計

- ユースケース2:データ分析の“仮説ジェネレーター”

- ユースケース3:日本語要件 → テストケース量産

どれも、Gemini 3.1 Proの「よく考える力」と長コンテキストを活かしやすいところです。

それぞれ、すぐ試せる日本語プロンプトと、APIの疑似コードもセットで置いておきます。

-1. ユースケース1:レガシーコードのリファクタ設計を“ペアプロ相手”にやらせる

まずはエンジニアの心の傷、レガシーコードから。

- 2,000行クラス

- 意味不明なグローバル変数

- if-else-else-else祭り

みたいなコードを前にすると、

「直す前にまず1時間くらい“眺める時間”が必要」なこと、ありますよね。

ここでGemini 3.1 Proにお願いしたいのは、

「実装を変える前の“設計相談”」です。

-1-1 こういうワークフローで使う

- 問題のクラス or ファイルを、部分的にコピペ(最初から全部じゃなくてOK)

- いま抱えている悩みも日本語でセットで渡す

- Geminiには、いきなり書き換えさせるのではなく、

- 現状整理

- 問題点の洗い出し

- 改善方針(設計レベル)

- 具体的な分割・責務案

までをテキストで出してもらう

コードの書き換えは、最初は人間がやったほうが安全です。

Geminiは「賢いレビュー担当エンジニア」として使うイメージ。

-1-2 明日から使える日本語プロンプト例

あなたは経験10年以上のソフトウェアエンジニアとして、 既存コードのリファクタリング方針を一緒に考えるペアプロ相手になってください。 これから、ある機能を実装しているクラスのコードを貼ります。 このクラスは以下のような問題を抱えています: - クラスの行数が多く、責務が分かれていない気がする - if文やフラグで挙動を切り替えており、分岐が追いにくい - 副作用がどこで発生しているか追いづらい やってほしいことは、**いきなり書き換えコードを出すことではなく**、 まず「どこをどう整理すべきか」の設計レベルの方針を出すことです。 出力は、次の4つのセクションに分けてください: 1. 現状整理 - このクラスが担っている責務を、あなたの理解で箇条書きにしてください 2. 問題点の洗い出し - 読みにくさ・保守性・テストのしづらさにつながりそうなポイントを列挙してください 3. 改善方針(設計レベル) - どのような観点でクラス分割・メソッド分割すべきか - 責務の切り方の案を、複数パターンあれば示してください 4. 具体的なリファクタ案 - 「クラスAをこういう責務にして切り出す」「このif文をポリモーフィズムに置き換える」など - 具体的な変更案を箇条書きで提案してください それではコードを貼ります:

// ここにJavaやTypeScriptなどの対象コードを貼る

ポイントは、

- 「いきなり書き換えるな」と最初に釘を刺す

- 求めるアウトプットの構造を明示する

- 責務・問題・改善方針・具体案の4分割を徹底する

です。

-1-3 Python+Gemini APIの疑似コード例

参考: API料金やモデル名は「Gemini Developer API の料金」

(https://ai.google.dev/gemini-api/docs/pricing?hl=ja) と

note「Gemini 3.1 Pro完全解説 — 推論性能2倍超・価格は競合の半額。」

(https://note.com/ai_driven/n/nf2ad56809e0f) をベースにしています。

import pathlib

import google.genai as genai # 公式Python SDK

client = genai.Client(api_key="YOUR_API_KEY")

code_path = pathlib.Path("src/legacy/OrderService.java")

code = code_path.read_text(encoding="utf-8")

system_prompt = """

あなたは経験10年以上のソフトウェアエンジニアとして、

既存コードのリファクタリング方針を一緒に考えるペアプロ相手になってください。

(中略:さきほどの日本語プロンプトの先頭〜出力フォーマット指定までをここに入れる)

"""

user_prompt = f"{system_prompt}\n\n対象コード:\n```java\n{code}\n```"

response = client.models.generate_content(

model="gemini-3.1-pro-preview",

contents=user_prompt,

config={

# 思考を深くしてほしいので "high"

"thinking_config": {"thinking_level": "high"}

}

)

print(response.text)

最初は、1クラスだけから始めるのがおすすめです。

「この出力なら次のクラスにも使えるな」と思えたら、少しずつ範囲を広げていく感じで。

-2. ユースケース2:データ分析の“仮説ジェネレーター”として営業&マーケを加速させる

次は、データ分析の手前の段階での使い方です。

BIツールやSQLを書く前に、

- 「そもそも何を見ればいいんだっけ?」

- 「売上落ちた原因、どこから当たりをつける?」

ここで悩んで、気づいたら夕方になっているパターン、あるあるだと思います。

Gemini 3.1 Proの「よく考える力」は、

この“仮説出し”にめちゃくちゃ相性がいいです。

-2-1 ざっくりシナリオ

例えば、こんなCSVがあるとします(すごい簡略版):

sales.csvdate, user_id, product_id, channel, revenueaccess.csvdate, user_id, session_count, device, referrer

やりたいことは、

- 「売上が先月比で10%落ちた」

- 「原因候補を3つ挙げて、それぞれ検証に使えそうなSQL案も3本ずつ出して」

みたいな、分析方針の設計です。

-2-2 日本語プロンプト例

あなたはデータアナリストとして、売上低下の原因を探るための 「仮説出し」と「分析方針の設計」を手伝ってください。 前提として、次のようなデータがあるとします: - sales.csv - date: 日付(YYYY-MM-DD) - user_id: 顧客ID - product_id: 商品ID - channel: 購入チャネル(web, app, store など) - revenue: 売上金額(円) - access.csv - date: 日付 - user_id: 顧客ID - session_count: 当日のセッション数 - device: デバイス種別(pc, sp など) - referrer: 流入元(direct, search, ad など) 状況: - 直近1ヶ月の売上が、前月比で約10%減少しています。 - プロダクトや価格自体には大きな変更はありません。 やってほしいこと: 1. 売上10%減少の「ありそうな原因候補」を3つ挙げてください。 - それぞれ、「どの指標の変化に現れそうか」もセットで説明してください。 2. 各原因候補ごとに、「検証に使えそうなSQLクエリ案」を3本ずつ提案してください。 - BigQueryの方言で書いてください。 - あくまで疑似コードレベルで構いません(テーブル名や細かい型は仮でOKです)。 3. 最後に、「まずどの仮説から検証するのが良さそうか」と、 その優先順位の理由を説明してください。 まだ実データは渡していないので、 SQLは「こういう構造のデータを前提とした雛形」として書いてください。

ここではCSVの中身をそのまま食わせなくてもOKです。

「カラム構成+状況説明」だけでも、仮説とSQL案までは出せます。

実データを投げるときは、

- ファイルをGeminiにアップロードする

- もしくはGCSやS3に置いた上で、前処理したサマリだけを渡す

など、データ量とコストに注意しつつ進めるのがよさそうです。

-2-3 Python+Vertex AIのざっくり疑似コード

GCPを前提に、Vertex AI SDKを使うイメージのコードです。

from google.cloud import aiplatform

PROJECT_ID = "your-project"

LOCATION = "asia-northeast1"

aiplatform.init(project=PROJECT_ID, location=LOCATION)

from google.genai import Client

client = Client()

SYSTEM_PROMPT = """(さきほどの日本語プロンプトをここに入れる)"""

user_prompt = SYSTEM_PROMPT

resp = client.models.generate_content(

model="gemini-3.1-pro-preview",

contents=user_prompt,

config={

"thinking_config": {"thinking_level": "high"}

}

)

print(resp.text)

ここで出てきたSQL案のうち1本だけをまず実行してみて、

「このレベルまで自動で考えてくれるならアリだな」と思えたら、

徐々に実データ連携を厚くしていくのがおすすめです。

-3. ユースケース3:日本語要件からテストケースを量産して、レビュー工数をゴリっと削る

最後は、テストケース生成です。

日本の現場あるあるとして、

- 要件定義書や議事録は日本語ベタ書き

- テスト観点を洗い出すのは、ほぼ人力

- 結果、テストケース一覧を作るのが地味にしんどい

という問題があります。

Gemini 3.1 Proにやってほしいのは、ここでの

- 暗黙の前提の補完

- 正常系・異常系・境界値の洗い出し

- テーブル形式でのテストケース案生成

までです。

-3-1 こういう流れで使う

- 要件定義書のうち、対象機能のページだけをコピペ

- Geminiに「テスト観点の洗い出し」と「テストケース案のテーブル化」をお願い

- それを人間がレビューして、JiraやTestRailに流し込む

全部自動でテストを回すのではなく、

「レビューのたたき台」を自動生成するイメージです。

-3-2 日本語プロンプト例

あなたはQAエンジニアとして、日本語の要件定義書から テスト観点とテストケース案を整理する役割を担ってください。 これから、ある画面/機能に関する要件説明を貼ります。 この要件をもとに、次の2ステップで出力してください。 --- Step 1: テスト観点の洗い出し 以下の観点ごとに、想定されるテスト観点を箇条書きで列挙してください。 - 前提条件 - 正常系 - 異常系 - 境界値 - 性能・レスポンス - セキュリティ・権限 - UX(エラーメッセージやバリデーション表示など) --- Step 2: テストケース案のテーブル化 Step 1の内容をもとに、Markdownのテーブル形式で テストケース案を一覧にしてください。 テーブルのカラムは以下とします: - ID - 観点種別(正常系 / 異常系 / 境界値 など) - テスト観点(1行でまとめた説明) - 前提条件 - 入力値・操作 - 期待結果 IDは TC-001, TC-002 のように連番を振ってください。 --- 注意点: - 要件書の中に矛盾や不明点があれば、「不明点」として別途リストアップしてください。 - 実装ではなく、あくまで要件ベースでのテスト観点整理として回答してください。 それでは要件を貼ります: ==== 要件ここから ==== (ここに日本語の要件定義書・議事録などを貼る) ==== 要件ここまで ====

要件書のコピペが長くなりそうなときは、

とりあえず1画面 or 1API単位に区切って投げるのがおすすめです。

Gemini 3.1 Proはコンテキストが大きいので、慣れてきたら

- 画面仕様

- バリデーション仕様

- エラーメッセージ一覧

あたりをまとめて一気に投げることもできます。

-3-3 Node.js+Gemini APIのざっくり疑似コード

import { GoogleGenerativeAI } from "@google/generative-ai";

import * as fs from "node:fs";

const genAI = new GoogleGenerativeAI(process.env.GEMINI_API_KEY!);

const model = genAI.getGenerativeModel({

model: "gemini-3.1-pro-preview",

});

const requirementText = fs.readFileSync(

"./specs/user-registration.md",

"utf-8"

);

const prompt = `

(さきほどの日本語プロンプトをここに貼る)

==== 要件ここから ====

${requirementText}

==== 要件ここまで ====

`;

async function main() {

const result = await model.generateContent({

contents: [{ role: "user", parts: [{ text: prompt }] }],

generationConfig: {

// ここは好みで調整。まずはデフォルトでもOK

temperature: 0.3,

},

});

console.log(result.response.text());

}

main().catch(console.error);

ここで出てきたMarkdownテーブルは、

- そのままJiraのチケットに貼る

- Confluence / Notionのテスト仕様ページに貼る

- CSVに変換してTestRailにインポート

など、既存のテストフローに組み込みやすいのもポイントです。

-4. この3つから始めると“元が取りやすい”理由

この3ユースケースに共通しているのは、

- 「人間がゼロから考えると重い」

- でも「最終判断は人がやる」

- そして「一度テンプレ化できれば、何度も使い回せる」

という点です。

Gemini 3.1 Proは、

「とりあえず聞けば何でも答えてくれるおしゃべりAI」ではなく、

“考えるコストが高い仕事”を肩代わりしてくれる参謀ポジション

として使うと、時間的にもお金的にも元が取りやすいと感じています。

- レガシーリファクタの設計レビュー

- データ分析前の仮説出し

- 要件からのテスト観点整理

どれか1つでも、「これ自分の現場に刺さりそう」と思ったものがあれば、

まずはこの記事のプロンプトをそのままコピペして、

自分のプロジェクトの断片(クラス1つ、要件1ページ)を投げてみてください。

このあと続くセクションでは、

- この3ユースケースを本番で回していくときに気をつけたい

- コスト

- 安定性

- プライバシー・コンプラ

あたりの“リアルな落とし穴”もまとめていきます。

PoCで「おお、これはいいぞ」となったあとに炎上しないために、こっちもセットで押さえておくと安心です。

本番導入で泣かないためのチェックリスト:コスト・安定性・ガバナンスのリアル

PoCまでは盛り上がったのに、本番に乗せようとした瞬間に炎上する——

生成AIあるあるです。

Gemini 3.1 Proも例外ではなくて、

- プレビュー版ゆえの“挙動の揺れ”

- 「よく考えるAI」ゆえの請求書パンチ

- 法務・情シスから飛んでくる“AIこわい”パンチ

この3つを雑に扱うと、普通に痛い目を見ます。

ここでは、

- プレビュー版あるある

- コストが爆増しないための設計

- プライバシー&コンプラまわり

の3視点で、「最低限ここは押さえておこう」というチェックリストをまとめます。

-1. プレビュー版あるある3連発:「動いたけど運用できない」を避けるには

まずは、Gemini 3.1 Proがまだプレビュー版だという事実です。

Google公式の料金ページ(「Gemini Developer API の料金」https://ai.google.dev/gemini-api/docs/pricing?hl=ja)や

AI-Papersの記事(https://ai-papers.net/google-gemini-3-1-pro-complex-reasoning-flagship)でも明言されている通り、

- モデルIDは

gemini-3.1-pro-preview - ステータスは「プレビュー」

- 今後GAに向けて挙動や制限が変わる可能性がある

この状態で、いきなりSLAガチガチの本番サービスにぶち込むのは、さすがにギャンブルです。

典型的な“プレビュー版あるある”を挙げつつ、どう付き合うか考えてみます。

あるある1:日によって回答のムラがある(モデル更新の影響)

- ある日を境に「前より賢くなった」「なんか日本語が自然になった」と感じる反面、

- 特定のプロンプトで以前より変な出力が増えることもあり得ます。

モデル自体が裏で更新されていくので、

「同じ入力 → いつも同じ出力」とは限らないのが前提です。

対策としては:

- 重要な出力は人間レビューを挟む前提で設計する

- 例:テストケース生成結果は、必ずQAリーダーが一度目を通す

- クリティカルな業務ロジックはAIに委ねない

- 例:請求金額の算出などはあくまで社内実装のみで完結

あるある2:API仕様や制限値がしれっと変わる

- レートリミットやトークン上限、エラーフォーマットなどが、

プレビュー期間中に変更されることがあります。 - 実際、Googleの「レート制限」ドキュメント(https://ai.google.dev/gemini-api/docs/rate-limits?hl=ja)でも、

「指定されたレート上限は保証されない」と明言されています。

対策:

- レスポンスを強く前提にしすぎない

400/429/5xx系のハンドリングをちゃんと書く- 「1回失敗したら終わり」ではなく、指数バックオフ+リトライを組み込む

- 上限値(RPM/TPM/RPD)は、コードにベタ書きしない

- 環境変数や設定ファイルから読むようにしておき、

変更が入ったら設定だけ差し替えればよいようにする

あるある3:同時接続数やスループットが読みにくい

- プレビュー版モデルは、本番モデルよりレート制限が厳しめなことが多いです。

- 「社内で一斉に試したらレートリミットにぶつかった」パターンが普通にあり得ます。

対策:

- まずは社内ツールやバッチ処理から使い始める

- 人間が「遅いな」と感じても、致命的にはならない領域で実験する

- BtoCの同期APIには、GAになるまで直接は繋がない

- どうしても使いたい場合は、

- 代替モデル(例:Gemini 3 Proや2.5 Pro)を用意してフェイルオーバー

- タイムアウト発生時は「後でメールで結果送付」などの非同期フローに逃がす

-2. “よく考えるAI”ほどお金がかかる問題:推論系タスクのコストをどう抑えるか

Gemini 3.1 Proの面白いところは、

内部でじっくり考える「Deep Think」的な仕組みが入っていることです。

が、そのぶん、

「中間思考が増える → トークンも増える → 請求書も増える」

という地味にシビアな現実があります。

料金のざっくり復習をしておくと(出典: 「Gemini Developer API の料金」https://ai.google.dev/gemini-api/docs/pricing?hl=ja):

- 標準API(プロンプト <= 200,000トークン)の場合

- 入力:$2.00 / 100万トークン

- 出力(思考トークン含む):$12.00 / 100万トークン

- バッチAPIだとさらに半額

- 入力:$1.00 / 100万トークン

- 出力:$6.00 / 100万トークン

「安くないけど、フラグシップとしてはかなり安い」ラインです。

とはいえ、雑に使うと普通に痛い金額になります。

ここからは、今すぐできるコスト削減テクを3つ。

テク1:事前に要件やデータを“圧縮”してから投げる

- 仕様書やログを、そのままドカッと投げない

- まず別の軽量モデルや自前スクリプトで要約してから、Gemini 3.1 Proに回す

具体例:

- 日本語の仕様書50ページ → Flash系モデルで3ページに要約

- その3ページ+重要なコード断片だけをGemini 3.1 Proに渡して、設計レビューしてもらう

これだけで、入力トークンが1/10〜1/20くらいになるケースも全然あります。

テク2:systemプロンプトで“やらせる仕事”を絞り込む

よくある悪手が、

「とりあえずこの仕様書全部読んで、気づいたことあったら教えて」

という丸投げプロンプトです。

こうするとモデルは、

- 全部読んで

- 全部理解しようとして

- そのぶん中間思考トークンも増やして

…と、不要に“フルパワー推論”モードに入ってしまいます。

避けるためには、

- 何をゴールにするかを具体的に指定する

- 例:「テスト観点のうち、境界値と異常系だけ洗い出して」

- 「この3観点だけに集中して」「この項目は無視してOK」と不要タスクを明示的に切る

のが有効です。

テク3:一問一答ではなく、1コールで“まとめ処理”をする

これもあるあるなんですが、

- 1つのクラスにつき1回API呼ぶ

- 1つのテストケースにつき1回API呼ぶ

みたいな細かい呼び方をすると、

- 毎回同じ前提説明を繰り返すことになり、

- そのたびに余計なトークンを消費します。

やりたいことが似ているなら、1回の呼び出しにまとめてしまうほうがコスパが良いです。

例:

- 悪い例:

- 10クラス分のリファクタ案を、クラスごとに10回API呼び出し

- 良い例:

- 「これから10クラスのコードを順番に貼る。

各クラスごとに1〜4のフォーマットでコメントして」と伝えて、

10クラス分まとめて1回で投げる

このほうが、

- 前提説明(システムプロンプト)が1回で済む

- モデルが「クラス間の関係」まで理解できる可能性も出てくる

というメリットもあります。

-3. 日本企業で気にされがちなプライバシー&コンプラ、どこまでケアすればOK?

最後は、一番センシティブなやつです。

- 個人情報

- 機密情報

- 取引先の名前

このへんを外部LLMに投げるとき、

日本企業だと9割方、法務 or 情シス or 情報セキュリティが出てきます。

Gemini APIの場合、

- 有料プランでは、入力コンテンツはモデル改善に使われないと公式に明記されています(料金ページより)

- とはいえ、「じゃあ何投げてもOK」では全然ない

ので、最低限この3つは押さえておきたいです。

チェック1:投入データのマスキング・抽象化

- 個人名、メールアドレス、電話番号、住所

- 取引先企業名、具体的な金額・契約内容

などは、可能な限りマスキング or 抽象化しましょう。

例:

山田太郎→ユーザーA株式会社〇〇商事→主要取引先X- 金額はレンジにする(「約500万円〜600万円」など)

設計レビューやテスト観点出しなら、

固有名詞がなくても十分機能するケースが多いです。

ここをしっかりやっておくと、

社内レビューのときに法務・監査部門への説明がかなり楽になります。

チェック2:アクセス経路をちゃんと制御する

Googleのドキュメントを見ると分かりますが、

- Gemini APIはプロジェクトごとのレート・請求管理

- Vertex AI経由なら、VPC Service ControlsやIAMなどGCP標準のガバナンスが使える

ので、できれば以下のような構成がおすすめです。

フロントエンド → 自社バックエンド → Gemini API or Vertex AI

つまり、

- ブラウザやモバイルアプリから直接Gemini APIを叩かない

- 自社バックエンドで

- APIキーの管理

- ログの管理

- データのマスキング

- レート制限

を一手に引き受ける

形にしておくと、“どこに何が流れているか”を説明しやすくなります。

チェック3:Google側のポリシーと社内ポリシーの差分を確認しておく

Googleの料金ページやドキュメントには、

- 無料枠では「プロダクト改善にコンテンツを使う」

- 有料枠では「プロダクト改善には使わない」

などの違いが書かれています(料金ページの「プロダクトの改善に使用されます」の欄)。

社内で説明するときには、

- どのプラン(無料 / 有料 / Enterprise)で使うのか

- そのプランでは、Google側でコンテンツがどう扱われるのか

- それに対して、社内でさらに

- マスキング

- ログ管理

- 利用範囲の制限

をどうしているか

をセットで文書化しておくと、監査・法務からのツッコミをかなり捌きやすくなります。

-4. “これだけは”チェックしてから本番に乗せよう(簡易リスト)

最後に、ここまでの話をざっくりチェックリスト化しておきます。

どれか1つでも「No」のまま突っ込むと、だいたい後で泣きます。

プレビュー運用チェック

- [ ] プレビュー版(

gemini-3.1-pro-preview)であることを、チーム全員が理解している - [ ] 重要な出力には必ず人間レビューが入るフローになっている

- [ ] APIエラー(4xx/5xx)のリトライ&フォールバックを実装している

- [ ] SLAが必要な部分には、別モデル or 別ロジックのフェイルセーフがある

コスト・設計チェック

- [ ] 仕様書やログは、可能な範囲で要約してからGemini 3.1 Proに渡している

- [ ] systemプロンプトで「やらせる仕事」を具体的に絞り込んでいる

- [ ] 同じ前提説明を何度も繰り返さないよう、複数タスクを1コールにまとめる設計をしている

- [ ] 大量バッチ処理は、可能な限りバッチAPI(半額)で回す検討をした

プライバシー・コンプラチェック

- [ ] 個人情報や機密情報は、可能なかぎりマスキング or 抽象化している

- [ ] フロントから直接Gemini APIを叩かず、自社バックエンドを経由している

- [ ] どのプラン(無料/有料/Enterprise)で使うかを決め、そのポリシーを読んでいる

- [ ] 社内のAI利用ポリシーに、「Gemini 3.1 Proをどの範囲で使うか」が明文化されている

ここまでやっておけば、

「PoCはすごかったのに、本番で炎上した…」

をかなりの確率で避けられます。

Gemini 3.1 Proは、確かに強力なモデルです。

でも、チートコードではありません。

- プレビューならではの“揺れ”

- よく考えるゆえの“コスト”

- 外部サービスに乗せる以上の“ガバナンス”

この3つを丁寧に扱ってあげることで、

「現場の地力を底上げしてくれる相棒」として、長く付き合えるはずです。

次は、このあたりの疑問を補完する形で、

「導入前によく聞かれるQ&A」をまとめていきます。

【Q&A】Gemini 3.1 Proを触る前にエンジニアが気にしがちな6つの疑問

「よさそうなのは分かった。でも、まずここが気になるんだよな…」

というポイントを、Q&A形式でざっくり拾っていきます。

Q1. 日本語の精度って実際どう?英語だけ強いパターンじゃない?

「また英語だけ無双して、日本語は“とりあえず動きます”程度なんでしょ?」

これは僕も最初に疑ってたところです。

結論からいうと、

技術系日本語+ビジネス日本語なら、かなり実用ラインに乗ってきた

という印象です。

- 技術要件の要約

- コードの日本語解説

- 設計レビューコメント

- 要件からのテスト観点洗い出し

この辺は、ほぼ違和感なく読めるレベルで返してくれます。

一方で、

- 「人間味あふれるストーリーを書いて」

- 「ブログの導入文をエモくして」

みたいな“文芸寄り”のタスクだと、

現時点ではClaudeのほうが一歩リードかな、という場面もまだあります。

なので、

- 論理+構造重視の日本語 → Gemini 3.1 Pro

- トーン・言い回し重視の日本語 → Claude

という使い分けをすると、だいぶ気持ちよくハマります。

Q2. もうChatGPT課金してるけど、Gemini 3.1 Proにもお金を出す意味ある?

「サブスクこれ以上増やしたくない問題」、めちゃくちゃ分かります。

ここは“乗り換え”として考えないほうが楽です。

- ChatGPT(GPT-5.x系):

- 日常チャット・ちょいスクリプト・軽い文章作成・既存連携(プラグイン等)の便利屋

- Gemini 3.1 Pro:

- 設計レビュー、仮説出し、重めの推論タスク担当

というふうに、「タスクごとに担当モデルを変える」発想がおすすめです。

たとえば:

- ふだんの雑多な質問やメモ起こし → そのままChatGPTでいい

- レガシーコードの構造を相談したい/要件からテスト観点を洗いたい → ここだけGemini 3.1 Proに振る

という形にすれば、

- 追加コストは「重いタスク分だけ」

- でも一番つらい作業の肩代わりは、しっかりしてもらえる

ので、「両方に課金する意味」は十分あると思っています。

Q3. 個人開発や小規模チームでもVertex AI / Gemini API導入って現実的?

GCP=でかい会社、というイメージがあるかもしれませんが、

Gemini 3.1 Proに関してはかなりライトに始められます。

おすすめの進め方はこの2ステップです。

- Google AI Studioで遊ぶフェーズ

- ブラウザだけで完結

- プロンプトを試しながら、「どんなタスクで役立ちそうか」感覚を掴む

-

チームに見せるデモもここで作る

-

必要になったらGemini API or Vertex AIに進むフェーズ

- 個人開発や小規模サービスなら、

- 自前バックエンド(Rails / Next.js / FastAPIなど)

- からGemini APIを直叩き

という構成で十分

- 既にGCPを使っている or エンタープライズ要件があるならVertex AIで

構成イメージはシンプルで、

フロント(既存Web or SPA)

→ 自社バックエンド(APIサーバー)

→ Gemini API or Vertex AI

の三段ロケットでOKです。

「いきなりGCPガチ構成にする」のではなく、

- まずはAI Studio+簡単なバックエンド

- それで手応えが出てから本格インフラに寄せていく

くらいのノリで十分回せます。

Q4. 社内のAIポリシーがまだフワッとしてるけど、今のうちに何を決めておくべき?

「AI使いたいけど、会社としてのルールがまだないんだよな…」

という状態、かなり多いと思います。

全部を完璧に決める必要はなくて、

まずはこの4つだけでも決めておくと、後から揉めにくいです。

- 投入OKなデータ/NGなデータの線引き

- OK例:

- 公開済みの仕様書・マニュアル

- 匿名化されたログ・ダミーデータ

-

NG例:

- 個人名・メールアドレスが入った生データ

- 未公開の経営数字・契約書全文

-

ログの扱い

- どこまでログを残すか(プロンプト/レスポンス/サマリだけ等)

- どれくらいの期間保管するか

-

ログへのアクセス権限を誰に与えるか

-

APIキーの管理方法

- リポジトリに直書きしない

- Secret ManagerやVaultで管理

-

発行・失効フローを簡単にでもドキュメント化

-

モデル更新時の検証フロー

- 主要プロンプトをスモークテスト的に自動実行できるようにしておく

- 挙動が変わったら、どの範囲まで人間が確認するかを決めておく

この4つを「社内向けAI利用ガイド(v0.1)」くらいのノリでまとめておくと、

上長や法務と話をするときも、だいぶ会話が楽になります。

Q5. 学習コストが不安…チームに広めるならどんな勉強会をやればいい?

「自分は触る気あるけど、チームを巻き込むのがしんどい」問題、ありますよね。

がっつり講義をする必要はなくて、

“ゆるい場”をいくつか用意しておくと、勝手に広まっていきます。

個人的におすすめなのはこの3つ:

- プロンプト設計LT会

- 各自が「うまくいったプロンプト」「失敗したプロンプト」を5〜10分で共有

- テーマ例:

- 「設計レビューに効いたプロンプト」

- 「レガシー調査で役立った聞き方」

-

ツールはGeminiでもChatGPTでも何でもOK

-

ユースケース別ハンズオン

- 今日の記事で挙げた3ユースケース(リファクタ相談/仮説出し/テストケース生成)から1つ選ぶ

- 事前にサンプル入力を用意しておき、全員で同じプロンプトを試す

-

「こうしたらもっと良くなった」とか、「ここは怪しかった」などをその場で議論

-

失敗プロンプト共有会

- あえて「うまくいかなかった事例」だけを集める会

- どこがダメだったのか、どう直せばよさそうかをみんなで考える

- 成功談よりも、チームの“AI耐性”が一気に上がるのでおすすめです

Gemini 3.1 Proに限らず、

こういう場を月1くらいで回していると、

- 「AI使うのは特定の好き者だけ」という状況から

- 「チーム全体が“とりあえず投げてみる”文化」に

じわっとシフトしていきます。

Q6. まず何を試せば“Gemini 3.1 Proの良さ”を実感しやすい?

最後に、「で、最初の一歩どこよ?」という話。

推論の強さを一番体感しやすいのは、たぶんこの3つのどれかです。

- レガシーコードのリファクタ相談

- 1クラスだけ選んで、この記事のプロンプトをほぼそのまま投げる

-

「現状整理→問題点→改善方針→具体案」の4ステップでちゃんと返ってくるかを見る

-

日本語要件 → テスト観点出し

- 要件書の1ページをそのままコピペ

- 正常系・異常系・境界値の観点+テストケーステーブルを作らせる

-

自分が考えたものとどこが被っていて、どこが追加で出てきたかを比較

-

「売上が落ちた」系の原因仮説ブレスト

- 実データはまだ要らないので、

- 状況説明

- 持っているデータのカラム情報

だけ渡す

- 原因候補と、その検証に使えそうな指標・SQL案を出してもらう

どれも、

- インプットをちょっと用意するだけ

- 結果は人間が簡単に評価できる

- 当たれば即・実務に活かせる

という意味で、“初回デモ”としてコスパが良いタスクです。

このQ&Aセクションのポイントをざっくりまとめると、

- 日本語は「技術+ビジネス用途」ならかなり実用ライン

- ChatGPTを捨てる必要はなく、「重い思考だけGeminiに振る」のが現実的

- 個人/小規模でも、AI Studio+シンプルなバックエンド構成なら全然いける

- 社内ポリシーは、まず「投入データ」「ログ」「APIキー」「モデル更新時の検証」の4点だけでも決めておく

- チーム展開は“ゆるい勉強会”から始めると、勝手に広がっていく

- 最初の一歩は、レガシー相談・テスト観点出し・仮説ブレストあたりが鉄板

まとめ:Gemini 3.1 Proは“チートコード”じゃないけど、開発チームの地力を底上げする

ここまで読んでくれた方はだいたい察してると思うんですが、

Gemini 3.1 Proって、

「押した瞬間にすべてのバグが消える“チートコード”」

ではなく

「ちゃんと考える系の仕事を、一緒に背負ってくれる“賢い相棒”」

くらいの立ち位置なんですよね。

最後に、この記事のポイントと“次の一手”を、ギュッとまとめます。

-1. 3行で振り返るGemini 3.1 Proのインパクト

-

“ちゃんと考える系タスク”に強い大型モデル

ARC-AGI-2で77.1%という推論スコア(出典: AI-Papers「Google、Gemini 3.1 Proを発表 — ARC-AGI-2で前世代比2倍超の推論性能を達成」)+100万トークン級コンテキストで、

設計レビュー・レガシーリファクタ相談・データ分析の仮説出し・日本語要件からのテスト観点洗い出し、といった「頭をフル回転させる仕事」をだいぶ手伝えるポテンシャルがあります。 -

最強ではないけど、“用途別の指名使い”でかなり刺さる

ベンチマーク16項目中13勝という派手な数字がある一方で、実務タスク評価(GDPval-AA)やツール統合タスクでは、Claudeに軍配が上がる場面もある(出典: note「Gemini 3.1 Pro完全解説 — 推論性能2倍超・価格は競合の半額。」https://note.com/ai_driven/n/nf2ad56809e0f)。

「よく考える係:Gemini」「人に読ませる長文係:Claude」「雑用&既存連携係:ChatGPT」という役割分担が、一番現実的な落としどころかな、というのが僕のスタンスです。 -

日本の開発現場なら、この3つから入るとコスパがいい

- レガシーリファクタの“設計相談”

- 売上低下などの“原因仮説ブレスト”

- 日本語要件 → テストケース案の量産

この3つは「人間がゼロからやると重い」「でも最終判断は人がする」タイプの仕事なので、Gemini 3.1 Proの“考える力”と相性がよく、かつ導入リスクも低めです。

-2. 今日からできる“お試し3ステップ”:小さく始めて、チームに広げる

最後に、「じゃあ何からやればいいの?」に対して、具体的な一歩を3つだけ。

Step 1. AI Studioで“自分の案件の断片”を投げてみる

- Google AI Studioを開いて、モデルを

gemini-3.1-pro-previewに切り替える - 自分のプロジェクトから、

- クラス1つ

- 要件書1ページ

- 分析したい指標のメモ1枚

くらいの“小さい断片”を選ぶ - 記事中のプロンプト(リファクタ相談 / テスト観点 / 仮説出しのどれか)をほぼコピペして投げてみる

→ 「あ、このレベルまで考えてくれるならアリだな」と思えたら、次へ。

Step 2. いま使っているAIツールの“ツラいところ”をリストアップする

たとえば:

- ChatGPTだと「設計の踏み込みが浅くて、結局自分で考え直している」

- Claudeだと「日本語はいいけど、コンテキストがキツくて長い仕様+コードを一気に食わせづらい」

- 安いモデルだと「レガシーの読み解きみたいな重い仕事にはちょっと力不足」

みたいな「今のAI環境の不満リスト」を、一度洗い出します。

その中から、

「ここだけでもGemini 3.1 Proに振ってみる価値ありそう」

というタスクを1つだけ選ぶのがポイントです。

全部を置き換えようとすると、だいたい途中でしんどくなります。

Step 3. チーム内で“小さなAI実験”を1つだけ企画する

- 題材:

- レガシーコードの一部

- 直近の障害のポストモーテム

- これから作る機能の要件書1枚

- やること:

- Gemini 3.1 Proに対して、この記事のテンプレプロンプトを投げる

- 出てきた結果を、チームで一度一緒にレビューしてみる

- ゴール:

- 「どこが便利だったか/どこが危なかったか」を10〜15分だけ話す

これくらいのライトな実験でも、

- “1人の趣味”から

- “チームの武器候補”

に昇格させるには十分です。

僕個人としては、

「Gemini 3.1 Proを触った結果、どのタスクに効いたか/イマイチだったか」

みたいな話を、ぜひ聞いてみたいなと思っています。

もしどこかのタイミングで試してみたら、Xでもnoteでも会社のLTでもいいので、どこかに感想を投げておいてもらえると、そのうち僕が勝手に拾って、また次のネタにします。

LLM戦争のスピードは正直しんどいですが、

自分の現場の“だるい仕事”を1つずつAIに押し付けていければ、

1年後にはけっこう違う景色が見えているはずです。

まずは、クラス1つ・要件1ページ・ログ1部屋分くらいから。

Gemini 3.1 Proを、“チートコード”じゃなくて“地力アップ装置”として、うまく使い倒していきましょう。

参考記事: note - GoogleがGemini 3.1 Proを発表!ARC-AGI-2で77.1%達成の超知性AIモデルとは?(2026年2月)|AI Study Boost

コメント