「LLMのセキュリティレビュー、どうやってやる?」と聞かれて、

正直「手動でレッドチームしてるだけです…」と心の中でつぶやいたこと、ありませんか?

- プロンプトインジェクション対策は一応やったつもり

- ツール権限もなるべく絞ったつもり

- でも「本当にこれで安全か?」と聞かれたら自信はない

そんなモヤモヤを抱えたタイミングで出てきたのが、Anthropicの「AI脆弱性管理機能」です。

これはちょっと、無視しづらい一手です。

結論(忙しい方向け)

- Anthropicの新機能は「LLMアプリの脆弱性を静的+動的に継続スキャンする」方向で、プロンプト小手先の対策より一段上です。

- ただし誤検知・コスト・ロックインが現実の壁。まずはPoCで“どんなリスクが見えるか”の棚卸し用途が適任です。

- 本番は「これだけで安心」ではなく、権限設計・ログ/監査・自社ルールとセットで運用する前提に。

想定読者:LLMアプリ開発者/セキュリティ担当/PoC責任者

一言でいうと「LLM版・コンテナ脆弱性スキャナ」が出てきた

今回のAnthropicの機能を一言で説明すると、

「LLMアプリケーションのための、Snyk / Aqua Security 的な“脆弱性スキャナ+継続監視プラットフォーム”」

です。

- 静的解析:プロンプト構造や設定をチェック

- 動的解析:攻撃的なプロンプトを自動生成して実際に叩く

- 結果を「脆弱性」として一覧化し、深刻度や対応策を提示

- 運用フェーズも含めて継続的にスキャン

という流れで、LLMアプリ全体を1つの「対象システム」として扱う。

これは、単なる「プロンプトのベストプラクティス集」や「NGワードフィルタ」とは明確に一線を画しています。

歴史的なアナロジーでいうと、

Dockerが普及して「動くコンテナ」は誰でも作れるようになった後に、

「そのコンテナの中身、本当に安全?」とチェックする専用ツール群が出てきたフェーズ

に非常によく似ています。

- Docker = LLM/Claude(新しい実行基盤)

- Snyk/Aqua = AnthropicのAI脆弱性管理(その基盤の“専用セキュリティレイヤー”)

という構図です。

何が本当に新しいのか:モデルの「外側」をちゃんと見始めた

今回の発表で、技術的に一番意味があるのはここだと思っています。

「モデルそのもの」ではなく「LLMアプリ全体」を見る

これまで多くのベンダーがやってきたのは、

- モデルに安全チューニングをかける

- 有害コンテンツをフィルタリングする

- システムプロンプトで行動を縛る

といった、「モデルの中身」を安全にする方向でした。

Anthropicが今回打ち出しているのは、

- プロンプトインジェクション

- ガードレール回避

- ツールの誤用(外部API・DB・ファイル操作)

- 機密情報の漏えい

のような、「LLMを組み込んだアプリケーションとしての振る舞い」を

静的+動的にスキャンするというアプローチです。

正直、ようやくここに来たか、という感じです。

現場でヒヤッとするのは、モデル単体の回答より「周辺システムとの組み合わせ」で起きる事故が圧倒的に多いので。

単発レッドチーミングから「継続的スキャン」へ

もう1つ本質的なのは、「運用フェーズ前提」の設計になっている点です。

- リリース前に一回だけレッドチームを走らせて終わり

- あとはユーザーの苦情が来たら調査

というやり方では、LLMアプリの進化スピードにまったく追いつけません。

- プロンプトを変えれば挙動が変わる

- 外部ツールが増えればリスク面も変わる

- モデルのバージョンアップでも安全性は揺れる

この変化に対して、「CI/CDにAI脆弱性スキャンを組み込む」という未来が

かなり現実味を帯びてきたのは、開発者としては無視できないポイントです。

競合と比べると何が違う?:Azureや専業ベンダとの立ち位置

ここが一番「戦略として面白い」ところです。

Azure / 大手クラウドとの違い

Azure OpenAI + Azure AI Content Safety のような大手クラウドのAIセキュリティは、

- モデル入出力のフィルタリング

- ポリシーベースの制御

- ログ・監査機能との統合

が中心で、「クラウド全体のセキュリティスイートの一部」という位置付けです。

対して、今回のAnthropicはかなり違う方向を向いています。

- LLMアプリケーションに対して「わざと攻撃入力を投げて挙動を見る」

- それを継続的にやり、ダッシュボードで“脆弱性管理”する

- しかも「Claude専用」ではなく、マルチモデル前提をうたう

つまり、

「クラウドセキュリティの1機能」ではなく

「AIアプリケーション・セキュリティ専用プラットフォームの座を取りに来ている」

という印象が強いです。

Azureは「城壁全体を強くする」方向。

Anthropicは「AIゲートウェイ部分に専用の検問所を立てる」方向。

そんな分担に見えます。

一番ダメージを受けそうなのは誰か

正直、一番プレッシャーを感じるのは、

- プロンプトインジェクション対策SaaS

- LLM用DLPツール

- AIレッドチーミング専業のスタートアップ

あたりでしょう。

「とりあえずモデルベンダがくれる標準機能から試すか」というのは

エンタープライズではかなり自然な選択肢です。

- まずAnthropicのスキャンを入れて

- どうしても足りない部分だけ専業ツールで補う

という順序になると、ニッチな単機能SaaSは真っ先に削られます。

コンテナ界隈で、Docker公式やクラウドベンダのスキャナが充実してきて、

サードパーティが苦しくなった構図にかなり近いものを感じます。

とはいえ「これで安心」とは全く言えない理由

技術的な方向性としてはかなり良い線を突いていますが、

じゃあ「これを入れたら本番で安心か?」と言われると、正直まだ様子見だと思っています。

コスト:テスト流量が普通に痛い

動的解析ということは、つまりこうです。

- 攻撃パターンをたくさん生成する

- それをアプリに対してひたすら投げる

- 結果もすべて評価する

トークンもAPIコールも、かなり食います。

- 本番トラフィック

- スキャン用トラフィック

をきっちり分けて、コストを管理しないと、

「セキュリティテストの請求が本番利用を超えた」という笑えない話になりかねません。

CI/CDに統合したくても、「毎PRごとにフルスキャン」は現実的ではなく、

どこまでを自動、どこからを定期スキャンにするか、設計のひと工夫が必要になります。

誤検知・過検知との付き合い方

LLMの挙動は本質的に確率的でコンテキスト依存です。

- あるプロンプトでは安全だった

- 似たような別のコンテキストでは危険な回答をした

こういう揺らぎが普通にあります。

その上で、

- 脆弱性スキャナが「危ないかもしれない」とフラグを立てる

- でも実環境ではまず起きないパターンかもしれない

- あるいはビジネス的には許容できるリスクかもしれない

ここを人間のセキュリティチームと開発チームがトリアージする必要があります。

ぶっちゃけ、「これを入れたから自動で安全になる」という類のツールではなく、

「リスクの見える化をしてくれるが、最後の判断は普通にしんどい」

タイプのツールです。

ここを勘違いして導入すると、「アラートだらけで結局誰も見なくなる監視ダッシュボード」の再来になります。

ベンダーロックインの“にじみ出る”リスク

Anthropicは「モデル非依存」を強調していますが、

セキュリティ系のプラットフォームはだいたい、次のようなフックを要求してきます。

- 特定フォーマットでのログ出力

- 特定プロキシ経由での通信

- 計測用のSDKやエージェントの組み込み

これ自体は仕方ないのですが、長期的に見ると、

- ログ設計

- 権限設計

- モニタリング構成

がAnthropic前提で固まってしまうと、

将来「モデルもクラウドもごっそり変えたい」となったときの移行コストが一気に跳ね上がります。

「モデルはマルチ、でもセキュリティレイヤーはAnthropic一本足」という構図は、

中長期的なアーキテクチャとして本当に採用していいか、冷静に検討したほうがいいポイントです。

カバレッジの限界:業界固有要件は結局自前

動的スキャンであっても、当然ながら「全攻撃パターンカバー」は不可能です。

特にきついのは、

- 金融・医療・公共などの業界特有のコンプライアンス

- 社内固有の運用ルールや、組織ごとの“NGな振る舞い”

といった領域です。

ここはどうしても、

- 自社のポリシーに沿ったカスタムルール

- 内部データとの組み合わせにおける「絶対にやってはいけない操作」の定義

を自前で作り込み、Anthropicの検査結果と組み合わせて運用する必要があります。

コミュニティの空気感:期待と不信が同居している

海外コミュニティの反応を追っていると、トーンはだいたいこんな感じです。

- 技術的には「めちゃくちゃ面白い」「方向性は正しい」

- でも「セキュリティ製品として本番で信用するにはまだ怖い」

特に象徴的だったのが、同じタイミングで話題になった

- PromptArmor研究者による「Files APIの情報流出脆弱性」指摘

- Claude Cowork(AIエージェント)のリサーチプレビュー公開

の組み合わせです。

「自分たちのFiles APIで脆弱性を指摘されている会社が、

AIの脆弱性管理プラットフォームを売るって、ちょっと複雑だよね」

というムードは、正直あります。

とはいえ、

- きちんと脆弱性を受け入れて修正している

- 外部研究者との協働を前提にしているように見える

という点はポジティブに評価されていて、

「AIツールチェーン+人間レッドチームのハイブリッドで運用するのが現実解では?」

という意見も出てきています。

個人的にも、これはかなり現実的な落としどころだと感じます。

じゃあプロダクションで使うか?:結論「PoCまでは全力、本番はまだ慎重」

エンジニアとして・プロダクト側として、どう判断するか。

正直なところ、今の段階の結論はこうです。

こういう使い方なら「今すぐにでも試す価値あり」

- 社内PoCや検証環境でのLLMアプリに対して

- プロンプトインジェクション耐性をざっくり可視化したい

- どんな類のリスクが潜んでいるか、ざっと棚卸ししたい

- CIの一歩手前の「事前スキャン」として

- セキュリティチームと開発チームが対話するための共通の“地図”がほしい

このレベルなら、むしろ積極的に使ったほうが学びが多いと思います。

- どんなパターンでガードレールをすり抜けるのか

- どこまで自分たちの設計が甘かったのか

- どの項目がビジネス的に本当に痛いのか

を短時間で炙り出す「副操縦士」としては、かなり有望です。

こういう使い方は「正直、まだ様子見」

- 顧客データを含む本番LLMアプリの「唯一のセキュリティ防波堤」として使う

- 「Anthropicでスキャンしてるから大丈夫」と経営層に説明する前提にする

- 規制業種でのコンプライアンス担保をこのサービスに大きく依存する

ここまで踏み込むには、

- サービスの安定性

- 契約・責任分界

- 監査ログ・説明責任の仕組み

が、もう一段レベルアップするのを見てからでも遅くはないと考えています。

最後に:これは「魔法の盾」ではなく、セキュリティ文化を変えるためのきっかけ

AnthropicのAI脆弱性管理機能で、一番重要なのは機能そのものよりも、

「LLMアプリの開発ライフサイクルに“セキュリティスキャン工程”を入れるのが当たり前になるかもしれない」

という文化の変化のほうです。

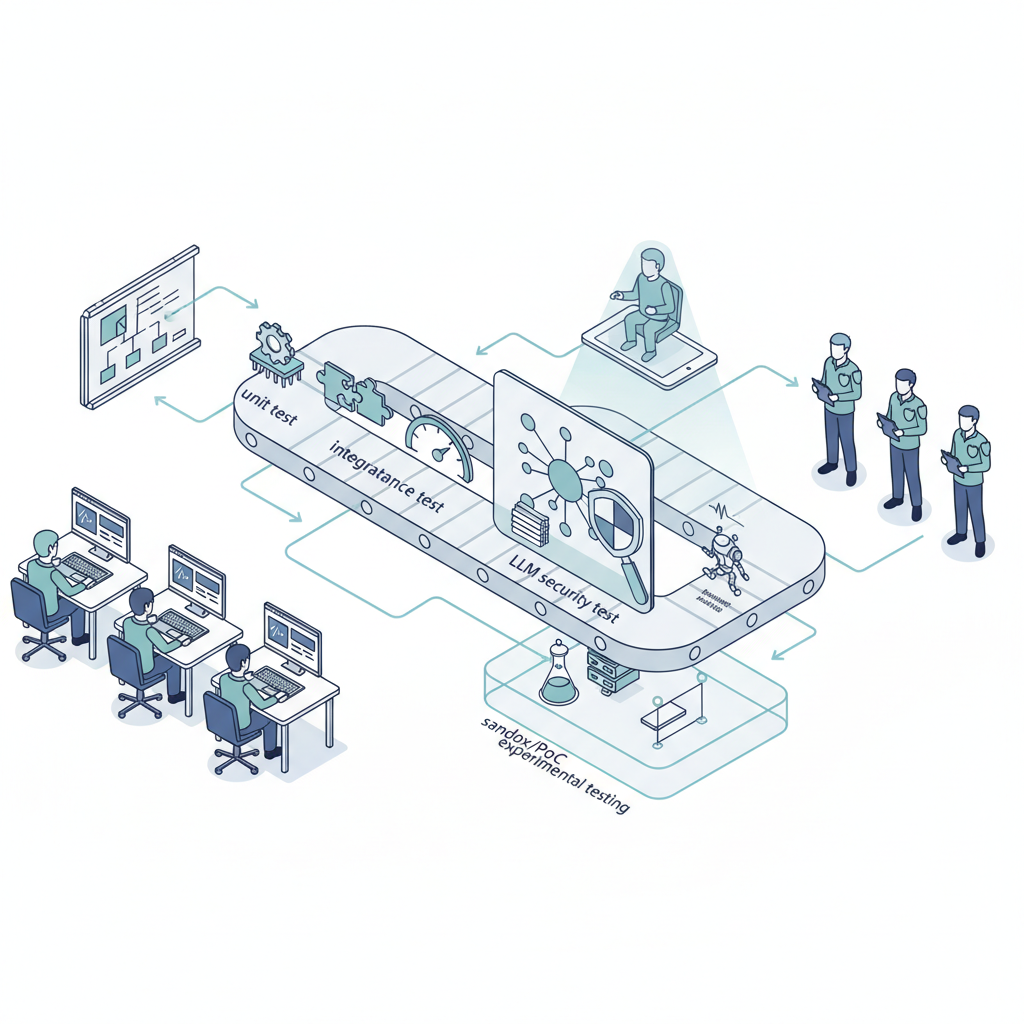

- ユニットテスト

- 統合テスト

- パフォーマンステスト

に続いて、

- LLMセキュリティテスト(静的+動的)

がCI/CDに組み込まれる。

これが当たり前になったとき、やっと「AI時代のセキュア開発」が土台から回り始めます。

その意味で、今回のAnthropicの一手はかなり大きい。

ただし、期待する役割は「本番の守護神」ではなく、

セキュリティチームと開発チームの間に座る「優秀なアシスタント」

= まずは“副操縦士”として使う

くらいに捉えるのがちょうどいいバランスだと感じています。

プロダクションに全面導入するか?

正直、今はまだ様子見です。

でも、PoC環境に入れて「どんな脆弱性が見えてくるか」を確認する価値は、十分にある。

そしてそこで得た知見は、Anthropicを使うかどうかに関わらず、

自社のAIアーキテクチャ設計とセキュリティポリシーに確実にフィードバックできるはずです。

コメント