「Opusレベルの性能が“デフォルト”になった世界」で、あなたの設計はまだ大丈夫ですか?

その症状、心当たりありませんか?

- ちょっと複雑なコードレビューをさせたいだけなのに、毎回フラグシップモデルを叩いて請求が地味に痛い

- 「長時間エージェント」を作ろうとすると、コンテキスト切れで途中から別人格になってしまう

- 無料ユーザー向けには性能をだいぶ妥協したモデルを出さざるを得ず、体験の差がエグい

こういうところでモヤモヤしたこと、ありませんか?

そのモヤモヤに、かなりストレートに刺さるアップデートが出ました。

Anthropicの「Claude Sonnet 4.6」です。

一言でいうと、「Opusを使う理由をかなり奪ってくるやつ」

ニュースとしてはシンプルです。

- Sonnet 4.6 が登場

- 性能は「これまでOpusクラスに頼っていたタスクも、だいたいこなせる」とAnthropic自身が言うレベル

- それでいて 価格は従来のSonnetのまま(入力100万トークン$3 / 出力$15)

- 無料・Proユーザーの デフォルトモデル にもこのクラスが降りてきた

- そして 1Mトークンコンテキスト(ベータ) 付き

一言で言うと、

「Opus級エンジンを、v8になったNode.jsみたいな“仕事用デフォルト”のポジションに落としてきた」

という印象です。

昔、Node.js v8 でパフォーマンスと非同期周りが一気に整って、「もう重いフレームワーク使わなくてよくない?」となった瞬間がありましたよね。

あのときに近い “ワークホースの世代交代” を、LLMのミドルレンジでやってきたのが今回のSonnet 4.6だと感じています。

なにがそんなにヤバいのか:単なる「ちょい精度アップ」ではない

正直、モデルアップデートのたびに「推論性能が○%向上しました」系の話には、エンジニアとしてはだんだん疲れてきます。

でもSonnet 4.6は、数字以上に設計判断を変えざるを得ないレベルで“バランス”が変わった点がポイントです。

-1. 「Opusレベルの推論」をミドルレンジ価格で

報道・Anthropicのコメントを総合すると:

- 推論・コーディングの質がOpus 4.6クラスにかなり近づいた

- 長いマルチステップ推論やコーディングで、

旧Sonnetよりも 忠実度が高く、ハルシネーションが減った - 一部ワークフローでは Opus 4.5より指示への忠実度が高い というテスター報告も

つまり、これまで

- 「ちょっとでもミスると事故るやつ → Opus」

- 「そこまでじゃないけど、早くて安く回したいやつ → Sonnet」

と線引きしていた領域の境界がかなり曖昧になる、ということです。

ぶっちゃけ、「とりあえず全部Sonnet 4.6で良くない?」という誘惑がかなり強い。

これが今回いちばんのインパクトだと思います。

-2. 1Mトークンコンテキストは「RAGの前提」を壊しにくる

Opus 4.6から引き継いだ形で、Sonnet 4.6にも 100万トークンコンテキスト(ベータ) が来ています。

これが何を意味するか。

- 巨大なコードベースを一括で突っ込める

- 論文十数〜数十本を並列で読み込ませて、その場で比較・統合させる

- 数百ページの契約書群を丸ごと渡して、整合性チェック・差分の洗い出し… など

これまでは「RAGでうまく分割・インデックスして…」が前提でしたが、

そもそも分割しなくて良いケースがかなり増える わけです。

正直、RAG屋さんやベクターストア周りのビジネスにはかなり厳しいニュースです。

「難しい検索・リトリーバルのロジックを乗り越えて、ようやくこのUXです」という世界観が、

「全部ぶち込んだけど?で、何したいの?」 にかなり近づいてしまう。

もちろん、検索精度・遅延・コストを突き詰めるとRAGはまだ死にません。

でも「最初の実装」として、素直に全部突っ込むだけ でかなりのことができてしまう。

この差はデカいです。

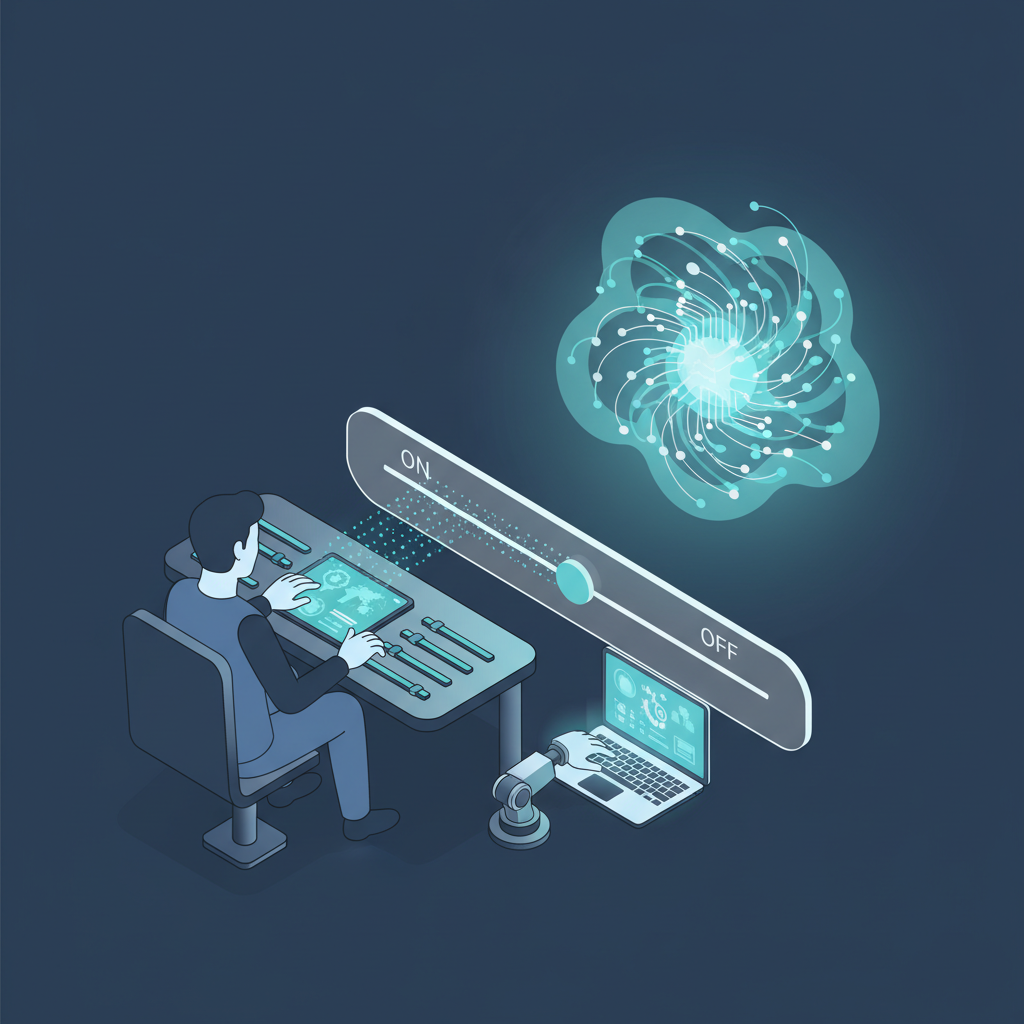

-3. 「コンパクション」「長時間エージェント」がようやく実用フェーズに

API側の改善も地味ですが、本番運用の視点だとかなり効きます。

- 会話が長くなったときに古い履歴を要約して文脈を保ち直す コンパクション

- いわば「自動コンテキスト圧縮」をAnthropic側が用意してくれる

これ、エージェントを作ったことがある人ならわかると思いますが、

長時間タスクでの“人格崩壊”問題への正面突破 です。

今までは:

- ログを自分で管理して

- どこまでを要約に置き換えるかロジックを書いて

- ミスると重要な手がかりごと捨ててしまう

という、かなりつらい実装をそれぞれのチームがやらされていました。

Sonnet 4.6+コンパクションは、「そこをプラットフォーム側が持ちます」と言いに来ている。

長時間走り続けるエージェントや「vibe working」的な常駐AIワーカーを作る上で、

かなり大きなボトルネックが外れつつあります。

競合モデルと比べて何が違うのか

ここが一番おもしろいところです。

個人的な整理をざっくり書くとこんな感じです。

-1. OpenAI陣営(GPT-4.1 / mini系)との違い

- OpenAIは「フラグシップ+mini」の二極構成で、

miniを“とにかく安くてそこそこ速い”路線にかなり振っています。 - AnthropicのSonnet 4.6は、

「高性能をできるだけ安価に広くばらまく」 方向に全振りした感じ。

正直、「無料ユーザーでもOpus級に近い体験」 というメッセージ性は強烈です。

これまでの「お金を払った人だけが最先端AIに触れられる」という前提が、じわじわ崩れ始めている。

開発者目線でいうと:

- GPT-4.1 mini:マイクロサービス化・エッジ向け・大量リクエスト処理に向いた スケーラビリティ路線

- Sonnet 4.6:エンタープライズ業務やコーディングを “これ一台でほぼ済ませたい” 路線

用途の切り分け方が変わってくる感じです 🤔

-2. xAI Grok 系との違い

Grokは:

- X(Twitter)との連携や“ちょっと危ういくらいオープン”なスタイル

- カジュアル・エンタメ寄り、リアルタイム性重視

に軸足があります。

対してSonnet 4.6は:

- 企業・開発者・知識労働 にガッツリ寄せた設計

- コーディング性能、長い推論、フォーマット厳守をかなり重視

- 安全性評価やプロンプトインジェクション耐性をかなり上げてきた

要するに、

Grokは「ネットの友達」寄り、Sonnet 4.6は「社内のめちゃ有能だが真面目寄りの同僚」

という住み分けです。

本番で回るワークフローをどっちに任せるか? と聞かれたら、

今のところはSonnet 4.6のほうに票を入れるエンジニアが多いはずです。

-3. 中堅ベンダー・専用コーディングモデルへのプレッシャー

GLM-4.7-Flashのような「30Bコーディング特化モデル」との比較もすでに出ていますが、

ここに来て 「汎用モデル+エージェント/スキル構成」 がかなり強くなってきました。

- Anthropicは、Sonnet 4.6を前提にした Claude Code、Cowork、エージェントチーム、PC操作 などを整備中

- つまり “エコシステムごと” で殴りに来ている

ぶっちゃけ、

「うちは中堅LLMベンダーで、Opusほどじゃないけど安いしそこそこ強いです」

というポジショニングは、今後かなり厳しいと思います。

そのポジションをAnthropicのSonnetが丸ごと取りに来ているからです。

ただ、懸念点もあります…(ここからが本題)

ここまでベタ褒め気味ですが、正直なところ 懸念もかなり大きい です。

-1. 「全部Sonnet 4.6でよくね?」は危険な思考停止

確かに、かなり多くのタスクはSonnet 4.6で十分こなせるようになります。

でも、

- 超高リスクな法務・コンプライアンス

- データ分析・金融系での細かい数値解釈

- 生成物に対する「最後の5〜10%のクオリティ」が致命的に効いてくる領域

では、やっぱりOpusレベルの“余裕”が必要なシーンも残るはずです。

Sonnet 4.6が「Opusをほぼ置き換えられる」と聞いて、

何も考えずに全部切り替えるのはかなり危うい。

やるべきは、

- タスクごとの ベンチマーク

- クリティカルなワークフローだけは Opusを温存

- それ以外を Sonnet 4.6に逃がす

という、粒度の細かい住み分けです。

-2. Anthropc依存のアーキテクチャが一気に進みすぎる懸念

Sonnet 4.6レベルが「無料〜Proのデフォルト」になると、

- プロンプトをClaude前提でチューニング

- Claudeの拒否パターン・安全性モデルに依存

- コンテキスト圧縮(コンパクション)やPC操作もAnthropic流儀にどっぷり

という、かなり深めのベンダーロックイン が進みがちです。

もちろん、Anthropic側の技術は素晴らしいし、現状ではそれで得られるメリットも大きい。

ただ、

- 他ベンダーのモデルに切り替えようとしたとき、

- あるいは自前LLMやオンプレモデルを混ぜようとしたとき、

に、想像以上の移行コストとして返ってくる可能性が高い。

個人的には、

- LLMクライアントは プロバイダ非依存の抽象レイヤー を挟む

- プロンプトは ベンダーごとの方言を切り替えられるテンプレート構造 にする

- 重要な評価指標は Anthropic以外のモデルでも再計測できる形 でログ化

くらいは、今のうちにやっておいたほうがいいと感じています。

-3. 「安くなったからたくさん叩いてもOK」は、だいたい間違い

よくあるパターンですが、

「Opusより安いし、性能高いし、とりあえず全部Sonnet 4.6で回しちゃおう!」

とやると、たいてい総コストはむしろ増えます。

- エージェント系ワークフローでの 連鎖呼び出し が増える

- 「これくらいならAIでやらせよう」が雪だるま式に膨らむ

- 1リクエストあたりは安くても、総発行トークンが爆増 する

ので、気づいたら請求書がOpus時代より太くなる、というやつです。

対策としてはシンプルで:

- Haiku / miniクラス を雑タスクにちゃんと使い分ける

- エージェントには 予算(トークン上限) を持たせる

- 定期的に 「このタスク、本当にLLM必要?」 の棚卸しをする

このあたりをサボると、「安くなったはずなのに財布が燃えている」状態になります 🔥

-4. モデルポートフォリオの“運用コスト”が地味に増える

Haiku / Sonnet (旧) / Sonnet 4.6 / Opus …

Anthropic内だけでもレイヤーがかなり増えてきました。

企業内でちゃんと運用しようとすると:

- どの業務でどのモデルを使うのか、ガイドラインが要る

- モデルアップデートのたびに 回帰テスト・評価・プロンプト調整

- セキュリティ・コンプライアンス観点での 再評価

が発生します。

Sonnet 4.6が強力になればなるほど、

「とりあえず全部これで」では済まなくなる のが皮肉なところです。

プロダクションで使うか? 正直、「部分導入から」だと思う

エンジニア視点での暫定結論はこれです。

「ミッションクリティカル以外の本番ワークロードには、積極的に試していい」

「ただし、Opus全面置換はまだ様子見。粒度の細かいA/Bテストが必須」

具体的にはこんな戦略が現実的だと思います。

-1. すぐにやるべきこと

- 社内ベンチマークにSonnet 4.6を追加

- 既存のSonnet / Opus / 他社モデルと並べてテスト

-

コーディング、長文要約、RAG、エージェントタスクなどを網羅

-

開発者向けツールから順に乗せていく

- 内部用コードアシスタント

- ドキュメント生成、テストコード生成

-

まずは エンジニアが目でレビューできる領域 から

-

無料枠・低価格プランのUX底上げに活用

- ここはリスクが許容しやすく、インパクトが出やすい

-2. 慎重にすべきところ

- 法務・コンプライアンス・財務レポート生成など、一発ミスると終わる系

- カスタマーサポートの完全自動応答など、ブランド毀損につながる系

ここは、

- まず OpusとSonnet 4.6のダブルラン でログを溜める

- しばらくの間は 人間レビュー前提 で部分的に置き換える

- ある程度統計が取れてから完全移行を検討する

くらいの慎重さでちょうど良いと思います。

最後に:本当に問われるのは「何を任せて、何を自分でやるか」の設計

Sonnet 4.6の登場で、

- 「高性能=高額」という垣根がかなり崩れ

- 無料〜低価格ユーザーにも フロンティア級のAI が降りてきた

これは、技術者としてもユーザーとしても歓迎すべき流れです。

ただ、ここから先で本当に難しくなるのは、

- 1Mトークンのコンテキストに 何を読ませるか

- PC操作能力を使って 何を自動化させるか

- どこまでをAIに任せて、どこから先を 人間の責任範囲 に残すのか

という、設計とリテラシーの問題です。

モデルの進化速度は、正直もう人間側のキャッチアップを軽く超えています。

「とりあえず最新を叩いておけばOK」というフェーズは、そろそろ終わりにしないといけない。

Sonnet 4.6は、

「ツールはここまで来ました。で、あなたは何を任せて、何を自分でやりますか?」

と問いかけてくるモデルだと思います。

プロダクションに入れるかどうかは、

モデルのスペックよりも あなたの設計と運用の覚悟 次第です。

コメント