「また自己紹介からかよ…」

ChatGPTにそうツッコんだこと、ありませんか?

- 「僕はWebエンジニアで、主にPythonとTypeScript使ってて…」

- 「敬体じゃなくて常体で書いて」

- 「このプロジェクトの背景はね…」

毎回これを説明するの、正直かなりダルいですよね。

しかも、チャットをまたいだら全部リセット。

その「説明地獄」に対して、ついにOpenAIが本気の一手を打ってきました。

ChatGPTの記憶機能(Memory)が、全ユーザーに“ほぼデフォルト”で開放されました。

一言で言うと「LLM界の Cookie 解禁」だと思っている

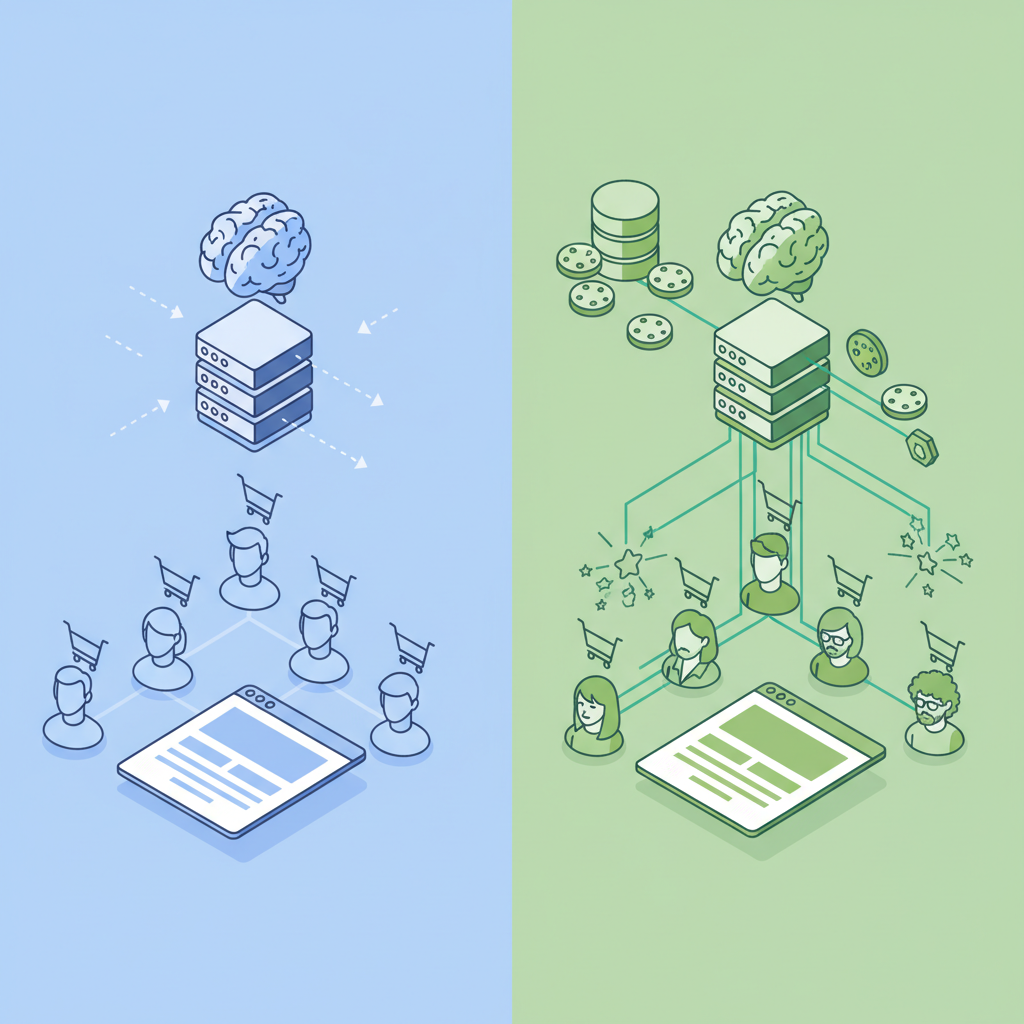

今回のアップデート、マーケ的には「会話の延続性がヤバい」とか言われていますが、エンジニア視点で一言で説明するなら:

「stateless な関数だったLLMに、Cookie とセッションが付いた」

これです。

- これまでは

→ セッションごとに完結する1回限りの巨大関数 - これからは

→ ユーザー単位で永続状態(長期記憶)を持つエージェント

この変化って、Webの歴史でいうと

「ただの静的HTMLサイト」に Cookie とセッション管理が来た瞬間にかなり近いです。

- Before:

- 毎回ログイン

- カートの中身も保持できない

- 誰が誰だかサーバー側からは分からない

- After:

- 常にログイン状態

- カートの中身も保存

- 嗜好に合わせたレコメンド

LLMの世界でいま、同じことが起きつつある。

このインパクトを「ちょっと便利になった」程度で受け止めるのは、かなりもったいないと思っています。

何がそんなに変わるのか:単なる「覚えてくれてうれしい」以上の話

機能として見えるのは、ざっくり言うとこんな感じです👇

- 「この情報を覚えて」「これは覚えないで」と会話中に指示できる

- 設定画面からメモリ一覧を見て、個別削除・全削除ができる

- グローバルON/OFFトグルで「今日は記憶OFF」にできる

- 好み・スキルレベル・プロジェクト情報などをユーザー単位で長期保存

裏側では、

- 「何をいつ覚えるか?」

- 「どのレベルの抽象度でまとめるか?」

をモデル側が推論して自動サマリしているっぽい。

いわば、

会話ログ → 要約 → ユーザー記憶ストア

というパイプラインが、ChatGPTの中にまるっと生えたかたちです。

正直、一番デカいのは「ユーザープロファイルとして横断利用される」こと

「このプロジェクトのコードベース」「チームの文体ガイド」「自分のスキル感」みたいな情報を一回教えると、その後の全チャット・全GPTで共有されるコンテキストになる。

- 今日:技術記事のドラフトレビュー

- 明日:社内向け資料のたたき台作成

- 来週:同じプロジェクトのバグ調査相談

全部別チャットでも、同じ“自分”として扱われる。

これ、エンジニア人生で初めて「IDEより先に、自分の属性を分かってるツール」が現れつつある感覚があります。

Google Gemini と比べると「思想」がかなり違う

個人的に一番おもしろいのは、Google Gemini とのアプローチの違いです。

「どうやって覚えるか?」のUX設計が真逆

- ChatGPT(OpenAI)

- ユーザーが「これ覚えて」「これ忘れて」と直接メモリを操作している感覚を前面に出す

- ON/OFF、一覧表示、削除など、“見える記憶”として扱っている

- Gemini(Google)

- アカウント(Gmail / Drive / Calendar…)全体を横断して、文脈を勝手に理解する方向が強い

- 「Saved info」もあるけれど、「AIに何を覚えさせているのか」をわざわざ意識させないUIが多い

どちらが良い悪いというより、

- OpenAI:「LLMの上にパーソナルOSを築きたい」

- Google:「既存のGoogleアカウントの延長としてLLMを統合したい」

という思想の違いがハッキリ出ているように見えます。

ロックインの構造が違う

- Google側のロックイン

- すでにGmail / ドキュメント / カレンダーなど「ユーザーデータの巣」が存在していて、その上にGeminiをかぶせている

- OpenAI側のロックイン

- もともとは stateless なチャットBotだったのが、

- ここに「ユーザー単位の記憶」を新規に構築し始めた

正直、怖いのは後者です。

なぜなら、

「LLMに蓄積された自分のプロファイル」は、

乗り換えコストがえげつなく高い

からです。

Gmailから別メールサービスに移行するとき、最悪メールを全部エクスポートして持ち出せますが、

ChatGPTのメモリをGeminiにエクスポートして再学習なんて、現時点で現実的じゃない。

つまり、

- ChatGPTのメモリに

- 自分の職務経歴

- プロジェクト履歴

- コーディングスタイル

- チーム文化

- よく一緒に出てくる社内用語

を数年かけて溜め込んだあと、 - 「やっぱりGeminiに移行するか」は

ほぼゼロから“人格インポート”をやり直すことになる

この「人格ロックイン」は、正直かなり強烈です🤔

「エージェント系フレームワーク」にとってはかなり厳しいニュース

LangChain や LlamaIndex みたいなエージェント基盤は、

- 「長期メモリを自前で実装」

- 「ユーザープロファイルの永続化」

を差別化ポイントにしてきたところがあります。

でも、ChatGPT本体が

- ユーザー単位の永続メモリを標準装備

- しかもUIで編集可能

- 全GPT(カスタムGPT含む)から横断利用可能

となると、軽量なパーソナライズ用途ならプラットフォーム標準で足りる世界に近づきます。

ぶっちゃけ、

- 「うちのSaaSは、ユーザーの好みを覚えます!」

- 「長期プロジェクトを横断して状況を把握できます!」

みたいな売り文句は、ChatGPT単体と比較される運命にある。

この意味で、今回のアップデートは

「LLMアプリ開発者 vs プラットフォーム」のパワーバランスを一段階変えるターニングポイントだと感じています。

ただ、手放しで喜べない理由もある

ここからは、かなり現場目線の「モヤモヤポイント」です。

コミュニティの空気は「期待混じりの不信感」

Reddit やXを眺めていると、

- 「ほんとに全ユーザーに開放されたの?うちのアカウントには来てないけど?」

- 「Plus払ってるのにメモリ制限キツすぎ。これ“記憶”って名乗っていいの?」

- 「長いチャットになるとクソ重くなる。まずパフォーマンス直してくれ」

みたいな声がかなり多い。

実装面のバグ報告も出ていて、

- メモリの「ピル」が正しく復元されない

- 設定ポップアップ変更がちゃんと反映されない

- 「記憶更新」のプロンプトを出しても動いてる気がしない

など、「コンセプトは分かるけど、挙動がまだ信用しきれない」状態です。

正直、本番システムの根幹をこのメモリ機能に委ねるのは、まだ怖いレベルだと思っています。

テストと再現性が一気に難しくなる

開発者視点でいちばん厄介なのはここです。

- これまでは:

- 「同じプロンプト+同じ設定 → だいたい同じ出力」という前提でテストできた

- これからは:

- ユーザーごとに記憶状態が違う

- 時間とともにメモリが勝手に変化する

つまり、

「なぜこの回答になったのか?」

の説明に、過去のどこかの会話断片が影響している可能性が常にある

という状態になります。

テストを再現しようとすると、

- プロンプト

- システムプロンプト

- モデルバージョン

に加えて、

- ユーザーのメモリスナップショット

まで揃えないといけない。

これはQAチームからすると地獄に近いです。

プライバシー&コンプラ的には「地雷原の上を歩いている」感覚

企業利用で一番怖いのはここです。

- 「この顧客の情報を覚えて」

- 「この社内プロジェクトの詳細を覚えて」

…をそのままやり始めると、

- それって

- 個人情報保護法的にOK?

- GDPR的には?

- 社内規程的にOK?

という話になる。

もちろんUI上では

- メモリ一覧を削除できる

- 設定でOFFにもできる

んですが、「サーバー側で本当に完全削除されているのか」をユーザーは検証できない。

GoogleのGeminiでも「アクティビティ削除が実際には微妙」と話題になることがありますが、

同じ不信感がChatGPTにも向くのは時間の問題です。

「AIに覚えさせていい情報」と「絶対に覚えさせてはいけない情報」を

組織として線引きしないと、そのうち確実にトラブルになります。

「じゃあ、プロダクションで使うの?」に対する正直な答え

現時点(2026年初頭イメージ)での自分のスタンスを整理すると、こうなります👇

✅ 積極的に使っていいところ

- 個人の作業効率アップ

- 自己紹介・スキルレベル・よく使う技術スタック

- 好みのトーン(敬体/常体、図多め/テキスト多め など)

- 長期的な自己学習ログ(「○○について学習中」など)

→ 「人間としての自分」に関する情報であれば、

むしろガンガン覚えさせた方が得だと思っています。

- 趣味・プライベート寄りのプロジェクト

- 個人ブログの文体

- OSS活動の履歴

- 趣味アプリの仕様

ここはロックインをあまり気にせず、「パーソナルOS」として活かすのはアリ。

⚠️ 慎重にすべきところ

- 業務システムにガッツリ組み込む

- 「ユーザーごとの設定をChatGPTメモリにだけ置く」のはかなり危険

- 将来の仕様変更やロールバックで挙動が壊れても文句を言えない

→ 少なくとも今は、

- クリティカルな状態は自前DBで管理

- ChatGPTメモリは「優先度低めのパーソナライズ」に使う

くらいのスタンスが現実的かなと。

- 機密情報・顧客情報を直接覚えさせる

これは、ぶっちゃけ「やらない方がいい」と思っています。

- 機密情報は

→ フロントで可能な限り匿名化・抽象化してから投入 - メモリ機能は

→ 「この会社はB2B SaaSで、利用者はエンジニアが多い」程度のメタ情報に留める

くらいに抑えておくのが安全圏でしょう。

最後に:このアップデートをどう捉えるべきか

まとめると、自分の評価はこうです👇

- 技術的インパクト:かなり大きい(HTTPにCookieが来たレベル)

- プロダクトへの実務インパクト:使い方次第で超便利だけど、ロックインと再現性が課題

- 現時点の完成度:コンセプトは最高、実装はまだ信用しきれない

なので、結論としては:

「個人利用では全力で使い倒す。でもプロダクションの中枢には、正直まだ置かない」

というスタンスです。

これからChatGPTやGemini、その他のLLMが

- 「どこまでをモデル側のメモリに任せるか」

- 「どこから先はアプリ側で責任を持つか」

という綱引きが本格化していきます。

今プロダクトを設計する側にいるなら、

最初のアーキテクチャ設計の段階で、以下をハッキリ決めておくべきです:

- どの情報をChatGPTの記憶に置くか

- どの情報は必ず自前ストレージに置くか

- 記憶機能が壊れたら、どのUXまで許容できるか

- 将来、他ベンダーに乗り換えるときに何を捨てる覚悟があるか

ここを曖昧にしたまま「なんか便利そうだから記憶ONにしとくか」と始めると、

数年後にじわじわ効いてくる技術的負債になります。

便利さに飛びつきたい気持ちと、エンジニアとしての慎重さ。

このアップデートは、その両方を試してくるアップデートだと思っています。

コメント