「GPT に仕様を投げたら “それっぽいコード” は返ってくるけど、

レビューしてみたら前提をどこかで見失ってて、結局自分で直し直し…」

そんな経験、ありませんか?🤔

長い議論や日本語のふわっとした要件が絡むと、

・途中で前提がねじれる

・文体が崩れる

・最終成果物が「全部つながっていない」

——このあたりでモヤモヤしているチームにとって、

今回の Claude 4.6 Opus はけっこう“刺さる”リリースです。

しかも、これは「4.5 のちょっと強い版」じゃない。

一言でいうと、「Docker ブームの後に出てきた Kubernetes 1.0」みたいな LLM です。

一言でいうと:ベンチ最強ではなく「業務インフラ」への振り切り

まず前提整理から。

- コード一発芸のスコアだけなら、依然として GPT-5.3-Codex が強い場面は多い

- でも 「要件 → 仕様 → コード → テスト → 日本語レポート」まで一気通貫で回したときの安定性は、Claude 4.6 Opus がかなり良い

- とくに日本語実務文書と長文一貫性は、明確に“チューニングの方向性が違う”と感じます

正直、「また 0.x 上がっただけでしょ?」と思っていた自分は、

4.6 を触ってみて印象が変わりました。

これは “フラグシップだけどベンチモンスター路線から降りたモデル” です。

スコア最強より、プロダクションで長時間まわしても壊れにくい土台 に寄せてきている。

このポジションが、さっきの Kubernetes アナロジーです。

- Docker(= GPT 系の圧倒的性能・シェア)が

「コンテナは使える」という事実を世界に広めた - でも本番運用・スケール・一貫性という“インフラのしんどさ”は残っていた

- そこに Kubernetes が来て、「運用で死なない仕組み」にフォーカスした

Claude 4.6 Opus も同じ匂いがします。

「1 回のプロンプトでの最強スコア」より、「半年回しっぱなしのワークフローで壊れないこと」に賭けている感じです。

本当に新しいポイントはどこか?ベンチより“挙動”が変わった

長文・長期タスクで「人格が崩れない」方向性

4.6 の一番の変化は、長い“思考の鎖”で前提を落とさないという挙動です。

- 設定を何度も確認しながら進める

- 会話履歴をちゃんと踏まえた上で仕様を更新してくる

- 文体やスタンスが途中でキャラ崩壊しにくい

これ、数字には出にくいけど、

プロダクトの仕様検討やビジネスシナリオ設計をやっていると ストレスの総量がかなり減る んですよね。

Qiita 系の検証でも、

- GPT-5.3-Codex:

単発コード・競プロ・API ラッパー → 依然つよい - Claude 4.6 Opus:

業務寄り・あいまい要件 → 要件の“補完と整理”がうまい

という傾向が出ていて、これは体感とかなり合っています。

「コードはそこそこ、でもワークフローはかなり強い」

ぶっちゃけコード精度だけ見れば、

「最強はどっち?」議論はまだ GPT 側に分があります。

でも実務では、

- あいまいな要件を投げる

- 要件を整理して、仕様の仮案を出してもらう

- そこからコード・テスト雛形を出してもらう

- 最後に日本語の報告書・プルリク説明を書く

という 一連の流れ を 1 モデルで回した方が、

「トータルの人間コスト」は下がりやすい。

4.6 はここがかなり現実的になった印象です。

- 仕様の抜けをそれなりに埋めてくれる

- 仕様・コード・テスト・レポートの整合性が崩れにくい

- 日本語のビジネス文書が、読ませるレベルで出てくる

エンタープライズ向けの「仕様書ドラフト」「分析レポート」「社内報告」を毎日書いている人からすると、

このバランス感はかなりありがたいはずです。

100万トークンコンテキストと「ちゃんと使える長文」

serverworks さんや Galirage さんの検証を見ると、技術的にもいくつか大きなポイントがあります。

- 1M コンテキスト対応(ベータ)

- API / Claude Code の従量課金ユーザー限定

- Bedrock では一部制約あり、Max/Pro サブスクではまだ使えない

- 長文コンテキストでの精度低下(Context Rot)の改善

- MRCR v2, Graphwalks などの長文系ベンチで 4.5 から大幅改善

- 「入るけど読めないコンテキスト」ではなく、「読んで使えるコンテキスト」になってきた

正直、これまでは

100万トークン入るって言われても、

実際にちゃんと読んでくれてる気がしない…

というモヤモヤがあったんですが、

4.6 は少なくとも「ベンチ上は」その壁をかなり超えてきています。

大規模コードベースや長期ログ解析を LLM に投げる構成を考えるなら、

「やっと設計の土台に乗せて良い」ラインに来た と言っていいと思います。

競合との比較:もはや「どれが最強?」を聞くのがナンセンスになってきた

ここからが本題で、4.6 の登場で一番変わったのは、

「モデルの選び方の前提」 だと思っています。

GPT-5.3-Codex vs Claude 4.6 Opus

コード周りをざっくりまとめると:

- GPT-5.3-Codex

- 単発コードの精度、アルゴリズム、明確仕様の実装 → かなり強い

- 競プロ・API ラッパー・定型処理などで高スコア

- Claude 4.6 Opus

- あいまいな業務要件を「こういう前提ですか?」と整理してくる

- 要件ヒアリング → 仕様仮定 → 実装の雛形 → テスト案 を 1 プロンプトで進めやすい

つまり、

- 「答えがわかっている世界」 では GPT がまだ頼りになる

- 「そもそも何を作るかから相談したい世界」 では Claude が強い

この 2 つを「どっちが上か」で比べるのは、もはや設計として間違っていて、

最初からマルチモデル前提でアーキテクチャを組んだ方がいい フェーズに来ています。

具体的にはこんな構成:

- GPT-5.x 系:

実装・アルゴリズム検証・競プロ的タスク - Claude 4.6 Opus:

仕様・設計・ドキュメント・顧客説明・日本語実務文書

この役割分担をきちんと設計したチームの方が、

どちらか一社に全振りしているチームより 最終的な生産性は高くなる と思います。

GLM / Gemini / その他の「汎用 LLM ベンダー」にとっての現実

ここで地味に効いてくるのが、

「専用ドメイン特化 LLM + Claude 4.6」の組み合わせでだいたい戦える

という事実です。

- 医療なら医療特化 LLM + Claude 4.6

- 法務ならリーガル LLM + Claude 4.6

- コードなら GPT-5.3-Codex + Claude 4.6

こういう組み合わせが取れるので、

中途半端な汎用 LLM ベンダーのポジションが一気に薄くなる。

「なんでもそこそこできます」タイプのモデルは、

正直これからかなりしんどくなるはずです。

実務目線での“うまみ”:どのチームが得をするのか

「ドキュメント地獄」チームにはかなり刺さる

4.6 のわかりやすい勝ち筋は、

- 社内規程や設計書のドラフト

- 分析レポート

- 顧客向け報告書

- 日本語仕様書

ここでの 「とりあえず Claude に投げれば、人間がちょっと直せば出せるレベル」 は、

かなり現実味があります。

英語ベースの情報を日本語に落とす GPT も強いですが、

- 読み手の前提知識

- 社内のトーン

- 「責任を取りすぎない」言い回し

こういう 日本語特有のニュアンス をちゃんと踏まえた文書を出せる点で、4.6 は一歩リードしていると感じます。

「要件がふわっとしたまま走り出しがちな」プロジェクト

仕様が固まらないまま走りがちなチームにも、4.6 は相性が良いです。

- 口頭メモ・議事録・チャットログを放り込む

- 「現時点の仕様案」「前提の仮定」「不足している質問リスト」を出してもらう

- そこからモック API 仕様・画面イメージを一緒に作っていく

この一連のフローを 1 モデルで回せる のは、かなりラクです。

ただし後で触れますが、

「勝手に前提を補完してくれる」ことは 同時にリスクでもある ので、規制産業ほど使い方には要注意です。

LLM オーケストレーション設計をちゃんとやりたい人

4.6 の登場で、アーキテクチャ設計はこう変わります:

- NG: 「ウチは全部 GPT(or Claude)でやります」

- OK: 「LLM は最初から複数前提。モデル選択レイヤーをアプリから切り離す」

具体的には:

- 仕様整理・顧客コミュニケーション → Claude 4.6

- 実装・難しい推論・一発の正答率がシビアなところ → GPT / 専用モデル

- 特定ドメイン(医療・法務…) → 専用 LLM + Claude で人間向け説明を生成

「どのモデルに何を投げるか」 を明示的に設計する時代に、

4.6 がかなり強く背中を押している、というのが自分の見立てです。

ただし、懸念もデカい:4.6 ならではの “Gotcha”

ここからは、意図的にネガティブ寄りに話します。

ぶっちゃけ、ここを考えないで 4.6 に全振りすると痛い目を見ます。

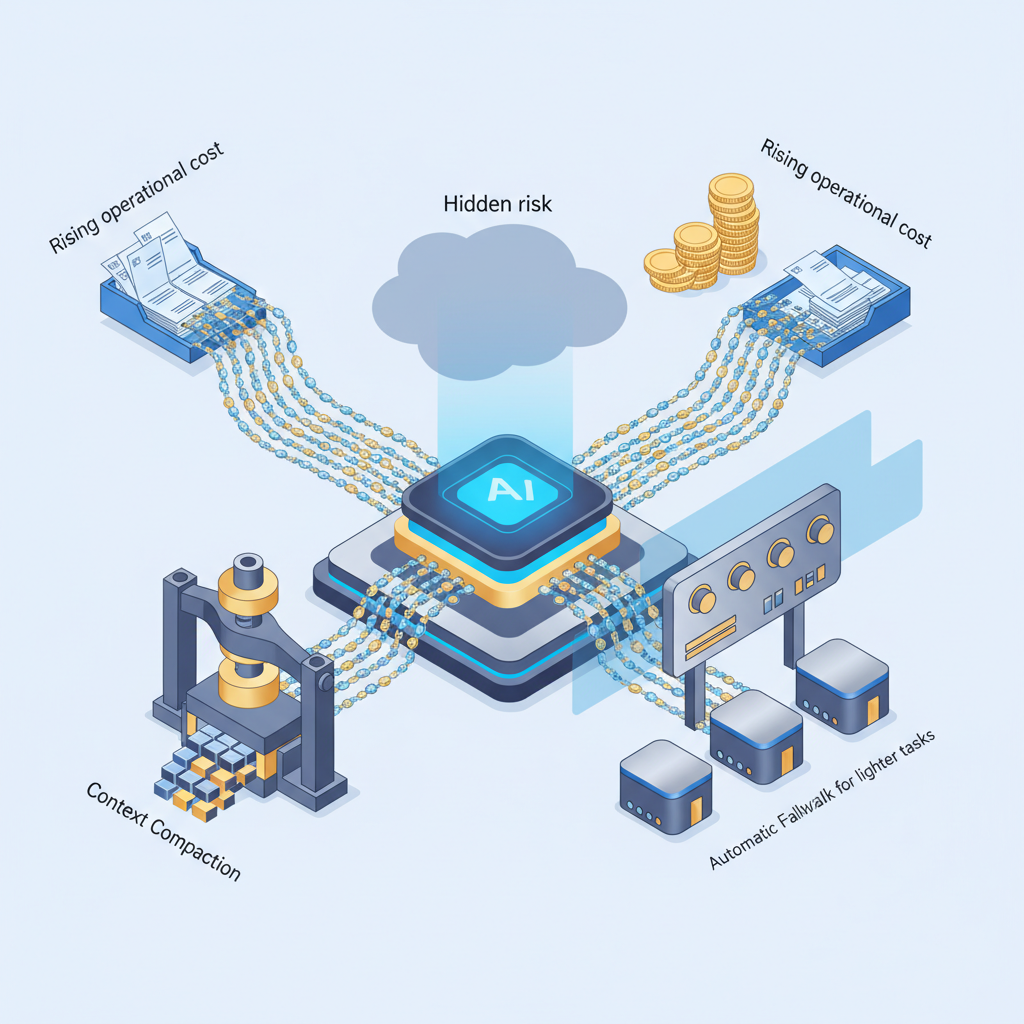

コスト:賢くて長文、つまり“高い”

まずお金の話。

- フラグシップモデルなので、もともと安くない

- 日本語でよくしゃべる(説明が厚い)

- 1M コンテキストは 20 万トークン超からプレミアム価格

この組み合わせは、気づいたら月末に請求書で殴られるパターン です 🧾

対策としては、最初から設計に組み込んだ方がいいです:

- system プロンプトで

「簡潔に」「中程度の長さで」などのガードレールを書く - /effort を

mediumかlowにするデフォルトを決める - 軽いタスクは Sonnet / Haiku に自動フォールバックさせる

- 長期対話には Context Compaction を有効化して、トークンを“圧縮”しながら進める

「とりあえず全部 4.6 に投げればいいや」は、

正直、プロダクションではやってはいけない運用です。

“賢すぎる補完” が、静かにリスクになる

4.6 は、仕様があいまいでも かなり良い感じに埋めて進めてくれます。

これは同時に、次のような怖さを孕みます。

- 「モデルが勝手に補完した前提」が、いつの間にか仕様書に紛れ込む

- 人間側がそれに気づかないままレビューを通してしまう

- 後からバグやコンプラ事故が起きたとき、

「そもそもこの前提、誰が決めたの?」がブラックボックスになる

とくに 金融・医療・公共系 は、ここを甘く見ると危ないです。

個人的には、4.6 を仕様に絡めるときは、最低限こう決めておいた方がいいと思っています:

- 「モデルが仮定した前提を、必ず明示させる」プロンプトを標準化する

- 出力をそのまま公式ドキュメントにせず、人間レビュー前提のワークフローを維持する

- 「LLM が補完してよい範囲」と「人間が必ず決める範囲」をチームで明文化する

ベンダーロックインと「Claude 前提ナレッジ」の固着

これは 4.5 でもありましたが、4.6 でワークフローをガッツリ組むと悪化します。

- プロンプトテンプレート

- システムプロンプトの設計思想

- チーム内の「Claude にはこう聞くといい」ノウハウ

これらが全部 Anthropic 前提 に寄っていくと、

将来、価格改定・規制・リージョン制約が来たときに詰みやすくなります。

避け方としては:

- プロンプトを「Claude 用 DSL」ではなく、できるだけモデル非依存の形 に書く

- モデル名をアプリコードにベタ書きせず、コンフィグやルーティング層で切り替えられるようにする

- 重要ワークフローについては、必ず GPT / 他モデルとの A/B 検証をしておく

要するに、「Claude に魂を売り切らない設計」を最初から意識するのが吉です。

マルチモデル時代特有の運用コスト

4.6 の良さを活かそうとすると、逆に運用が複雑になる というジレンマもあります。

- Claude 向けプロンプトと GPT 向けプロンプトの「書き癖」が違う

- 社内に「Claude 流」「GPT 流」のノウハウが別々に溜まる

- PromptOps / LLM Gateway 的な仕組みがないと、どこで何が動いているか把握しにくい

ここを「人間のスキルと属人ノウハウ」で解決しようとすると、

結局 LLM 周りが新しいレガシー になります。

個人的には、

- 早い段階から LLM 向けの プロンプト管理・バージョン管理 を導入する

- 「モデルごとの違い」を薄めるために、中間レイヤー(社内 DSL / JSON 指向プロンプト)を噛ませる

- 評価指標も「公開ベンチの点数」ではなく、「自社ワークフローでの成功率」に振り切る

くらいのことをやらないと、

せっかくの 4.6 のポテンシャルをきれいに活かしきれないはずです。

コミュニティの空気:「4.5 で十分強い」からの“慎重な期待”

Reddit や国内記事を眺めていると、

熱狂というより 冷静な様子見 というムードが強いです。

- 「今のところ Opus 4.5 が本当にたくさん使える。4.6 はまだ実感がない」

- 「Claude Code ではまだ 4.6 が出てないんだね」

- 「どうせすぐ GPT / Gemini の新バージョンが出るから、どこに張るか悩む」

要は、

4.5 の運用を固めつつ、4.6 や GLM / Gemini / GPT の新型を

自社ワークフローで一通りベンチしてから決める

というプロっぽいスタンスが増えてきた、ということです。

これは健全な変化だと思います。

Verdict:プロダクションに入れるか?自分の結論

最後に、エンジニアとしての立場からまとめます。

を「即プロダクション採用」すべきケース

- 日本語の仕様書・レポート・社内文書が業務のボトルネックになっている

- 要件がふわっとした状態から一緒に設計を進めるワークフローが多い

- 大規模コードベース / 長文ログを LLM に読ませる設計を真面目にやりたい

- すでに Claude 4.5 を本番で使っており、A/B テストがすぐ回せる

このあたりなら、4.6 を実タスクで A/B テストして、良ければ徐々に切り替え が現実的です。

まだ様子見した方がいいケース

- すでに GPT-5.x 系を前提に、本番アーキテクチャ・プロンプト資産を厚く積んでいる

- コード精度・単発性能が最優先で、仕様や文書はそこまでネックではない

- コストとレイテンシに厳しい制約があり、フラグシップモデルを乱用できない

この場合は、

- 「仕様・ドキュメント専用」として Claude をサブ的に導入

- 4.6 / GPT / 他モデルを自社ワークフローでベンチして、用途別に最適モデルを決める

くらいが妥当だと思います。

「4.6 が出たから全部 Claude に乗り換え」みたいな動きは、正直おすすめしません。

まとめ:Claude 4.6 Opus は「全部お任せの神モデル」ではない

整理すると、4.6 はこういうモデルです。

- ベンチマーク最強のコード生成モンスターではない

- 代わりに、

- 長期一貫性

- 日本語実務文書

- 上流〜下流をつなぐワークフロー

に全振りした “実務インフラ寄りフラグシップ LLM” - その結果として、

- マルチモデル前提のアーキテクチャ設計

- コスト・補完リスク・ロックインへのケア

を真面目に考える必要が出てきた

正直に言うと、「4.6 さえあれば他はいらない」という時代は来ません。

むしろ逆で、

4.6 のような“インフラ志向モデル”が出てきたことで、

**「1 社の 1 モデルに全振りする設計」が過去のものになる

そういう転換点に来ているのだと思います。

なので、エンジニアとしてやるべきことはシンプルです。

- GPT / Claude / ほか主要モデルを、自社の“リアルなタスク”で A/B テストする

- モデル選択レイヤーをアプリから分離し、マルチモデル前提で設計する

- プロンプト標準化とガバナンス(補完範囲・レビューの線引き)を決める

そのうえで、「日本語ドキュメントと長期一貫性」 がボトルネックなチームなら、

Claude 4.6 Opus を ワークフローの“主語”の一つ に据える価値はかなり高い、と自分は見ています。 🚀

コメント