「エージェント実装したら、99%は“LLMがツールをちゃんと呼んでくれない問題”で溶けていくんだが?」

そんな経験、ありませんか?

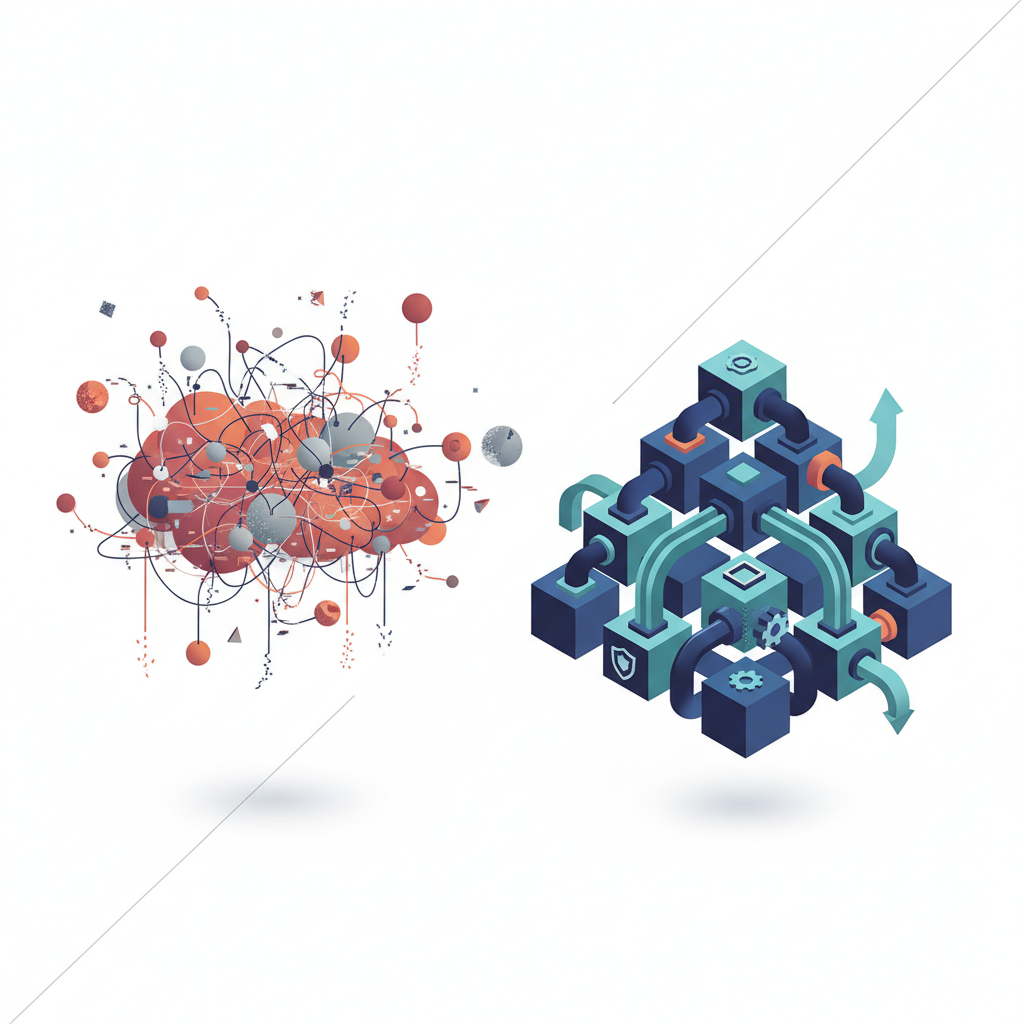

プロンプトは長くなる、ステートマシンは増える、LangChain のフローはスパゲッティ化。

そのうえモデルはツールスキーマを微妙に無視して、JSON も平気で壊してくる…。

そんな中で出てきたのが Gemini 3.1 Pro。

これ、ただの「精度ちょいアップ版」じゃなくて、正直言うと「やっと仕事で使う前提のモデルを出してきたのか」という印象です。

一言でいうと:LLM界の TypeScript が来た

一言で言うと、Gemini 3.1 Pro は LLM 界の TypeScript です。

- JavaScript(= これまでの LLM)は強力だけど、規模が大きくなると途端に壊れる

- TypeScript は「文法ほぼそのまま」なのに、型とツールが整って一気にプロダクション向きになった

Gemini 3.1 Pro も同じで:

- API も、テキスト/画像/コードも、表面上はほぼ従来どおり

- だけど中身は「複雑なワークフロー」と「ツール呼び出し」の安定性に全振り

ぶっちゃけ、これは「スコアがちょっと上がった最強モデル」ではなく、

「大規模エージェントや RAG システムを、現実的なコストで回せるか?」をテーマにしたモデルだと感じています。

何がそんなに違うのか:地味だけど本質的なアップデート

技術的なポイントをざっくりまとめると:

- 新しい 3.x 世代のフラグシップ(

gemini-3.1-pro) - テキスト+画像+構造化データに対する複雑な推論が強化

- マルチステップのツール呼び出しと、その結果に基づく推論が安定

- JSON / スキーマ準拠の出力がかなりマシになった(※ここ重要)

- 長い指示・長いワークフローでも変な脱線が減った

正直、ぱっと見は「いつものアップデート」にも見えるんですが、

実際に現場で問題になるのは GPT-4.1 だろうが Gemini 1.5 だろうが、

- ツールパラメータを勝手に増やす

- 必須フィールドを忘れる

- 途中で JSON をやめて普通の文章を混ぜ始める

- 3ステップ目くらいで前提を忘れる

みたいな“現実世界での雑さ”なんですよね。

そこを真面目に潰しにきているのが Gemini 3.1 Pro だ、という印象です。

競合との比較:Google vs OpenAI vs 「その他」

能力勝負というより「どの陣営に入るか」のフェーズに入った

OpenAI 側には GPT‑4.1 / o3、Google 側には Gemini 3.1 Pro。

性能的にはタスクによって「どっちが微妙に強いか」が変わるレベルで、

正直、“単体モデル性能の差”は、もう決定打じゃないです。

重要なのは:

- どのクラウドとデータ基盤に寄せるか

- どのオフィススイート(Workspace / M365)と統合するか

- どのエコシステムのツールフォーマットやガードレールを前提に設計するか

という 「陣営選び」 に移りつつあること。

Gemini 3.1 Pro は、まさにそのGoogle 陣営の「標準プロダクションモデル」の位置づけです。

Google 版「エージェント前提モデル」

OpenAI 側でいうと:

- GPT‑4.1 / o3 = 「functions / tools を前提にした高推論モデル」

- Assistants API や Copilot で、MS 製品にガッチリ組み込む

Google 側での対抗軸が:

- Gemini 3.1 Pro = 「ツール・RAG・エージェント前提の Pro モデル」

- Gmail / Drive / Docs など Workspace への統合(拡張も出たばかり)

- Vertex AI / Google AI Studio でのエージェント実装

という構図になりつつあります。

GCP / Workspace 前提でシステムを組むなら、

もはや「とりあえず Gemini 3.1 Pro」をベースに検討すべき段階に入ったと思います。

一番ダメージを受けるのは誰か?

正直、今回一番キツいのは:

- 「ツール使わせるための複雑なオーケストレーションを SaaS で売っている」系

- 「うちのエージェントフレームワークを使えば、LLM の不安定さを吸収できます!」みたいな商材

です。

Gemini 3.1 Pro クラスが当たり前になってくると:

- LLM に任せられるオーケストレーション部分が増える

→ 手書きステートマシンの出番が減る - LangChain / LlamaIndex も「複雑なガードレール製品」より

「便利な Python ライブラリ」としての価値が相対的に大きくなる

要は、「モデルがちゃんとしてくれれば要らないレイヤー」から淘汰されていく流れが加速する、ということです。

コミュニティの空気:盛り上がりというより「冷静な期待」

日本のタイムラインを見ていても、正直、雰囲気はかなり冷静です。

- 「AlphaCode 2 が競技プログラマ上位 85% に勝ってる=エンジニアの 99% じゃない?」

→ コーディング能力への期待と、軽い恐怖 - 「全然使えないビデオ生成機能なんか提供するんだよ」

→ Veo / 動画生成に対する苛立ち混じりの冷笑

このギャップが象徴的で:

- アルゴリズム・コードの強さはかなり評価されている

- でも ビデオや派手なマルチモーダル機能は「デモ止まり」扱い

要するに、現場の開発者はこう思っているわけです:

「競プロで85%に勝つのはすごい。

でも、日々の仕事で何がどこまで楽になるのか、そこをちゃんと見せてくれ。」

Gemini 3.1 Pro は、その意味で「ようやく現場目線に降りてきた一手」だと感じます。

派手な動画より、堅いツールコールと JSONをちゃんとやってきたのは評価ポイントです。

本当のキラーフィーチャーは「ツール」でも「マルチモーダル」でもない

正直、Gemini 3.1 Pro の真価は「画像も読めます」とか「動画も扱えます」ではありません。

実務で効くのは、次の3つです。

エージェントの「オーケストレータ」として使えるレベルになってきた

- マルチステップでツールを呼び分ける

- 途中結果を踏まえて、次に呼ぶツールを判断する

- ロングコンテキストでも指示をブレずに維持する

ここが安定してくると、アーキテクチャ設計が変わります。

これまで:

- LLM は「1 ステップずつの賢い if 文」扱い

- 全体のワークフローは人間がゴリゴリ実装(FSM / BPM / custom agent)

これから:

- LLM+ツールの組み合わせに、もっとロジックを寄せられる

- オーケストレーションコードはミニマルなガードレールと監視に絞れる

TypeScript が JS の型まわりを肩代わりしてくれた結果、

「アプリロジックに集中できるようになった」のと似ています。

コード・データ系の“地味にめんどい作業”を丸投げできる

AlphaCode 2 の話題が象徴的ですが、

「競プロで強い=狭く定義された問題に強い」ということでもあります。

これは実務でいうと:

- 「この 10 個の SQL を統一的なスタイルにして」「WHERE 句のロジックを共通化して」

- 「この 5 ファイル分のコードをリファクタ案込みでレビューして」

- 「この CSV 群から KPI を定義してダッシュボード設計案を出して」

みたいな“めんどいけどパターン化できる作業”と相性がいい。

Gemini 3.1 Pro は、まさにこのゾーンを狙ってチューニングされているように見えます。

正直、ここがまともに使えるなら、エンジニアの「雑務時間」はかなり減らせるはずです。

「プロダクションでの挙動」が多少は読みやすくなる

日本語圏の実務エンジニアが一番ストレスを感じるのは、

- 日によって JSON の形式が微妙に変わる

- 負荷がかかるとレスポンスがブレる

- 回答が英語に寄ったり文体が安定しなかったりする

といった「プロダクションでの再現性の低さ」です。

Gemini 3.1 Pro は、ここをかなり意識していて:

- スキーマ遵守(JSON, tool params)が改善

- ロングタスクでの「途中から話変わる問題」が減少

- 「変な返答が減って、実務コードに使いやすくなった」という声も出てきている

もちろん完璧ではないですが、

「とりあえず 1.5 Pro の ID を 3.1 Pro に差し替えて、既存テストを流してみる価値はある」レベルにはなっています。

ただし、懸念もかなりある 🤔

ベンダーロックインは確実に強くなる

Gemini 3.1 Pro を本気で採用すると:

- ツール定義やガードレール周りを Google 流 に合わせる

- Vertex AI / AI Studio / Workspace 拡張に依存した設計になる

- RAG も「Google の想定するパターン」に寄せやすくなる

これは悪いことばかりではなく、

- セキュリティ・権限モデルを Workspace / GCP に揃えられる

- Drive / Gmail / Docs との統合は素直に爆速で便利

というメリットも大きいのですが、

一度ここまで寄せると、OpenAI / Azure / AWS への移行コストは跳ね上がるのは間違いないです。

「まずはセカンドベンダーとして A/B する」のか、

「最初から Google 陣営に振り切る」のか、そこは会社として腹をくくる必要があります。

価格と TCO はまだ見えにくい

記事ベースの情報だと、

- 3.1 Pro はあくまで「Pro」=安くはない層

- コンテキスト長+マルチツール+ロングワークフローで

トークン消費は普通に爆発する構成

になるのは、ほぼ確定です。

特に、

- 「長い PDF × 複数 + RAG + ツール + 10 ステップ」みたいなフロー

- 社内 Copilot 的な「常時計算するエージェント」

をやり始めると、料金テーブルの数字以上の運用コストが見えてきます。

正直、ここは実際に PoC を回して、

- 1 ユーザ / 1 日あたりの平均トークン

- 想定アクティブユーザ数

- バックエンド処理のバースト

をちゃんと出してから、他社モデルとの「円/推論品質」での比較をしたほうがいいです。

魔法ではない:データの汚さは相変わらずお前の責任

Gemini 3.1 Pro はたしかに賢くなりましたが、

- 半端な RAG 設計

- 汚い社内データ

- ふんわりしたプロンプト

の上に乗せると、ちゃんと賢く迷子になります。

- 「幻覚は減った」とはいえ、ゼロにはならない

- スキーマが雑なら、モデルも雑に解釈する

- 規制業種では、相変わらず人間側の検証プロセスが必須

「Pro になったから guardrail いらないよね?」は、

ぶっちゃけ一番やってはいけない思考です。

プロダクションで使うか?正直、こう見る

既に GCP / Workspace が主戦場なら:A/B テスト即開始でいい

- すでに Gemini 1.5 Pro や 1.5 Flash を使っている

- 社内は Workspace / GCP が標準

- NotebookLM や Drive 連携系を PoC している

こういう環境なら、正直「様子見」している時間はもったいないです。

- 既存のエージェント / RAG フローの model ID を

gemini-3.1-proに切り替えてテスト - 特に:

- ツール呼び出し

- JSON 出力

- マルチドキュメント要約 / 比較

あたりの回帰テストを走らせて、

「運用コードを書き換えずにどこまで改善するか」を観測する価値があります。

完全に OpenAI / Azure 陣営なら:セカンドベンダーとして“冷静に”導入

- 既に GPT‑4.1 / o3 + Azure / OpenAI API にがっつり寄っている

- CI/CD、認証、権限管理もすべて Azure で組んでいる

こういう状況で、いきなり「メインを Gemini に乗り換える」は、

さすがに現実的ではありません。

その代わりに:

- 特定ユースケースだけ Google に寄せるのはアリ

- Drive / Gmail / Docs と連携したワークフロー

- BigQuery とセットで回す社内アナリティクスボット

- 「同じタスクを GPT‑4.1 / o3 と 3.1 Pro に投げて、

どっちが円あたりの成果が出るか」を数値で比較する

というセカンドベンダー戦略は、十分検討に値します。

まだどこにも寄っていないスタートアップなら:正直、かなり悩ましい

スタートアップ視点だと、ぶっちゃけこうです:

- プラットフォームとしての完成度は

「OpenAI + Azure + M365」

vs

「Gemini + GCP + Workspace」

でほぼ五分の戦いに近づきつつある - モデルだけで選ぶと、どちらも十分に強く、タスク依存で勝ったり負けたり

なので最終的には:

- チームの既存スキルセット(Azure 強いのか、GCP 強いのか)

- 既に契約しているオフィススイート

- どの地域・規制環境向けのサービスか(データレジデンシ / コンプライアンス)

で決めるのが現実的です。

Gemini 3.1 Pro の登場で、「Google 陣営をメインに選ぶ」という選択肢がようやく本気で検討できるレベルにはなった、というのが個人的な評価です。

結論:まだ「様子見」じゃなくて、「限定本番投入 & 計測」のフェーズ

プロダクションで使うか?と聞かれたら、正直こう答えます。

- 「全面移行」:まだ様子見

- 「限定ユースケースでの本番投入」:むしろ早く試したほうがいい

理由はシンプルで:

- ツール呼び出し・JSON・ロングワークフローの改善は、

現場のペインにかなり直結している - とはいえ、価格 / 挙動の安定性 / ロックインのインパクトは

まだ数ヶ月は観測が必要

なので、現実的な落としどころは:

- 既存ワークフローに

gemini-3.1-proを刺して A/B テスト - ツールコール成功率・ハルシネーション率・タスク完了時間をメトリクスで比較

- 有望なところから限定的に本番導入

この「計測付きの限定本番投入」が、

いま Gemini 3.1 Pro に対して取るべき一番健全なスタンスだと思います。

ぶっちゃけ、派手なデモ動画よりも、

地味な JSON とツール呼び出しがどこまで安定したかのほうが、

エンジニアの給料と睡眠時間には直結しますからね。

コメント