「動画もテキストも画像もできるのに、BGMだけ毎回フリー素材を漁ってる」

そんな経験、ありませんか?😅

YouTube用にサクッと動画作りたいのに、

- 著作権OKな音源を探すのに30分

- ループが不自然

- 雰囲気は合ってるけど、尺が合わない・盛り上がりがズレる

正直、ここが一番“人間がやらされている作業”だと前から思っていました。

そんな中で、Google DeepMindが出してきたのが

Geminiの音楽生成機能(Music in Google AI / Music AI tools)。

結論から言うと、

これは「AIで音楽も作れるようになりました」じゃなくて、

「Googleが“クリエイティブOS”を取りに来た一手」です。

以下、エンジニア視点+クリエイター視点で、かなり本音ベースで書きます。

一言で言うと「CUDAがGPUを変えた瞬間」が、クリエイティブ領域で来た

DeepMind本人たちも分かっていると思いますが、

これは単なる「テキスト→音楽モデル」ではありません。

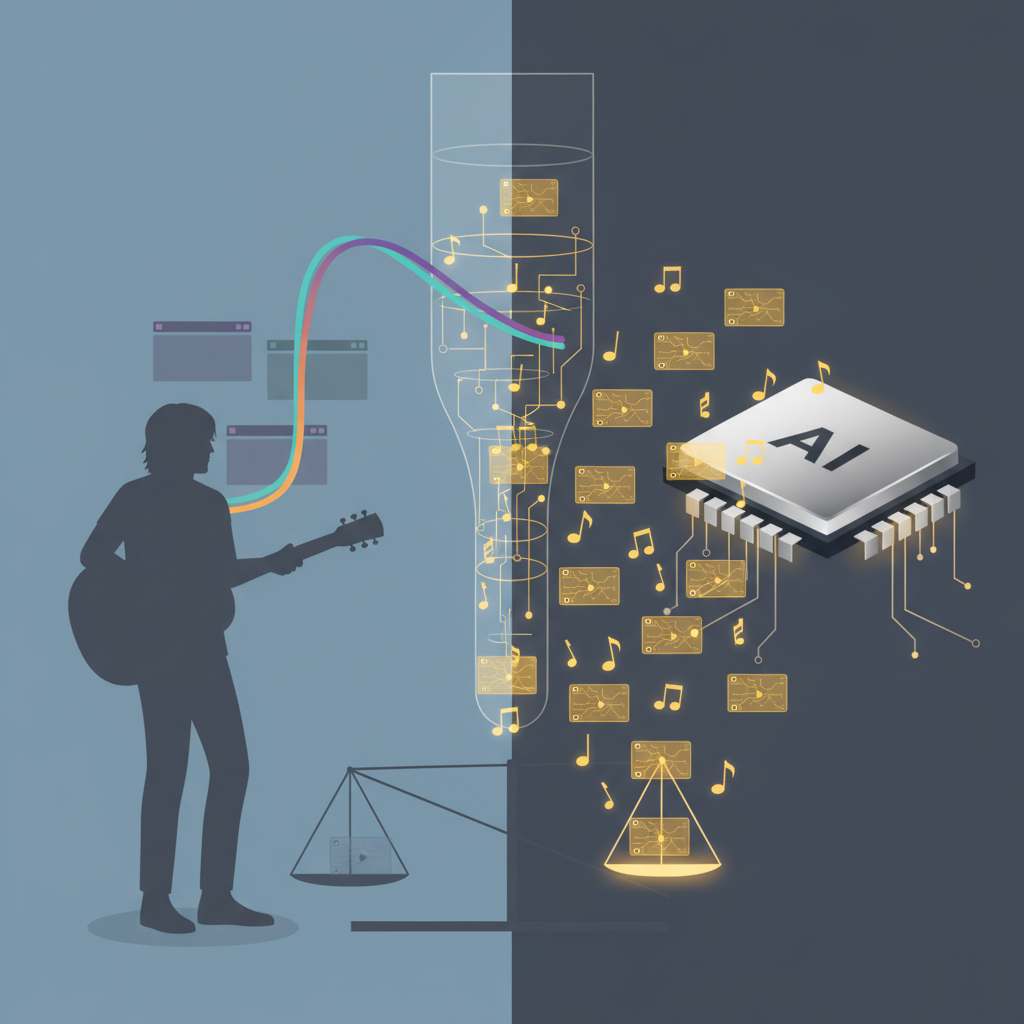

- 以前:LLMは「テキストと画像とコードのエンジン」

- これから:Geminiは「テキスト・画像・動画・音楽をまとめて握る“創作エンジン”」

歴史的に言うと、

CUDAが出て「GPU=ゲーム用」から「汎用計算エンジン」に化けた瞬間にかなり近いです。

CUDA以前:

- GPU = グラフィック専用

CUDA以後:

- GPU = 機械学習・物理シミュ・レンダリングなんでも乗る“汎用アクセラレータ”

今までは:

- テキスト → LLM

- 画像 → Diffusion

- 音楽 → Suno / Udio / 研究用モデル (MusicLM など)

- 動画 → Veo, Pika, Runway など

とバラバラだったのが、

Googleは「全部Geminiにまとめていいじゃん」と言い始めた。

Geminiで:

- スクリプトを書く(テキスト)

- 絵コンテっぽい画像を出す(画像)

- Veo 3で動画を作る(動画)

- その動画に合わせたBGMを自動生成する(音楽)

という一気通貫のパイプラインが、1つのモデルファミリーの中で回る。

これ、地味にとんでもない変化です。

何がそんなにヤバいのか:機能より「どこに組み込んだか」が本質

技術的には「すごい」けど、それより「配置」がエグい

Geminiの音楽生成で新しいところをざっくり言うと:

- テキストだけで曲を作れる(ジャンル・ムード・テンポなど指定)

- ハミングや歌を入力して、それを元にアレンジできる

- 参考音源を渡して、雰囲気だけ継承したトラックを生成

- 動画を渡して、その構成やムードに合う音楽を自動生成

- 数十秒〜1分超えの構造のある楽曲(イントロ / A / サビ的な流れ)

でも、正直ここだけなら

「SunoやUdioと同じカテゴリの“テキストから音楽”ツール」なんですよね。

本当に怖いのはここ:

- YouTube Studio に直結

- Geminiアプリ(モバイル/Web)から誰でも触れる

- 将来的にGemini API で text_to_music が飛んでくるのがほぼ確実

つまり、

「YouTubeで動画作るなら、

とりあえずGeminiでBGMつければいいじゃん?」

というデフォルトの選択肢をGoogleが作りにきている。

SaaSの世界で言えば:

- 競合のAI音楽スタートアップは「単体のSaaS」

- Googleは「OSレベルにバンドル」してきた

この構図です。

他のAI音楽サービスと比べて、何が違うのか?

ぶっちゃけ、Suno / Udio vs Gemini Music という構図は避けられません。

機能面:Sunoは“音楽特化”、Geminiは“ワークフロー特化”

- Suno / Udio

- 「曲を完成させる」のに特化

- ボーカル入り、歌詞も一気に生成

- 純粋な音楽クオリティはかなり高い

-

ただし“そこだけ”で完結

-

Gemini Music

- 単体の曲としての完成度より、

- 「動画・スクリプト・画像と一緒に扱える」ことに強み

- 例:

- Geminiで台本 → Veo 3で動画 → GeminiでBGM → YouTubeにそのままアップロード

正直、音楽のクオリティ単体ではSunoのほうが尖っている可能性は全然あると思っています。

でも開発者やYouTubeクリエイターの立場で見ると、

「いちいち別サービスに行かなくても、

YouTube Studioの中で完結するほうが圧倒的にラク」

なんですよね。

エコシステム:個別サービス vs “YouTube標準”

Suno側から見ると相当キツいのはここです。

- Suno:

- Webアプリ or 連携アプリとして「選んで使う」存在

-

APIはあっても、ユーザーを自分のところに呼び込まないといけない

-

Gemini Music:

- YouTube Studio や Google Photos, Android, そのうちSlides/Docsにも入ってくる

- 「え、これデフォルトで使えるじゃん」が武器

たとえば数年後、

- YouTubeの「BGMを追加」ボタン → デフォルトがGemini生成

- Androidの動画編集アプリ → 「AIでムードに合う音楽を作成」

みたいな世界になったとき、

ユーザーがわざわざ別サービスを開くインセンティブはかなり下がる。

クラウドの世界で

「他社のLLM APIをわざわざ繋ぐ?」

という議論とすごく似てます。

法務・著作権:Googleは“安全サイドに振り切る”はず

AI音楽で一番荒れそうなのがここ。

- Suno / Udio:

- 「学習データは合法の範囲でやってます」路線

-

とはいえ、有名アーティストっぽい曲が出ることはよくある

-

Gemini:

- YouTubeはすでに世界最大級の権利処理マシン(Content ID)

- メジャーレーベルとのコネ・契約が山ほどある

- その分だけ、“似すぎ問題”には超ビビっているはず

なのでGemini側は:

- 「〇〇風の曲作って」はかなり弾かれる

- 明確にアーティスト名を出したらほぼNG

- 似すぎと判定されたら内部で自動的にスタイルをずらす

みたいな挙動になる可能性が高い。

クリエイター目線だと

- 安全だけど、ちょっとつまらない

- 攻めたパスティーシュやオマージュをやりたい人には物足りない

というバランスになる気がしています。

「開発者から見たおいしさ」と「地味にキツいポイント」

良いところ:フルスタック・クリエイティブAPIのピースが揃った

Gemini音楽がAPI化されたとき、開発者的に一番おいしいのはここです:

- 1つのバックエンド(Gemini)で:

- スクリプト生成(テキスト)

- サムネイル・イラスト生成(画像)

- 動画プロットやショット案(テキスト+画像)

- 実写やCG合成のガイダンス(テキスト)

- BGMやジングル(音楽)

- 全部をひとつのマルチモーダルAPIで繋げる

今までは:

- OpenAI / Gemini → テキスト・画像

- Suno → 音楽

- Pika / Runway / Veo → 動画

と分散していたところを、

「とりあえずGeminiに寄せておけばOK」という設計ができてしまう。

ゲーム開発でも:

- シーンの状況(テキスト)→ リアルタイムBGM生成

- キャラの会話 → その感情に合わせた短いジングル

みたいなことを同じAPIでやれるのは、正直かなり魅力的です。

ただし:ロックインと“黒箱DAW問題”がかなり重い

懸念も多いです。

ベンダーロックインが濃すぎる

- 音楽生成って、テキストや画像以上にモデル依存度が高い

- もし自社サービスの音周りをGemini Music前提で設計すると:

- モデルの挙動が変わったり

- プライシングが変わったり

- 利用規約が変わったりしたときの影響がデカい

しかも、音楽は「差し替えが大変」なんですよね。

既存コンテンツ全部のBGMを後から別モデルで作り直す、というのは現実的じゃない。

コントロールが“プロ視点だと足りない”可能性が高い

音楽を本気でやっている人からすると、

「プロンプト&祈り」でしか制御できない作曲ツールは、最終的にストレスの元になります。

- キー(調)、テンポ、拍子

- セクションの長さ、サビの位置

- ストリングスだけミュート、ドラムだけ差し替え(=ステム)

この辺をどこまでAPIとして開いてくれるのか、かなり怪しい。

少なくとも最初のバージョンは、

「YouTube動画のBGMとしては十分だけど、

DAW代替にはまだならない」

というレベルに落ち着くと見ています。

コスト & レート制限

音楽生成はテキストの比じゃないくらい重いです。

- 高サンプリングレート(44.1k / 48kHz)

- ステレオ

- 数十秒〜数分の連続シーケンス

これをリアルタイム or ほぼリアルタイムで返すとなると、

- 1リクエストあたりのコストはテキストの桁違い

- 無料枠 or 低価格プランではかなり厳しめの制限が入るはず

商用サービスで利用する場合は:

- 「1曲あたりいくらまでなら許容か」

- 「生成回数に対してどんな課金モデルにするか」

をかなりシビアに設計しないと、赤字BGMジェネレータになります😇

一番の「落とし穴」:YouTubeに“音楽OS”を握られるということ

正直、ここが一番気になっています。

- 今でもYouTubeは「音楽の発見プラットフォーム」として強すぎる

- そこに「YouTube公式のAI音楽」が乗る

ということは、

- インディーミュージシャンが自作曲をYouTubeで広める

- クリエイターはGeminiが作ったBGMを無限に使える

という2つが同じ場で競合することになる。

プラットフォーム側(=YouTube)から見れば、

- 著作権処理の要らないGemini曲を推すインセンティブ

- “自社AIで作ったロイヤリティフリーBGM”が増えれば増えるほど、

レーベルへの支払い比率を抑えやすい

という構造がどうしても出てきます。

もちろん、Googleは「クリエイターと共存します」と言うでしょう。

でも、アルゴリズムのちょっとした優遇で状況はいくらでも変えられる。

「Gemini製BGMを使った動画の方が、軽くおすすめに乗りやすくなる」

みたいな“見えない優遇”は、技術的にはいつでも可能です。

これをどうバランスさせるのかは、かなりセンシティブなポイント。

じゃあ、プロダクションで使うべきか?個人的な結論

現時点(ローンチ直後を前提にして)での自分のスタンスはこんな感じです:

✅ 積極的に試すべきケース

- YouTube / ショート動画 / 広告のBGM

- テスト用・プロトタイピング用としては最高

- 「とりあえず雰囲気を見る」には神コスパ

- 社内用動画・プレゼン・社内イベント用コンテンツ

- 著作権的にグレーな音源を使いたくない現場にはかなりありがたい

- プロトタイピング用のゲーム・アプリデモ

- 雰囲気BGMを量産する用途

🤔 まだ様子見したいケース

- 本気の音楽プロジェクト(リリース前提のアルバム・サントラ)

- 権利関係(著作権・著作者人格権相当の扱い)

- ライセンス条件(クレジット義務・再配布・二次利用)

- モデルの挙動の安定性

- これらがまだフワッとしている段階での全面依存は、正直怖いです

- 他プラットフォームでの二次利用前提の案件

- YouTube外(Netflix, TV放送, ゲーム機, オフライン展示など)で

どこまでクリアに使えるのか、利用規約を精読するまではNG

🎯 自分ならどう使い始めるか

- まずはYouTube用のBGMプロトタイプ生成マシンとして使う

- 良かったものは、人間の作曲家に参考として投げる

- 「こういう雰囲気で、ここから盛り上がる感じで」と共有

- 実プロジェクトは人間が最終的に作る

- 用途・規模を見ながら、

- ライセンス条件が明確になってきたら

- 一部の案件で本番採用も検討

という、“AIをアイデアジェネレータとして使う段階”から入ると思います。

まとめ:これは「便利なBGM機能」じゃなくて「クリエイティブOS戦争」の一歩

- Geminiの音楽生成は、

- 単なる「テキストから曲が作れるスゴいデモ」ではなく、

- YouTube・Android・Google全体を巻き込んだ“創作インフラ化の一手”。

- SunoやUdioは、機能としては引き続き魅力的だけど、

- エコシステムのパワーゲームではかなり厳しい戦いになる。

- 開発者目線では、

- 「テキスト・画像・動画・音楽を一つのAPIで扱える」世界は魅力的だが、

- ベンダーロックインとコントロール不足、ライセンスの曖昧さには要注意。

正直に言うと、

「プロダクションでフル依存するのは、まだ様子見。

でも、ワークフローに“混ぜて試す”価値はかなり高い」

というのが今の結論です。

これから数年、

「どのAIが一番すごいか」よりも「どのAIがクリエイティブOSになりきるか」

という勝負が本格化していきます。

Geminiの音楽生成は、その中でかなり大きな一手。

エンジニアとしてもクリエイターとしても、「使われる側」にならず、「使いこなす側」でいたいですね。🚀

コメント