「レスポンス速くしたいから小さいモデルを選ぶと、精度が物足りない。

精度を取りに行くと、今度はレイテンシとコストが死ぬ。」

そんなトレードオフで悩んだこと、ありませんか?

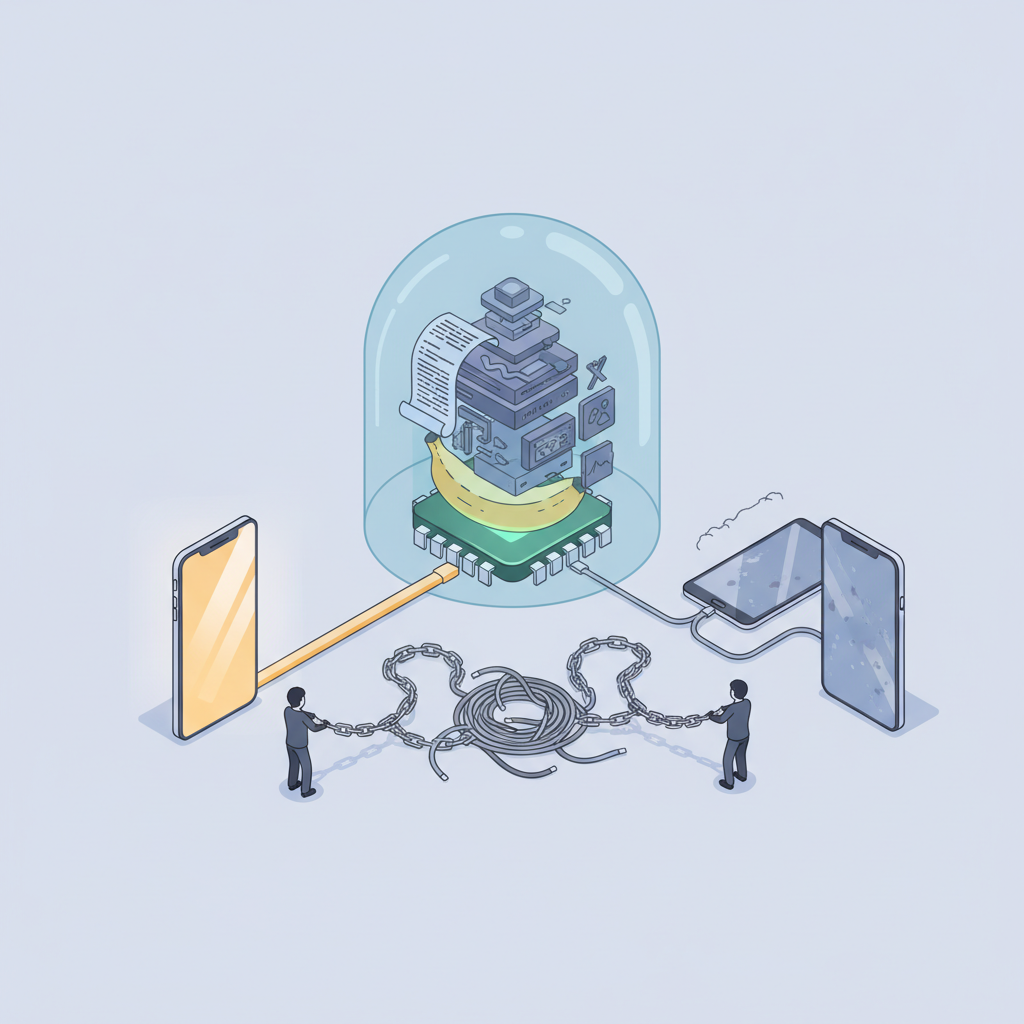

そのど真ん中を狙いにきたのが、今回 Google DeepMind が出してきた 「Gemini Nano Banana 2」 です。

結論(忙しい方向け)

- Nano Banana 2は「端末/エッジ寄り」の高速LLMで、レイテンシとプライバシー要件が強い機能の一次受けに向く。

- 実装は「まずNano→条件でクラウドProへ」を前提に、切替条件・ログ・回帰テストを設計に組み込むのが安全。

- 最大の論点はGoogle/Androidロックイン。マルチプラットフォームなら抽象化レイヤーで逃げ道を残す。

想定読者:モバイル/プロダクト開発者、SaaSでLLM機能を運用する人、レイテンシ/コストを見ているリード。

一言でいうと何か:

「クラウドLLMを“必須”じゃなくしてくる、モバイル界の Neural Engine 化」

一言でいうと、Nano Banana 2 は 「スマホ側に乗る、そこそこ賢い Gemini Pro ライト版」 です。

- これまで:

- 「速さ・コスト・プライバシー」を取るときは Nano(軽量・ローカル)

- 「頭の良さ・汎用性」を取りたいときは Pro / Ultra(クラウド)

- これから:

- 多くのユースケースが 「とりあえず Nano Banana 2 で良くない?」 で済むラインに寄ってきた

感覚的には、

「AI はサーバーサイドでやるもの」という前提から、

「AI はOSのプリミティブの一つ」へ落ちてきたタイミング に近いです。

Apple が iPhone に Neural Engine を載せてから、「顔認証」「写真検索」「リアルタイムエフェクト」が当たり前になりましたよね。

あれと同じことを、Google は 汎用LLMレベルの推論 と コード理解 でやろうとしている、と見ています。

何がそんなにヤバいのか:

「Nano クラスなのに Pro 寄りの“考える力”」というポジショニング

技術的なポイントを、エンジニア目線でざっくり整理すると:

- Nanoクラスなのに「Pro並み」の用途を狙っている

- 文章生成、要約、リライト

- 基本的なコード補完・バグ説明

- ツール呼び出し(関数コール)での推論

- レイテンシ前提が完全に「リアルタイム」

- 高性能スマホなら数百msオーダーを想定

- 入力〜応答までを「UIスレッド感覚」で扱えるレベル

- Android / AICore と密結合

- Pixel → 他OEM という順番で広がるのはほぼ確実

- OSレベルの「AIランタイム」としての扱い

ぶっちゃけ、

「GPT-4o-mini を API 経由で叩くかどうか悩んでいたクラスの機能が、Android に標準搭載される」 くらいのインパクトです。

これ、ちゃんと動くなら設計方針が変わります。

なぜ重要か:

Google vs OpenAI / OSS:開発者目線で見ると「土俵がズレた」

ここからは、完全にエンジニアの立場からの比較です。

OpenAI の “mini/小型” モデルとの違い

- OpenAI 側(例:gpt-4o-mini。関連:Copilotのモデル選択自由化)

- 強み:

- 純粋な推論性能は依然としてトップクラス

- エコシステム(LangChain, LlamaIndex など)が圧倒的

-

弱み:

- どこまでいっても「クラウド前提」

- レイテンシはネットワークと混雑度に縛られる

- プライバシー面で「絶対ローカル完結」が必要なケースには向きづらい

-

Nano Banana 2

- 強み:

- オフラインでも動く可能性(少なくとも設計思想としては)

- レイテンシが「ほぼゼロに近い体感」を狙える

- Android / ChromeOS / Google製アプリに直で噛ませられる

- 弱み:

- モデルサイズ・コンテキスト長の制約は避けられない

- 純粋な「難問コード・長文推論」では Pro/Ultra や GPT-4系に劣る

正直、

「gpt-4o-mini vs Nano Banana 2、どっちが賢いか」 という比較は、あまり本質的ではないと思っています。

より本質は、

- OpenAI:「クラウドAIサービス」

- Google:「OSレベル機能としてのAI」

という住んでいるレイヤーの違いです。

開発者としては、

- ネットワーク越しでもいいから最強の頭脳が欲しい → OpenAI / Gemini Pro / Ultra

- とにかく速くて、デバイスの外に出したくない → Nano Banana 2 クラス

という住み分けが、やっと現実的になってきた感があります。

OSS / ローカルLLMとの力関係

ここも地味に大きいポイントです。

- 今までは:

- スマホで「まともに使えるローカルLLM」を動かそうとすると、

LLaMA 系や Mistral-small を量子化してガリガリ最適化する必要があった - モデル配布・端末性能・バッテリー・メモリなど、全部自前で面倒を見る必要 があった

- これから:

- Android 側が 「使えるローカルLLM(=Nano)」を標準インフラとして提供 し始める

- 開発者側は「細かい推論インフラ」より、「どう体験を設計するか」に集中できる

ぶっちゃけ、

“小さくて速いローカルLLMを売りにしていたSDKベンダー” はかなりきつくなる と見ています。

開発者として何が嬉しいか:

「とりあえず Nano Banana 2 でやってみる」という新しいデフォルト

具体的なインパクトを、ユースケース別に整理します。

モバイル / Android アプリ

- 今まで:

- ちょっとした要約・返信候補でもクラウド呼び出し

- ネットワーク切断時の UX を別途設計

-

コストとレイテンシを見ながら Pro / 小型モデル / ルールベースを併用

-

これから:

- 「まず Nano Banana 2 を叩く」 が新しいデフォルトになり得る

- 意味のある処理の多くを オフライン対応 にできる

- 重い処理だけ Pro / Ultra のクラウドにエスカレーション

結果として、

- 「エッジファースト、クラウドは重い処理専門」 なアーキテクチャが組みやすくなる

- ユーザー視点では「アプリがサクサク」「電車のトンネルでも動く」が増える

SaaS / バックエンド

ここは少し視点が違います。

- API経由で使える Nano Banana 2 は、

- 「いきなり Pro だと過剰だけど、あまりにショボいとクレームになる」

というラインのタスクにちょうどいい - 例えば:

- チャットボットの一次応答

- タグ付け、分類、ライトな要約

- 単純なコード補完やレビューコメント

正直、ここは「gpt-4o-mini クラス」と完全にぶつかる領域 です。

- 料金・性能が拮抗してくると、

- 「インフラを全部 Google で寄せるか」

- 「OpenAI + OSS で構成するか」

- という “クラウドベンダー選定”的なゲーム になってくる気がします。

ただし…懸念点もあります

ベタベタな Google / Android ロックイン

これは一番大きい懸念です。

- アプリが Nano Banana 2 前提で設計されてしまうと:

- iOS / 中国向け Android / Windows 等で

同じ体験を再現するコストが一気に跳ね上がる 可能性があります - 代替モデル(他社クラウド or OSS)を用意しても、

- 出力スタイル

- 推論の癖

- コンテキスト長

が微妙に違うので、QA コストが増える のはほぼ確定です

正直、

「Android だけ爆速で賢いAI体験、iOS は明らかに一段落ちる」 みたいな世界線も十分あり得ます。

クロスプラットフォーム前提のプロダクトは、

- 「Nano Banana 2 を使い倒したいチーム」

- 「ベンダーロックインを避けたいチーム」

のあいだで、社内議論が荒れそうです。

能力的な“天井”問題

いくら「Proっぽい」とはいえ、Nano Banana 2 はあくまで Nano クラスです。

- 長文・長コンテキストの議論

- 大規模コードベースのリファクタリング

- 複雑なマルチモーダル(画像+テキスト+長期履歴)

こういうものは、結局 Pro / Ultra クラスを呼びに行くしかない。

つまり、現実的には:

- Nano Banana 2:

- 「その場で即答してもらいたい、軽め〜中程度のタスク」

- Pro / Ultra:

- 「時間かけてもいいから、絶対にミスできない・重いタスク」

という 二段構え設計が必要 になります。

開発者側は、

- どこまでを Nano に任せて、

- どの条件でクラウド側にエスカレートするか

という ポリシー設計とテスト が新しい仕事になります。

テストサーフェスの爆発

オンデバイス vs クラウドの二段構えをやると、当然テストパターンが増えます。

- 端末の性能差(ミドルレンジ Android でのレスポンス)

- モデル差(Nano Banana 2 と Pro/Ultra での挙動差)

- ネットワーク有無によるフォールバック

正直、

「LLM導入そのものより、モデル切り替えロジックと QA のほうが難しい」 という未来は容易に見えます。

それでも「時代が変わった感」がある理由

個人的に、一番効いていると思うのはここです。

Google が「高品質な AI 画像生成や、そこそこ賢いテキスト推論」を

あえて Flash / Nano クラスに落とし込んできている という戦略そのもの。

画像生成の Nano Banana 2(Gemini 3.1 Flash ベース)の流れも含めて、

- 4K クラスの画像

- 自己検閲+自己修正の多段パイプライン

- それでいて Flash アーキテクチャで「速く・安く」

を押し込んできているのを見ると、

- 「高品質は Pro / Ultra の特権」ではなく、

- 「高品質 × 軽量 × 安価 が新しいデフォルト」

にしたい、というメッセージをかなり強く感じます。

ぶっちゃけ、

“高性能AIはお金持ちクラウドだけのもの” という構図を壊しにきている と見ると、かなり面白いフェーズです。

じゃあ、プロダクションで使うか?

正直…「段階的な採用」が現実的なライン

エンジニアとしての結論をはっきり書くと:

- 「いきなりコアロジックを Nano Banana 2 に全振り」は、まだ様子見

- ただし、PoC とサブ機能から導入する価値はかなり高い

具体的には、こんな戦略をおすすめします。

Android アプリが主戦場のチーム

- まずは:

- 要約

- スマートリプライ

- アプリ内チュートリアル / FAQ

- など、「UX影響は大きいがビジネスリスクは低め」の部分から Nano Banana 2 を試す

- その上で:

- Pro / Ultra へのエスカレーションパターンを設計

- iOS / Web では別モデルでどこまで再現するかを検証

SaaS / バックエンド中心のチーム

- まずは:

- Gemini Pro / 他社モデルで動いている軽量タスクを、

コンフィグ切り替えで Nano Banana 2 に差し替え可能にしておく - モデルは:

- Feature flag / 設定ファイルでいつでも差し替え可能にする

- KPI として:

- コスト

- レイテンシ

- エラー率/CSクレーム

- を追いかけ、どこまで Nano Banana 2 を「デフォルト」にできるかを測るのが現実的です。

まとめ:

「クラウドLLM絶対主義」が崩れ始めたタイミングとして、Nano Banana 2 を捉える

Nano Banana 2 自体のベンチ結果や、「本当にどこまで Pro に近いのか」は、正直これからの検証次第です。

ですが、技術者として重要なのは、

- Google が本気で 「使えるレベルのLLMを端末側に落としてくる」 方向に舵を切ったこと

- それによって、アーキテクチャ設計の前提が

「クラウド中心」から「エッジ中心+クラウド補完」に変わり得る こと

だと思っています。

プロダクションでフル採用するかは、まだ冷静に見た方がいい。

でも、

- Android アプリ

- 画像生成付きのワークフロー

- ライトな推論を多用する SaaS

をやっているなら、

「今のうちに、Nano Banana 2 前提の設計を一度シミュレーションしてみる」 価値はかなり高いです。

数年前に「Neural Engine 前提で iOS アプリを設計し直した人たち」と、

今 Nano Banana 2 を前提に動き出す人たちの差は、

数年後にそれなりにはっきり出るだろうな、というのが正直な感触です。

コメント