「昨日まで普通に動いていたLLMスタックが、今日いきなり“ポリシー違反”になった」──そんな経験、そろそろ現実味を帯びてきたと感じませんか?

2月27〜28日のAI・データ分析界隈のニュースは、「API仕様は変わってないのに、世界のほうが勝手に壊してくる」タイプのアップデートが揃いました。

正直、エンジニア視点で見ると、技術ニュースというより運用とガバナンスの悪夢です。

この記事ではニュースを並べるだけでなく、「実際にプロダクトを作る側から見て何が変わるのか?」を中心に、かなり主観強めで整理します。

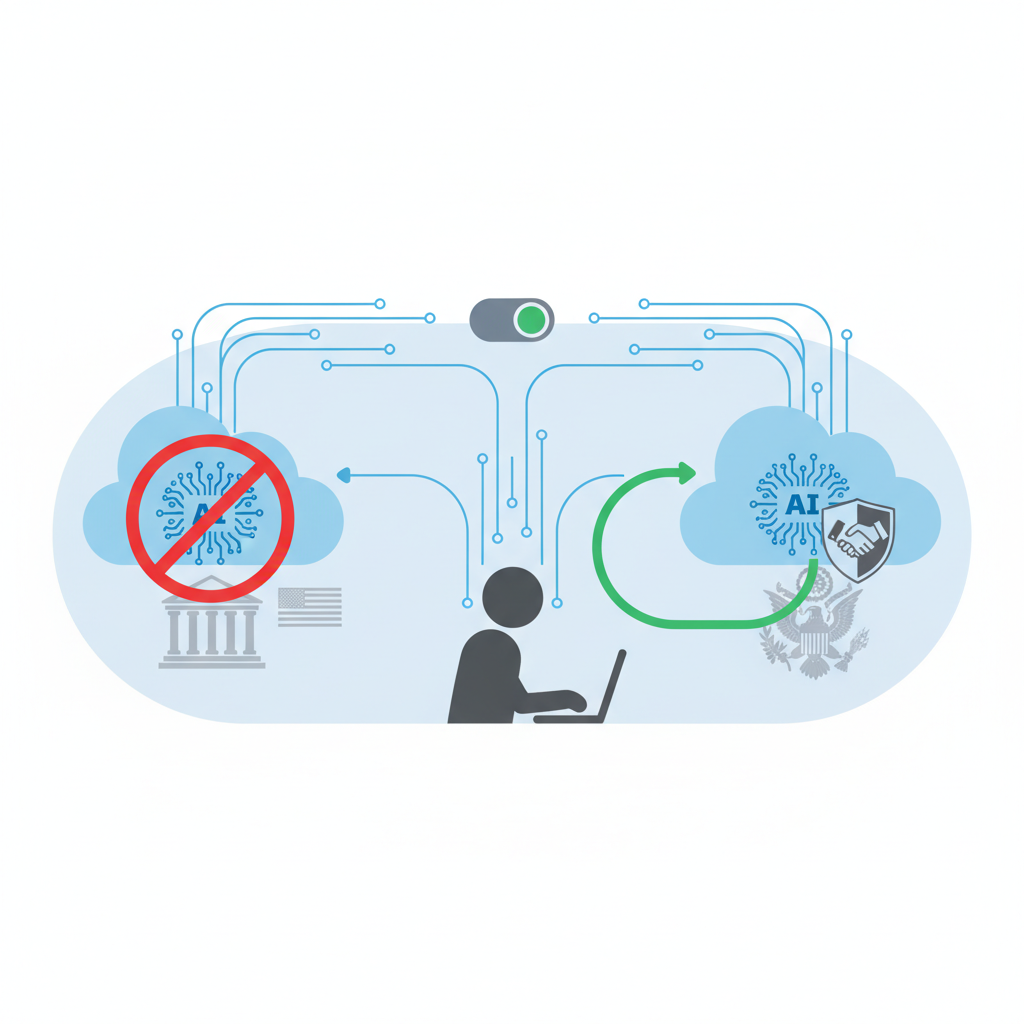

US政府のAnthropic使用禁止+OpenAI–DoD契約:これは事実上の「LLM版 Huawei 排除」

-1. 何が起きたか(技術者に関係する部分だけ)

- トランプ政権の方針として、米連邦政府はAnthropic(Claude系)の利用禁止

- ほぼ同タイミングで、OpenAIが米国防総省(DoD)と正式契約

- ClaudeのAPI仕様は何も変わっていないのに、「US Gov環境では使えないライブラリ」化した、というのが本質です。

一言で言うと、

「AI界のHuawei排除+Cisco優遇」が、

そのまま「Anthropic排除+OpenAI採用」で再演されている感じです。

- Anthropic = Huawei/ZTE 的な扱い(連邦用途ではブラックリスト)

- OpenAI = Cisco 的な「標準・安全」とみなされるポジションへ

-2. なぜこれが痛いか:APIではなく“環境”が壊れたから

開発者にとっての痛みどころはここです。

- コードは同じでも、

if tenant == "US_GOV": provider != "Anthropic"

という環境依存の制約が突然増えた - 既にClaudeベースでPoCをやっていたSIer・ベンダーは、

要件定義フェーズの後ろから「政治的Breaking Change」が飛んできた状態

ぶっちゃけ、

「バージョンアップで壊れるならまだマシで、政策で壊れるのが今後の標準形」になりつつあると感じます。

-3. OpenAI vs Anthropic:技術より“政治リスク差”がはっきりした

性能やAPIの心地よさの議論より、

「どっちを選ぶと後からポリシーで殴られにくいか」が、かなり露骨に差として出ました。

- OpenAI

- DoDパートナーになったことで、

「セキュリティ・コンプライアンス面で“米国公認”」というバッジをゲット - Azure OpenAI経由のガバメントクラウド活用も含め、

ガチガチの監査・ロギング機能がプロダクションAPIにも降りてくる可能性が高い - Anthropic

- 連邦用途でのビジネスはほぼクローズ

- 銀行・重要インフラ・防衛産業など、「政府と足並みを揃えがちな業界」でも敬遠されるリスク

技術者として正直に言うと、

「Claudeの対話品質が好きだからメインに使う」みたいな選択は、

規制産業・公共案件では一気に“危険寄りの選択”になったと見たほうがいいです。

Seedance 2.0とハリウッド:AIトレーニング界の「Napster裁判」前夜

-1. Seedance 2.0は、技術的には地味で法的には派手

Seedance 2.0 自体は、

- 映画・TVコンテンツ(脚本・映像・音声)に強い

- 検索・埋め込み・シーン対応などが整理された

- 物語構造や台詞スタイルの学習に使いやすい

といった、「ちゃんと作られたマルチモーダル資料集」に見えます。

でもハリウッドは、これを“AIトレーニング用Napster”ポジションとして狙い撃ちしにきている。

- Napster:音楽ファイル共有 → 業界総出で潰された

- Seedance:映画的表現の共有・学習基盤 → 訴訟で境界線を決めにいく

技術目線で怖いのは、

「埋め込みベクトルだからOKでしょ」みたいな発想が、まとめて吹き飛ぶ可能性が高いことです。

-2. なぜ開発者には効いてくるのか:データセットが“法的ライブラリ”になるから

今までは:

pip install的ノリで HuggingFace の dataset を使う- 「出所はグレーだけど、みんな使ってるし…」という空気

で済んでいたところが、

Seedance 2.0 の裁判結果次第で、ビジネス的に完全にNGになるラインが明確化されるかもしれません。

ぶっちゃけ懸念しているのはここです:

- 「ライセンス不明なデータセットを混ぜた大規模事前学習モデル」ごと巻き込まれる可能性

- 「トレーニング時に使ったかどうか分からないけど、結果として似たシーンが出てきた」

→ それだけで訴訟リスクになる未来

これ、後からクリーンアップするのはほぼ不可能です。

Git履歴に機密鍵をコミットしてしまうどころの話ではない。

日本の高校生の46%が生成AI利用:エドテックはもう「LLMが差別化」じゃない

-1. 46%という数字の意味

日本の高校生の約半数が生成AIを使っている、という調査結果。

ここでポイントなのは:

- これは「ギークな一部」ではなくマス採用である

- 学校側の規制・禁止をすり抜けながらも使われている可能性が高い

- ChatGPTやClaudeだけでなく、LINEや国内ベンダーのボット経由など、生活インフラ側に溶け込んでいる

エンジニア目線で言うと、

「エデュケーション領域のユーザーは、デフォルトでAIネイティブ」と見なさないと設計を誤ります。

-2. エドテック開発の現実:AIは“機能”ではなく“前提インフラ”

正直、

「うちの学習アプリには生成AIチャットが付いています!」

は、もはや売り文句ではなく最低限のUXです。

- 生徒はどうせ外部のChatGPTなりを並行利用する

- 宿題・模試の問題文が外部LLMにコピペされるのは時間の問題

- PII(個人情報)や試験問題が海外LLMに普通に流れているとみるべき

なので本当に差別化になるのは、

- 学校・塾単位の専用エンドポイント

- 年齢に応じたプロンプトフィルタリング

- 学習履歴と連動したカリキュラム最適化

- 「どこまでAIを使ったか」を教師が把握できる透明なログ

といった、“AIを守る側・管理する側の機能”です。

単なる「AIをつけてみました」サービスは、正直もう厳しい。

3つのニュースに共通する「やっかいな真実」

ここまでをまとめると、3つのニュースはバラバラに見えて、エンジニアにとっては同じメッセージを投げてきています。

「もうAPIやモデルだけを見て設計してはいけない」

共通する3つの構造

- Anthropic禁止

- 問題:技術的には動いているが、ポリシーで使えない

- Seedance 2.0

- 問題:技術的には便利だが、法的に地雷かもしれない

- 高校生AI利用46%

- 問題:禁止しても実態は変えられないので、ガバナンス込みで設計する必要

どれも、「コードだけ見てても見えない破壊要因」です。

ぶっちゃけ、

LLMやデータ基盤を設計する人は、もう半分はアーキテクト兼プロダクト弁護士見習いくらいの感覚が要る時代に入ったと思います。

他のプレイヤーとの比較視点:「マルチベンダー・クリーンデータ・ドメイン特化」が勝ちパターンになる

-1. ベンダー選定:OpenAI一択か? それともマルチか?

「政府がOpenAI選んだからOpenAIだけでいいじゃん」という割り切りも一理ありますが、

エンジニアとしてはそこまで単純に乗るのも危ないと見ています。

- OpenAI単独依存のメリット

- コンプライアンス資料が厚い

- Azure/GCP連携などエコシステムが豊富

- 国防クラスの要求を満たすログ・監査機構のエコー効果

- ただしデメリット

- 価格・レート変更リスクにフルコミット

- 将来のポリシー変更(利用用途制限等)に逃げ場がない

- モデルの世代交代(4oのEoLのような件)にユーザー側が付き合わされる

一方でAnthropicやオープンモデルを含むマルチ構成は、

- 規制が緩い領域:Anthropicやオープンモデルでコスト・品質最適化

- 規制が厳しい領域・特定顧客:OpenAIやローカルモデルでガバナンス重視

のようにワークロード単位でのポリシーベース・ルーティングが取りやすい。

正直、

「どれが一番強いか」という“LLM戦闘力ランキング”より、

「切り替えコストをどれだけ安くできるか」が競争力になってきています。

-2. データスタック:Seedance 2.0 問題から見える勝ち筋

Google、Microsoft、Adobe など大手はすでに、

- 「学習データのライセンスはクリーンです」

- 「クリエイターに対する補償スキームがあります」

というストーリーを整え始めています。

これに対して、

- Webスクレイピング+少し加工しただけのデータ販売業者

- Seedance 2.0 のような、グレー〜黒寄りのコーパス

は、Napster時代の違法MP3アーカイブにどんどん近づいている。

エンジニアがこれから評価すべきは、

- 「どれだけ大きいコーパスか」ではなく

- 「どれだけ出所・ライセンス・削除権限が透明か」

です。

ぶっちゃけ、「パフォーマンスはいいけどデータ出所はボカしてます」系のモデルやデータセットは、

プロダクション用途では“将来バグるライブラリ”と同じ扱いにすべきだと考えています。

「ただ、懸念点もあります…」:開発現場レベルでの落とし穴

-1. ポリシー対応を「人間の運用」でやろうとするのはほぼ無理

「US政府案件ではAnthropic使うなってガイドライン書いておけばいいでしょ」

という運用は、現場的にはまず破綻します。

- 設計書ではOpenAIになっているが、検証環境でエンジニアがClaudeを試してそのまま残る

- テスト用の環境変数が本番テンプレートにコピペされる

- インターンが書いたスクリプトが、実はAnthropic前提だった

正直、人間の注意力に頼る設計はもう限界です。

テスト・CI/CD・設定管理の層に、ポリシーチェックを機械的に組み込む必要があります。

例:

allowed_providersを環境変数やTerraformで明示し、CIでLint- データセット単位で

license: commercial_allowedを必須にし、スキーマValidation anthropicへのHTTPコールを静的解析してFailさせるルール

など、「違反したらビルドが落ちる」レベルまで持っていかないと、現場では守れないと見ています。

-2. エドテック:安全に作ろうとすると、想像以上にフルスタック

「高校生向けAIアプリを安全に作る」ことを真面目にやると、かなり重いです。

- 年齢別フィルタリング(未成年向け)

- PII検出とマスキング

- 学校・自治体ごとのポリシー反映

- 保護者・先生向けのダッシュボード

- ログ保存期間や第三者提供の明示

単に「モデルをAPIで叩く」だけではなく、プロダクトとしての社会責任設計がフルセットで乗ってきます。

ぶっちゃけ、

「とりあえずChatGPTをくっつけた教育アプリ」は、

2026年以降は“技術的には簡単だが事業的には危険”な領域に入ってきたと思います。

結論:プロダクションでどうするか?正直「様子見」しつつ、構造だけは今すぐ変えるべき

最後に、「じゃあ実務としてどうするの?」という話を、自分ならこうするという形でまとめます。

-1. LLMベンダー戦略

- Anthropic/Claudeを全面禁止にする必要まではないと思っています。

- ただし「政府・規制産業案件での“第一選択肢”にはしない」が妥当ライン

- OpenAIは、

- 規制の厳しい顧客・用途では“デフォルト候補”

- ただし価格・ポリシー変更リスクを考えて、アーキテクチャ的には必ず差し替え可能にしておく

- 重要なのは、

- アプリケーションコードからLLMプロバイダを分離すること

- これをやらないと、次の「Anthropic禁止」の類似イベントが来たときに、本当に死にます。

結論:

「どれを使うか」より「いつでも乗り換えられるようにしておくか」が本質です。

-2. トレーニングデータ・RAGコーパス戦略

- Seedance 2.0 のようなものは、

商用プロダクションには入れないほうが賢明だと思います(少なくとも判決出るまでは)。 - 自前でコーパスを作るなら、

- 最初から

source,license,allowed_useをメタデータに入れて - 「ライセンスが不明なら学習・インデックスに入れない」パイプラインを組む

- すでにグレーなデータを学習済みのOSSモデルを使う場合は、

- 利用用途を限定(社内検索など)

- 対外に生成物を出すときは「スタイルの模倣」系に慎重

結論:

プロダクション用の“クリーンコーパス”を会社として資産化し始めないと、数年後に詰むと思っています。

-3. 教育・若年層プロダクト

- 「AI利用を禁止する」のは現実的ではないので、

- 「公式の安全な入り口」を用意する方向に発想転換

- 具体的には、

- 学校・塾単位の専用エンドポイント

- ログ・コンテンツフィルタ・個人情報の扱いを明確化

- それでも外部LLMは使われる前提で、差分価値は“先生と一緒に使えること”に置く

結論:

教育向けAIは「AIをどう使わせるか」より「AI利用を前提にカリキュラムを再設計するか」が勝負だと考えています。

正直なところ、

今回のニュース群に対する私の総評は、

- 技術スタックとしてはまだまだ攻めていい

- ただしアーキテクチャとデータガバナンスは、今のうちに“守り寄り”に張り替えておかないと、後で痛い目を見る

です。

「プロダクションでAIを使うか?」という問いに対しては、

「使うべき。ただし“今のままの作り方”で出すのは、正直もう様子見したほうがいい」

というのが、エンジニアとしての本音です。

コメント