「関連研究のサーベイして、実験コード書いて、ログ整理して、ドラフト書く」──

この一連の流れ、正直もう何回やったか覚えていないし、毎回「これ全部、自分がやる必要ある?」と思ったことはありませんか。

そんなところに出てきたのが、Andrej Karpathyの自律研究エージェント「autoresearch」です。

結論(先に要点)

- autoresearchは、研究タスクを“ワークフローとしてコードに分解”し、LLMを差し込むリファレンス実装。

- 『ボタン一発で論文』ではなく、ログ・レビュー・権限設計まで含めた運用が前提。

- 現時点は本番投入より、R&Dの実験基盤(プロトタイプ)として触るのが現実的。

想定読者:研究室/R&Dで文献調査〜実験〜レポート作成の反復を回している人、LLMエージェントを“運用できる形”に落としたい人。

autoresearchって結局なに?一言でいうと「研究版 Papermill」

一言でいうと、autoresearch は「研究ワークフローに特化した、自律エージェント版 Papermill」だと感じています。

- AutoGPT 的な「なんでもやります!」系エージェントではなく、

- 研究タスク(アイデア → 文献調査 → 実験 → 結果要約 → 論文ドラフト)にフォーカスして、

- そのプロセスをコードとして明示的に分解・実装している

歴史的にいうと、

- Jupyter が「対話的な研究」の民主化を起こし、

- Papermill が「Notebookをバッチ実行してレポート自動生成」という“研究パイプライン”を開いたように、

autoresearch は「LLM を中心に据えた、自動研究パイプライン」の最初のリファレンス実装になり得るものです。

正直、この「ワークフローをちゃんとコードで切り出した」のが一番エラいところだと思います。

何が新しいのか:LLMエージェントの解像度を一段上げた

技術的なポイントはすでに多くの解説記事があるので、ここでは「エンジニア目線で何が変わるか」に絞ります。

-1. 「プロンプト芸」から「ワークフロー設計」へのシフト

LangChain 以降、「Agent + Tool + Memory」の抽象で遊んだ人は多いと思いますが、

- 1プロンプトで全部やらせようとして破綻する

- 思考チェーンが長くなると、途中でコンテキストが迷子になる

- 気づけば「とりあえず色々試してくれる、お利口なチャットボット」で終わる

という経験、ありますよね。

autoresearch はここをかなり割り切っていて、

- 文献探索

- 実験計画とコード生成

- 実験実行

- 結果集約

- 論文セクションごとのドラフト生成

といった「研究タスクのモジュール分解」を先に決めておき、その上で LLM を差し込んでいます。

ぶっちゃけ、「LLM に何をさせるか」より前に

「研究プロセスをどう分解するか」をちゃんとデザインしているところがポイントです。

これは、

- 「プロンプトエンジニアリング」から

- 「ワークフローエンジニアリング」

に、開発者の意識を一段引き上げるサンプルコードになっていると感じます。

-2. Karpathy版「これがエージェントの書き方だ」のリファレンス

autoresearch のもう一つの意味は、Karpathy本人が設計した“エージェントの分解の仕方”が丸ごと公開されたことです。

- 630行前後のミニマルな Python

- 余計な抽象化やフレームワークを入れない

- 「思考ログ + ツール呼び出し」を素直に書いている

正直、LLM エージェントの設計パターンをここまで「生々しく」晒しているコードはまだ少ないです。

LangChain のようなフレームワークは抽象化が厚くて、

- “正解の組み方”が分かりづらい

- 典型パターンがコードベースとして見えにくい

という意味で、初心者には逆にハードルが高かった。

autoresearch はそこに、

「研究用エージェントなら、これくらいの粒度で分解するとちょうどいいよ」

という具体的な見本を1つ置いてくれた、そんなポジションだと思います。

競合との比較から見える「autoresearch のリアルな立ち位置」

ここからは少し辛口に、既存のプレイヤーと比較してみます。

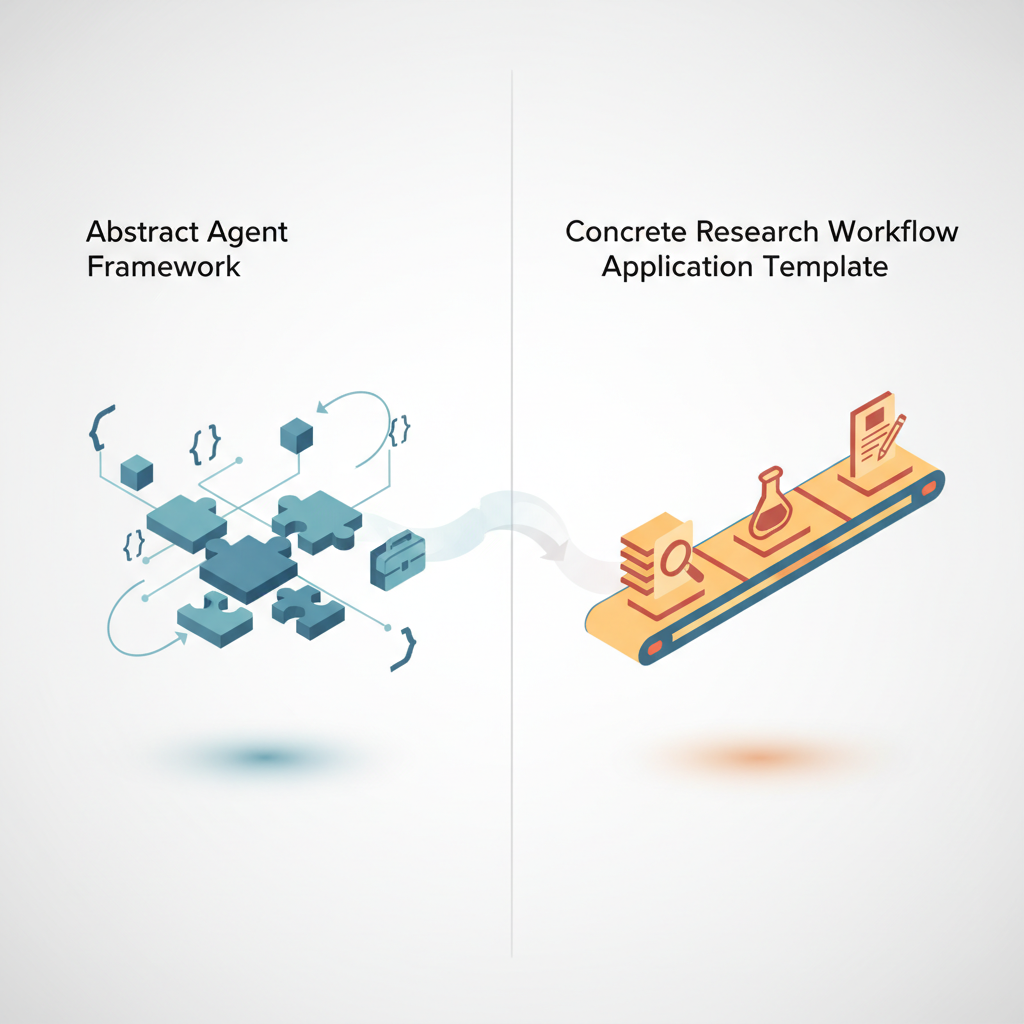

-1. LangChain / LlamaIndex vs autoresearch

- LangChain / LlamaIndex

- 汎用エージェントフレームワーク

- どのドメインでも使える抽象を提供

-

ただし、「研究プロセス」をどう切るかは利用者の責任

-

autoresearch

- 研究という特化ドメイン向けの完成品テンプレ

- 文献検索〜実験〜ドラフトまでの具体ルートをハードコード

- 抽象度よりも「動く実例」を優先

ここで重要なのは、「どっちが優れているか」ではなく、

- LangChain系:ライブラリ/フレームワーク

- autoresearch:アプリケーションテンプレ/リファレンス実装

という役割の違いです。

正直、LangChain が「殺される」とかいう話では全くなくて、

むしろ LangChain 側が autoresearch 的な「研究ワークフローテンプレ」を公式で用意すべき、くらいの話だと思います。

-2. 研究支援 SaaS への圧力

個人的に一番インパクトが大きいのは、

Elicit や Consensus のような文献調査・論文ドラフトSaaSへの圧力です。

- 文献検索 → 要約 → 関連研究マップ → 簡易ドラフト

みたいな機能を月額で売っているサービスは、

- autoresearch + ローカル LLM + ちょっとしたカスタム

で「研究室内だけで似たことができる」世界と、

これからガチで戦うことになります。

もちろん、SaaS には

- UX

- チームコラボ

- 高品質クラウドモデルの安定利用

などの優位もあるので、いきなり置き換わる話ではありませんが、

「API 課金を気にせず、ゼロコストで自律研究を回せる」

というローカル LLM 事例が出てきたことで、

「自分たちで組んだ方が良くない?」と真面目に考える研究室・R&D 部門が増えるのはほぼ確実だと思います。

ローカル LLM × 自律エージェントが意味するもの

Qiita/Zenn で報告されている通り、autoresearch をローカル LLM に差し替えて動かしている事例もすでに出てきています。

-1. 「ゼロドル研究エージェント」はどこまで本当か

構成としてはシンプルで、

- OpenAI クライアントを

- Ollama や llama.cpp ベースの HTTP エンドポイントに置き換え

- OpenAI 互換 API で chat.completions をそのまま叩く

というパターンです。

コンセプトとしての「$0 の自律 AI 研究」は非常に魅力的で、

- 個人研究者

- GPU を1〜2枚だけ持っているインディー開発者

- 予算の厳しい大学研究室

には間違いなく刺さります。

が、正直に言うと、「ゼロコスト」にはかなり注意書きが必要だとも感じています。

- 7B〜13B クラスのローカルモデルで

- 長期的な一貫性

- コード生成 + 論文構成 + 文献理解

を全部やらせるのはかなりキツい - 70B クラスをちゃんと回そうとすると、個人 GPU では現実的でない

つまり、

「動くことは動くが、“研究者の右腕レベル”の品質を出すには、結局それなりのハード or クラウドコストが必要」

というのが現実に近いと思います。

ただ、それでも

- 「API 課金を気にせず、タスク設計とワークフローを実験できる」

という意味での価値は大きいです。

自分の環境でガンガン試行錯誤できるというのは、開発者にとって相当な自由度です。

自律研究エージェントの「落とし穴」はどこにあるか

良い面ばかり語っても仕方ないので、懸念もちゃんと言語化しておきます。

-1. 「自律研究者」という言い方には違和感がある

コミュニティでも議論されていますが、

正直、「自律研究者」というフレーズにはちょっとモヤっとしています。

多くの人が指摘している通り、現状の autoresearch がやっているのは、

- うまく分解された研究タスクの

- 実験実行と評価と反復

であって、「仮説の本質的な創造」や「批判的検証」を丸ごと肩代わりしているわけではありません。

言い方を変えると、

かなり賢い「自動実験オーケストレーター」であって、

まだ「フルスタックな研究者」には程遠い

というのが妥当な評価だと思います。

ここを過大評価すると、

- 「ボタン一発で NeurIPS 論文が生えてくる魔法ツール」

みたいな勘違いが広まり、

現実とのギャップでがっかりする未来が見えます。

-2. ブラックボックス化とデバッグのつらさ

自律エージェント全般にいえる話ですが、

- どのステップで誤った前提を導入したか

- どのツール呼び出しが失敗したか

- どこから探索がループし始めたか

を後から追うのはかなりしんどいです。

autoresearch のような長期タスクになると、

- 一晩回してみたら、

- 初期の前提が微妙にズレていて、

- その上で100個の実験が積み上がっていた

みたいなケースも普通に起こり得ます。

実用レベルで使うには、

- ステップごとのログ

- 実験設定と結果のトラッキング

- Diffの可視化

- 「ここで人間がレビューする」チェックポイント

といったMLOps 的な仕組みを、かなり真面目に設計する必要があります。

正直、「放っておけば勝手に賢くなっておいてくれる」ような代物では全くありません。

-3. 研究倫理と品質管理の線引き

もう一つ気になるのは、「どこまでをAIに任せるか」というラインです。

- 実験計画の妥当性

- 統計的検証の正しさ

- 引用文献の正確さ(ハルシネーション問題)

など、人間のレビューなしで通すには危険なポイントがいくつもあります。

組織で導入するなら、

- autoresearch が出したドラフトはあくまで叩き台

- 最終判断と責任は必ず人間研究者

というルールを明確にしておかないと、

後で炎上要素を抱えることになるのは目に見えています。

じゃあ、どんな人・組織が今触るべきか

ここまで見てきて、「で、これ実際どうなのよ?」という話を整理します。

-1. 今すぐ試したほうがいい人・組織

- GPU を持っている

- AI/ML 研究者

- データサイエンティスト

- 趣味で LLM をいじっているハッカー

- 研究室・R&D 部門で

- 関連研究調査

- 実験ログの整理

- 報告書・ドラフト作成

などの作業に日々追われているチーム

こういう人たちは、

- autoresearch のコードを一通り読んで、

- 自分のドメイン用に

- 文献ソース

- 実験テンプレ

- 論文テンプレ(NeurIPS / ICML / 自社レポート形式など)

を差し替えるだけで、

かなり実用的な「半自動研究パイプライン」が作れる可能性があります。

特に個人的に面白いと感じたのは、

- 大学院生が週末に GPU を1枚解放して autoresearch を回し、

- 月曜までに「そこそこ筋の良い改善案リスト」が出ている

みたいな「24時間実験係ボット」としての使い方です。

これは普通にありだと思います。

-2. 逆に、まだ距離を置いたほうがいいケース

- 明確な評価指標(val_bpb 的なもの)が定義できないビジネスプロセス

- セキュリティ・コンプライアンスが厳しく、実験ログの扱いに厳重な管理が必要な環境

- 「とりあえず LLM 触ってみたい」レベルのライトな利用

このあたりは、正直まだ autoresearch を使うフェーズではないと思います。

autoresearch は、

「自動化したいループ」と「測定可能な成功指標」がハッキリしている人向けのツール

であって、「なんかAIで便利にしてほしい」を叶える魔法の箱ではありません。

結論:プロダクション投入するか?正直まだ“研究インフラの種”として使うのが現実的

最後に、完全に個人的な結論を書きます。

- プロダクション運用(本番系システムに直結)に使うか?

- 正直、まだ様子見です。

-

ログ管理 / 権限 / リソース制限 / 監査 などを考えると、そのまま本番に入れるには設計が足りない。

-

研究開発インフラの「実験的な土台」として使うか?

- これは「今から仕込んでおく価値が高い」と感じています。

- 特に、

- 自分たちの研究ワークフローをどう分解するか

- どのループなら自律エージェントに任せられるか

- どこに人間レビューを挟むか

を設計するための思考ツール/プロトタイプとしては最適です。

長期的には、

「人間が“Do”する時間を減らし、“Review & Design”に集中するための研究インフラ」

をどう作るか、という勝負になっていくはずで、

autoresearch はその未来を少し具体的な形で見せてくれた最初の実装、という位置づけだと思います。

なので、個人的なおすすめはこうです。

- すぐ本番に入れようとしない

- まずは「自分の研究室/チーム版 autoresearch」を fork して、

- ワークフロー分解

- ローカル LLM の実験

- ログ・レビューの設計

を「遊び半分・本気半分」で試してみる

その過程で、

- どのループなら完全自律で回せるか

- どのループは人間の判断が必要か

がだんだん見えてきます。

正直、そこまでやったチームと、

「ChatGPT にちょっと長めのプロンプトを投げてるだけ」のチームでは、

数年後に相当な差がつくと感じています。

autoresearch は、「自律エージェントをどう自分の仕事に埋め込むか?」を真面目に考え始めるための、かなり良質な起爆剤です。

触るかどうか迷っているなら、コードを読んで、自分のワークフローに当てはめてみるところから始めてみる価値は十分にあります。

FAQ:autoresearch導入前によくある質問

- Q. autoresearchはAutoGPT系と何が違う?

A. 汎用『何でも屋』ではなく、研究タスク(文献探索→実験→結果整理→ドラフト)に必要なステップを先に決め、そこへLLMを差し込む“ワークフローテンプレ”に寄っています。 - Q. ローカルLLMで回せば本当に無料(ゼロ円)?

A. API課金は抑えられても、GPU/電力/時間、そして品質の確認コストは残ります。『無料で無限に回せる』より『試行回数を増やせる』くらいの捉え方が安全です。 - Q. 人間レビューはどこに挟むべき?

A. 引用・主張の整合性、実験条件の妥当性、結果の解釈(都合の良い結論への誘導)あたりは、チェックポイントを明示的に置くのが現実的です。 - Q. まず試すなら何から始める?

A. コードを一通り読んだ上で、最小のテーマで『文献探索→小実験→要約』の往復を作り、ログの粒度と失敗時のデバッグ導線を先に固めるのが近道です。

FAQ(導入判断でよくある質問)

Q. まず何から試すのが安全?

PoCで小さく当てて、コスト上限・権限・データ取り扱いを先に固めるのが安全です。

Q. 一番のリスクは?

ロックイン(移行コスト)と、運用/ガバナンスが仕様に追いつかないことです。

Q. どんなチーム/用途に向く?

導入スピード重視のPoC/社内利用や、要件が比較的軽い領域から始めるのが向きます。

コメント