結論(忙しい方向け)

- BitNetは「1bit前提で学習する」量子化系Transformer:後付けの4bit量子化とは思想が違い、メモリ/電力コストの伸びしろが大きい。

- ただし現状は研究〜先行実装フェーズ:本番で「すぐ置き換え」は危険。再現性・周辺ツール・ハード最適化がボトルネックになりやすい。

- 取るべき行動はPoC設計:自社ワークロードで「コスト/遅延/品質」を計測し、採用ライン(どこまで許容するか)を決める。

想定読者:LLM推論コストに悩む開発者/オンデバイス推論を検討するチーム/モデル運用の技術選定担当

関連記事:

NVIDIAの260億ドル投資(コスト/ロックインの見方)/

プロンプト圧縮(トークン/コスト設計)

「GPUメモリが足りない」「推論コストがインフラ費を食い潰す」──

LLM触っていて、こういうため息をついたことはありませんか?

- 4bit量子化しても、まだVRAMがパンパン

- それでも精度は落としたくない

- モバイルやエッジに“それなりにちゃんとしたLLM”を載せたいけど、現実味がない

そういう人にとって、「BitNet 1‑bit LLM」は、正直かなりヤバいワードです。

でも同時に、「これ、本当に信じていいの?」という懐疑もセットで付いてきます。

この記事はニュースをなぞる解説ではなく、

技術的な中身とコミュニティの温度感を踏まえた「1人のエンジニアとしての意見」です。

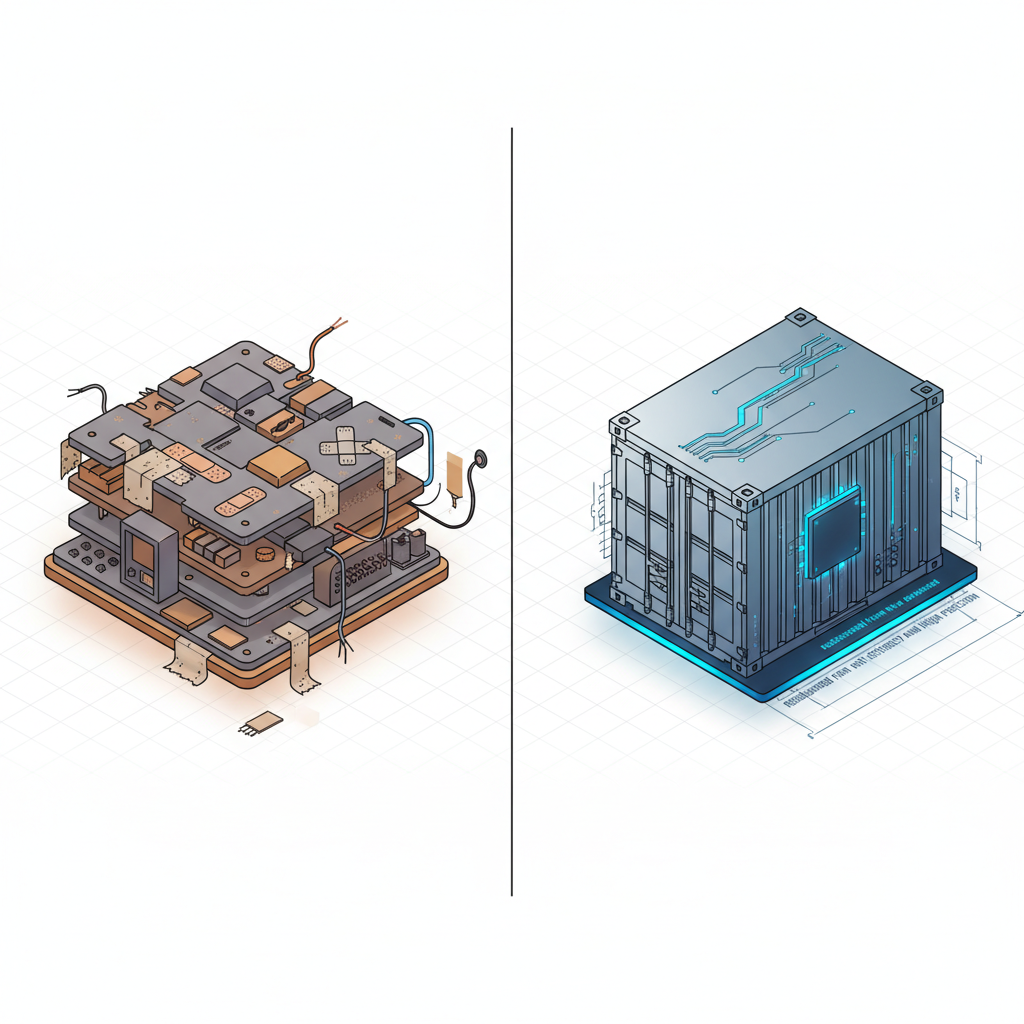

一言で言うと「FP16前提の世界をひっくり返す Docker っぽいもの」

BitNet を一言で雑にたとえると、

「FP16/GPU 前提で組んできた LLM インフラに、

“いや、そもそも 1ビット前提で設計し直したら話変わりません?”と殴り込んできた Docker 初期のコンテナ革命」

に近いと感じています。

- これまで:

- FP16/BF16 で学習 → 推論だけ 8bit/4bit に落とす「事後量子化」が前提

- BitNet 系:

- 最初から {-1, 0, +1} の 1.58bit(三値)重みで学習する前提でアーキテクチャと訓練レシピを組む

つまり、「LLM=でかい FP16 行列積をどう高速に回すか」という世界観そのものに、

「そもそもその前提いらなくない?」とケンカを売りに来ている。

- パラメータはほぼ 1bit(正確には log₂3 ≒ 1.58bit)

- 行列積は「浮動小数点の掛け算+足し算」ではなく、

bit 演算+加算ベースに置き換え可能 - メモリは理論上 FP16 の 1/10〜1/16 オーダーまで削れる

数字だけ見ると「革命」の二文字が踊ります。

ただし、ここまで読むときっとこう思うはずです。

「いやいや、1ビットなんて精度ボロボロでしょ?」

この「直感」と、論文・実験結果、コミュニティの反応は綺麗にぶつかっています。

BitNet の“何が本当に新しいのか”を雑に整理する

技術的な話はすでにZennの記事や論文が丁寧に解説しているので、

ここでは「エンジニアとして押さえておきたいポイント」に絞ります。

-1. “事後量子化”ではなく“1ビット前提で設計”

ここが一番のポイントです。

- 従来:

- FP16/BF16 でトレーニング

- → 学習後に 8bit/4bit に量子化(GPTQ, AWQ など)

- → 元モデルの精度をどこまで壊さずに落とせるかが勝負

- BitNet:

- 最初から「1.58bit(三値)重みで学習する」前提

- Forward はほぼ 1bit 重みで計算、勾配計算などは高精度

- 量子化の非連続性は Straight-Through Estimator で“見なかったことにする”

つまり、「高精度モデル → 低ビット近似」ではなく、

「低ビットで動くように最初から育てる」発想です。

これは、8/4bit 量子化とのギャップです。

- 4bit は「FP16 モデルをなるべく壊さないように縮める」世界

- 1bit BitNet は「1bit でそこそこ賢い奴を最初から作る」世界

アーキテクチャ・最適化・正則化・学習スケジュールまで、全部やり直しになります。

-2. メモリと計算コストのスケールが“別世界”

理論上の話をあえて単純化すると:

- メモリ:

- FP16: 16 bit / パラメータ

- BitNet: 1.58 bit / パラメータ(実装オーバーヘッド除き)

- ⇒ ざっくり 10倍以上のパラメータ数を、同じメモリで扱える潜在力

- 計算:

- FP系: FMA(浮動小数点の乗算+加算)がメイン

- BitNet: ほぼ「符号付き加減算」+ XNOR/Popcount

- ⇒ 専用ハードなら 一桁~数桁レベルのエネルギー効率改善が現実的

実際、Microsoft 発の BitNet b1.58 2B4T のデータを見ると:

- 2Bクラスで 非埋め込みメモリ ~0.4GB

- CPU 推論レイテンシ ~29ms

- 同クラスのフル精度〜低ビットモデルと比べても、

平均性能はトップクラス+圧倒的な省メモリ・低エネルギー(論文ベース)

正直、この数字だけ見れば「夢ありすぎだろ」と思います。

既存の 4bit LLM と比べて“何がヤバいのか”

4bit 量子化 LLM(GPTQ/AWQ LLaMA 系)と比べると、絵がはっきりします。

-1. 設計思想:パッチ vs. 再設計

- 4bit:

- 高精度モデルにあとからパッチを当てる発想

- メリット:既存の学習レシピ・エコシステムがほぼそのまま使える

- デメリット:

- ビット数をさらに削るには限界

- 精度は常に「元モデル以下」が上限

- 1bit BitNet:

- “低ビット前提”で Transformer を作り直す

- メリット:

- 表現力・安定性を「低ビットの制約込み」で最適化できる

- 理屈の上では、FP16 と同等 or それ以上の精度も狙える

- デメリット:

- トレーニングレシピも実装も全部新規

- 「とりあえず既存モデルを変換」がほぼ無理

ここが Docker とのアナロジーに近い部分です。

- Docker 以前:

- 既存のサーバーを手で構成管理する世界

- Docker 以後:

- アプリを「コンテナ」という前提で設計・パッケージする世界

BitNet 的な 1bit LLM も同じで、

「LLMを FP16 前提で設計するか、1bit 前提で設計するかで、

そもそものインフラと制約が変わる」

というパラダイムシフトを要求しています。

-2. 実用フェーズ vs. 研究フェーズ

現状の立ち位置はこう見ています。

- 4bit LLM:

- OSS実装、ツールチェーン、チュートリアルが豊富

- Hugging Face / GGUF / llama.cpp 系で普通に使える

- 「すでに実用フェーズの技術」

- 1bit BitNet:

- 研究~先行実装フェーズ

- PyTorch/FW は専用フォーク+カスタムレイヤーが必要

- 真価を出すには bitnet.cpp のような専用 C++ 実装がほぼ必須

- 「成功すればゲームチェンジャーだが、まだ R&D 技術」

正直、「今からプロダクションで 4bit を飛ばして 1bit に突っ込む」のは、

かなり攻めた選択だと思います。

コミュニティの“期待を込めた懐疑”はわりと妥当

日本語圏のコミュニティの反応を眺めていて、一番しっくりきたまとめはこれです。

「技術的にはめちゃくちゃ面白い。

でも“これで LLM の全てが変わる”と言い切るには、まだ材料が足りない」

具体的にはこんな懸念が見えます。

- 「三値(1.58bit)とか 1bit で、本当に汎用 LLM レベルの精度が出るのか?」

- 「論文はきれいだが、サードパーティの再現で同じ精度はまだ出ていない」

- 「精度が“逆転”したと言っても、タスクや条件がかなり限定的なのでは?」

情報処理学会の記事でも、

- CIFAR-10 など小さめデータセットでは「量子化した方が精度が良い」ことは昔から報告がある

- でも、LLMクラスの難しいタスクで、三値化しても精度逆転する事例はほぼない

- b1.58 論文の 3B での“逆転現象”は確かに面白いが、7B/30B で同じことが起こるかはまだ誰も知らない

という冷静な整理がなされています。

個人的にも、ここはかなり同意です。

- 「1bit だからといって精度が落ちるとは限らない」

→ これは過去研究的にもそこそこ筋がよい - 「だからといって、どのサイズ・どのタスクでも FP16 を超える」

→ ここまで言うのは、さすがにまだ早い

実際に触ってみた人たちの声:小さいモデルでも“妙に”出来がいい

面白いのは、実装を試した人たちが口を揃えてこう言っているところです。

「このサイズ(~100M〜200M)で、ここまで“それっぽく”書けるのは正直驚き」

ある Note 記事では、BitNet の野良実装で 110M パラメータ程度のモデルを学習し、

- モデルサイズは約 200MB

- 数時間の学習で loss が 4.9 → 2.78 程度まで下がる

- 生成された文は内容は支離滅裂だが、文法的にはかなり自然

- 「このサイズ帯の通常の Transformer だと、もっと崩壊した文章になりがち」

という所感が書かれています。

もちろん、これだけで

- 「BitNet は小さいモデルでも Transformer より優れている」

と言うのは乱暴です。

実装の質、データ、チューニング、いろいろ差がありすぎます。

ただ、「1bit だからどうせダメでしょ」という先入観は、

この手の実験結果を見ると揺さぶられます。

懸念点:1bit LLM は“魔法の弾丸”ではない

技術的に見て、BitNet にはクリティカルな懸念がいくつもあります。

-1. 精度と安定性のボトルネック

- 重みがほぼ {-1, 0, 1} だけというのは、

表現力的にはかなりギリギリの世界 - その不足を補うために:

- 一部層(入出力、LayerNorm など)は高精度をキープ

- スケーリングパラメータを導入

- 活性は 8bit で量子化

- 学習時は STE で勾配を「素通し」するため、

理論的には正確でない勾配で巨大モデルを回すことになる

正直、この組み合わせで 70B クラスまで本当に安定して学習できるのか、

私自身はまだ半信半疑です。

「3B まではなんとかなる」

「でも 30B 〜 70B は別ゲーでした」

という展開も全然あり得ます。

-2. ハードウェアとエコシステムが追いついていない

BitNet の真価は「1bit 前提のハード+カーネル」でこそ出ます。

- 今の GPU(CUDA, cuBLAS)は:

- FP16/BF16, INT8/FP8 行列積には最適化されている

- 1bit 行列積(XNOR/Popcount)にはほとんど最適化されていない

- 結果として:

- PyTorch + Transformers で BitNet を回しても、

「FP16 より少し遅い or 同程度」というオチになりがち - メモリ削減の旨味はあるが、「爆速」というほどではない

Microsoft の bitnet.cpp のような専用 C++ 実装では、

- x86 / ARM CPU で数倍の速度・大幅な省エネ

- 将来的に NPU/GPU サポートも予定

など、かなり良い数字が出ています。

が、これは「専用実装を頑張った結果」であって、

pip install transformers

AutoModelForCausalLM.from_pretrained("bitnet-…")

で魔法のように速くなる世界は、まだ来ていません。

-3. ベンダーロックインの危うさ

もし今後、

- あるチップベンダーが「1bit LLM 専用アクセラレータ+SDK+独自フォーマット」をセットで出す

- そしてそれが実際にめちゃくちゃ速い

という展開になると、かなり強烈なハードウェアロックインが発生します。

- モデルはそのベンダーのハードでしか真価を発揮しない

- 推論フレームワーク・フォーマット・ツールチェーンも専用

- 乗り換えコストが一気に跳ね上がる

これは「いまの GPU ロックイン」の再演ですが、

低コスト・エッジ側まで巻き込んだより広範なロックインになる可能性があります。

正直、ここはかなり警戒しています。

開発者として“どう構えるか”の現実的なライン

じゃあエンジニア目線で、BitNet 1bit LLM をどう扱うべきか。

-1. APIユーザ視点:「そのうち裏で勝手に使われる技術」

OpenAI / Anthropic / Google / Microsoft などの API を使うだけなら、

- BitNet がバックエンドに入ろうが

- FP8/INT4 の超最適化モデルになろうが

インターフェースはほぼ変わらないはずです。

- エンドユーザが感じるのは:

- 「いつの間にか価格が下がった」

- 「レイテンシが速くなった」

- 「無料枠が増えた」

- その裏側の“コストカーブを折り曲げている技術”として、

BitNet が使われる可能性はある

API 利用者としては、「へえ、そういうのが裏で動いてるんだ」くらいで十分です。

直接 BitNet を触る必然性は、あまりありません。

-2. 自前でモデルを持つ側:「ウォッチ対象としては“本命級”」

自社で LLM を自前運用している/したい人にとっては、話が変わります。

- 対象になりやすいケース:

- GPU コストがサービス原価のボトルネックになっている SaaS

- 大規模オンプレ推論(企業内 LLM, プライベートクラウド)

- モバイル・エッジへのオンデバイス LLM 展開

こういう文脈では、

- いきなり本番投入はないにしても、R&D テーマとしてかなり優先度が高い

- 特に:

- bitnet.cpp などの OSS 実装

- Hugging Face での正式サポート状況

- 3B を超えたスケールの再現実験・第三者ベンチ

は、ウォッチしておいた方がいいと感じます。

-3. 研究好き・個人開発者:「今触るとおいしい題材」

コミュニティの空気を見ていると、

- 「cpp 製の 1bit(三値)LLM 用推論フレームワークを試してみた」

- 「GPT の生成パラメータ(temperature, top_k, top_p)が 1bit モデルでどう振る舞うか検証した」

みたいな、手触り重視の実験がじわじわ増えています。

ぶっちゃけ、これはかなり面白い遊び場です。

- LLM の内部表現がどこまで潰せるか

- 低ビットゆえのノイズを、生成パラメータでどこまでコントロールできるか

- 110M〜1B クラスの小さな 1bit モデルを、自前データでファインチューニングするとどうなるか

この辺りは、いま触っておくとかなり“美味しいポジション”だと思います。

履歴書にもブログネタにも、カンファレンス発表にもなりやすい領域です。

結論:プロダクションで使うか?正直まだ様子見。ただし“本気でウォッチすべき技術”

最後に、個人的な結論をはっきり書いておきます。

- プロダクションに今すぐ入れるか?

→ 正直、まだ様子見です。 - でも、“どうでもいいトレンド”か?

→ まったく逆で、「LLM コスト構造を根本から変えうる本命候補」だと思っています。

理由はシンプルで、

- 「高精度モデルをどう縮めるか」という発想から、

- 「最初から低ビット前提でモデルを設計する」という発想への転換は、

- Docker が「VM でアプリをどう動かすか」から「コンテナとしてアプリをパッケージする」へ変えたのと同じくらい

インフラの前提をひっくり返し得るからです。

とはいえ現時点では、

- 精度のスケーリング則(3B 以上、7B/30B で本当に FP16 と戦えるのか)

- 専用ハード・カーネル抜きの“普通の GPU/CPU 環境”で、どこまで恩恵があるのか

- エコシステム(Hugging Face / ONNX / TensorRT / llama.cpp 系)がどの程度追従するのか

このあたりが全く固まっていません。

ですので、現実的なポジション取りとしては:

- 今すぐの魔法の弾丸ではなく、1〜3年スパンで LLM のコストカーブを折り曲げる“ゲームチェンジャー候補”

- API ユーザとしては「そのうち裏で使われて、価格やレイテンシが静かに良くなる技術」

- 自前インフラを持つ側・研究者・個人開発者にとっては「今から実験しておく価値の高いテーマ」

このくらいが妥当だろう、と考えています。

少なくとも一つだけは、はっきり言えます。

「1bit LLM は、話題倒れで終わるには惜しすぎる技術」

だからこそ、過度に持ち上げすぎず、

でも「なんとなく流行りワードだからスルー」はもったいない。

冷静に数字と再現実験を追いかけつつ、

自分たちのプロダクトとワークロードにとって“刺さる瞬間”が来るかどうか、

一緒に見極めていくタイミングだと思います。

評価・導入チェックリスト(PoC設計)

- 対象ワークロード:生成(チャット)/分類/要約/オンデバイスなど、まず1つに絞る

- 品質指標:人手評価・タスク成功率・回帰テスト(既存ケースの再現)を用意する

- コスト/性能:メモリ使用量、レイテンシ、スループット、(可能なら)消費電力を同条件で比較する

- 実装前提:利用ランタイム(CPU/GPU/NPU)と、専用カーネル/実装が必要かを確認する

- 運用:モデル更新・監視・フォールバック(通常モデルに戻す手段)を設計してから試す

- ロックイン:特定ベンダSDK/フォーマット依存が増えないか、移行コストを先に見積もる

よくある質問(FAQ)

Q. 「1-bit」って本当に1bitですか?

厳密には「三値(-1/0/+1)」のような表現(1.58bit相当)を指す文脈が多いです。記事中でもその前提で説明しています。

Q. 既存の4bit量子化と何が違う?

4bitは高精度モデルを後から“縮める”発想なのに対し、BitNetは低ビット前提で学習レシピ/アーキテクチャを組み直す発想です。伸びしろは大きい一方で、エコシステムが成熟していない点が課題になりやすいです。

Q. すぐプロダクションに入れられますか?

現状は「PoCで数字を取る」段階が安全です。再現性・専用実装の有無・周辺ツール(推論/監視/デプロイ)が揃っていないと、性能は出ても運用で詰まります。

Q. どこから試すのが一番現実的?

まずは「推論コストが支配的で、品質劣化に許容幅がある」タスク(要約・分類・社内ツールなど)から、比較実験の設計を作るのが現実的です。

コメント