ブラウザ自動化スクリプトが、UI変更一つで全部死んだこと、ありませんか?

RPAロボットのフローを、仕様変更のたびに夜中まで直した経験、ありませんか?

正直、ここ数年の「AIで自動化できます!」系の話は、現場のエンジニアからすると「どうせデモだけだろう」と思って見ていた人も多いはずです。

ところが、先週の「AI三連発」は、さすがに無視しにくいレベルでした。

- 粒子物理の実験をAIがフル自動で回した

- 未解決だった数学の問題にAIが食い込み始めた

- そして、OSごとPCを操作する「AIデスクトップ作業員」が現実味を帯びてきた

その裏で使われているのが、Anthropicの Claude 4.6 Sonnet。

ぶっちゃけ、「また新モデル出たのね」くらいに思っていたのですが、この三つのニュースを並べて見ると、少し景色が変わって見えます。

結論(忙しい人向け)

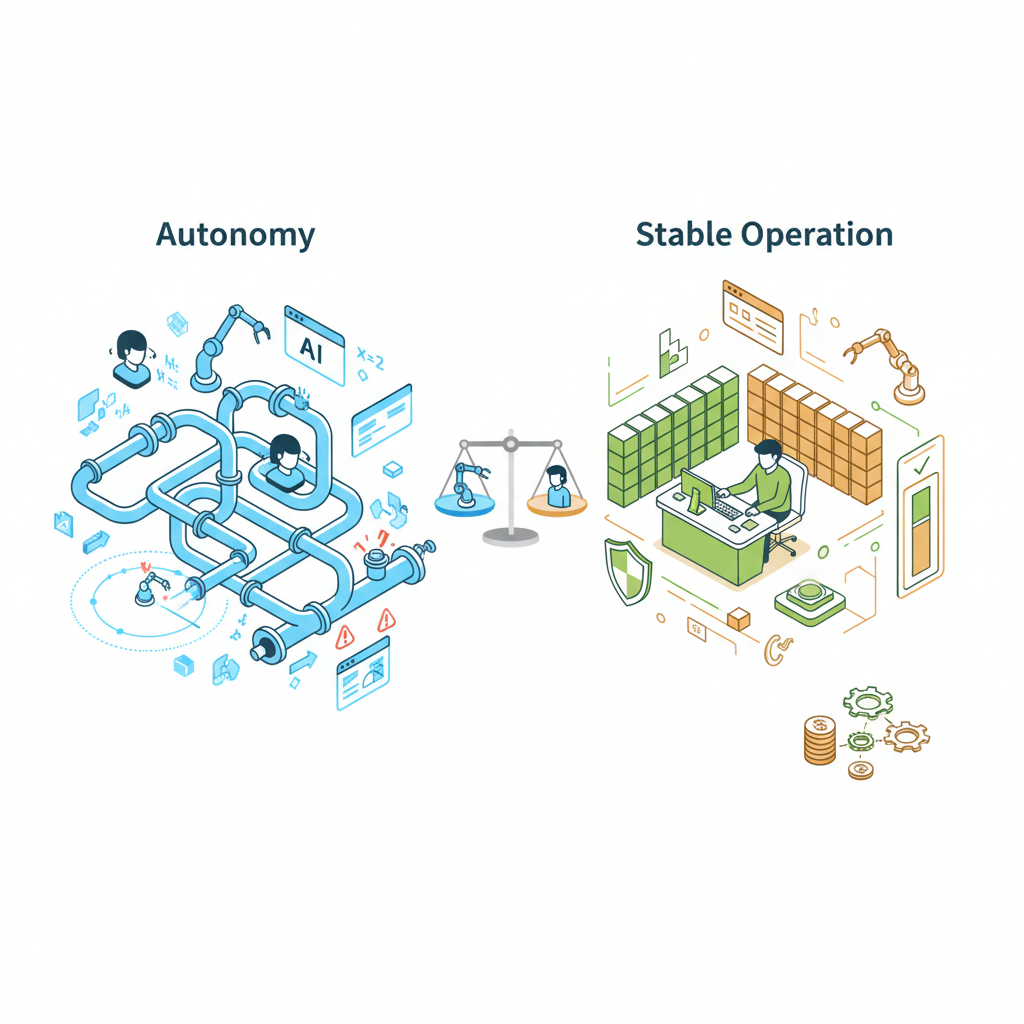

- 今すぐ全面自律ではなく「二段階導入」が現実的(まずはオペレーター補助→次に低リスク領域から限定自律)。

- PC操作エージェントはRPA/Seleniumの“次”になり得るが、SLO運用にはログ・例外処理・責任分界の設計が必須。

- ロックインはモデルより「オーケストレーション」に出る。抽象化レイヤと行動ログの標準化を先に作ると安全。

想定読者:業務自動化(RPA)担当/SRE・プラットフォーム/PM/エージェント基盤を作る開発者

関連記事: AI業界週次まとめ(要点・導入判断) / AIエージェントのゼロトラスト運用(Docker×NanoClaw)

- 一言で言うと、「cronジョブからKubernetesへの移行」が今度は人間の仕事に来た

- Claude 4.6 Sonnet は何が「ちょうどいい」のか

- 「AIだけで粒子物理実験を回した」何がそんなにヤバいのか

- 数学への進出は「AutoMLの数学版」が始まったくらいに見ておくのが現実的

- 「PCを丸ごと操作するエージェント」は、RPAとSeleniumにとっての Kubernetes になるか?

- Claude 4.6 Sonnet vs OpenAI の Computer Use:どちらが「頭脳」として使いやすいか

- ただし、懸念点もあります:自律 ≠ 安定運用

- では、今プロダクションで使うべきか?正直、用途次第で「二段階導入」が現実的

- まとめ:今回の三連発は「AIが何をできるか」より「開発者に何を求めてくるか」のシグナル

- FAQ(導入判断)

- 関連記事

一言で言うと、「cronジョブからKubernetesへの移行」が今度は人間の仕事に来た

一言で言うと、今回起きているのは、

「人間の仕事が、シェルスクリプト時代から Kubernetes 時代に入り始めた」

という話だと感じています。

- これまでは「一つひとつの操作」を自分で書く世界(RPA、Selenium、スクリプト)

- これからは「最終状態だけ指定して、あとはAIに任せる」世界(目標ベースのエージェント)

Docker → Kubernetes で起きたことを思い出してください。

- 以前:

cron+ シェルスクリプトで、プロセスの起動・停止・リカバリを全部自分で書いていた - 以後:Kubernetes に「このサービスを常時3レプリカ動かして」と宣言すると、落ちても勝手に復旧してくれる

今回の「粒子物理」「数学」「PC操作」の三つは、それを知的作業のレイヤーでやり始めた例だと見ています。

- 粒子物理:実験設計〜実行〜結果評価のループを「自動スケジューラ」に乗せた

- 数学:定理の証明探索や新しい構造の提案を「自動サーチャ」に任せ始めた

- PC操作:クリック手順ではなく「目的」を指定して、あとは画面を見たAIが判断する

そして Claude 4.6 Sonnet は、その「スケジューラ/プランナー役」として、実用レベルに乗ってきた、という位置づけだと思います。

Claude 4.6 Sonnet は何が「ちょうどいい」のか

モデル単体として見ると、4.6 Sonnet は Anthropic の中では「中核・汎用モデル」です。

- Haiku:軽くて速い

- Opus:重くて高性能

- Sonnet:その中間で、「エージェントの頭脳」にちょうどいい

今回のニュース群を見る限り、特に効いているのはこの3点だと感じます。

- ツール呼び出し前提で設計された推論スタイル

- 長いコンテキストをまたいだ安定した推論(論文やコード、ログをまとめて扱える)

- 「計画→実行→モニタリング→再計画」のループを自力で回せるだけの一貫性

数年前のモデルに、いきなり粒子物理実験まるごと任せる気には、正直なれませんでした。

でも今回、研究者が「実験の制御ループそのもの」をAIに渡し始めた、というのは、

「少なくともこのクラスのモデルなら、エージェントの“脳”として信用してもいいかもしれない」

という判断を、現場がし始めたサインだと思います。

「AIだけで粒子物理実験を回した」何がそんなにヤバいのか

粒子物理の現場って、正直かなり保守的です。

ビームタイムは高価で、装置も壊したら洒落にならない。普通は「ブラックボックスに全部任せる」なんて絶対にやりたがりません。

それでも今回、

- ビームや加速器のパラメータ設定

- 検出器のキャリブレーション

- 実験実行

- データ評価と次のパラメータ決定

といったループを、人間の逐一のオペレーションなしで回すところまできた。

もちろん、安全インターロックや境界条件は人間が設定していますが、

「実験オペレーション」を「AIにとってのAPI」として整理し、LLMベースのエージェントに丸ごと渡した

という構造自体が重要です。

これは、インフラ界隈でいうところの、

- ただの

sshスクリプト → Terraform + Kubernetes で「宣言的な状態管理」に移行した

のと同じパラダイムシフトが、

今度は物理実験という“リアル世界のスタック”に降りてきた、という意味を持ちます。

開発者視点で言うと:

- これからのラボ・工場・IoT系ソフトは、「人間が操作するUI」だけでなく

- 「AIエージェントが叩くための、安全で型付きのAPI」も最初から設計する必要が出てきます

「AIに任せる/任せない」の議論より前に、AIが安全に叩けるAPI設計が、かなり本質的な仕事になってくるだろうと思います。

数学への進出は「AutoMLの数学版」が始まったくらいに見ておくのが現実的

「AIが未解決問題を解いた」という話は、毎回バズり方が極端です。

- ホ hype側:「もう数学者いらないでは?」

- 懐疑側:「どうせ制約付きのサブ問題でしょ?」

真ん中あたりで冷静に見ると、いま起きているのは、

「研究レベルの問題でも、LLM+定理証明系の“AutoML 的な探索”が、局所的には人間と勝負できるようになってきた」

くらいの話だと感じています。

技術的なポイントは:

- LLM が「証明の全体戦略」を自然言語レベルで提案

- それを Lean や Coq などの形式言語に落とし込む

- 自動証明器が形式的にチェックし、エラーを LLM にフィードバックして再探索

という「人力だとだるすぎる探索」を大量に回せるようになったことです。

ここで開発者として効いてくるのは:

- 「証明」だけでなく、「設計探索全般」で同じパターンが使えるようになってきたこと

(アルゴリズム設計、最適化問題、システム構成探索など)

つまり、

- 仕様(制約)を形式的に書ける人間

- その上で LLM に大量の探索をさせ、結果を評価できる人間

が、今後かなり強くなります。

逆に言うと、「なんとなくの勘で設計する」仕事は、AI に食われやすいとも言えます。

ぶっちゃけ、ここにはかなり大きな「職能の再定義」が含まれていると感じています。

「PCを丸ごと操作するエージェント」は、RPAとSeleniumにとっての Kubernetes になるか?

一番わかりやすく、かつ現場インパクトが大きいのは、やはり 「コンピュータのフル操作」だと思います。

具体的には:

- 画面キャプチャを見てボタンの位置やラベルを理解する

- マウスクリック、キーボード入力、スクロール、ウィンドウ切替を自分で決める

- ブラウザでログイン → 検索 → ダウンロード → Excel or Python で整形 → PowerPoint 作成 → メール送信

みたいな、「人間の総務・営業アシスタントがやりそうな仕事」を、

「ゴールだけ口頭で伝えて任せる」ことが、デモレベルではもう普通にできています。

ここで、OpenAI の「Computer Use」との比較が気になります。

Claude 4.6 Sonnet vs OpenAI の Computer Use:どちらが「頭脳」として使いやすいか

今のところの整理を、エンジニア目線でざっくりまとめると:

- OpenAI 側

- 「Computer Use」という形で、デスクトップ操作まで含めたフルスタック製品を先に打ち出している

- o3 や GPT‑4.x 系と組み合わせて、「数学・推論・PC操作」の全部入りパッケージ

-

強み:ターンキーな体験、「全部おまかせ」がしやすい

-

Anthropic / Claude 4.6 Sonnet 側

- 単体モデルとしての「プランナー/頭脳」がかなり扱いやすい

- 長文・長コンテキスト、慎重な推論、ツール呼び出しの安定性という意味で、ミドルウェアっぽく組み込みたくなる性格

- 強み:自前でエージェントフレームワークを組みたい人にとっての「いい心臓部」

私自身の開発者としての感覚だと:

- 「自社のエージェント基盤をちゃんと育てたい」なら、Claude 4.6 Sonnet はかなり良い選択肢

- 「まずは動くものをスピーディーに作って経営層に見せたい」なら、OpenAI の Computer Use のほうが早いかもしれない

という立ち位置です。

正直、これから数年は、

「クラウドプロバイダの完成度高い垂直統合スタック」 vs

「Claude 4.6 Sonnet をコアに、自社で細かく制御できるミドルウェアスタイル」

という構図で、開発者がどちらの賭けをするか、というフェーズに入る気がしています。

ただし、懸念点もあります:自律 ≠ 安定運用

ここまで書くと「いよいよ何でもAIに任せればいいのでは?」という空気になりがちですが、

ぶっちゃけ、現場で運用する側としてはかなり多くの懸念があります。

信頼性:粒子物理でも、PC操作でも、「たまにやらかす」問題

- 粒子物理:

安全インターロックがあっても、無駄なビームタイムを食う、意味の薄い実験を大量に回すリスクは普通にあります。 - 数学:

形式検証していない部分は、相変わらず「それっぽいけど間違っている」説明をしてくることがあります。 - PC操作:

UIがちょっと変わる、ネットワークが詰まる、ポップアップが変なタイミングで出ると、一気に動きが怪しくなります。

「自律して動ける」のと「SLOを守って安定オペレーションできる」は、まったく別問題です。

運用目線では、

- エージェントの行動ログをどう構造化して残すか

- どこまでを自動復旧とし、どこから人間のエスカレーションにするか

- 誰が最終責任を取るのか

といった設計が必要で、「AIがやってくれる」話からは一気に遠ざかります。

コスト:人件費の代わりに「トークン代+オーケストレーションコスト」が乗る

自律エージェントは、一回のタスクで

- 画面キャプチャ → 認識 → プランニング → 操作 → 再認識 …

を何十〜何百ステップも回します。

つまり、

- LLM APIコール

- ビジョンモデルAPIコール

- ログの保存と分析

が、馬鹿正直に積み上がります。

安定したUIで、毎回同じことをやるだけなら、ぶっちゃけ今まで通りの RPA やスクリプトの方が圧倒的に安いケースも多いです。

AIエージェントが真価を発揮するのは、

- UI変更が頻繁に起こる

- タスク内容が毎回微妙に違う

- 例外ケースへの対応が多い

という、「人間の柔軟さ」が必要だったところです。

そこを見極めないと、「人件費削減のつもりが、トークン代と運用コストで逆に高くついた」というオチになりかねません。

ベンダーロックイン:プロンプトではなく「オーケストレーションごとロックされる」

Computer Use 系のスタックは、各社とも

- 独自の「ツール呼び出しスキーマ」

- 独自の「行動トレース形式」

- 独自の「安全ガードレール」

を用意してきています。

モデルを変える、クラウドを変える、というレベルではなく、

「エージェント全体のオーケストレーションレイヤーごと抱え替え」

になる可能性がかなり高いです。

これを避けるには、開発側で意識的に:

- 自前の「ツール呼び出し抽象レイヤー」を作る

- エージェントの行動ログを、シンプルな JSON などに落とし、後から別モデルでリプレイできるようにする

- モデル依存のプロンプト/システム設計を最小化する

といった「地味だけど効く設計」をしておく必要があります。

では、今プロダクションで使うべきか?正直、用途次第で「二段階導入」が現実的

最後に、「じゃあ Claude 4.6 Sonnet とこの“三里塚みたいな週”をどう受け止めるべきか」という話です。

正直なところ、自律エージェントをいきなりプロダクションの中核業務に入れるのは、まだおすすめしません。

自分なら、こういう二段階導入にします。

フェーズ1:Claude 4.6 Sonnet を「賢いオペレーター補助」として入れる

- 粒子物理や実験系なら:

- 実験計画案の生成

- ログの要約・異常パターン検出

- 論文・既存データとのクロスリファレンス

- ビジネスオペレーションなら:

- 手順書の自動生成・更新

- ログを食わせて「どこでヒューマンエラーが起きやすいか」を洗い出す

- 数学・アルゴリズムなら:

- 設計案のブレスト、証明スケッチの作成

- 形式ツール(Lean, Coq など)とのインターフェースコードの生成

この段階では、意思決定は常に人間。

Claude 4.6 Sonnet は「長いコンテキストを読んで、整理して、提案する」役に徹させます。

フェーズ2:リスクの低い領域から「限定的な自律」を許す

- 開発・検証環境の PC 操作エージェント

- 本番系とは隔離されたサンドボックス環境での自動実験

- ドキュメント生成・整理など、誤動作しても安全側に倒れる業務

ここで初めて、

- 「ゴールベース」の指示

- 自律的な試行錯誤

- 成功・失敗ケースの分析とチューニング

を回し始めます。

このフェーズで、ログの取り方・ガードレールの張り方・組織内の責任分界が固まってきたら、徐々に本番業務への適用範囲を広げていく、というのが現実的なラインだと思います。

まとめ:今回の三連発は「AIが何をできるか」より「開発者に何を求めてくるか」のシグナル

- 粒子物理実験のフルAI運用

- 研究レベル数学問題への食い込み

- デスクトップ丸ごと操作するエージェント

これらは、「AIすごいね」という話以上に、

これからの開発者は、

「人間のためのUI」と同時に「AIエージェントのための API / ワークフロー / ガードレール」を設計する役割を求められる

というシグナルだと感じています。

Claude 4.6 Sonnet は、その世界で動く「ちょうどいい頭脳」として、かなり現実的な選択肢になってきました。

ただし、プロダクションにいきなり全委任するのではなく、

- まずは「長文・複雑タスクの整理役」として入れる

- そのうえで、限定的な領域から自律性を試す

くらいの段階的な導入が、エンジニア的には一番健全だと思います。

正直、この一週間で「AIはオートコンプリート」だと言い張るのは、そろそろ苦しくなってきました。

でも同時に、「じゃあ全部任せて寝てていいか」というと、そこまで行くには、まだ我々開発者の仕事が山ほど残っています。

その「山ほど残っている仕事」をどう設計し、どこまでAIに乗せるか——

2026年以降のエンジニアリングの面白さは、まさにここにあると感じています。

FAQ(導入判断)

Q. ClaudeのHaiku/Opus/Sonnetは何が違う?今回の文脈で選ぶなら?

A. 雑に言うと、Haiku=軽量、Opus=最高性能、Sonnet=実務で扱いやすい中核。エージェントの「頭脳」としては、コスト/安定性/長文耐性のバランスでSonnetが刺さりやすいです(高難度だけOpusに逃がす設計が現実的)。

Q. PC操作エージェントはRPAの置き換えになる?

A. 反復・固定UIだけなら従来RPAが安いことも多いです。一方、UI変更や例外が多い業務では価値が出やすい。まずは検証環境/サンドボックスで、失敗時に安全側へ倒れるフローから試すのが安全です。

Q. 本番運用で最低限必要なガードレールは?

A. 権限(最小権限)・行動ログ(後追いできる形)・エスカレーション条件(人間に戻す境界)の3点が最低ライン。自律=安定運用ではないので、SLO設計と監査性を先に固めるのがコツです。

コメント