「AIエージェントを作ろうとして、

・LangChainのチェーン設計がどんどん肥大化する

・プロンプトがSOPみたいになって誰も触りたがらない

・モデルを5.2に変えただけで挙動が全部ズレる

…こんな地獄、経験したことはありませんか?

その“モヤモヤ”に、かなり直球で踏み込んできたのが GPT‑5.4 です。

結論(忙しい方向け)

- 本質は「精度アップ」だけではない:Thinking+カスタム指示で、思考手順(SOP)をモデル内に常駐させやすくなり、外側のチェーン設計を薄くできる。

- 導入はPoC前提で早めに:要件定義/調査/レビューなど“専門職タスク”は差が出やすい一方、Thinking多用はコスト/レイテンシ増に直結する。

- 事故は設計不良で起きる:FACT/HYPOTHESIS/OPINIONの区別、エスカレーション条件、タスク別のモデル切替(Thinking/非Thinking)を先に決めるのが安全。

想定読者:AIエージェント/業務AIを作っていて、プロンプトやチェーンが肥大化している開発者・PM・情シス。

関連リンク:

一言でいうと:GPT‑5.4は「React Hooks が来たとき」と同じ空気感

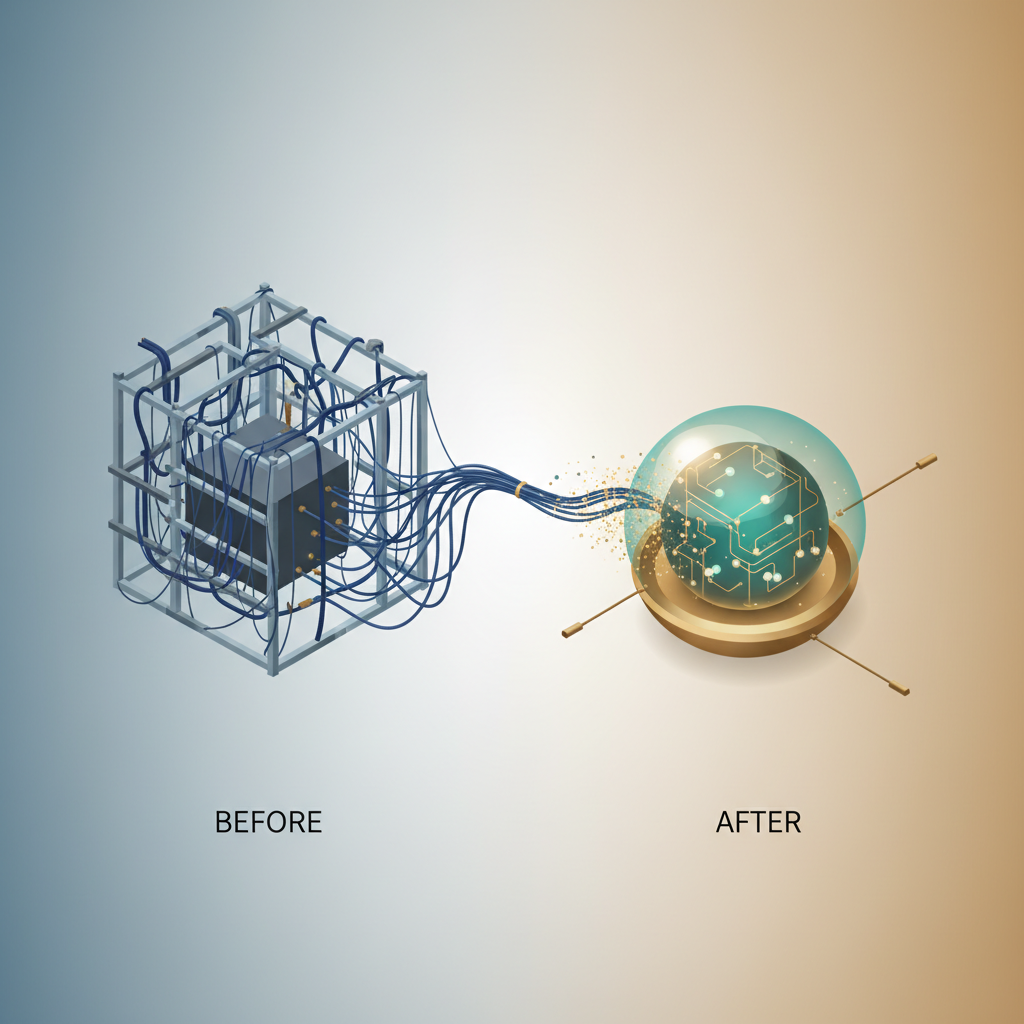

一言で言うと、GPT‑5.4 は LLM界の「React Hooks」 です。

- 以前:

- 推論プロセスは外側のフレームワーク(LangChain 等)でゴリゴリ制御

- モデルは「1ステップ実行マシン」として扱う

- これから:

- Thinking モード+カスタム指示で、“思考ロジック”をモデル内部に埋め込む

- 外側のオーケストレーションは薄くてよくなる

React Hooks で「ロジックをコンポーネント内に閉じ込める」が標準になり、クラスベース設計の多くが一気にレガシー化したのと同じで、

GPT‑5.4 は 「外で組んでいた思考チェーンを、モデルの中に片付けましょう」 というメッセージにかなり近いです。

何が本当に変わったのか:5.4は“テキスト精度”の話で終わらない

技術的な細部は既に多くの解説がありますが、エンジニア視点で「パラダイムが変わるポイント」だけを抽出すると、だいたい次の4つです。

Thinking モードが「おまけ機能」から「前提インフラ」に

5.2 Thinking のときは正直、「長く考えてくれるけど、長く迷走もする」という印象が強かったです。

5.4 Thinking はそこがかなり変わっていて、

- 長編の構成・伏線・一貫性が目に見えてマシ

- 「手順 → 実行 → 検証 → 微修正」という、人間くさい思考プロセスが文章から透けて見える

つまり、内部で長めの“計画フェーズ”+自己検証を本気で回している感じが出てきました。

開発者的に重要なのは、

- 「ユーザーからは1プロンプト」

- 「モデル内部では複数ターンの自己対話 → 結果だけ返す」

という 半自律エージェント挙動が、追加実装なしで成立しやすくなった ことです。

これまでは、

- Chat → 外部フレームワーク → サブプロンプト連打 → マージ

を自分で設計していたのが、

カスタム指示+Thinking モードだけで“内なる LangChain”が回り始める イメージにかなり近いです。

セルフリレー:モデル自身が「仮説を事実化する」ループを回し始めた

今回のキーワードのひとつが「セルフリレー」です。

- 自分で仮説を立てる

- 自分で検証する

- 不足があれば、自分に追加プロンプト(サブ質問)を投げる

- その上で、ユーザーに最終回答だけ返す

これを 「常にそう振る舞え」とカスタム指示で常駐させる 前提で設計してくれ、というのが 5.4 の思想です。

従来のプロンプト設計は、「この1回のリクエストでどう動かすか」ばかり考えていましたが、

5.4 では 「このモデルに、いつもどう考えていてほしいか」を SOP として書く ことの方が重要になってきます。

これは、プロンプトから 「運用プロトコル」へのシフト です。

カスタム指示 = 思考SOPになる

GPT‑4 時代のカスタム指示は、

- 口調

- 役割(〜なコンサルとして振る舞え)

- 回答形式(箇条書きで)

くらいが主戦場でした。

5.4 時代は、ここに 思考プロセスそのもの を突っ込むべきです。例えば:

- 仮説 → 検証 → 要約 の流れ

- FACT / HYPOTHESIS / OPINION のタグ付けルール

- 自己修正ループを回すかどうか

などを「全リクエスト共通の社内標準カスタム指示」として持つ。

正直、ここをサボると 5.4 の旨味の半分を捨てていると言っていいです。

「平均的な人間専門家」をアウトパフォームする前提で設計する必要

OpenAI は、法律・会計・医療などを含むベンチマークで

- 8割超のタスクで「平均的な人間専門家」より高スコア

と主張しています。

ぶっちゃけ、ここは冷静に受け止めた方がよくて、

- 「便利な賢い部下」から

- 「タスク遂行主体(Doer)」

へのポジションに、静かに足を踏み入れつつある、ということです。

つまり設計側の問いも、

- 「AIにどう手伝ってもらうか?」から

- 「どこまで AI に任せて、人間は何に責任を残すか?」

に変わります。

Google / Gemini と比べると何が違うのか:どこが“効いている”アップデートか

開発者として一番気になるのは、「Gemini 1.5 / 3.1 と比べて結局どうなの?」というところだと思います。

専門職タスク vs 超長コンテキスト

公開情報+各種記事を眺める限り、

- Gemini 1.5 / 3.1 Pro

- 超長コンテキスト(100万トークン級)

- マルチモーダル(画像・動画・音声)統合

-

GCP / Workspace との統合

-

GPT‑5.4 / 5.4 Thinking

- 専門職タスク(法律・会計・科学・数学・コーディング)でのテキスト推論精度

- エージェントワークフローとコード生成(元 Codex)を単一モデルに統合

- 「ビルトインコンピュータ使用」+ツール検索で、PC操作・ブラウザ操作をモデルが自前で計画・実行

という棲み分けになってきています。

つまり、

- 「膨大な社内文書+動画+スプレッドシートを一括で飲み込んで分析する」

→ 依然として Gemini 系がかなり有力 - 「専門職の頭脳労働(契約レビュー、要件定義、仕様整理、科学的リサーチ)」を肩代わりさせたい

→ GPT‑5.4 が一歩リード

という構図です。

「思考プロセスをどこに置くか」の思想差

個人的に一番差を感じるのはここです。

- Google:

- どちらかというと「外側のオーケストレーション前提」

-

GCP サービス・外部ツールと組み合わせて、大規模システムを組む思想に近い

-

OpenAI(GPT‑5.4):

- モデル内部でのセルフリレー/Thinking を強く推す

- 中〜中大規模の業務アプリなら、モデル単体+薄いアプリ層で完結し得る

この違いは、時間が経つほど効いてきます。

- Gemini 路線:

- しっかりアーキテクチャを組むエンタープライズ向き

- GPT‑5.4 路線:

- 「小さく作って早く回す」現場主導の業務改善・SaaS に向く

で、現場レベルのナレッジワークは、正直後者の土俵の方がスピードが出ます。

Google が「業務のデータ層」を押さえている一方で、OpenAI は「人が考える最上流の作業」を侵食し始めている、という見立てです。

ここが落とし穴:5.4は“設計のダメさ”を増幅させる

良い話ばかりしても仕方ないので、開発・事業側から見た懸念もきちんと書いておきます。

コストとレイテンシ:Thinking 多用は普通に高くて遅い

- 5.4 Thinking / Pro は 5.2 より API 単価が約1.5倍と言われつつ、

- 内部で複数ステップ推論(セルフリレー)を回すため、

- トークン消費が増える

- レスポンスも普通に 2〜3 倍遅くなるケースがある

特に、

- コールセンターのような大量トラフィック

- ユーザー対話での「レスポンス待たされ感」を嫌うプロダクト

では、無邪気に Thinking をオンにすると即死します。

現実的には、

- 難度の高い要約・要件定義・リサーチ:5.4 Thinking

- 日常の Q&A・軽い補助タスク:5.4( or mini 系)

といった モデル切り替えロジックをアプリ側で持つ 必要があります。

ベンダーロックインはむしろ深くなる

「カスタム指示で思考SOPを書く」と何が起きるか。

- その SOP は OpenAI モデルの挙動前提のナレッジ になる

- 一度そこに投資した組織は、

- Gemini や Claude に乗り換えるとき、「コード移植」だけでなく

- プロトコル/社内ルールの再設計 からやり直しになる

つまり、スイッチングコストが

- アプリコード → 安い

- 人と運用 → 高い

という構造にシフトしていきます。

これは、「気づいたら完全に OpenAI 前提の業務フロー」にしてしまうリスクでもあります。

「5.4 に変えれば全部うまくいく」という幻想

正直ここが一番怖いポイントです。

- モデルの性能が上がる

- 文脈理解や言い回しが上手くなる

- それっぽい理由・根拠も付けてくる

結果として、

- 設計が曖昧でも、それっぽい回答が返ってくる

- しかも「もっともらしい」ので、誤りに気づきにくい

という状況が加速します。

5.4 でも当たり前に起きる問題は、

- タスク定義が曖昧なまま丸投げ

- 事実と推測の区別をさせていない

- 重要な判断を AI だけで完結させている

といった 人間側の設計不良 です。

ここを防ぐには、

- FACT / HYPOTHESIS / OPINION の明示

- 自信度が低い場合は「保留」として出す

- 一定以上のリスクがある判断は必ず人間にエスカレーション

といったルールを、カスタム指示+社内ガイドラインとして 明文化 しておく必要があります。

モデルを変えるだけでここは解決しません。

社内スキルギャップが一気に広がる

GPT‑5.4 時代の「AI 活用がうまい人」は、

- プロンプトの一言テクニックではなく、

- セルフリレーの設計

- 役割・責任の分け方

- ログを見て運用プロトコルを改善する

といった プロセス設計スキル を持っている人になります。

「とりあえずチャットで聞けるから大丈夫」レベルの使い方に留まる人との生産性差は、今後かなり開くはずです。

そして、その差は GPT‑5.4 が普及すればするほど可視化されていきます。

プロダクションで使うか?正直な結論

ここまで踏まえて、「5.4 を本番に突っ込むか?」という問いに対しての、現時点の自分のスタンスはこうです。

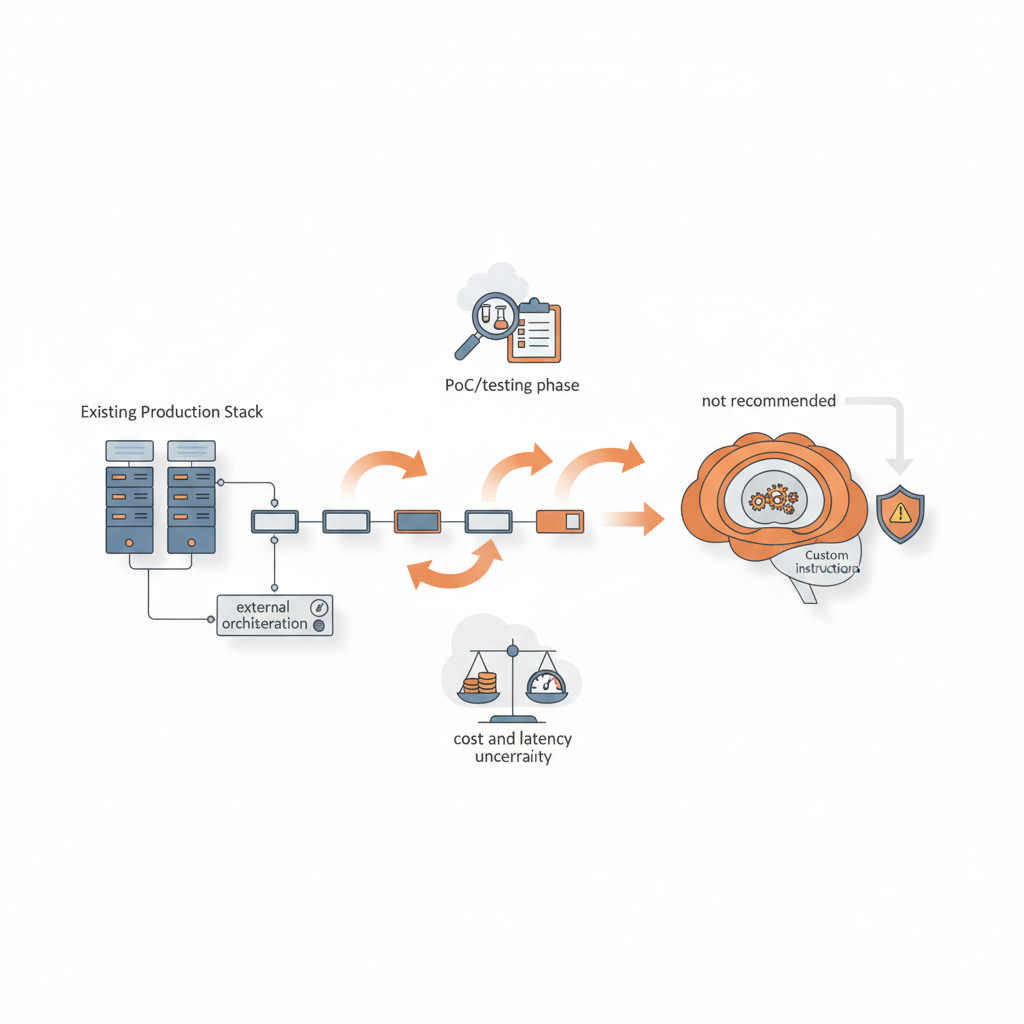

- 「置き換え前提の PoC を必ずやるべき」フェーズには入った

- 既存で 4.x / 5.2 を使っているなら、5.4 / 5.4 Thinking へのテスト移行は早めにやった方がいい

-

特に、専門職タスク・リサーチ・長文要約は差分が出やすい

-

いきなり全面置き換えはおすすめしない

- コストとレイテンシの影響がまだ読みにくい

-

カスタム指示をちゃんと設計しないまま切り替えると、むしろ事故リスクが上がる

-

本番でガッツリ使うなら「設計をやり直す」覚悟が必要

- LangChain などで組んだチェーンを棚卸しして、

- モデル内部(カスタム指示+Thinking)に吸収できる部分

- 外部オーケストレーションに残すべき部分

- を分解して再設計した方がいい

ぶっちゃけ、

「モデルだけ乗せ替えて満足する」のは、一番コスパが悪い使い方 になりつつあります。

これから3〜12ヶ月で、現場として何をするべきか

最後に、開発・事業サイドでの現実的なアクションプランを簡単にまとめます。

- 短期(〜3ヶ月)

- 主要ユースケースを 5.4 / 5.4 Thinking で A/B テスト

- 「Thinking を使うタスク / 使わないタスク」を洗い出す

-

社内共通カスタム指示ドラフト(役割+FACT/HYPOTHESIS 区別+セルフリレー手順)を作る

-

中期(3〜12ヶ月)

- 既存のプロンプト/LangChain フローを棚卸しし、

- モデル内部ロジックに落とす部分

- 外部フレームワークに残す部分

を整理

-

AI 利用ポリシーを更新し、

- どこまで AI に任せるか

- どの判断は必ず人がレビューするか

を明文化する

-

長期(1〜3年)

- 専門職の役割定義を、

- 「自分で全部やる人」から

- 「AI にタスクを定義し、検証し、責任を取る人」

に書き換えていく

- 事業戦略として、

- 「AI をどう使うか」ではなく

- 「AI なしで何をやらないか」

を決めるフェーズに入る

GPT‑5.4 を「ちょっと賢くなった新モデル」として扱うか、

それとも「思考インフラの更新」としてちゃんと設計し直すかで、3年後の差はかなり大きくなります。

個人的には、

- 5.4 そのものよりも、

- 5.4 前提で“思考プロトコル”をどう設計するか

に時間を使うチームが、静かにゲームチェンジャー側に回っていくと思っています。

FAQ:GPT‑5.4を本番導入する前に

Q. Thinking は常時ONにすべき?

A. 基本は「タスク別に切り替え」がおすすめです。要件定義/調査/レビューなどはThinkingが効きやすい一方、定型Q&Aや大量トラフィックではコスト・体感速度の悪化が目立ちます。

Q. 5.2→5.4 で、プロンプトはそのまま移植できる?

A. 動くことは多いですが、同じプロンプトでも挙動が“それっぽく”変わりやすいので、重要ユースケースはA/Bテストが前提です。特に「根拠の書き方」「自己検証」「保留の出し方」を明示しないと事故りやすいです。

Q. カスタム指示は何を書けばいい?

A. 口調より先に、思考SOP(仮説→検証→要約)と、FACT/HYPOTHESIS/OPINIONの区別、エスカレーション条件(人間レビューが必要なケース)を書きます。ここが5.4の投資対効果を左右します。

Q. ベンダーロックイン対策は?

A. アプリ側に抽象化レイヤ(/chatなどの自前API)を挟み、評価セットとログを“モデル差し替え前提”で維持するのが有効です。運用プロトコル(カスタム指示)が資産になるほど、移行コストは「コード」ではなく「人と運用」に寄ります。

コメント