「またモデル消えてるんだけど?」

4o や 4.1 を前提にワークフロー組んでいた人なら、この数週間で一度はそうつぶやいたはずです。

動いているプロダクションを抱えたまま、「はい今日から GPT‑5.4 です、5.3/5.1 は役割変えました」と言われて、素直に喜べるエンジニアは多くありません。

でも、今回の GPT‑5.4/5.4 Thinking は、単なる「数字を盛っただけのマイナーチェンジ」ではなさそうです。

痛みを伴う乗り換えコストを払ってでも検討する価値があるかどうか——その観点で、5.3 / 5.1 からの進化を技術者目線で整理してみます。

- 結論(忙しい方向け)

- 結論(忙しい方向け)

- 一言でいうと:React Hooks が出たときの「あ、設計前提変わったかも」感

- 何が変わったのか:5.3 の「うざさ」から 5.4 の「仕事が分かるやつ」へ

- コーディング観点:中堅実装者+α をかなり本気で食いにきた

- 「8割の専門職を上回る」の正しい読み方

- 競合との立ち位置:ロジックの GPT‑5.4 vs クリエイティブの Claude Opus

- 開発者として一番痛いところ:モデル廃止とロックイン

- 「Gotcha」:5.4 / 5.4 Thinking を真面目に使うときの落とし穴

- 導入判断:移行の進め方(チェックリスト)

- プロダクションで使うか?正直「いきなり全面乗り換え」はおすすめしない

- FAQ(導入検討でよく出る質問)

- まとめ:GPT‑5.4 は “使い方を変えないと損をする” タイミング

- 関連記事

結論(忙しい方向け)

- 体感差は「余計な免責が減って指示に忠実」になったこと。日々の実装/調査のスループットが上がりやすい。

- 移行は段階的に:4o/4.1廃止の影響棚卸し→非クリティカル領域でA/B→Thinkingは設計レビューなど高レバレッジ用途に限定。

- 前提が変わるのは「AI同席前提のプロセス設計」。プロンプト/評価/パーサなど“5.3前提のハック”は見直しが必要。

想定読者:LLMを業務/プロダクトに組み込み、モデル変更の影響と導入判断をしたい開発リード・PM・SRE。

機能面の整理を先に押さえたい場合は、関連記事:GPT‑5.4で何が変わった?Thinkingとセルフリレーの実務インパクトもどうぞ。

結論(忙しい方向け)

- 体感差は「余計な免責が減って指示に忠実」になったこと。日々の実装/調査のスループットが上がりやすい。

- 移行は段階的に:4o/4.1廃止の影響棚卸し→非クリティカル領域でA/B→Thinkingは設計レビューなど高レバレッジ用途に限定。

- 前提が変わるのは「AI同席前提のプロセス設計」。プロンプト/評価/パーサなど“5.3前提のハック”は見直しが必要。

想定読者:LLMを業務/プロダクトに組み込み、モデル変更の影響と導入判断をしたい開発リード・PM・SRE。

機能面の整理を先に押さえたい場合は、関連記事:GPT‑5.4で何が変わった?Thinkingとセルフリレーの実務インパクトもどうぞ。

一言でいうと:React Hooks が出たときの「あ、設計前提変わったかも」感

今回のアップデートを一言でたとえるなら、

「クラスコンポーネント時代から、Hooks 前提で設計を組み直せるようになったタイミング」

にかなり近いと感じています。

- 5.3 までも十分「仕事になる」レベルではあった

- でも 5.4 / 5.4 Thinking は、「専門職レベルの思考が常時そばにいる前提でプロセスを組む」という発想転換を迫ってくる

ぶっちゃけ、

「チャットボットがちょっと賢くなりました」

というノリでスルーすると、2〜3年後にワークフロー設計で取り返しがつかなくなるタイプのアップデートです。

何が変わったのか:5.3 の「うざさ」から 5.4 の「仕事が分かるやつ」へ

5.3 の課題:安全すぎて “プロ用途では邪魔” なアシスタント

5.3 を本番で触っていた人ならわかると思いますが、あの世代は総じて:

- 「私は医師ではありませんが…」「AI は完璧ではないため…」といった免責盛り盛り

- 「コードだけ出して」と言っても、しれっと解説と注意書きが混ざる

- 法務・コンプラ的には安心だが、実務としてはテンポを削ぐ

正直、「会社で新しく入った“超コンプラ意識高い新人”」という感じでした。

まじめでいいやつなんだけど、作業スピードは明らかに落ちる、みたいな。

5.4 の改善:指示をちゃんと聞く、現場を知ってる同僚レベルへ

5.4 で一番効いているのは、性格のチューニングだと思います。

- 「コードだけ」「要点だけ」といった指示への忠実度が戻った

- 不要な説教・免責が大幅に減った

- それでいて、危険・規約違反系はちゃんとブロックする

つまり、「ガバナンスは維持しつつ、現場の邪魔をしないライン」にだいぶ寄せてきた。

この変化は、ベンチマークスコアには出にくいのですが、一日中となりで仕事させると地味に効いてくる差です。

コーディング観点:中堅実装者+α をかなり本気で食いにきた

開発者視点で一番インパクトがあるのは、ここです。

「雑に要件を投げても、とりあえず動くコード+テスト」が出てくる

5.3 までは、

「コンセプトは合ってるけど import が抜けてる」「テストが半端」「致命的なエッジケース抜け」

みたいな “あと 20% がしんどい” ことが多かった。

5.4 だと、検証記事ベースでも実務感覚でも:

- 複数ファイル構成+テストコードを一括で出してくる精度が上がった

- DB スキーマ、API 設計、クラス設計などの「上流の会話」がだいぶマトモになった

- 「既存コードを見せて、この部分だけを書き換えて」「差分パッチで」といった指示が通りやすい

正直、「コードが書ける仕様策定担当」くらいの人材は、かなりの範囲で置き換え可能な水準です。

ミスはもちろんありますが、「骨組みからテストまでを任せて、人間はレビューと最終調整」に振り切る設計は、もはや机上の空論ではありません。

(関連)5.3 系の「日本語トーン改善」や現場での使いどころは、GPT‑5.3 Instant 早期レビューでも補足しています。

GPT‑5.4 Thinking:5.1 Thinking の“粘り強さ”に、ロジック強化を足した感じ

Thinking モデル側も、5.1 Thinking からの素直な進化です。

- タスク分解 → 検討 → 解決案 → 検証、という構造化された思考パターンは 5.1 とかなり近い

- 数学・アルゴリズム・システム設計まわりの推論精度が底上げ

- 途中で投げずに、自己修正しながら完遂しようとする傾向が強い

代償としてレスポンスは確実に遅いです。

でも、バックエンドで「設計レビューを 1 回 30〜60 秒かけてでもちゃんとやってほしい」タイプの処理には、5.4 通常モデルではなく Thinking を据える価値が十分あります。

「8割の専門職を上回る」の正しい読み方

OpenAI は「専門職タスクの 8 割以上で人間を上回る」とアピールしています。

このフレーズ、技術者としてはかなり注意深く解釈したほうがいいです。

- ベンチマークや短時間テストでは、たしかに弁護士・会計士・医師レベルの判断を出してくる

- でもそれは、「1 回限りの問題を、良心的に採点したときのスコア」の話

継続運用・責任・検証コストまで含めたときに、“実務の 8 割を丸ごと代替できる” とは言っていないんですよね。

ここを誤解して

「5.4 があるから、もうジュニアは要らない」

みたいな意思決定をすると、おそらく数年後に痛い目を見ると思っています。

むしろシニア層の視点からすると、

- 日々の実装・調査の 70〜80%程度を 5.4 にまかせて

- 自分は設計・レビュー・検証・チーム教育に集中する

という 「生産性のシフト」のほうが現実的な読み方です。

競合との立ち位置:ロジックの GPT‑5.4 vs クリエイティブの Claude Opus

今回の 5.4 / 5.4 Thinking は、明確に「エンジニアリング・ロジック寄り」にチューンされています。

Anthropic の Claude Opus 4.6 と比べると、ざっくりこんな感じです。

- GPT‑5.4 Thinking

- 数学・アルゴリズム・システム設計・コード生成でわずかに優位

- 「粘り強く完遂させる」という意味での信頼感が高い

- Claude Opus 4.6

- 文章の自然さ、エッセイ・物語などの創作力で優位

- 共感・感情表現・“読ませる文章”は依然として強い

なので、

- SI/プロダクト開発など「ロジックとコードが主戦場」の組織は、5.4 側に重心を寄せる

- メディア・ライティング・編集など「文章表現」が主戦場なら、Opus は引き続き有力

という棲み分けが見えてきます。

「どっちが強いか」ではなく、「どの仕事で誰を前提にプロセスを組むか」が論点になってきた、という感じです。

開発者として一番痛いところ:モデル廃止とロックイン

ここからは、コミュニティでも一番ざわついているポイントです。

o / 4.1 廃止:性能より「信頼できる土台が消えた」ダメージ

4o / 4.1 にそれなりの信頼を置いてフロントを組んでいた人にとって、

- 「安定していたモデルが突然ラインナップから消える」

- 「同じプロンプトでも 5.4 では振る舞いが変わる」

というのは、正直かなりきついです。

- テスト・検証・監査のコストは誰が払うのか

- 本番環境で「いきなり性格が変わった AI」をどう説明するのか

この辺り、OpenAI は「フロンティアモデルを一つに統合しました」と前向きに語りますが、運用側が負う負担は増えているのも事実です。

によるベンダーロックインの“質の変化”

性能がここまで上がってくると、

「じゃあ別ベンダーに乗り換えれば?」という選択肢が現実にはかなり取りづらくなってきます。

- ベンチマーク上で 1〜2 割差がついてしまう

- プロンプト・ワークフロー・社内ナレッジが GPT 前提で最適化されてしまう

正直、“モデルを差し替え可能なアーキテクチャ” を設計していても、実運用で差し替えるインセンティブが急速に失われるフェーズに入っています。

ロックインそのものが悪だとは言いませんが、

- 長期コスト

- モデル廃止リスク

- 機能変更の透明性

あたりを織り込まないと、「SaaS の中枢を丸ごと OpenAI に預ける」設計はかなり危ういです。

「Gotcha」:5.4 / 5.4 Thinking を真面目に使うときの落とし穴

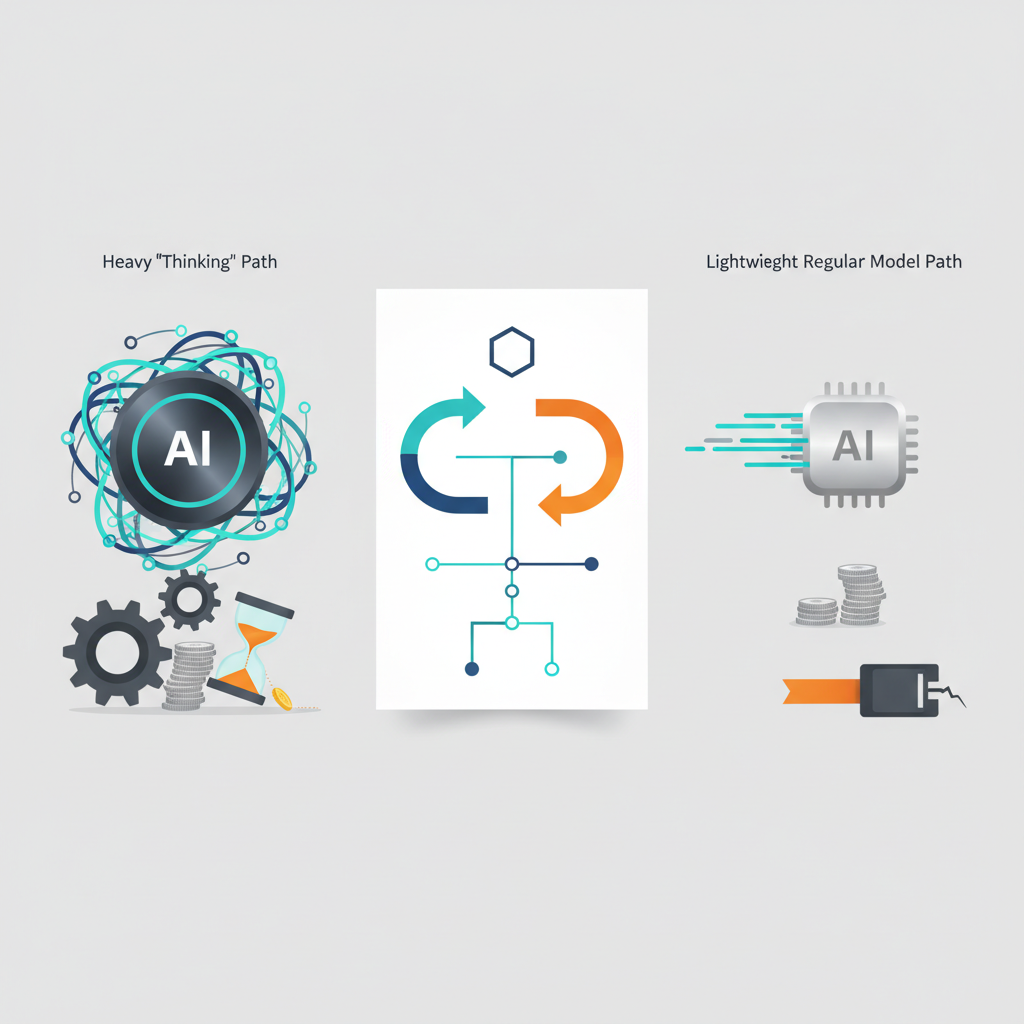

Thinking を乱用すると、普通に採算が合わない

5.4 Thinking は内部で長い思考トークンをガンガン回す設計なので、

- 通常モデルより遅い

- 通常モデルより高コスト

はほぼ確定です。

なんでもかんでも Thinking で統一すると、SaaS 的な料金モデルが一気に苦しくなるパターンです。

現実的には:

- 単純な Q&A や軽いコード補助 → GPT‑5.4

- 設計レビュー、複雑な推論、重要意思決定 → GPT‑5.4 Thinking

というマルチモデル戦略を設計段階から組み込んでおく必要があります。

「冗長さが減ったこと」が Breaking Change になるケース

5.4 はトークン効率が良くなったぶん、

「以前より短くまとめてくる」傾向があります。

人間にとってはありがたいのですが、

- 5.3 時代に「長文が出てくる前提」でパーサを書いていた

- 「免責文の後に本論が出る」みたいなパターンに依存していた

ような実装は、地味に壊れます。

API 互換性としての Breaking Change はなくても、挙動の前提が変わることでロジックがズレるパターンです。

幻覚は「かなり減ったが、まだ普通に出る」

法律・医療・歴史などの事実系で幻覚率が下がっているのは事実ですが、

- ニッチな日本語情報

- ロングテールな技術スタック

- 「ソースをすぐに検証しづらい」領域

では、相変わらずそれっぽい嘘を堂々と言ってきます。

正直、「嘘が減った」からこそ怖いところでもあります。

「たまに嘘をつく、超優秀な同僚」がチームにいる前提で、プロセスを組まないといけないわけです。

ソースの提示を要求する、検証用の自動テストを用意するなど、「AI 出力をそのまま本番に流さない」ためのガードレール設計は、5.4 世代でも必須です。

導入判断:移行の進め方(チェックリスト)

- 影響棚卸し:4o/4.1 前提のプロンプト/パーサ/評価ロジックがどこにあるか洗い出す

- 計測:品質(正答/幻覚)、レイテンシ、コスト、レビュー工数を KPI として定義

- 分割導入:軽い補助→本番前のレビュー→限定された自動化、の順に適用範囲を広げる

- Thinking のルール化:設計レビュー/重大インシデント対応など「高レバレッジ用途」に限定し、乱用を防ぐ

プロダクションで使うか?正直「いきなり全面乗り換え」はおすすめしない

ここまでいろいろ書いてきておいてなんですが、

「明日から全部 5.4 に切り替えよう」という判断は、正直あまりおすすめしません。

自分が現場のテックリードだとしたら、たぶんこうします。

- クリティカルでない領域から A/B テスト

- 社内ドキュメント生成、議事録、軽いコード補助など

-

5.3 / 4o 系との比較を定量+定性で計測する

-

5.4 Thinking を「設計レビュー専用ボット」として限定導入

- PR コメント生成

- アーキ検討の壁打ち

-

仕様書のレビュー

など、「人間が必ず目を通すレイヤー」にまず置いて挙動を観察する -

4o/4.1 廃止の影響を洗い出しながら、徐々に 5.4 ベースへ

- 既存ワークフローで「モデル前提のハック」に依存している部分を可視化

-

「モデルの性格変化」に弱いロジックをリファクタリング

-

最終的に、“AI 同席前提” のプロセスを設計し直す

- 実装フェーズを徹底的に自動化し、レビューと検証に人間を寄せる

- 教育・オンボーディングも「まず AI に質問してから人に聞く」前提で見直す

その意味で、

5.4 世代は「いますぐ全乗り換え」より、「3 年後に勝っているチームの設計方針を考え始めるためのトリガー」だと見ています。

FAQ(導入検討でよく出る質問)

GPT‑5.4 と GPT‑5.4 Thinking はどう使い分ける?

原則は「通常=日常の実装/調査」「Thinking=設計レビューや複雑な推論」など、高レバレッジ用途に寄せるのが無難です。

4o / 4.1 廃止の影響を最小化するには?

モデル依存の挙動(長文前提のパース、免責文の有無など)を先に洗い出し、A/B で差分を計測してから段階移行するのが安全です。

「短くまとめる」傾向はメリット?デメリット?

人間にとっては読みやすい一方、出力形式に依存している既存処理は壊れやすいので、構造化出力(JSON 等)へ寄せるのが定石です。

幻覚はもう気にしなくていい?

減っていてもゼロではありません。ソース提示、検証用テスト、レビューのガードレール設計は引き続き必須です。

まとめ:GPT‑5.4 は “使い方を変えないと損をする” タイミング

整理すると、5.3 / 5.1 から見た GPT‑5.4 / 5.4 Thinking は:

- 5.3 の「過剰な安全・うざさ」をかなり是正しつつ

- 5.1 Thinking の「粘り強い高推論」を継承・強化し

- コーディングと専門職タスクで「中堅〜シニアを本気で補完・部分代替できる」領域を広げてきた

一方で、

- モデル廃止の速さ

- ベンダーロックインの深化

- Thinking モデルのコスト

- 幻覚の残存

といった現実的な制約も、むしろ濃くなっています。

正直、「5.4 が出たからすぐ乗り換えましょう」という単純な話ではありません。

むしろ、

AI をどう“使うか”ではなく、

「AI が常にそばにいる前提で、組織とプロセスをどう設計し直すか」

に軸足を移すきっかけとして、5.4 世代をどう扱うか。

ここで判断を誤ると、数年後に「モデル性能はあるのに組織が活かしきれていない」状態に陥るリスクが高いと感じています。

プロダクションに即投入するかどうかは、正直まだ様子見でいい。

ただし、「様子見しながら PoC を回し、プロセス設計の前提をアップデートしていく」動きだけは、そろそろ本気で始めたほうがいいタイミングだと思います。

コメント