「ロボットのスタック選定だけで1カ月消えた…」

そんな経験、ありませんか?

- シミュレータはどれにするか

- 学習はどのクラウドで回すか

- 実機側はJetsonか、それとも別SoCか

- 自動運転はまた別スタックで…

気づいたら、コードを書く前に「スタックの交通整理」で燃え尽きる。

正直、ここ数年のロボティクス/自動運転まわりって、ずっとこの泥沼でした。

その泥沼に対して、NVIDIA が GTC 2026 で持ち出してきた答えが「フィジカルAI」。

これは単なる新バズワードではなく、「スタックの政治」に対するかなり攻めた一手だと感じています。

結論(忙しい方向け)

- NVIDIAは「Omniverse/Isaac/DRIVE/生成AI」を“フィジカルAIスタック”として束ね、ロボティクス/自動運転のデファクトを狙っている

- PoC/R&Dは乗った方が速い一方、本番はロックイン/コスト/安全・規制の逃げ道設計が必須

- 意思決定の軸は「制御品質の要求 × 運用スケール × ロックイン許容度」

想定読者:ロボティクス/自動運転/産業オートメーションのアーキテクト、技術企画、MLOps/インフラ担当

※GTC全体の発表整理は別記事でまとめています:NVIDIA GTC 2026まとめ:フィジカルAI・エージェントAI・AIファクトリー戦略の実務インパクト

一言でいうと:「ロボティクス界の Docker 宣言」が来た

NVIDIA がやったことをざっくり言うと、

「Omniverse + Isaac + DRIVE + 生成AI」を

ぜんぶまとめて 『フィジカルAIスタック』 と呼ぶことにした

です。

技術的には目新しい API がドカンと増えたわけではありません。

むしろ大きいのは「意味付け」と「束ね方」です。

2013〜2015年ごろ、コンテナ界隈で起きたことを思い出してください。

- 以前:

- LXC, cgroups, chroot, シェルスクリプト…

- どれもあったけど、バラバラで「何をどう組むのが正解か」が分かりにくかった

- Docker 期:

- 「コンテナ = Dockerfile + Image + Registry」という物語に一本化

- “これに乗ればモダンなコンテナ運用ができる” というデフォルトが生まれた

今回の「フィジカルAI」宣言は、

ロボティクス・自動運転・産業オートメーションに対して ほぼ同じことをやろうとしている と見ています。

一言で言うと、

「ロボティクス/自動運転界の Docker 的デファクトを、NVIDIA が取りに来た」

そんな位置付けです。

何が本質的に変わったのか:「バラバラな道具箱」が「1本のストーリー」になった

これまでの NVIDIA の物理世界向けプロダクトは、正直こんな見え方でした。

- Omniverse:

→ 3D、デジタルツイン、なんかすごいけど重そうなやつ - Isaac:

→ ROSまわりの人が触っているロボティクスSDK - DRIVE:

→ 自動車 OEM 向けの別世界のスタック

エンジニア目線だと、「結局どれとどれを組み合わせればいいの?」という疑問がずっと残っていた。

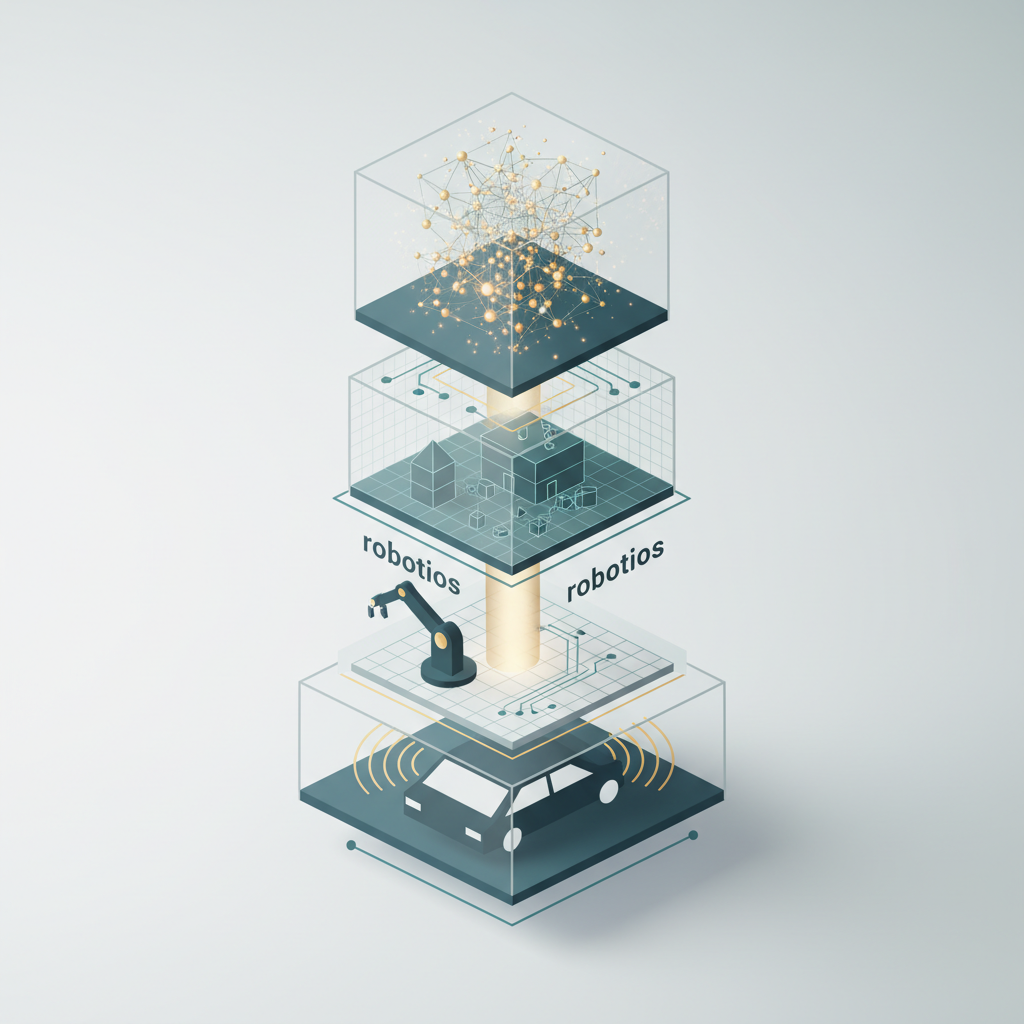

今回のフィジカルAIのメッセージはかなり明快です。

- シミュレーション / デジタルツイン → Omniverse / Isaac Sim

- ロボット(AMR, マニピュレータ, ヒューマノイド) → NVIDIA Isaac

- 車両(ロボタクシー/ADAS) → NVIDIA DRIVE

- 思考・対話・マルチモーダル → LLM/VLM 等の基盤モデル

- それらを支えるコンピュート → 同一アーキテクチャの GPU / SoC

これを全部ひっくるめて「物理世界とAIを統合する1本のスタック」と呼ぶ。

正直、このラベリングだけでも現場の説明コストはかなり下がると思っています。

社内でこんな会話がしやすくなるからです。

「うちの自律搬送ライン、

NVIDIA のフィジカルAIスタックで統一しませんか?

シミュレーションは Omniverse、実機は Isaac + Jetson、

将来ロボタクシーやAGVの拡張があっても DRIVE に乗り換えやすいようにしておきましょう」

これまでだと、

- 「Omniverse ってうちに必要なんだっけ?」

- 「Isaac と ROS2 の関係は?」

- 「車載部門はまた別スタックでしょ?」

と説明に 30 分かかっていたところが、

「フィジカルAIスタック」という共通の箱に入れ直せる。

技術そのものより、アーキテクトの“説明容易性”が一段上がった、

ここが今回の一番のポイントだと見ています。

なぜ今「フィジカルAI」なのか:ロボタクシーと OpenClaw が示すフェーズ転換

東京にロボタクシーが来る=「GTC発表が社会インフラの仕様書になる」

ニュースでは、東京でのロボタクシー実運用の話と GTC が、ほぼセットで語られています。

これ、地味に大きいです。

- これまでは:

→ GTC = 研究デモ / PoC の発表の場 - これからは:

→ GTC = 都市スケールの実サービスを支えるインフラを発表する場

になりつつある。

ぶっちゃけ、

「東京で走っているあのロボタクシーの裏側、大体このスタックで動いてます」

というメッセージを、NVIDIA 自身が半ば当然の前提として語り始めた、

そう感じています。

自動運転やロボタクシーをやっている人からすると、

「GTC のプロダクトロードマップ = 数年後の都市インフラの技術仕様」

になりかねない。

この影響力は、もはや単なるGPUベンダのレベルではありません。

中国発「OpenClaw」ブーム=ROS の次の“コミュニティ層”が見え始めた

もうひとつ面白いのが、中国発のオープンソースロボティクスプロジェクト「OpenClaw」の盛り上がりです。

- ロボットアームやマニピュレーション用の OSS スタック

- 学習・推論は結局 NVIDIA GPU / CUDA 前提

- Isaac や Omniverse と組み合わせる前提で語られることも多い

これ、クラウド時代の TensorFlow/Keras にかなり近い匂いがします。

- 本体:NVIDIA のフィジカルAIスタック(Omniverse/Isaac 等)

- その上で動くコミュニティ層:OpenClaw 的な OSS

つまり、

「NVIDIA スタック + OSS コミュニティ」= 物理世界版の“クラウドネイティブAI」

が立ち上がりつつある。

正直、ここまで来ると、

- 「ロボットの学習コードは GitHub で拾う(OpenClaw 等)」

- 「シミュレーションは Omniverse / Isaac Sim」

- 「実機は Jetson / DRIVE」

という “お作法” が、

若い世代のデフォルトになっていく可能性が高いと感じています。

なぜ技術者に効いてくるのか:スタックが決まると「何を勉強すべきか」が明確になる

エンジニア目線で見ると、「フィジカルAI」宣言には実務的なメリットと代償があります。

メリット:とりあえずこのスタックを抑えれば、ロボティクス一式が見渡せる

- PoC をやるとき:

- シミュレーション → Omniverse / Isaac Sim

- ロボット制御 → Isaac / ROS2 + Jetson

- 車両系 → DRIVE

- 学習系:

- データセンターGPUで学習 → Isaac/DRIVE でデプロイ

という「テンプレ」がハッキリしました。

これにより、

- 「シミュレータ何にする問題」で 3 カ月悩まない

- 「車載SoCはどれがいいか論争」がある程度ショートカットできる

“まずは NVIDIA のフィジカルAIスタックで PoC を回してみる”

これが、スタートアップでも大企業でも、「一応通る提案」になる。

ビジネス側も、

- 「NVIDIA スタックでやるんですね、なら実績も多そうだし安心ですね」

と理解しやすい。

技術とビジネスの会話が合わせやすくなるのは、現場的にはかなり大きいです。

デメリット:学ぶべきスキルセットが一気に“広く・重く”なる

ただし代償もはっきりしています。

ロボットエンジニアにいま求められているのは、もはや

- C++ / Python 書けます

- ROS2 触れます

だけではなく、

- GPU アーキテクチャ(CUDA, TensorRT, CUDA Graph)の理解

- 3D シーン構成(USD)、センサーモデリング、物理シミュレーション

- LLM/VLM をロボットに統合するアーキテクチャ設計

- 安全性・制御のフォーマルな扱い(Safe RL, Fault Tolerance など)

ぶっちゃけ、

「クラウド ML エンジニア + ロボットエンジニア + 3Dエンジニア」を一人でやれに近い世界になりつつある。

NVIDIA が「スタックをまとめてくれた」ことで道筋は見えた一方、

その道のりは前よりだいぶ険しくなった、というのが正直なところです。

競合と比べて見える「NVIDIAの本気度」と「偏り」

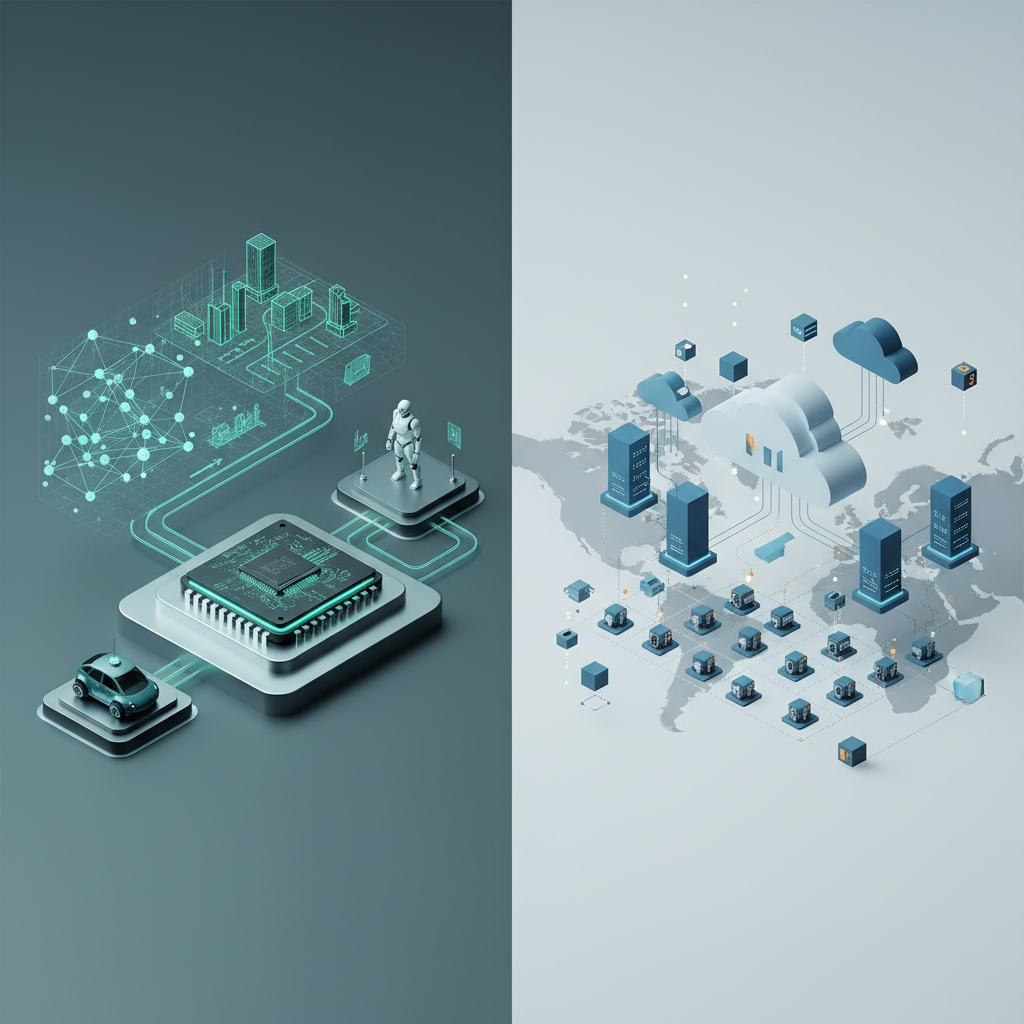

NVIDIA vs AWS:

「フラッグシップの物理制御」か、「マススケールな運用」か

AWS も RoboMaker や SimSpace Weaver など、ロボティクス系のサービスを持っています。

ここを NVIDIA と改めて比べると、かなり役割がハッキリしてきました。

- NVIDIA フィジカルAI

- GPU/SoC からクラウドまで、1社完結の垂直統合

- Isaac / DRIVE / Omniverse で、

「シミュレーション → 学習 → 実機」の一気通貫 -

自動運転や産業ロボットのような「ハイエンド・リアルタイム制御」に最適化

-

AWS 系スタック

- マイクロサービス / IoT / 監視 / ログ / サーバレスに強い

- マルチベンダーなハードウェアに比較的フレンドリー

- ただし「ロボタクシーやヒューマノイドをE2Eで支える専用スタック」ではない

正直に言うと、

- フラッグシップ級の自動運転やヒューマノイドロボットを本気でやるなら、NVIDIA優位

- 数千〜数万台のシンプルなロボットを世界中の倉庫にばらまいて運用するなら、AWS優位

という棲み分けが、だいぶ明確になってきたと思います。

実務的には、

- コアの制御・知能系 → NVIDIA フィジカルAIスタック

- フリート管理・監視・データレイク → AWS / GCP / Azure

という “ハイブリッド構成”が現実解 になるでしょう。

ただし、懸念点もはっきりしている

ベンダーロックイン:ここまで縦に長いと「逃げ道」がほぼない

フィジカルAIスタックにフルコミットすると、

- ロボット側:Jetson / DRIVE

- シミュレーション:Omniverse / Isaac Sim(NVIDIA GPU最適化)

- 学習 / 推論クラウド:NVIDIA GPU前提

と、システムの骨格ぜんぶを NVIDIA が握る形になります。

一度ここまで組んでしまうと、

- GPU を別ベンダーに切り替える

- シミュレータを別製品に変える

- 車載SoCを別社に乗せ替える

のコストは、正直「ほぼ作り直し」と言っていいレベルになりかねません。

OpenClaw のような OSS も、

おそらく「NVIDIA 上だと一番ラクに動く」という世界になる。

OSS を使っているつもりが、事実上 NVIDIA 専用ミドルウェアになっていく懸念はあります。

コスト構造:ロボット1台あたりの単価がまだ重い

高性能 GPU/SoC + クラウドGPUクラスター + 高負荷シミュレーション環境…

このセットを前提にすると、

- 初期投資(CapEx)

- 運用コスト(OpEx)

ともに、それなりの規模が必要です。

東京でロボタクシーを回すメガプレイヤーならまだしも、

地方の中小製造業や小規模物流では、コストが一番のボトルネックになる可能性は高い。

NVIDIA もスタートアップ向け Inception プログラムなどで支援はしていますが、

それでも

- ロボット1台あたりいくらまで GPU/SoCにかけられるか

- シミュレーションをどのレベルまでやるか

は、常にシビアなトレードオフになります。

安全性と規制:LLMをどこまで「物理制御」に近づけるのか問題

フィジカルAIの世界では、

- ロボットが自然言語で指示を受ける

- 基盤モデルがタスク計画を生成する

- 実際に物理世界で行動する

という構図が当たり前になろうとしています。

ここで厄介なのは、

- LLM/VLM は本質的に「確率的なブラックボックス」

- 産業ロボット・自動運転は「安全規格と法規制のど真ん中」

というギャップです。

- LLM はどのレイヤに置くべきか?

- 高レベルの対話だけに使うのか

- ルールで囲ったプランナとして使うのか

- どこまでフォーマルに安全性を証明できるのか?

ここは、スタックが整理されただけでは解決しません。

むしろフィジカルAIによって 「危ない組み合わせ」が簡単に作れてしまう 懸念すらあります。

正直、このあたりは

技術者と法規制側が数年かけて擦り合わせていくしかない領域です。

じゃあ、プロダクションで即フル採用するべきか?

個人的な結論はこうです。

「戦略レベルでは今からフィジカルAI前提で考えるべき。

ただし、プロダクションを一気に全面移行するのはまだ様子見」

です。

導入判断チェックリスト(企画/アーキテクト向け)

- 対象の領域はハイエンドなリアルタイム制御(自動運転/ヒューマノイド/産業ロボ)寄りか? それとも“運用スケール”寄りか?

- ロックイン許容度:GPU/SoC・シミュレータ・SDKをNVIDIAに寄せる代わりに、どこを中立レイヤ(Kubernetes/ROS2/メッセージング等)で守るか

- コストの握り:ロボット1台あたりのHW単価と、学習/シミュレーションのクラウドコストを誰がいつ負担するか

- 安全・規制:LLMは“高レベル計画”に留め、物理制御はルール/制約で囲う設計にできるか

いまやるべきこと(エンジニア / アーキテクト側)

- 既に NVIDIA ベースでやっているチーム:

- 自社アーキテクチャを「フィジカルAIスタック」の用語で書き直してみる

- どこまで Omniverse / Isaac Sim をシミュレーション中心に組み込むか検討

- これから参入するチーム:

- 「NVIDIA フルコミット案」と「クラウド汎用+マルチベンダ案」を

- CapEx / OpEx

- ロックインリスク

- 必要スキルセット

の観点でガチ比較してみる

技術スタックとしての採用方針

- PoC / R&D:

- 正直、NVIDIA フィジカルAIに乗ってしまった方が早いと思います。

- 特にシミュレーション駆動開発(SDD)をやるなら、Omniverse / Isaac Sim は避けて通りづらい。

- 本番プロダクション:

- フルスタックを一気に NVIDIA に寄せる前に、

- どこまで NVIDIA 固有にするか

- どこをクラウド標準(Kubernetes / ROS2 / 汎用メッセージング)で抽象化するか

を先にアーキテクチャで決めておくべきです。

最後に:今回のGTCは「スタック整理の年」だと捉える

APIレベルのブレイキングチェンジは、現時点の情報では見えません。

むしろ今回は、

- 「フィジカルAI」というラベルでスタックを再編成

- ロボタクシーや OpenClaw を引き合いに、「社会実装フェーズ」に入ったことをアピール

- Docker 期のように、「これに乗れば物理世界のAI開発が一通りできる」というデフォルトを提示

という、戦略と物語づくりのフェーズに近い。

技術者視点でいうと、

- いきなり全部作り直す必要はない

- ただし、今後数年の設計・採用・学習計画は「フィジカルAI前提」で組み直した方がいい

というタイミングだと感じています。

ぶっちゃけ、

「ロボティクス / 自動運転スタックの決着戦、NVIDIA がかなり有利に盤面を固めてきた」

そんな印象です。

あとは、我々がどこまでその盤面に乗るか、どこに「逃げ道」と中立レイヤを仕込むか。

2026年以降のロボティクスエンジニアの仕事は、

その“付き合い方”をデザインするところから始まるのだと思います。

FAQ:フィジカルAI採用でよく出る質問

Q. まずPoCで試すなら、どこから着手する?

「シミュレーション(Omniverse/Isaac Sim)→データ→学習→実機デプロイ」のどこを最初に回すかを決め、最小のユースケースで1周回すのが近道です。最初から全部を統合しようとすると、環境構築で燃えやすいので注意。

Q. ベンダーロックインを最小化するには?

計算資源やSDKはNVIDIA前提になりやすい一方、運用面はKubernetes/ROS2/標準メッセージング/観測基盤など“移植しやすい層”を意識して分離しておくと、逃げ道を残せます。

Q. LLMはどのレイヤに置くのが安全?

自然言語→タスク計画(高レベル)に寄せ、最終的な物理制御は制約付きのコントローラ/検証可能なルールで囲うのが基本線です(安全規格・監査要件とも相性が良い)。

Q. クラウド標準(AWS等)と併用する現実解は?

記事内でも触れた通り、コアの制御/知能はNVIDIA寄り、フリート管理・監視・データ基盤はクラウド標準寄り、という“ハイブリッド”が現実的です。

コメント