「昨日までちゃんと動いてたプロンプトが、モデルアップデートで突然バグり始める」。

LLMを本番投入しているチームなら、一度はこういう“事故”でヒヤッとしたことがあるはずです。

- デモでは完璧だったエージェントが、翌週には変なツール呼び出しをし始める

- 安全チームに見せた評価レポートが、モデル更新後には全部“無効”になる

- 「どのモデルが一番いいの?」と役員に聞かれても、「えっと、体感だと…」で詰まる

正直、このあたりの“信頼性まわり”って、2024年あたりまでずっと「気合いとスプレッドシート」でやってきた人が多いと思います。

そこに「OpenAIがPromptfooを買収しました」というニュース。

ぶっちゃけ、「ああ、ついにこのレイヤーをプラットフォーマーが取りに来たか」という感想でした。

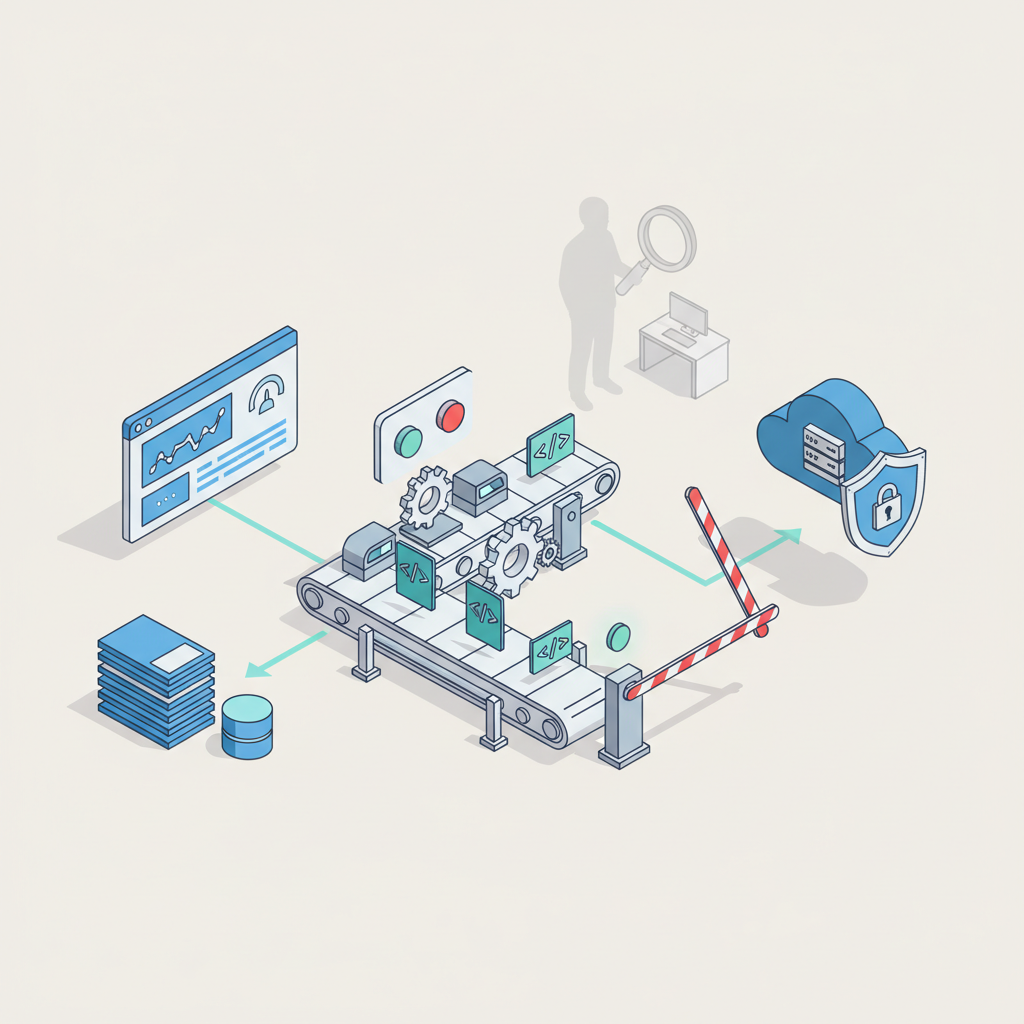

- 一言でいうと:LLM界の「Jenkins」を、OpenAIが自社クラウドに組み込もうとしている

- なぜそこまでして「評価(eval)」を押さえに来るのか

- 開発者目線で見る「OpenAI + Promptfoo」が意味するワークフローの変化

- 競合との比較:特にLangSmith勢はどうなる?

- 「Jenkins化」が生む、インテリジェントなロックイン

- 懸念点1:Eval文化は「コスト」と「面倒くささ」との戦いになる

- 懸念点2:「Trust Dashboard」を見て安心しすぎるリスク

- 懸念点3:OSSとしてのPromptfooはどうなるのか

- じゃあ、エンジニアとしてどう動くべきか?

- 結論:プロダクションで即フル依存するか?正直まだ様子見です

- 関連記事

一言でいうと:LLM界の「Jenkins」を、OpenAIが自社クラウドに組み込もうとしている

Promptfooはざっくり言うと、

- プロンプトやエージェントの挙動を

- YAMLでシナリオ定義して

- 複数モデルで一括テストし

- 回帰(リグレッション)も検出できる

そんな「LLM用のCIツール」です。

今回の買収は、クラウドの世界でいえば、

「GitHubがTravis CIを買って、GitHub Actionsとしてプラットフォームに溶かし込む」

にかなり近い動きに見えます。

これまでのOpenAIは「より良いモデルを出す会社」でしたが、Promptfoo買収で一歩踏み込んで、

- モデルそのもの

だけでなく - そのモデルをどう評価し、監視し、信頼するかという“運用基盤”

を自前で握りに来た、というのが今回の本質だと思っています。

なぜそこまでして「評価(eval)」を押さえに来るのか

エージェント時代のボトルネックは「精度」ではなく「説明責任」

大規模言語モデルそのものの性能は、正直もう「十分強い」フェーズに入りつつあります。

今みんなが困っているのは、性能そのものよりも、

- このエージェントは、どのくらいの確率で正しくツールを呼ぶのか

- このカスタマーサポートボットは、どのくらいポリシー違反を起こさないのか

- モデルを

gpt-4oからgpt-4.1に変えたら、どんな影響が出るのか - それを数値とレポートで説明できるか

という“運用としての信頼性”の部分です。

OpenAI自身も、

- 「OpenAI Frontier」のようなエンタープライズ向けエージェントサービス

- 「エージェントがツールを叩き、社内システムに書き込みもする」ような世界

を売りたい。そのとき必ず聞かれるのは、

「で、そのエージェントがちゃんと動いていることをどうやって証明するの?」

という質問です。

ここで「いや、みんな頑張ってテストしましょう」で済ませるのではなく、

- ダッシュボードから

- シナリオ別に成功率を可視化できて

- モデル更新前後の差分もトラッキングできて

- ポリシー違反率の推移まで出せる

- しかもその裏側は、Promptfoo的なYAML/CLIベースの仕組みでオートメーションされている

という“Trust Operation Platform”を、OpenAI自身が提供する。

今回の買収は、明らかにそこを狙いにいった動きです。

開発者目線で見る「OpenAI + Promptfoo」が意味するワークフローの変化

「プロンプトいじったら手でQA」は、いよいよ許されなくなる

PromptfooがOpenAIに統合されると、おそらくこうなります。

- OpenAIのダッシュボードやAPIから

- データセットを登録し

- 評価シナリオ(プロンプト、ツール呼び出しフロー)を定義し

- 「新しいモデルに切り替える前に eval suite を実行」

→ 合格しなければデプロイ不可、みたいなゲートが張られる

つまり、既存のソフトウェア開発でいうと、

- 「ユニットテストを書かずに本番デプロイする」

が白い目で見られるのと同じように、 - 「LLMプロダクトなのに eval suite を持っていない」

が、企業として運用リスクを取っている状態として扱われる

そんな世界にシフトしていきます。

これは開発者にとって面倒にも見えますが、正直、

「ようやくここまで来たか」という感じでもあります。

競合との比較:特にLangSmith勢はどうなる?

LangSmith vs Promptfoo(+OpenAI内製化)のざっくり整理

現在、LLMまわりの「eval / observability」界隈にはざっとこんなプレイヤーがいます。

- LangSmith(LangChainの観測・評価基盤)

- Humanloop

- Weights & Biases の LLM eval 機能

- Galileo, Braintrust などの各種ツール

その中でも一番分かりやすいのは、やはりLangSmithとの比較です。

- LangSmith

- 強み:トレーシング、複雑なチェーンやエージェントの挙動を可視化するUI

- LangChainとの統合がかなり強力

-

複数プロバイダ・複雑オーケストレーションには向いている

-

Promptfoo

- 強み:YAML + CLIでサクッと書ける「テストスイート感」

- マルチモデル比較、回帰テストがやりやすい

- OSSでローカルでも回る、という“開発者寄り”の思想

ここまでは「棲み分け可能」な世界でした。

しかしPromptfooに「OpenAI本体のプラットフォーム統合」が乗ると話が変わります。

OpenAI専属チームは「とりあえず純正」を選ぶようになる

正直、次のようなチームはかなりの確率でOpenAI純正路線に寄ると思います。

- モデルはほぼOpenAIだけを使っている

- エージェントもOpenAIの提供する仕組み上で構築している

- 社内のセキュリティ・コンプライアンスも、OpenAIとの契約に大きく乗っかっている

このケースでは、

- 「OpenAIダッシュボードからそのまま eval を定義できて」

- 「OpenAIのログ・監査・セキュリティと一体化して」

- 「しかもPromptfoo起源のOSS的ワークフローもある程度踏襲している」

という純正ツールを、あえて避ける理由が薄くなります。

一方、LangSmith側はどうするか。

- もっと強く「マルチクラウド・マルチモデル」を打ち出す

- LangChainベースの複雑なエージェントやマルチステップチェーンの深いデバッグ体験に振り切る

- 企業内の既存データ基盤・BIツールとの接続など、「開発者以外も巻き込む」観点を強める

といった方向にシフトする必要が出てきます。

ぶっちゃけ、「OpenAIしか使わない」チームを相手にすると負け筋になりやすいので、

どこにフォーカスするかがこれからはかなりシビアに問われると思います。

「Jenkins化」が生む、インテリジェントなロックイン

見えない囲い込みは、評価基盤から始まる

クラウドの世界でロックインが効いてくるのは、

単なるコンピュートやストレージではなく「運用の目」となる部分です。

- AWSなら CloudWatch / CloudTrail / IAM

- GCPなら Cloud Logging / Monitoring / IAM

これらをしっかり作り込むほど、

「別クラウドに移すの、正直しんどい…」という状態になります。

LLMでも同じことが起きます。

- Evalの定義

- プロンプト・シナリオごとのベンチマーク

- 歴史的なスコア・SLA証跡

これらがOpenAIの中でガッチリ管理され、

監査ログもダッシュボードもOpenAIに集約されていくと、

「別プロバイダのモデルに切り替えたいんだけど、

その場合 eval スイートをどうやって移植するんだっけ…?」

という話になります。

テスト定義そのものはYAMLでポータブルかもしれませんが、

- モデル固有のツール呼び出し仕様

- OpenAI固有の安全ポリシー&評価テンプレート

- ダッシュボードの権限モデルやアラート連携

こういった“運用の皮膜”の部分がじわじわロックイン要因になります。

正直、これはOpenAI側から見れば非常に賢い戦略です。

ユーザーとしては、「楽さ」と「自由度」のトレードオフを意識する必要があります。

懸念点1:Eval文化は「コスト」と「面倒くささ」との戦いになる

データを作るのは、いつだって人間

Evalの話になると、どうしても華やかな

- LLM-as-a-judge で自動採点

- セマンティック類似度でのスコアリング

といった話に目が行きがちですが、

根本的には「良い評価データセット」を作れるかがすべてです。

- 実運用に近い入力パターンを集める

- 期待される出力をラベル付けする

- 仕様変更に合わせてデータセットも更新する

この地味な作業は、どれだけツールが良くなっても、人間の時間を食います。

PromptfooがOpenAIに統合されることで、

- Evalをやるハードルは技術的には下がる

- しかし「ちゃんとやるなら dataset と scoring の設計は避けて通れない」

という現実は変わりません。

「Evalは大事」というメッセージが強くなる分、

そのコストをどう予算化するかが、これからのチーム運営のテーマになります。

LLMを評価するために、さらにLLMコストを払うジレンマ

OpenAI統合版Promptfooでは、おそらく

- LLMを使った自動採点(LLM-as-a-judge)がテンプレ化される

- 安全ポリシー違反チェックも LLM で判定する

といった流れが強くなるはずです。

これは便利な一方で、

- 本番推論のために1回

- 評価のためにもう1回

と、2回分のトークンコストを払う構造になりがちです。

規模が小さいうちは気になりませんが、

エンタープライズ規模でエージェントを回して、

その上で毎週 eval suite をぶん回すような運用になると、

評価だけでそれなりの請求額になる未来も普通にありえます。

懸念点2:「Trust Dashboard」を見て安心しすぎるリスク

スコアが上がった=現実世界で安全、とは限らない

もう一つの根本的な問題は、

- どれだけEvalインフラが立派になっても

- カバーしていないケースでは普通に事故る

という当たり前の事実です。

ダッシュボードに、

- 成功率 98%

- ポリシー違反率 0.3%

と出ていると、人間はつい「これで大丈夫だ」と思いがちです。

しかしその数値が意味しているのはあくまで、

「このテストセットにおいては、その程度の挙動だった」

というだけです。

- テストデータが現実をちゃんと反映していない

- 新しいユースケースが追加されたのにdatasetが更新されていない

- ユーザーの入力分布が時間とともに変わっている

こういうズレは、どれだけオシャレなEvalツールを使っても発生します。

「OpenAIが用意したEvalテンプレートを通った=本番運用していい」

と考えてしまうのは、正直かなり危険だと思っています。

懸念点3:OSSとしてのPromptfooはどうなるのか

Promptfooはこれまで、

- OSSであること

- OpenAIに限らず、Anthropicやローカルモデルにも対応すること

を大事にしてきたツールです。

今回の買収によって、

- コア部分はOSSのまま

- ただし“本気の機能”はOpenAIプラットフォーム側でのみ提供

みたいな二層構造になる可能性もあります。

それ自体はビジネス的には自然な流れですが、

- クロスプロバイダでのeval文化

- ローカルモデルや自前推論環境でのeval

を重視する人からすると、

「ちょっとずつOpenAI寄りの世界観に引っ張られる」リスクはあります。

個人的には、

- テストケースや評価基準の設計は、できるだけプロバイダ非依存に

- 実行基盤としては、OpenAI統合版とOSS版の両方を触れるようにしておく

くらいの距離感が、しばらくは健全かなと思っています。

じゃあ、エンジニアとしてどう動くべきか?

「Eval文化」をチームに根付かせる

- プロンプトやエージェントを変更したら、

必ず eval を回すという運用ルールを作る - Eval定義(YAMLでもなんでも)は

- Gitで管理し

- CIで自動実行し

- 結果をPRレビューの一部に組み込む

ここまでやって初めて、「LLM開発が普通のソフトウェア開発と同じ土俵」に乗ります。

テストケースとスキーマは、できるだけベンダーニュートラルに

- 入力データ

- 期待出力の形式(スキーマ)

- スコアリングロジック(ex. 正規表現 + セマンティック類似度など)

このあたりは、将来別のモデルを試したくなったときにも使い回せるように、

なるべくOpenAI専用の前提を埋め込まないほうがいいです。

Promptfoo統合は魅力的ですが、

「Evalの定義そのものをOpenAIの中に閉じ込めてしまう」

と、将来の選択肢が狭まります。

コストと人手をちゃんと見積もる

- Eval用データセット作成に誰の時間を使うか

- LLM-as-a-judgeでどの程度のトークンを消費するか

- どの頻度でEvalを回すか(毎デプロイなのか、毎週なのか)

このあたりを雑にやると、「Evalが形骸化する」か「コスト爆増する」かのどちらかになります。

最初はスモールスタートで、

- クリティカルなユースケースだけEvalを厚めに

- それ以外はサンプリング + 人間レビュー

といったハイブリッド運用が現実的です。

結論:プロダクションで即フル依存するか?正直まだ様子見です

エンジニアとしての腹の中を言うと、

- 方向性としては完全に正しい:

Evalを一等市民にするのは、LLMエージェント時代の必然だと思います。 - 開発者体験もきっと良くなる:

CLI/YAMLベースのPromptfoo文化が、OpenAIダッシュボードと結びつくのは素直に嬉しい。

一方で、

- ロックインリスク

- Evalへの過信

- OSSとしての中立性の行方

といった点には、まだ懸念があります。

なので自分だったら、

- Promptfoo統合の動向は追いつつ

- Eval文化そのものは、プロバイダに依存しないかたちで先にチームに根付かせる

- 本番のSLAやコンプライアンスを丸ごとOpenAIのEvalスタックに預けるのは、少なくとも最初の1〜2年は様子見

というスタンスを取ります。

「JenkinsなしでCIやってた時代になんとなく戻りたくない」のと同じで、

数年後には「EvalなしでLLM本番投入してた時代、よくやってたな」と笑われるはずです。

OpenAIのPromptfoo買収は、その未来を数年早めるトリガーになる動きだと感じています。

コメント