「GPT-○○って多すぎて、結局どれを選べばいいか分からない」

プロダクションでLLMを触っているなら、一度はこう思ったことがあるはずです。

- コストは下げたい

- レイテンシも下げたい

- でも品質は落としたくない

- モデルは毎月増える

- そして移行するたびにテスト負荷が重い

そんなタイミングで出てきたのが、「GPT-5.4 mini / GPT-5.4 nano」です。

名前だけ聞くと「またバリエーション増やしたの?」ですが、今回のリリース、正直かなり“本気の一手”だと感じています。

結論(忙しい方向け)

- miniは「大量処理ワーカー」向け:コスト/レイテンシを落としつつ、一定の品質を確保しやすい。

- nanoは分類・抽出・ルーティングなどタスクが明確な軽量処理向け:ユーザー向け本文生成は慎重に(品質劣化が静かに出やすい)。

- 本番は段階導入が現実解:モデル切替を設定/Feature Flag化し、A/Bテストでワークロード別に最適化する。

想定読者:プロダクションでLLMを使うエンジニア/PM/テックリード(コスト・レイテンシ・品質のバランスで悩んでいる方)。

上位モデル側(GPT‑5.4本体)の文脈は、こちらも参照:GPT‑5.4発表:1Mコンテキスト+ネイティブPC操作で何が変わる?段階導入の現実解

一言で言うと、「LLM界の React Hooks」みたいな分解フェーズに入った

一言でたとえるなら、LLM界の「React Hooks 登場」に近いです。

React Hooks 前は、

- 重いロジックも

- 軽いロジックも

- ライフサイクルも

全部、クラスコンポーネントに突っ込んでいました。

Hooks が出てからは、

- 状態管理だけ useState

- 副作用だけ useEffect

- メモ化だけ useMemo

と、「どの処理にどれだけの重さを割り当てるか」を細かくコントロールできるようになった。

今回の GPT-5.4 mini / nano の登場も、それにすごく似ています。

- o3 / GPT-5.4 → 重い思考・高度推論用

- GPT-5.4 mini → 重いこともそれなりにできる「中量級ワーカー」

- GPT-5.4 nano → ルーティングや分類など「軽量サブタスク職人」

つまり、「全部フルモデルに投げる」時代から、「処理ごとにモデルを切り分ける」時代に入った、そのためのパーツがやっと揃ってきた、という印象です。

ざっくり技術的には何が変わったのか(開発者目線で要点だけ)

技術的な新しさを、開発者が本当に気にするポイントだけに絞るとこうなります。

ミドル級と超軽量級がはっきり追加された

OpenAI 全体のラインナップをざっくり整理すると:

- 大型:o3 / o1 / GPT-5.4(フルサイズ)

- 中型:GPT-4.1 mini

- 小型:GPT-5.4 mini

- 超小型:GPT-5.4 nano

ここでのポイントは、「用途特化モデル」ではなく、サイズとコストの粒度を増やしたことです。

APIはこれまで通り chat.completions / Assistants / Realtime などで使えます。やることは model 名を変えるだけ。

コスパ帯がかなり攻めている

ZDNet の数字ベースで見ると(100万トークンあたり):

- GPT-5.4

- 入力: 2.50ドル

- 出力: 15.00ドル

- GPT-5.4 mini

- 入力: 0.75ドル

- 出力: 4.50ドル

- GPT-5.4 nano

- 入力: 0.20ドル

- 出力: 1.25ドル

ざっくり言えば、

- mini = フルの 1/3 くらいの単価で、ベンチマーク上はかなり近い性能

- nano = さらにその軽量版。品質より速度&安さ優先

しかも mini は、40万トークンコンテキスト。

長大な仕様書・ログ・コードベースを一気に投げて処理させる“ワーカー”として、かなり現実的です。

なぜこれが重要なのか:Google Gemini との比較で見える「狙い」

このリリースを単体で見るより、Google Gemini との構図で見ると意図が分かりやすいです。

Gemini側の動き(推論をAPIパラメータで制御する設計など)は、Google Gemini 3.1 Pro 新API解説:推論パラメータ化の実務インパクトと落とし穴に整理しています。

Google vs OpenAI:スケール階層の見せ方

Google はすでに:

- Gemini Ultra / Pro / Nano

という三層構造をはっきり打ち出しています。特に Gemini Nano は Pixel や Android へのオンデバイス統合が進んでいます。

OpenAI もこれまでは、

- o3 / o1 / GPT-4.1 / GPT-4o / GPT-4.1 mini

と“なんとなく階層構造”はあったものの、「Nano」という名前できれいに見せてはいませんでした。

今回:

- GPT-5.4 mini

- GPT-5.4 nano

と明示したことで、「うちも Ultra〜Nano まで揃ってますよ」というメッセージを、開発者に対してかなりはっきり出してきた感じがあります。

開発者体験で見ると、OpenAI が一歩リードしているポイント

正直、ここが今回一番おもしろいところです。

- OpenAI:

- 同じ API / 同じ SDK で

modelを差し替えるだけで-

o3 から 5.4 mini / nano まで一気通貫で扱える

-

Google:

- Gemini Pro / Ultra は Cloud(Vertex AI / AI Studio)

- Gemini Nano は Android / デバイス側

- 開発体験としては 「クラウド」と「オンデバイス」が分断されがち

つまり、「1つのAPIの中で、超高性能〜超軽量までを滑らかに選べる」という点では、OpenAI側の絵作りがだいぶ分かりやすい。

これは、実務でかなり効いてきます。

- 重要な推論:o3 / GPT-5.4

- 重めだが大量:GPT-5.4 mini

- ルーティング・分類:GPT-5.4 nano

といった構成を、全部 OpenAI API の設定だけで切り替えられる。

Gemini だと「ここはクラウドで、ここはAndroid SDKで…」とレイヤが分かれるケースが多い。

開発者からすると、

「アーキテクチャ設計が1枚の図で済むか、2〜3枚必要か」くらいの差があります。

「でも、実際どれくらい良くなってるの?」という現場目線

コミュニティの反応(Reddit やフォーラムの雰囲気)をまとめると、空気感はこんな感じです。

- 空気感:期待しつつも、冷静に様子見

- よく出てくる声:

- 「5.4 は deep research が強いらしいけど、実務でどれくらいマシになったのかはまだ分からない」

- 「‘fewer factual mistakes’ がどの程度か、社内データでちゃんと検証してからじゃないと移行できない」

加えて、既に GPT-4o-mini や 4.1-nano で SaaS を回しているチームからは、

- 「今のモデルで十分に安く安定してるから、わざわざ 5.4 に変える理由が見えない」

- 「モデル更新のたびにA/Bテストとプロンプト調整をやるの、正直つらい」

という、“新モデル疲れ” の空気も確実にあります。

正直、ここにはかなり共感します。

「ただ、懸念点もあります…」と思うところ

技術的には面白い一手ですが、現場視点で「これは気をつけないと痛い目を見る」と感じるポイントもいくつかあります。

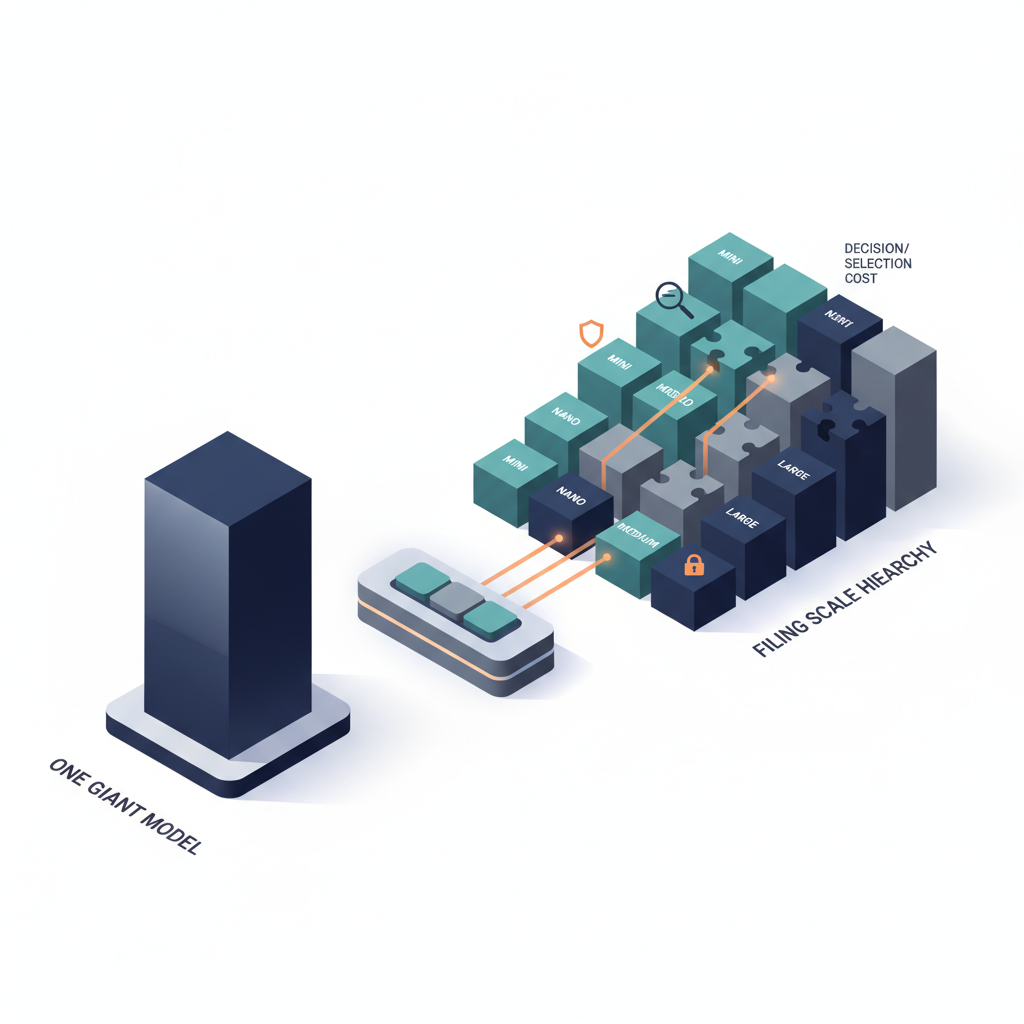

モデル乱立による「判断コスト」がかなり重くなっている

現状のラインナップを並べると、

- o3 / o1 / GPT-5.4

- GPT-4.1 / 4o

- GPT-4.1 mini

- GPT-5.4 mini

- GPT-5.4 nano

…などなど。

正直、「どのタスクに何を使うのがベストか」を判断するだけでかなり疲れます。

- ベンチマーク結果もタスクによって変わる

- コストも入力/出力で別

- レイテンシやスループット要件も絡む

小さいチームだと、「安くて速そうだから nano でいいや」→ 品質劣化で炎上という未来が普通にありえます。

「nano でもそこそこいける」幻想

名前のインパクト的に、「nano = 小さいけど賢い」と期待したくなります。

でも実際の想定用途はかなりはっきりしていて、

- 分類

- 抽出

- ランキング

- シンプルなコーディング支援

- 意図推定、ルーティング

といった、文脈が浅い or タスクがはっきり定義されている処理向きです。

長文ドキュメントの深い理解、複雑な設計レビュー、曖昧な要求の整理……こういうところで nano を使うと、

- それっぽいけど浅い回答

- 細かい条件抜け落ち

- 長文の一貫性が弱い

といった「ジワジワ効いてくる品質問題」が出やすい。

ここを見誤ると、ユーザー体験が静かに悪化します。

コストは「安くなったように見えて、結局増える」問題

mini / nano は確かに単価が安いです。ただ、構成が複雑になるほど:

- モデルの呼び出し回数が増える

- サブエージェントが増殖する

- 「とりあえずAPI叩く処理」がシステム内に散らばる

結果として、月の請求は結局右肩上がりというパターンをわりと見ます。

しかも全部 OpenAI API に寄せてしまうと:

- 他ベンダーの Nano 級モデル(Gemini Nano, あるいはオープンソース LLM)への乗り換えがしづらい

- 将来的にオンデバイス実行したくなったとき、アーキテクチャをかなり作り直す羽目になる

という、ベンダーロックイン+アーキテクチャ負債の合わせ技になりがちです。

Azure 勢にとっては「また待たされるのか問題」

コミュニティで毎回出る話ですが、

- 「OpenAI 本体でリリースされた」

- 「でも Azure OpenAI ではまだ使えない」

- 「いつ来るかは Azure のリリースノートとリージョン別のページを毎回チェック」

という、情報源が分散しすぎ問題があります。

Azure 上でプロダクトを動かしているチームからすると、

- モデル比較・移行計画を立てづらい

- 「5.4前提でロードマップ引いても、いつ使えるか見えない」

という意味で、今回もまたストレス要因になりそうです。

じゃあ実務ではどう使うべきか:個人的な指針

ここからは、「自分がプロダクト側の技術責任者だったらどう判断するか」という視点で書きます。

すぐに全部 5.4 系に乗り換えるか? → いきなり全乗り換えは推奨しない(段階的に試す)

率直に言うと、既に GPT-4o-mini / 4.1-nano で安定しているサービスは、即全乗り換えする必要はないと思います。

やるなら:

- まずは バックエンドの大量処理 / サブエージェントに限定して GPT-5.4 mini を試す

- 例:ログ要約、コードベース検索、社内ドキュメントのバッチ処理

- 軽量なフロント周辺(意図判定、入力補助、ルーティング)は GPT-5.4 nano を A/B テスト的に試す

- メインのユーザー向け回答は、当面は今までのモデル+限定ユーザーでのテストに留める

くらいの慎重さでちょうどいいと考えています。

設計上、絶対にやっておいた方がいいと思うこと

これは強めにおすすめしたいのですが、

コスト最適化はモデル選定だけでなく「入れるトークンを減らす」でも効くので、エンジニアが押さえておきたい「プロンプト圧縮」とは?も合わせて読むと判断が早いです。

- モデルIDをコードにベタ書きしない

- 設定ファイル / 環境変数 / Feature Flag で切り替えられるようにする

- 推論層をラップする

- LangChain / LlamaIndex / 自前ラッパー などで「モデル抽象レイヤ」を用意

- 将来、他ベンダーやローカルLLMに変えたくなったときの逃げ道を確保

- タスクごとに「必要な最低品質ライン」を明文化しておく

- ここは nano でOK(分類・ルーティング)

- ここは mini 以上必須(長文要約・複雑ロジック)

- ここだけは o3 / 5.4 クラス(重要意思決定・法務系など)

この3つをやっておくと、「モデル増殖時代」にそこそこ戦えます。

「GPT-5.4 mini / nano をどう評価するか?」

個人的な評価をまとめると:

- 戦略的インパクト:

- 高い

→ OpenAI がクラウド〜エッジまでを一気通貫で押さえに来ているシグナルとしてかなり重要 - 開発者にとっての実利:

- 中〜高

→ サブエージェントや大量処理ワーカーとしての mini、軽量推論としての nano は現実に役立つ - 今すぐ本番全乗り換えするべきか:

- 正直、まだ様子見

→ deep research / factual mistakes 減少の実力値が、自分たちのドメインでどれだけ出るかを測ってから

最後に:これは「性能アップ」よりも「設計の自由度アップ」のリリースだと思う

今回の GPT-5.4 mini / nano、ニュースとしては「安くて速い新モデルが出ました」とまとめられがちですが、エンジニア視点での本質は少し違うと感じています。

- 1つの巨大モデルに全部投げる時代から

- タスクごとに最適な“重さ”のモデルを割り当てる時代へ

その移行を本格的に後押しするための、「スケール階層を埋めるパーツ」が揃った、という意味合いが強い。

その自由度は魅力的ですが、同時に:

- モデル選定の判断コスト

- ベンダーロックイン

- モデルポートフォリオのガバナンス

という新しい課題も確実に増えます。

なので、結論としてはこうです。

- プロダクションで全面採用するか?

- 正直、まだ様子見。まずは一部のワークロードで A/B テスト。

- エンジニアとしてはどう向き合うべきか?

- モデルそのものより、「どう切り替えられるように設計するか」に時間を投資した方が、長期的にはリターンが大きい。

GPT-5.4 mini / nano は、「より賢いAI」ではなく、「より賢くAIを使い分けるための部品」として捉えた方が、現場ではうまくいくはずです。

FAQ

mini と nano、まずどっちを試すべき?

多くのチームは、まずはmini(大量処理・要約・社内ドキュメント処理など)からが安全です。nanoは分類/抽出/ルーティングなど「成功条件が明確な処理」から段階導入が無難です。

nano でユーザー向け本文生成をしてもいい?

短文・定型なら成立する場合もありますが、品質劣化(条件抜け/一貫性低下)が静かに出やすいので、重要な回答はmini以上+評価ログ前提を推奨します。

既存モデルから移行するとき、最小の検証は?

Feature Flagでモデル切替→代表ワークロードでA/B→失敗時のフォールバック(旧モデル)を用意、の3点が最低ラインです。コストは「呼び出し回数増」で逆に上がりうるので、メトリクスを必ず取ります。

Azure OpenAI ではすぐ使える?

Azure側の提供タイミングは遅れることが多いので、リリースノート/リージョン別対応状況の確認が必要です(計画は“いつでも切替できる設計”に寄せるのが安全)。

コメント