結論(忙しい方向け)

- 日本語×医療ドメインに寄せた巨大モデル(109B級)が出てきたことで、英語モデル+翻訳のロスを減らせる可能性がある

- 研究/PoCは触る価値が高い一方、本番はインフラ・責任分界・監査がボトルネックになりやすい

- 最初の一手は「自院/自社のテストケースでの比較」と「差し替え可能なアーキ設計」を先に固める

想定読者:病院情シス/医療AIベンダー/製薬・医療データ基盤チーム(日本語カルテ要約、退院サマリ、医療QAを扱う人)

セキュリティ/ガバナンス観点は ChromeのGemini統合に関する高リスク脆弱性、基盤側のリスク感は OpenSSLゼロデイの話 もあわせて。

病院や製薬の案件で、日本語のカルテ要約や退院サマリ生成をLLMにやらせてみて、「英語モデル+翻訳だとニュアンスが死ぬ」「日本語汎用LLMだと医学用語で盛大に幻覚する」──そんな経験、ありませんか?

正直、私もここ1〜2年ずっとこの壁に頭を打ち続けてきました。

そんな中、東京大学・松尾研から「日本語特化の医療LLM(109Bパラメータ級)」が出てきた、というニュース。

これ、単なる「また大きいモデルが出たね」という話ではありません。日本の医療AI界隈にとっては、かなり空気が変わる出来事です。

一言でいうと「日本の医療NLP版 Docker」が来た

一言でいうと、このモデルは 「日本の医療NLP界の Docker」 だと感じています。

- これまで:

- 各病院・研究室・ベンチャーが、バラバラに独自の日本語医療NLPを作っていた(ルールベース、BERT系、細々としたファインチューニング…)。

-

まともな性能を出そうとすると、データ収集から注釈、モデリングまで重い投資が必要。

-

これから:

- 「医療日本語をかなりわかっている」109BクラスのLLMが、研究目的なら無償で使える。

- つまり、「自前でベースモデリング」はほぼ卒業して、その上にどうロジックやワークフローを載せるかに集中できる。

Dockerが「OSや依存関係を毎回全部整える苦行」からエンジニアを解放したように、

このモデルは「日本語医療NLPのベースモデルづくり」という、みんなが個別にやっていた辛い作業を共通基盤に押し込める可能性があります。

何が新しいのか:ただの「医療プロンプト付きLLM」ではない

技術的なポイントをざっくり整理すると:

- パラメータ規模は 109B、いわゆる100B級の巨大モデル

- 日本語+医療ドメインに特化して事前学習/チューニング

- ガイドライン、教科書、臨床文書など医療日本語コーパスをがっつり使っている様子

- 「汎用モデルに医療プロンプトを少しかけた」レベルではなく、コアが医療寄りになっている

- 研究利用なら モデル重みを無償提供(要契約)

- APIだけでなく、重みにアクセスできる前提

- 学内GPUクラスターや共同研究基盤で自由度高く扱える

ここが大事で、

「汎用日本語LLM + 医療向けInstructionファインチューニング」ではなく、

最初から医療方向に大きく寄せた100B級モデルがオープンに近い形で出てきた、というのがポイントです。

ぶっちゃけ、これを自前でやろうとしたら、

日本国内の多くの企業・病院には到底払えない計算資源とデータガバナンスコストがかかります。

それを大学側がある程度飲み込んでくれた、という意味でインパクトが大きい。

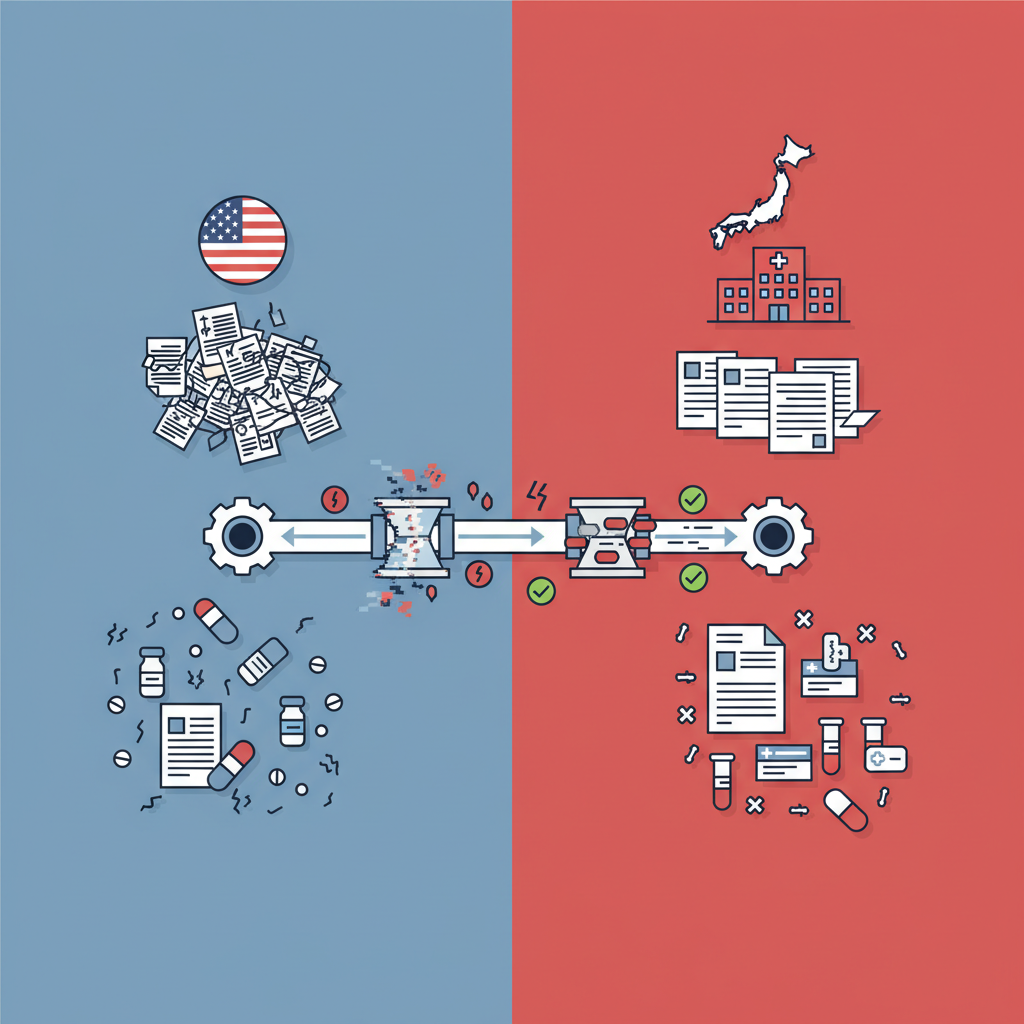

なぜ重要か:Google Med‑PaLM との対比で見える「地の利」

この手の話で必ず出てくるのが、Googleの Med‑PaLM / Med‑PaLM 2 との比較です。

ここであえて、実務エンジニア視点での「違い」を整理してみます。

言語とコンテキスト:英語モデル+翻訳の限界がようやく超えられる

- Med‑PaLM:

- USMLEなど英語の医療試験で高スコア

- 英語の論文・ガイドラインには強い

-

日本語で実運用しようとすると「翻訳レイヤー」が常について回る

-

松尾研モデル:

- 日本語が母語であり、訓練コーパスも日本の医療文書が中心

- 診療情報提供書、退院サマリ、日本の学会ガイドラインの言い回しを、そのままの文化圏で理解できる

英語圏の医療AIは「疾患名も薬品名も全部英語」の世界で最適化されています。

でも、日本の現場は「薬は商品名」「検査略語は病院ローカル」「やたら漢字+カタカナ混在」という、

英語モデルにとっては地獄みたいな前処理の世界です。

ここを「翻訳でなんとかする」のは、正直もう限界が見えていました。

日本語ネイティブな医療LLMがようやく出てきたことで、翻訳レイヤーに起因するロスやバグをようやく減らせる可能性があります。

アクセスモデル:クラウドAPI vs. 重みへのアクセス

- Med‑PaLM:

- Google Cloud / Vertex AI 経由のAPIのみ

- モデルの中身や重みには触れない完全ブラックボックス

-

コストは利用量ベース+クラウドロックイン

-

松尾研モデル:

- 研究用途なら モデル重みそのものにアクセス可能(と読める)

- 病院のオンプレGPUでの推論・追加ファインチューニングが現実的になる

- 日本の法規制(個人情報保護・医療情報ガイドライン)を考えると、オンプレ/国内クラウドで回せることの価値はかなり大きい

医療データは「外に出せない」がデフォルトです。

にもかかわらず、ここ数年は「でもAPIで外に出さないとLLM使えない」という捻れた状況が続いていました。

重みアクセスがあるということは、

- 院内データセンター(もしくは国内クラウド)で

- PHI入りのプロンプトを外に出さずに推論

- ローカルな診療スタイルに合わせて追加学習

ができる可能性が出てくる。

これは、「使えるけど法務とセキュリティが怖い」から「ちゃんと設計すればOKになりうる」への一歩です。

エコシステム:完成品スイート vs. 研究者の遊び場

- Med‑PaLM:

- FHIRツール、医療データ統合基盤など、Google Cloudのエコシステムに乗ると便利

-

いわゆる「エンタープライズ向け完成品」的な位置づけ

-

松尾研モデル:

- まだエコシステムはこれから

- その代わり、研究者やスタートアップにとっては「好きにいじれる遊び場」になる

正直、大病院の情報システム部として、今すぐ医療機器レベルで責任を持って使うなら、まだMed‑PaLMのほうが安心だと思います。

論文も評価指標も揃っているし、Googleが責任をある程度持つ構造になっている。

一方で、日本の大学病院や医療AIベンチャーが「3〜5年後の本命」を仕込むなら、松尾研モデルのほうが圧倒的に自由度が高い。

ここが分かれ目です。

誰が一番インパクトを受けるか:スタートアップと「なんちゃって医療対応LLM」

このリリースで一番影響を受けるのは誰か。個人的には、次の2つだと見ています。

- 汎用日本語LLMを「医療でも使えます」と売っていたベンダー

- これまでは「うちの汎用モデルでも、プロンプト工夫すれば医療いけますよ」が一つの売り文句でした。

-

でも、最初から医療に振り切った109Bモデルが研究機関にはタダで配られる世界になると、「医療にも使える汎用モデル」の価値はかなり目減りします。

-

独自小型モデルを売りにしていた医療NLPスタートアップ

- 「うちは独自に医療日本語コーパスでBERT系をトレーニングしました」が、差別化にならなくなる。

- これからは、「松尾研モデル級の大型モデルをどう安全かつ効率よく小型化・蒸留して、現場向けに届けるか」が勝負になりそうです。

要するに、「モデルそのもの」ではなく「モデルの運用・プロダクト化・医療現場への実装力」で勝負するフェーズに入る、ということです。

とはいえ「魔法の杖」ではない:109Bモデルの現実的な懸念点

ここからがいちばん大事なところで、「いいことばかりではない」話です。

正直、エンジニアとしてはかなり現実的な懸念があります。

109Bは重すぎる:オンプレ運用はガチでインフラ案件

109Bクラスのモデルをまともな精度で回そうと思うと、

- FP16なら 8〜16枚クラスの 80GB GPU

- 量子化しても 4〜8枚は欲しい

くらいの世界です。

大学の計算機センターならまだしも、ふつうの病院情報システム部にとっては 「GPUをもう1枚さす」レベルでは全然足りない。

つまり:

- 研究:

- 大学や一部の大病院のクラスターで試す → 現実的

- プロダクション:

- 大半は何らかのマネージド推論サービス(国内クラウド or ベンダ)頼み → 結局インフラ投資は必要

- もしくは 蒸留・小型化モデルが出てくる前提で設計 せざるを得ない

「重み公開だからオンプレで自由に」という期待だけで動くと、

GPUとMLOps人材のボトルネックですぐ詰む可能性が高いです。

規制と責任:大学発モデル ≠ 医療機器

これも誤解されがちですが、

- 「東大・松尾研が作った医療LLM」=「安全でお墨付きがある医療システム」

ではまったくありません。

医療機器として使うなら、どのみち:

- 自院のデータでのバリデーション

- 導入範囲の明確化(診断支援、文書支援、患者説明…)

- リスク分析(誤診・見落とし時の責任所在)

- ログ・監査・ヒューマンインザループ設計

が必要です。

むしろ、モデルが自由にいじれるぶん、

その設計責任が病院側・ベンダー側により強く返ってくると考えたほうが健全です。

データガバナンス:自由度が増えるほど「やっていいこと/ダメなこと」の線引きが難しくなる

オンプレで重みを持てる、ということは、

- 院内の匿名化前カルテでの追加学習

- ローカルガイドラインでのチューニング

など、色々やりたくなるのが人情です。

ただし、ここには「個人情報保護法」「医療情報システムの安全管理ガイドライン」など、相当細かいルールが絡みます。

- ログにPHIが入らないようにする

- モデルの再利用時に旧データの影響をどう扱うか

- 外部共同研究との境界をどう引くか

など、技術より運用・法務のほうがしんどいフェーズに一気に突入します。

重み公開は自由を増やしますが、

同時に「考えなくてはいけないこと」も爆増させます。

ベンチマークの透明性:今のところは「かなり良さそうな研究ツール」

現時点で見えている情報だと、

- 日本語の医療QA・要約で良さそう

- 薬剤量や禁忌の幻覚が減っている「らしい」

といった 定性的な評価が中心 です。

USMLE的な日本版医療試験データセット(仮にJMLEとでも呼ぶとして)でのスコアなど、

定量評価がどこまで公開されるかは、まだ不明瞭です。

プロダクション導入を考えるなら、

- 自院のテストケースでの比較(既存ルールベース、既存LLMとのA/B)

- 日本語医師国家試験過去問などでの定量評価(あくまで一指標ですが)

といった地道な検証が結局必要で、

「東大が作ったから大丈夫」では全然足りない点は、強調しておきたいところです。

導入前に押さえるチェックリスト(医療現場向け)

- 用途の線引き:診断支援ではなく、まずは文書支援/要約/説明文生成など「医師のレビューが前提」の領域から始める

- PHI/個人情報の扱い:ログ・監査・マスキング・アクセス制御を「モデル非依存」で設計しておく

- 計算資源:109B級は“GPUを1枚増やす”では足りない。推論方式(量子化/分割/マネージド)を前提に見積もる

- 評価セット:自院/自社の症例・文書フォーマットで、既存手法(ルール/小型モデル/汎用LLM)とA/Bで比較する

- 切り戻し/差し替え:将来の蒸留版・別モデルへ置き換えられるよう、ルーティングとプロンプト/評価を分離する

じゃあエンジニアとしてどう動くべきか?

ここまで踏まえて、実務エンジニア/アーキテクト視点での「現実的な動き方」をまとめておきます。

研究/PoC目的:今すぐ触りに行く価値は高い

- 大学・病院・医療系企業のR&Dなら:

- 研究利用枠でのアクセス申請を検討する価値はかなり高いです。

- まずは 既存ワークフローでの比較実験 をやるべきだと思います。

- 退院サマリ要約

- 患者向け説明文の生成

- 医局勉強会用の症例解説

- ここで「汎用LLM+プロンプト」からどれだけ改善するかを見ておくと、

自分たちの数年後の「標準ライン」がどこに来るかがかなりクリアになります。

プロダクション:正直、まだ「様子見+土台づくり」が妥当

ぶっちゃけ、いきなりプロダクションの主役に据えるのは、かなり勇気が要る段階です。

- インフラが重い

- 規制対応・責任分界がまだ整っていない

- ベンチマークも「論文レベル」で固まっていない

この状況でやるべきなのは、

- 医療LLM前提のアーキテクチャを「今のモデルを差し替え可能」な形で設計しておく

- 例えば:

- 現在は汎用LLM+プロンプト

- 将来的に松尾研モデル or その蒸留版に差し替え

- モデル選択を

一般LLM + 医療LLMのマルチモデル前提にしておく - 汎用知識や雑談系は小さい汎用モデル

- ガチ医療QAやカルテ要約は医療特化モデル

- ログ設計・監査・ヒューマンインザループのフレームワークをモデル非依存で整えておく

要するに、

「松尾研モデルに全ベットする」のではなく、

「いつでも乗り換え/併用できる土台を今のうちにつくる」

のが現実的な戦略だと思います。

FAQ

いきなりプロダクション投入して大丈夫?

多くの組織では、まずは研究/PoC→限定用途→段階的拡大が安全です。特に責任分界(誤り時の扱い)と監査設計が整っていない段階での全面投入は避けるのが無難です。

英語の医療モデル(Med‑PaLM等)+翻訳ではダメ?

日本語のカルテ/退院サマリは、商品名・略語・院内ローカル表現が多く、翻訳レイヤーがボトルネックになりがちです。日本語ネイティブ前提の医療LLMは、ここを構造的に減らせる可能性があります(ただし評価は要)。

個人情報(PHI)を扱うとき、最初に作るべき仕組みは?

ログ/監査/権限を先に作るのが効きます。入力・出力・根拠データへのアクセスを追跡できる形にし、必要ならマスキング/匿名化のパイプラインを入れます。

109B級の運用コストが重い。現実的な落としどころは?

本番では、蒸留/小型化モデルや用途別のマルチモデル構成(汎用は軽量、医療文書は特化)でバランスを取る設計が現実的です。

個人的な結論:プロダクションは様子見、でも「基準線」は今日から変わった

最後に、エンジニア兼コラムニストとしての個人的な結論を書いておきます。

-

プロダクションで今すぐメインに据えるか?

→ 正直、まだ様子見です。- 性能・安全性・運用コストの全体像が見えるまで、

「医師の目が必ず入る補助ツール」「研究用バックエンド」として使うのが妥当なラインだと思います。

- 性能・安全性・運用コストの全体像が見えるまで、

-

戦略的な意味でどう評価するか?

→ 日本の医療AIにとっての「基準線」が今日から変わりました。- 「医療日本語にそこそこ対応できる汎用LLM」ではなく、

「医療日本語に本気で振った100B級モデル」が前提になる世界に入った、ということです。

- 「医療日本語にそこそこ対応できる汎用LLM」ではなく、

-

今動かないと何を失うか?

→ モデルそのものではなく、「このモデルを前提にした数年後のエコシステム設計」の議論に乗り遅れます。- 競合は、すでにこのモデルでPoCを回して、「何が得意で何が危ないか」を自分たちのデータで把握し始めるはずです。

正直、こういう「本気の日本語医療LLM」が出てきたのは、

医療AIを日本語でやってきたエンジニアからすると、ようやく、という感じです。

魔法の杖ではないし、まだ荒削りな部分も多いでしょう。

それでも、「どうせ日本語だと限界あるでしょ」という諦めモードから一歩抜け出せるだけでも、

このリリースの価値はかなり大きいと感じています。

コメント