結論(先に要点)

- 東大の医療AIが医師国家試験で約93%正答:日本語・日本の診療ガイドライン前提の「ローカル特化」が強いことを示すニュース。

- ただし試験に強い ≠ 臨床で安全:導入は教育/PoCから。監査ログと責任分界、ガイドライン更新体制が鍵。

- 設計パターンが重要:ドメインLLM+RAG+入力パース+安全フィルタは、他の規制ドメインにも再現可能。

想定読者:病院DX/研究・PoC担当、医療AI/ヘルスケアSaaS担当、規制ドメインでLLM活用を検討する開発者。

「AIに診断を聞いてみたら、それっぽいけど根拠が分からない」「英語モデルに日本語で医療の質問を投げると、急に精度が落ちる」——そんなモヤモヤを感じたことはないでしょうか。

正直、最近の「医療×LLM」は、デモは派手でも、現場で使うには怖いものが多かったはずです。

そんな中で、「東京大学の医療AIが日本の医師国家試験で正答率約93%」というニュースが出てきました。

また「AIが試験に受かったのか、はいはいすごいね」で終わりそうな話ですが、これはちょっと毛色が違います。

一言でいうと:日本の医療界の「AlphaGo moment」っぽい

一言で言うと、これは 日本語ローカルな医療版 AlphaGo です。

- 全く新しいアルゴリズムを発明したわけではない

- でも、「既存のパーツ」をうまく組み合わせて、日本の医師国家試験レベルを普通に超えてきた

AlphaGoがやったことと構図が似ています。

- AlphaGo:ニューラルネット+モンテカルロ木探索という既知の要素を、

「プロ棋士に勝てるシステム」としてフル統合した - 東大医療AI:

- 医療向けマルチモーダルLLM(関連:東大・松尾研の医療日本語LLM)

- 日本語医療ガイドラインへのRAG(検索連携)

- 試験問題パーサ&安全フィルタ

を「日本の医師国家試験を解き切るAI」として統合した

技術的に“ギョッとする新要素”は少ないのに、「ここまでちゃんとやると、もう国家試験は普通に受かるのか」と天井が一段上がった感じがあります。

何がうまいのか:単なる「賢いチャットボット」ではない設計

技術的には、今どきのLLMエンジニアなら聞き慣れた部品ばかりです。それでも93%まで到達したのは、設計の粒度が“プロダクト志向”になっているからだと感じます。

ざっくり言うと、3本柱です。

- 1. 医療特化のマルチモーダル基盤モデル

- テキストだけでなく、X線・CT・MRI・病理・心電図なども入力

- 「文章+画像」を一つの“症例”として扱う前提で作られている

-

医師国家試験のスタイル(長文の症例提示+画像+設問)に最適化

-

2. 日本語ガイドラインを噛ませたRAG(検索拡張)

- 質問に対して、まず日本語の診療ガイドライン・教科書・過去問解説を検索

-

その内容を踏まえて推論させることで、

- ハルシネーションを抑制

- 「日本の標準的医療」を反映

-

3. 試験問題専用のツールチェーン

- 問題文をパースして、

- 患者プロフィール

- 主訴・経過

- 重要所見

- 設問タイプ(診断・治療・次の検査 など)

を構造化

parse → retrieve → reason → answer → justifyという一連のフローを明示的に設計- さらに「危険・ガイドライン違反な回答」をフィルタする安全レイヤー

ぶっちゃけ、「LLMにそのまま聞いて正答率65〜75%でドヤ」みたいな実験とは、思想レベルで別物です。

最初から“臨床意思決定支援パイプライン”として設計しているのがポイントだと思います。

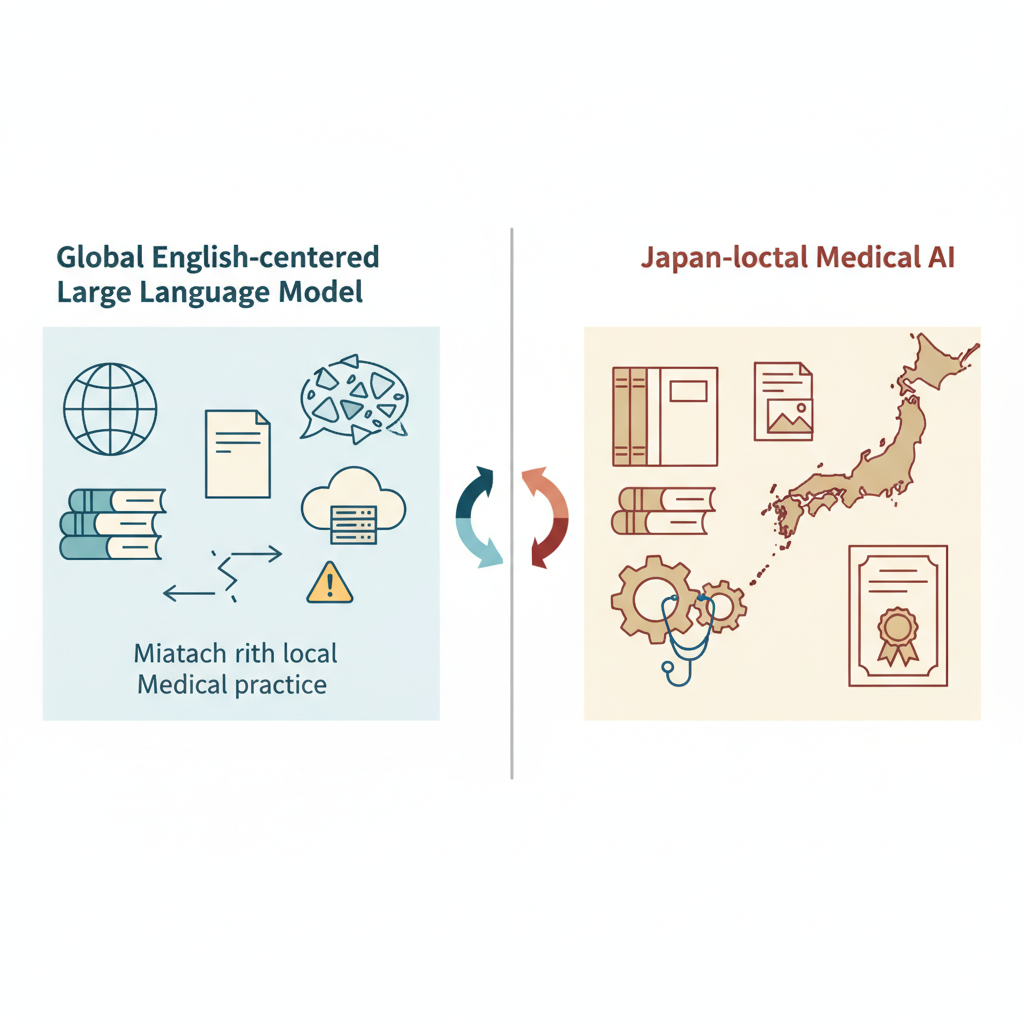

なぜ重要か:Google MedPaLM にもない「日本ローカルの決定打」

ここからが個人的に一番面白いところですが、これは単に「精度が高いAIが出てきました」という話ではなく、グローバルLLM vs ローカル医療AIの構図に直結します。

MedPaLM vs 東大医療AI:ざっくり比較

ざっくり整理すると、こんな感じです。

- 言語

- MedPaLM:英語中心、他言語サポートは「おまけ」レベル

-

東大AI:日本語ど真ん中。医療用語・略語・日本語の設問スタイルに最適化

-

参照する知識

- MedPaLM:英語圏中心の論文・教科書・国際ガイドライン

-

東大AI:日本の診療ガイドライン、和文教科書、医師国試の過去問解説

-

モダリティ

- MedPaLM(初代):テキスト中心(後継でマルチモーダル化は進行中)

-

東大AI:最初から「文章+画像」が前提

-

ターゲット

- MedPaLM:グローバル医療・USMLE系ベンチマーク

- 東大AI:日本の医師国家試験と、日本の標準治療

開発者目線でいうと、グローバル大手LLMをそのまま医療に流用する戦略の「限界」がかなり明示的になった感があります。

- 英語LLMに日本語の医療相談を投げて、

- 変な誤訳

- 日本の保険診療からズレた提案

- 日本では存在しない薬剤の提案

などが混ざるのは、構造的な問題です。

そこに「日本語+日本のガイドライン前提で93%」という数字を突き付けられると、少なくとも 日本市場では“ローカル特化AI”がかなり強い武器になるのは間違いありません。

Google/OpenAI 側も「日本向けヘルスケアパートナー」が必要になるし、日本の大学・病院・ベンダー連合が「医療ドメインだけはこっちで押さえる」戦略を取りうるフェーズに入ってきました(関連:OpenAIの『ChatGPT Health』発表)。

開発者にとっての示唆:これ、かなり再現可能な設計パターンです

エンジニアとして一番気になるのは、「この成果がどこまで再現可能なパターンか」という点だと思います。

正直に言うと、かなり汎用パターンとして真似できると感じます。

- ドメイン特化LLM(あるいは汎用LLMのドメイン特化ファインチューニング)

- ローカルなガイドライン/教科書を詰め込んだRAG基盤

- ドメイン特化の入力パーサ+推論エージェント+安全フィルタ

を組み合わせるだけで、

- 医療 → 国家試験レベル

- 法律 → 司法試験や各種資格試験レベル

- 金融 → 証券アナリスト・各種検定レベル

まで持っていけることが、今回ほぼ「実証」されました。

逆に言うと、

- 「汎用LLMをそのままQAボットにしました」

- 「RAGは入れたけど、ドメイン特化のパーサ/安全レイヤーまでは作っていません」

というプロダクトは、今後一段見劣りするフェーズに入ると思います。

医療に限らず、「ドメインLLM+RAG+ワークフロー設計」がセットで“最低ライン”になっていく予感があります。

とはいえ:懸念と「冷静に見たほうがいいポイント」

ここまでベタ褒めっぽく書きましたが、ぶっちゃけ懸念もそれなりにあります。

国試に強い ≠ 臨床で安全

一番大事なのはここです。

- 国試問題:

- 必要な情報はほぼ全て与えられている

- 正解は1つ(もしくは明確な「最善解」がある)

-

異常値・典型例・代表的なパターンが中心

-

実臨床:

- 情報は欠落・矛盾だらけ

- 合併症・既往歴・社会的背景が絡みまくる

- 「どれも正しくないけど、マシな選択」をせざるを得ない場面が山ほどある

93%という数字は確かにすごいですが、「じゃあこのAIに外来診療を任せよう」は完全に別次元の話です。

実臨床では、

- 誤診したときの責任は誰が取るのか

- 説明責任をどう果たすか

- 医師がAIの提案を覆したときのログと理由をどう扱うか

といった、ややこしい問題が一気に噴き出します。

コンテンツの運用コストが重い

この手のRAGシステムは、最初のモデルよりも「中に入れる知識」の運用が重いです。

- 診療ガイドラインは数年おきに改訂される

- 新薬や新しい手技がどんどん出てくる

- 国試の出題傾向も変わる

つまり、

- 定期的なコーパス更新

- インデックスの再構築

- 回答パターンの再評価

といった「コンテンツ運用チーム」無しでは長期運用が難しいタイプのシステムです。

医療AIを入れたい病院・企業は、「モデルエンジニア」だけでなく「医療コンテンツ運用チーム」をどう組むかまで考えないといけません。

海外展開にはそのまま使えない

東大モデルの価値は「日本に合っていること」そのものですが、これは同時に国ごとの作り直しがほぼ必須という意味でもあります。

- 言語

- ガイドライン

- 保険制度

- 法規制・責任範囲

が違えば、安全フィルタや“標準的治療”の定義から作り直しです。

「このモデルをそのまま東南アジアや欧州に持っていく」ことはまず無理で、汎用化しづらい構造ではあります。

とはいえ、「パターンとしては輸出可能、実装はローカルごとにやり直し」が現実的なラインでしょう。

規制と責任の問題はこれからが本番

医療AIを本当に臨床現場で使うには、

- 日本ならPMDAレベルの医療機器認証

- 各病院のリスクマネジメント委員会での承認

- 医師会・患者団体との合意形成

など、技術とは別の大きな山があります。

「93%正答だからOK」という話では全くなく、

- どのレベルのタスクまでAIに任せてよいか

- どの場面では“補助意見”に限定すべきか

- ログ・監査・説明可能性をどう担保するか

といった設計が求められます。

ここを雑にやると、一発のインシデントで一気に「医療AI=危険」の烙印を押されかねません。

エンジニア視点の「実務インパクト」

開発者としての肌感をまとめると、こんなところです。

- 真似すべきところ

- ドメイン特化LLM+ローカルRAG+明示的なワークフロー設計という「型」

- マルチモーダルを前提にした設計(医療なら画像は逃げられない)

-

ガイドライン準拠の安全フィルタを最初から組み込む発想

-

まだ様子見したいところ

- 実臨床レベルでの運用実績・前向き試験

- コンプライアンス・説明責任まで含めたトータルコスト

- 病院ITインフラに組み込む際のレイテンシ・障害時運用

「PoCとして使ってみる」「院内の教育用に国試問題を解かせてみる」のは、かなり現実的なユースケースだと思います。

一方、「このAIに初診の診断を自動で任せる」といった使い方は、正直まだかなり慎重にやるべきフェーズです。

導入判断:いま検証するなら何から?(病院/医療系企業向け)

- 短期の現実解:教育(国試・院内研修)や文書要約/ガイドライン検索など「低リスク」用途からPoC。

- 評価設計:正答率だけでなく、根拠(引用)・禁忌の抑止・ログ/監査・人間の覆しフローをセットで確認。

- 運用の論点:ガイドライン改訂の反映頻度、コンテンツ更新体制、責任分界(誰が最終判断か)を先に固める。

結論:プロダクション投入は“慎重前向き”、ただし設計パターンとしては必修科目

最後にまとめると、こんなスタンスです。

- 技術的な意味

- 「日本語ローカル・医療特化・マルチモーダル・RAG+安全フィルタ」で、

国家試験レベルなら“人並み以上”はもう普通に出せる -

これは他ドメインにもそのまま応用できる、かなり強い設計パターン

-

プロダクト的な意味

- 医療教育・試験対策・臨床意思決定支援(CDS)のPoCとしては、

今すぐにでも検証してよいレベル -

ただし「診療の最終判断をAIに委ねる」ようなプロダクションユースは、

規制・責任・運用コストを踏まえると、まだワンクッション必要 -

戦略的な意味

- 「医療のような規制ドメインは、ローカルプレイヤーが本気で作ればBig Techに普通に対抗できる」

というメッセージとしてはかなり強い - 逆に、グローバルLLMをそのまま医療用途に流用する戦略は、

日本ではますます説得力を失っていく

なので、エンジニアとしての結論はこうです。

プロダクションで“診療の中核”に据えるか?

正直、まだ様子見です。

ただし、「自分たちのドメインで何を作るべきか」を考えるうえでの

設計テンプレートとしては、もう必修科目です。

医療に限らず、自分のドメインにこのパターンをどう移植するか——そこを具体的に考え始めるタイミングには、もう来ていると思います。

FAQ(よくある質問)

Q. 「正答率93%」は何を意味しますか?

A. 医師国家試験形式の問題で、与えられた情報から最適解を選ぶ能力が高いことを示します。ただし実臨床は情報欠落や例外が多く、同じ指標がそのまま安全性を保証するわけではありません。

Q. 病院でいきなり診療支援に使えますか?

A. まずは教育・過去問/症例レビューなど、患者安全への影響が小さい用途からの検証が現実的です。診療に近づけるほど、責任分界・監査ログ・説明責任の設計が必須になります。

Q. 企業側(医療系SaaS)は何を真似すべき?

A. ドメイン知識のRAGだけでなく、入力の構造化(パース)とワークフロー化、そして危険回答の抑止レイヤーまで含めて「型」として組む点です。

Q. いちばんのボトルネックは?

A. モデルそのものより、ガイドライン改訂への追随、評価データ整備、運用チーム(医療コンテンツ/法務/品質保証)など“継続運用”です。

コメント