「え、またベンダーロックインの地雷増えたの?」

そう感じたエンジニア、多いはずです。

せっかくClaude 4.6 Sonnetや「Claude Code」で爆速開発フローを回し始めたのに、「米政府がAnthropicを“国家安全保障リスク”扱い」というニュース。

正直、「技術選定に地政学リスクまで考えないといけないの?」という疲労感があります。

でも今回の動き、ぶっちゃけ Huawei vs 5GのAI版 にかなり近い構図で、エンジニア目線でも無視できません。

この記事では、ニュースの要約ではなく、「開発者・プロダクト側から見てどう解釈すべきか」を意見ベースで掘り下げます。

一言で言うと:AI界の「Huawei排除」を、いま目の前で見ている

今回起きていることを乱暴に一言でまとめると、

「Anthropic(Claude)が、米国の“AI版Huawei”のポジションに追いやられつつある」

という構図です。

- トランプ政権寄りの安全保障サイドが

- Anthropicを「国家安全保障上のハイリスクベンダー」とラベリング

- 特に防衛・インテリジェンス関連の用途で利用を制限・忌避するガイダンスを準備

- ほぼ同タイミングで

- OpenAI(+Microsoft)が、重要な政府系AI案件の「事実上の標準ベンダー」ポジションを確保

Huaweiと5Gのときも、

- 技術的には超有力

- しかし「国家安全保障リスク」と認定され、

- 調達リストから外され

- 結果的にNokia/Ericssonなど、別の「安全と認定された」ベンダーに市場が集中

という構図でした。

今回はそれが LLMスタックで起きている だけです。

なぜこんなに揉めているのか:技術ではなく「価値観」と「軍事利用」の衝突

今回のAnthropic叩き、単なる「性能が怪しい」とか「セキュリティが甘い」ではありません。

もっと面倒で、正直やっかいなのは 価値観レベルの衝突 になっている点です。

Anthropic側のスタンス:武器にはなりたくないAI企業

Dario Amodei(Anthropic CEO)は前から一貫して、

- 「Constitutional AI」(AIに“憲法”に相当する原則を埋め込む)によるアラインメント重視

- 民主的な監督・統制のもとでのモデル運用

- 特に 攻撃的な軍事システムとの深い統合には慎重 という立場

をかなり明確に打ち出しています。

要するに、

「我々は“武器グレードAIのフルサプライヤー”にはなりません」

という宣言に近い。

これは市民社会・研究コミュニティからすると好感度が高いポジションですが、

正直、防衛・情報コミュニティから見ると

- 「制約が多そう」

- 「こちらの要求に最後まで付き合ってくれるのか不安」

- 「必要なときに“嫌です”と言われそう」

という懸念を持たれてもおかしくないスタンスです。

国家安全保障サイドの期待:フルスペックで使える“ナショナルAIスタック”が欲しい

一方で、米国の安全保障サイドが欲しいのは

- サイバー、情報戦、インテリジェンス分析を含め フルスペックで制約少なく使えるAI

- 機密データ・機微なオペレーションでもフル統合できる 「国産」かつ「従順」なベンダー

- 更新・監査・ログ・リージョン制御など、

すべてを 政府仕様にカスタムできる相手

という存在です。

そこで、

- 既にDoDや政府との太いパイプを持つMicrosoft

- その上で動くOpenAIモデル

というコンボが、

「政治的に扱いやすい“安全なデフォルト”」として一気に押し上げられた、という構図に見えます。

技術的にはどうか:ぶっちゃけClaudeはかなり強い

ここが今回の一番のポイントですが、

これは“技術的な敗北”ではなく、完全に政治レイヤーの話 です。

Claude 4.6 Sonnet / Claude Code の実力

開発者目線で見ると、Claude 4.6 Sonnetと「Claude Code」ワークフローは、

- 大規模リポジトリをまたいだコード理解・編集

- マルチファイルの一括リファクタリング

- 設計レビュー/影響範囲分析レベルの長文・長コンテキスト推論

で、かなり「世界を変えつつある」ラインに乗っています。

正直なところ、

- レガシーな巨大モノリスの大規模改修

- 既存システム全体のコードベースの健康診断

みたいなタスクでは、

「現時点ではClaudeの方が楽」と感じているエンジニアも少なくないと思います。

OpenAIとの比較:国家安全保障 vs 開発現場

国家安全保障+エンタープライズ調達の観点では、

- OpenAI + Azure

- 既に政府調達・コンプラ周りの枠組みが厚い

- VNet、プライベートエンドポイント、リージョン制御など、

「CISOが喜ぶチェックボックス」をかなり埋めやすい - Anthropic

- 技術的には競争力あり

- しかし「高リスクベンダー」扱いがつくと、

入札・ガバナンスの文脈で一気に不利になる

一方で、「開発生産性」の観点だと、

- Claude

- 長コンテキスト+コード理解はかなり得意

- 「慎重で構造的なコーダー」としてのフィードバックが多い

- OpenAI

- エコシステム・SDK・統合は圧倒的

- ただし、リポジトリ丸ごとの読解ではまだ工夫が必要なケースもある(※モデル世代によって変わる領域)

という感じで、どっちが“圧勝”という話ではない。

なのに国家レベルでは「OpenAIスタック一択」っぽい流れになりつつある、というのが今回の違和感です。

真のトリガーは「Claude Code」だった説

日本語圏の記事群を読むと、

ホワイトハウスや安全保障サイドの懸念の文脈でやたら強調されているのが 「コード自動化能力」 です。

- 大規模コードの自動編集

- マルチファイルの一括変更

- セミ自律的なコーディングエージェントとしてのふるまい

これ、攻撃者目線で見ると

- ゼロデイの自動探索

- エクスプロイトコードの大量生成

- 既存マルウェアの自動変種生成

にも かなり直結しうる能力 なんですよね。

正直、その恐怖感はわかります。

つまり、

「Claude Codeが“世界の開発フロー”を変え始めた瞬間に、

“それは同時にサイバー攻撃のゲームチェンジャーでもある”と政府が気づいた」

という流れに近い。

開発者が「うわ、めちゃくちゃ便利!」と盛り上がった同じ機能を、

安全保障サイドが「これはヤバい」と見ているわけです。

懸念点:この流れ、エンジニアにとってけっこう危ない

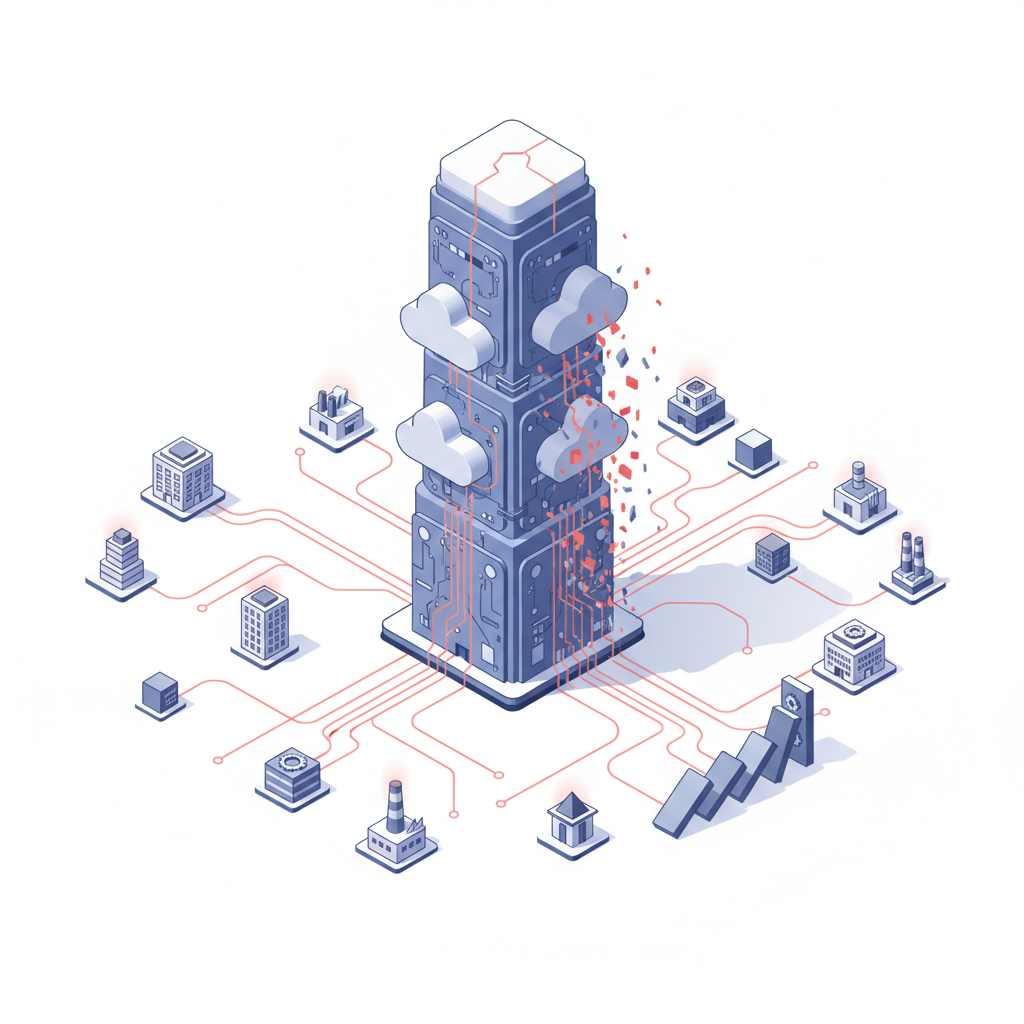

ベンダー集中による「AI版シングルポイント・オブ・フェイラー」

国家安全保障を理由に、

政府・大企業・規制産業が一斉に「OpenAI+Azure」に寄っていくと何が起きるか。

- ツール、SDK、リファレンスアーキテクチャ、コンプラテンプレが

ほぼ「1スタック前提」で設計される - 有事の際、その1スタックに障害・リーク・ポリシーミスが出ると

同時多発的なシステム障害 を引き起こしうる

クラウドでも「AWS一極集中リスク」はよく語られますが、

推論・意思決定にかかわるAIレイヤーが一社に偏るのは、

正直それ以上に危険だと思っています。

「安全性を真面目に言語化すると損をする」という逆インセンティブ

今回のAnthropicのケースが一番まずいのはここです。

- 民主的統制

- 武器用途への慎重姿勢

- 憲法的な原則を明文化

…こういったスタンスを 真面目に・公然と 出した結果、

- 「防衛用途に使いにくそう」

- 「面倒な制約を要求してきそう」

と見なされて、

政府ビジネスで不利になっている 可能性が高い。

これ、他のラボへのメッセージとしては最悪で、

「安全性や軍事利用への懸念をあまり公言しないほうが、

国家レベルの大型契約は取りやすい」

という逆インセンティブを作ってしまいます。

正直、これは長期的にかなりまずいトレンドだと思います。

開発者側のリスク:ポリシーによる「見えないAPIブレイク」

今回のAnthropic問題は、コード的には何も壊れていません。

Claude 4.6 SonnetもClaude Codeも普通に動く。

でも、実際には

- RFPで「高リスクベンダーに指定されていないこと」条項

- 監査で「なぜAnthropicを使っているのか?」説明要求

- 「防衛系・重要インフラではAnthropic禁止」という内規

がじわじわ広がると、

- 特定ベンダー前提で組んだアーキテクチャが、

一夜にして「コンプラ違反予備軍」 になる - 後からOpenAIや他モデルへの切替を迫られ、

プロンプト・設計・ワークフローの大改修が必要になる

という「ポリシー由来のブレイキングチェンジ」が発生します。

APIは互換でも、組織の規約が非互換。

これ、かなりタチが悪いです。

それでもClaudeを使うべきケース、避けるべきケース

じゃあ現場としてどうするか。

ぶっちゃけを言うと、現時点の自分の結論はこうです。

政府・防衛・重要インフラ直結の案件

- プロダクションでAnthropic依存は かなりリスク高い と見ます

- 具体的には、

- 直接の政府案件

- 防衛・インテリジェンス関連の下請け

- 電力・通信・金融など、明確に「クリティカルインフラ」扱いの領域

ここでClaudeを中核に据えるのは、

正直「ポリシー変化リスク」を取りすぎです。

現実解としては、

- OpenAI + Azure

- もしくは、Google系(Vertex)や、政府指定のオンプレ・自前モデル

をメインに据えつつ、

- どうしてもClaudeの能力を使いたい場合は

明確にサンドボックス化された補助的ツール として位置づける

(本番経路には組み込まない)

くらいが落としどころだと思います。

商用プロダクト・社内開発支援・R&D

ここは逆に、まだまだClaudeの旨味を取りに行っていい領域です。

- 大規模リポジトリのリファクタ

- 既存プロダクトの仕様抽出/ドキュメント化

- セキュリティ以外の領域でのAIペアプロ

など、クリティカルインフラ直結でない用途なら、

Claude 4.6 Sonnet + Claude Codeをガンガン試す価値はある と考えています。

ただし、

- アーキテクチャは必ず マルチLLM前提 にする

- モデルを抽象化するレイヤーを最初から挟む

- Claude専用のプロンプト・機能に依存しすぎない

- 「Anthropicが高リスク指定されたら即切替」のパスを

設計段階から用意しておく

という「政治リスク前提の設計」はやっておいたほうがいいです。

セキュリティ用途(特に攻撃側に寄る領域)

ここはかなりグレーです。

- アラートの自動調査

- インシデントの要約・レポート作成

- ログ相関とナレッジ化

のような 防御側・運用効率化 なら、

Claudeを使う合理性は大きい。

一方で、

- エクスプロイト作成支援

- 攻撃パス自動生成

- レッドチーム用の攻撃シミュレーションの一部

みたいな領域で、

Claudeを中核に据えるのは、

正直これからどんどん「政治的に炎上しやすい領域」になっていくはずです。

自分の結論:プロダクションでの「Claude一本足打法」は、正直おすすめしない

まとめると、いまの自分のスタンスはこんな感じです。

- Claude 4.6 Sonnet / Claude Codeの技術ポテンシャルは、

開発者体験としてかなり魅力的 で、

とくに大規模コードベースには積極的に使いたい - ただし米国の国家安全保障ポリティクスが、

すでにAnthropicを「Huawei的ポジション」に追いやり始めている以上、 - 政府・防衛・クリティカルインフラ直結の本番環境で

Anthropic単独依存は リスクが高すぎる - 商用・R&D用途でも、

マルチLLM前提の設計をしておかないと、後から痛い目を見る可能性が高い

正直なところ、いまの答えはこうです。

「プロダクションでClaude一本で行くか?

正直、まだ様子見です。

ただし開発効率を上げる“ツール”としては、

いまのうちに徹底的に触っておく価値は大きい。」

AI時代のアーキテクチャ設計は、

もはや「レイテンシ/コスト/精度」だけでは足りません。

- そのベンダーがどんな政治的ラベリングをされているか

- 2〜3年後に「国家安全保障リスク」として

調達NGを食らう可能性があるか - そのとき、どれだけ簡単に別スタックへ逃げられるか

まで含めて、初期設計で織り込む時代 に入ったと感じています。

エンジニアが書く設計ドキュメントに、

「Geopolitical Risk」の章が増える日も、

そう遠くないのかもしれません。

コメント