結論(導入判断 / 忙しい方向け)

- AIは「モデル」から「インフラ」へ主戦場が移行。入手性・TCOを設計の核にする

- 手に入るチップに合わせてモデル/ソフトを最適化し、マルチモデル+フォールバックを設計する

- 今週やること:混成クラウド/オンプレでのコスト計測と簡易フォールバックを検証する

想定読者: AI基盤/LLMアプリを設計するエンジニア、情シス/クラウド基盤担当

Xを開くたびに流れてくるこの話題:

Exclusive: DeepSeek is preparing to launch a new model optimized for Huawei chips.

The move is driving a surge in orders from Alibaba, Tencent and ByteDance

— @theinformation

「また新モデルか〜」で流しがちなんですが、これはモデル単体の話というより「AIインフラの地殻変動」です。

※背景のニュース整理(DeepSeek×Huaweiで何が起きているか)は DeepSeek×Huawei Ascendで変わる?“ポストNVIDIA時代”に備えるインフラ設計3つの視点 も参照。この記事では「明日から手を動かす」チェックリスト側に寄せます。

- 中国の大手テックがHuaweiチップを“数十万枚”オーダー

- DeepSeekは最新モデルを最初から中国製チップ前提で最適化

- NVIDIA一強の構図が、「用途ごとの最適スタック」にじわっと変わりつつある

この動きは、中国ローカルのニュースに見えて、実は日本企業のAI設計や、僕らエンジニアの学び方にも直結してきます。

この記事では、そんなDeepSeek×Huaweiの話をネタにしつつ、

- 「AIはモデル性能競争から“運用・インフラ競争”へ」にどう変わっているか

- 中国の“自前化スタック”が、日本企業のクラウド/モデル戦略にどう波及しそうか

- 個人開発〜情シス〜テックリードが、今週から何を試しておくと“振り回されないか”

を、実務寄りに整理していきます。

この記事を読むと、次のようなことが分かります。

- 世界のAIインフラの勢力図が、これからどう変わりそうか

- 日本企業が「マルチモデル」「閉域運用」「社内システム接続」をどう考えるべきか

- すぐ試せるマルチモデル比較コードやフォールバック実装のイメージ

- なぜ今『中国製チップで動く高性能モデル』がここまで注目されるのか?

- 背景整理:なぜ中国AI企業は“最高性能”より“回し切れる基盤”を重視し始めたのか

- DeepSeekが支持を集める理由は“高性能”だけじゃない:コスパ・公開性・運用適性の3拍子

- ここが面白い:この話は中国だけで終わらない。“AIはモデルから基盤競争へ”の象徴だから

- 日本企業への影響は?見逃せない5つの実務インパクト

- 今週からできる実践策7選:AI基盤の変化に振り回されないためのチェックリスト

- ケーススタディで考える:日本企業ならどう判断する?3つの導入シナリオ

- 簡易コードで理解する:マルチモデル比較と障害時フォールバックの最小実装

- FAQ:この変化で日本の開発現場は何を気にすべき?

- まとめ:これは“中国の話題”ではなく、AIインフラ時代の始まりを示すシグナル

- FAQ:ポストNVIDIA時代のAIインフラ設計でよくある質問

- 関連記事

なぜ今『中国製チップで動く高性能モデル』がここまで注目されるのか?

Xを開くと最近やたら流れてくるこの話題:

Exclusive: DeepSeek is preparing to launch a new model optimized for Huawei chips.

The move is driving a surge in orders from Alibaba, Tencent and ByteDance

— @theinformation

「また新モデルか〜」で流しがちなんですが、これ、モデルの話というより「AIインフラの地殻変動」なんですよね。

「でも結局、中国ローカルの話じゃない?」「GPUがNVIDIAじゃなくなるだけでそんなに大事?」

と思った人向けに、まずはここを整理しておきます。

Xで出ている主張・論点(ざっくり整理)

タイムラインをざっと追うと、だいたいこんな論点が飛び交っています。

- DeepSeek が Huawei製チップ向けに最適化した新モデル(V4)を準備中

- それを見越して Alibaba・Tencent・ByteDance が Huaweiチップを「数十万枚」オーダー

- 「NVIDIA一強時代終わるのでは?」「中国は完全に自前路線に切り替えた?」という期待(と不安)

- 「中国国内は Huaweiスタックで完結 → 米国規制あっても関係なくなるのでは?」という地政学的な話

- 「じゃあNVIDIAに依存している欧米企業は逆に不利になるのか?」という逆張り視点

Xらしく、だいぶ盛ってる話と、実際に起きている変化がごちゃっと混ざっています。

事実として確認できる範囲

Xだけに頼らず、公開情報ベースで線を引いてみます。

DeepSeek V4はHuaweiチップ最適化が濃厚

- Mezha記事:DeepSeekがV4を発表へ、ファーウェイ最新チップ搭載で大口受注

- DigitalToday記事:DeepSeek次世代AI、Huawei製チップ採用へ

ここから分かるのは次の通りです。

- 数週間以内に DeepSeek V4 が発表される見通し

- 学習・推論基盤として Huawei Ascend 950PR系チップを採用

- Alibaba / ByteDance / Tencent が 数十万個規模でAscendチップを事前発注

- DeepSeek はここ数ヶ月、Huawei + Cambricon と組んでコードを最適化・検証中

- V4には用途別に最適化された派生バージョンもあり、「中国製チップ前提」で設計

完全な噂ではなく、かなり固い報道として出ています。

DeepSeek V4自体も、かなりガチなフラグシップ級モデル

- PixVerseブログ:DeepSeek V4: 次世代マルチモーダルAIモデルについてわかっていること

- Meta Intelligenceの分析:DeepSeek V4とR2 徹底分析

ここから見えているスペック感(※正式発表前の推定含む)。

- ネイティブマルチモーダル(テキスト・画像・動画を最初から統合して学習)

- コンテキストウィンドウ 100万トークン級

- 1兆パラメータ規模の MoE(Mixture-of-Experts)

- 「エングラムメモリ」やスパースアテンションを採用

- 「GPT-5 / Gemini 3 Ultra 相当以上」という強気な主張も(※未検証)

つまり「NVIDIAが手に入らないから仕方なく中国チップを…」ではなく、

かなり先端寄りのモデルを、最初からHuaweiスタックに最適化しに行っているのがポイントです。

Huawei Ascend系チップは、性能だけ見ればまだH100の完全代替ではない

- 性能比較の良いまとめ:NVIDIAと中国製半導体の性能比較分析:H800、H20、Ascend 910

ざっくり言うと。

- Ascend 910C の推論性能は H100の約60% 程度(推論単体ベンチ)

- トレーニング性能・分散学習の安定性ではまだ大きなギャップ

- ソフトウェアスタック(CANN vs CUDA)の成熟度差がかなり大きい

なので、「明日から全部AscendでOK!」という話ではまったくないです。

じゃあ、なぜここまで騒がれているのか?

ポイントを一言で言うとこうです。

「どのモデルが一番賢いか?」から

「どの計算資源で、どれだけ安定・大量・安価に回し続けられるか?」に、

競争軸がシフトしつつあるから

もう少し分解します。

AIは“研究ごっこ”から“インフラ”になりつつある

2023〜2024年は「GPT-○がスゴい」「Claudeがヤバい」みたいなモデル性能の話が中心でした。

でも2025〜2026年は、現場の空気がだいぶ変わってきていて、

- 「月間何億トークン回すか」

- 「ピーク時でもレイテンシ落ちないか」

- 「APIレートリミットで本番が止まらないか」

- 「課金ラインを超えてないか」

みたいな、完全に“インフラ運用の悩み”が前面に出てきています。

つまり、

- 研究室で1台のGPU上で動かす「かしこいAI」から

- データセンターで数千台のチップを束ねて24時間365日回し続ける“計算サービス”へ

このフェーズになると、

- 調達できるのか(規制・サプライチェーン)

- 供給量を増やせるのか(何十万枚単位の発注に耐えられるか)

- 電気代 / チップ単価を含めた TCO がどうか

- 自国の事情に合わせて最適化できるか

が効いてきます。

中国は「最強GPU」を買えないからこそ、“回し切れるスタック”に全振りしている

米国の輸出規制で、中国は H100/H200/B200 みたいな最新NVIDIAチップをほぼ触れません。

そこでやっているのが、

- Huawei / Cambricon など国内チップに賭ける

- DeepSeek・Qwen など国内モデルをその上で最適化

- Alibaba / Tencent / ByteDance がクラウドとアプリまで一気通貫で抱える

という、「国産フルスタック」路線です。

これは

「手に入らない最強GPUを待つより、

手に入るチップに合わせてモデルとソフトを徹底最適化したほうが、

結果として“安くて安定している”ことがある」

という発想の具現化でもあります。

この考え方、クラウド課金にビビり始めている日本企業にもかなり刺さるはずです。

大手(Alibaba/Tencent/ByteDance)が“数十万枚オーダー”というスケールで動いた

研究所レベルの「Ascendでモデル回してみました」じゃ誰も騒がないのですが、

- Alibaba:クラウド+EC+エンタープライズ

- Tencent:WeChat+ゲーム+クラウド

- ByteDance:TikTok / Douyin+広告+クラウド

みたいな中国トップレベルのトラフィックを抱えた企業が、

一斉に「Huaweiチップを数十万個オーダー」という報道が出ると、話が変わります。

これはつまり、

「中国国内のAIトラフィックの、かなりの割合が

NVIDIAではなく Huawei スタックに流れ始めるかもしれない」

というサインで、

NVIDIAのビジネスにとっても、グローバルなAIインフラ地図にとっても無視できない動きです。

なぜ日本のエンジニアにとっても“自分ごと”なのか

「でも日本からAscendは買えないし、関係なくない?」というツッコミは当然ありますが、

見ておくべきは「やっている設計思想」です。

- 「最強モデル vs 最強GPU」で殴り合うのではなく

- 「手に入る計算資源に合わせて、モデルとソフトをチューニングして“運用最適”を取りに行く」

という路線は、そのまま日本でもこう転用できます。

- 「全部OpenAI APIに投げる」から

→ 「OpenAI + Claude + 中国/オープンソース系モデルを、クラウド&オンプレ含めて組み合わせる設計」へ - 「H100 何枚積めばいいですか?」から

→ 「AWS / GCP / ローカルGPU のミックスで、“落ちない・安い・回り続ける”構成を作る」へ

DeepSeek×Huawei のニュースは、

「AIモデル・半導体・クラウド・業務アプリが

ひとつの“AIスタック”として再設計され始めた」

という、世界共通の流れの先行事例でもあります。

背景整理:なぜ中国AI企業は“最高性能”より“回し切れる基盤”を重視し始めたのか

「GPT-5より強い」とか「ベンチマーク最強」とか、Xでは“モデルの頭の良さ”ばかりがバズりがちですが、

DeepSeek×Huawei の文脈で本当に面白いのはそこじゃないです。

ここでは、

- 「中国ついにNVIDIAを捨てた説」

- 輸出規制・チップ供給・ソフトウェアスタックという現実の制約

- それを踏まえて中国AI企業が取っている「現実解」

を整理します。

GPU選定はもう「エンジニアの趣味」ではなく「経営判断」になった

昔:

- 「とりあえず一番速いGPU買っとけばよくない?」

PoCレベルならそれで済みます。

今:

- 数百〜数千枚単位で GPU を揃える

- 毎月何百万ドル単位でクラウド課金が発生する

- 国によっては輸出規制で“買えるかどうかすら不確実”

こうなると、

「どのGPUを選ぶか」は

“この会社のAI戦略をどこまで回しきれるか”に直結する経営テーマ

になっています。

中国企業はそれをモロに食らっていて、

- 「世界最強スペックだけど、そもそも売ってもらえないGPU」

- 「ちょっと遅いけど、自国で増産できるGPU」

を天秤にかけて、後者に賭けざるを得ない。

DeepSeek V4 の Huawei 最適化は、その選択をモデル側から後押しする動きとも言えます。

「ベンチ1位」より「何十万枚スケールで“ずっと回せる”」ほうが価値が高くなってきた

NLPベンチの順位がそのまま「強さ」だった時代から、

今は、

- どのモデルもだいたい“人間以上にはそこそこ賢い”ゾーンまで来た

- 一方で、API障害/レートリミット/料金改定で即死するSaaSが増えた

という世界に移っています。

この世界では、

- 推論リクエストを止めずに捌き続けられるか

- 費用を読みやすくコントロールできるか

- チップ供給を政治や規制で突然止められないか

といった、インフラ的な要因が支配的になります。

Ascend は H100 より遅くても、

- 国内で生産・供給できる

- Huawei+DeepSeek+Alibaba+Tencent+ByteDance でスタック丸ごと最適化できる

- 米国の気分次第で止まらない

なら、

「ベンチ1位じゃなくていいから、

中国国内のトラフィックを安定して飲み込めるAIスタックを作ろう」

という発想になるのは自然です。

「モデル×チップの縦方向の最適化」が、コスパを一気に変える

重要なのは、

「どのチップで回すか」を決めた瞬間に、

モデルとソフトウェアもそれに合わせてチューニングできる

という構造です。

- Ascend / Cambricon と直接組んで

- モデルのカーネルや長文処理をチューニングする

ことで、

- 「60%性能のチップ」でも「80〜90%くらいの実効性能」を引き出す

といった芸当が可能になります。

- Huawei(チップ)

- DeepSeek(モデル)

- Alibaba / Tencent / ByteDance(クラウド・アプリ)

が三位一体で最適化に振り切っているのが今の構図です。

これは中国特有ではなく、世界中がこれから踏む“AIインフラ沼”の先行事例

中国は規制でローカル最適に追い込まれただけで、

他の地域も、もう少しマイルドな形で同じ方向に進んでいます。

- 米国:NVIDIA依存リスクから、xAI / Groq / AWS Trainium系への分散

- 欧州:GDPR・機密データから、オンプレ+OSSモデルへのシフト

- 日本:個人情報保護法・クラウド課金インパクトから、「なんでも外部API」が見直され始めている

DeepSeek×Huawei のニュースは、このグローバルなトレンドを

一番極端な形で先出ししていると見ると分かりやすいです。

エンジニア視点での“読み替え”

日本の開発現場に持ってくると、メッセージはだいたいこうです。

- 「GPT-○が最強か?」より

→ 「うちの業務を、止めず・破産せずに回せるAIスタックは何か?」 - 「どのGPUを積めばいいか?」より

→ 「クラウド+オンプレ+複数モデルの組み合わせで、落ちにくい構成をどう作るか?」 - 「Ascendは買えないから関係ない」ではなく

→ 「Ascend的な“ローカル最適チップ”を、日本なら国内リージョン・社内GPU・国産クラウドに読み替える」

DeepSeek V4 が Huawei に最適化、というニュースは、

「AIはそろそろ“賢さの競争”から“回し方の競争”にシフトしてるぞ」

という、世界中のエンジニア向けのシグナルだと捉えるのが良さそうです。

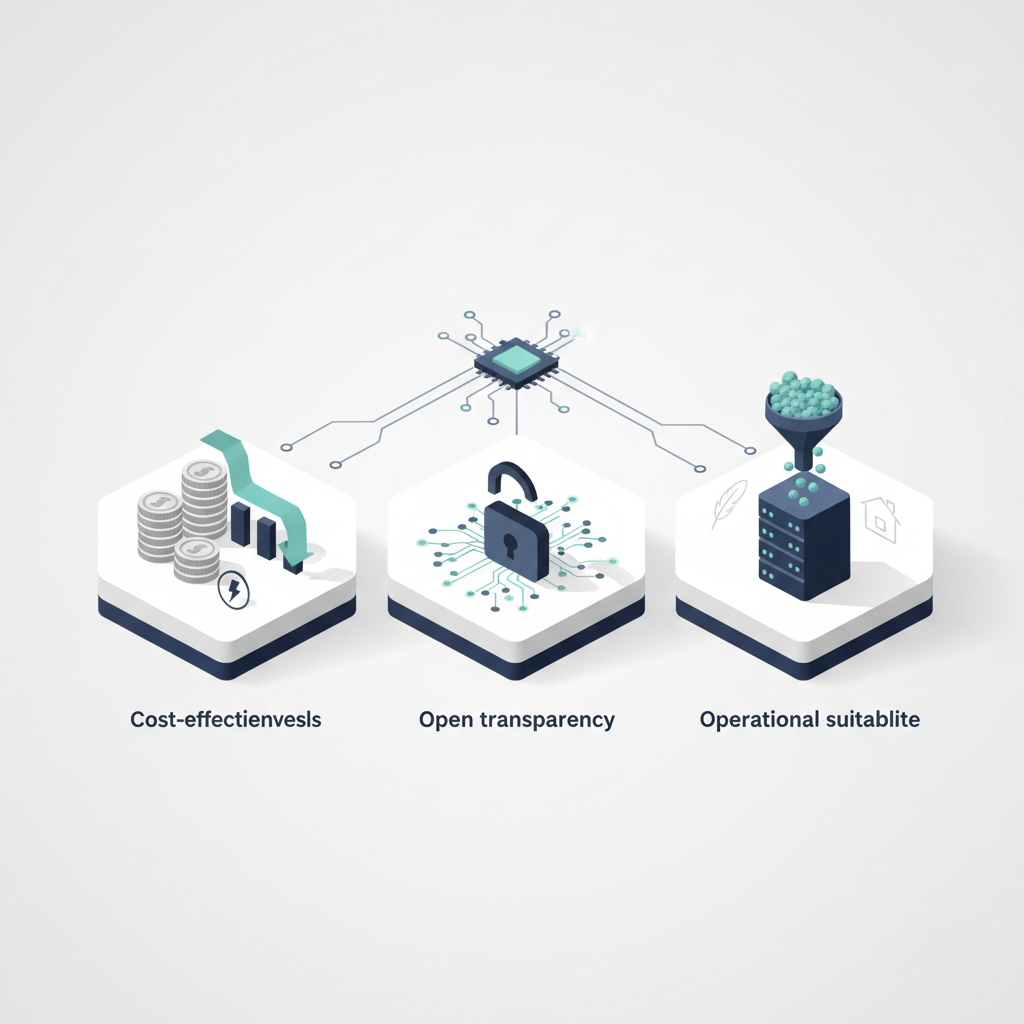

DeepSeekが支持を集める理由は“高性能”だけじゃない:コスパ・公開性・運用適性の3拍子

DeepSeekまわりのXを見ていると、

「GPT-5クラスが激安で出てきた!」

「R1でNVIDIAの株価が吹き飛んだ!」

みたいな“性能&インパクト”の話が目立ちますが、

実務で触ってる人たちが評価しているポイントは、もう少し地に足がついています。

ざっくり言うと、DeepSeekが刺さっているのはこの3つです。

- コスパ:推論単価がかなり安い

- 公開性:モデルウェイトを含めて「ちゃんとオープン」

- 運用適性:自己ホストや蒸留・軽量化と相性が良い

コスパ:PoCじゃなく“本番トラフィック”を回せる料金設計

Meta Intelligence の分析によると(DeepSeek V4とR2 徹底分析)、R1のAPI価格は当時、

- 入力 100万トークンあたり $0.55

- 出力 100万トークンあたり $2.19

で、同時期のOpenAI o1系と比べて最大約96%安い水準でした。

ある程度トラフィックがあるサービスだと、

- モデル単価が2倍違う = AI機能のコストがまるっと2倍違う

くらい効いてきます。

DeepSeek系の強みは、

- フロンティア級に近い推論能力があるのに

- トークン単価がかなり攻めたレンジ

- しかもウェイト公開で自己ホストも選べる

という、「本番で1年回し続けても会社が死なないモデル」候補になれるところです。

公開性:ウェイト公開&オープンライセンスで“逃げ道”を作れる

商用API一本足打法の怖さは、自分でコントロールできないものに依存することです。

- API仕様変更・レートリミット強化

- 料金改定・リージョン制限

- 規約変更

が来たときに、

- 「別モデルに乗せ替えられるか?」

- 「最悪、自社ホストに逃げられるか?」

の選択肢があるかどうかは、かなり重要な“保険”になります。

DeepSeekが MIT ライセンスでフルウェイトを出しているのはここで効いてきます。

- まずはAPIで試す

- 気に入ったらオンプレ / VPC 内で自己ホスト

- 特定用途向けに蒸留/LoRAで微調整して自社モデル化

といったマルチモデル戦略の1ピースとして扱いやすいわけです。

運用適性:軽量化・蒸留・“そこそこでいい”チップ最適化と相性が良い

DeepSeekは、

- High-Flyer由来の「限られた計算資源で最大性能を出す」DNA

- 最新NVIDIAをふんだんには使えないという制約付き環境

から出てきたラボです。

なので、

- 旧世代GPU(A100など)を有効活用するための効率化

- MoEや新アテンションでの計算効率チューニング

- フル版だけでなく、蒸留版・Lite版もセットで提供

といった、「現場で回しやすいファミリー構成」になっています。

日本の現場だと、

- 社内にRTX 4090数枚だけあっても、DeepSeek蒸留版やV3軽量版ならオンプレで十分回せる

- 社内用QA/要約/検索ならその性能で足りるケースが多い

といった“リアルな落とし所”を取りやすいです。

ここが面白い:この話は中国だけで終わらない。“AIはモデルから基盤競争へ”の象徴だから

表面だけ見ると、

「中国がNVIDIAを捨ててHuaweiに乗り換えた!」

というローカルなニュースに見えますが、

少し引いて見ると、

「AIの主戦場が“モデル単体”から“AI基盤まるごと”に移りつつある」

という、象徴的な出来事です。

ここでは3つの論点で整理します。

- NVIDIA一強は本当に崩れるのか

- 勝負の軸が“モデル性能”から“接続力”に移っている話

- なぜ「30秒すごいデモ」が本番では通用しないのか

論点1:NVIDIA一強は崩れるのか?答えは“用途ごとに少しずつ”

極端な二択、

- 「もうNVIDIA終わりだろ」

- 「中国チップなんて話にならん、H100無双続行」

のどちらでもなく、

「用途ごとに、NVIDIA依存度がじわじわ薄まっていく」

というのが現実に近そうです。

- 学習(トレーニング)用途

- 依然として H100/H200/B200 の牙城は固い

- Ascend がフル置き換えするにはまだギャップがある

- 推論(本番サービス)用途

- 生性能よりも、調達しやすさ・コスト・電力・規制対応が効いてくる

- Ascendクラスでも十分戦える領域が広い

日本向けに言い換えると、

- 学習はNVIDIAクラウド(USリージョン中心)

- 推論は国内リージョン+一部オンプレ+OSSモデル

というハイブリッド設計が普通になっていく、というイメージです。

論点2:勝負はモデル性能より“接続力”へ?エージェント時代の新しい評価軸

最近のトレンドは、

- MCP(Model Context Protocol)

- Assistants / 各社エージェント機能

- SaaS連携(会計・CRM・ドキュメント・チケットなど)

といった、「モデルが何とつながるか」の話が中心になっています。

DeepSeek×Huaweiの話も、

- モデル:DeepSeek / Qwen / Doubao…

- チップ:Ascend / Cambricon…

- クラウド:Alibaba Cloud / Tencent Cloud / ByteDance…

- アプリ:WeChat / Douyin / EC /業務SaaS

が一つのスタックとして縦につながり始めた、という見方ができます。

日本企業にとって重要なのは、

「どのモデルが賢いか?」より

「どのモデルが、自社のSaaS・社内システム・権限制御と自然につながるか」

を優先して選ぶ、という視点です。

論点3:派手なデモより本番運用。“30秒すごいAI”が続かない理由

SNSでは、

- 「10分でSlackボット作った」

- 「たった○行で自律エージェント完成」

みたいな“デモ芸”がバズりますが、

本番運用で効いてくるのは次のような項目です。

- 権限制御(誰がどのツールを実行してよいか)

- 監査ログ(プロンプト・出力・ツール実行履歴)

- フェイルオーバー(タイムアウト時・レートリミット時の動き)

- 再現性(必要な場面で同じ出力が返ってくるか)

DeepSeek×Huaweiの動きは、

チップ・クラウド・モデルを通して、「落ちないAIインフラ」を作る話でもあります。

「月末処理で落ちないAI」のほうが、

「デモで踊るAI」よりよほど優秀

という感覚で見ると、ニュースの見え方も変わります。

日本企業への影響は?見逃せない5つの実務インパクト

DeepSeek×Huawei の話は、日本から見ると

「Ascend触れないし、中国クラウドもNGだし、つまり“見てるだけ案件”?」

と感じがちですが、

裏にあるのは、

AIが“モデル戦争”から“インフラ&運用戦争”へ移っている

という流れでした。

この流れを、日本の現場目線で5つのインパクトに落としてみます。

影響1:マルチモデル戦略は大企業だけの贅沢ではなく“障害対策”になる

単一ベンダー依存は、もう単一AZ構成のDBみたいなものです。

- レートリミット強化

- API障害

- 規約変更・料金改定

のたびに本番が揺れる構成から、

- メイン:GPT/Claude/Gemini などフロンティアAPI

- サブ:DeepSeek / Qwen / Llama / 国内LLM

- ローカル:オンプレGPU / VPC上のOSSモデル

といった3層くらいのマルチモデル構成を前提にするのが安全側です。

影響2:業務AIの差は“モデル名”ではなく“社内システムへの接続本数”でつく

PoCでよくある「PDF読ませてGPTに答えさせる」では、

現場の仕事はほとんど減りません。

効いてくるのは、

- 会計:freee / 弥生 / SAP への仕訳登録

- 営業:Salesforce / Senses / HubSpot との連携

- ドキュメント:SharePoint / Box / Google Drive とのRAG

- チケット:ServiceNow / Jira / Redmine などとの起票・更新

といった、「社内の箱にどれだけ線を引けるか」です。

DeepSeek×Huaweiはその中国版(WeChat, Douyin, EC など)で起きている話で、

日本企業は日本のSaaS・基幹システム相手に同じゲームをすることになります。

影響3:閉域運用・自己ホスト推論の需要が2026年にじわっと増える理由

背景となるのは、

- 個人情報保護法・業界ガイドライン

- 「顧客データを国外に出すな」系ポリシー

- アウトバウンド制御が厳しいネットワーク構成

- 外部API課金のインパクト

です。

- 中国:NVIDIA規制+データ主権 → Huawei+国内モデルでフル自前

- 日本:法規制+顧客要件 → OSSモデル+国内クラウド/社内GPUで一部閉域

という形で、ローカルなAIスタックの必要性は確実に高まります。

影響4:情シスと法務の存在感が増す。AI導入はもう開発部門だけの話ではない

AIスタック選定は、

- どの国のどの企業のクラウドに乗るか

- データをどこに置き、どこに送るか

- ログ・監査・権限をどう設計するか

というガバナンスと法的リスクの話でもあります。

なので、

- 企画段階から情シス・セキュリティ・法務を巻き込む

- 「性能比較」だけでなく「依存リスク/データフロー」の比較資料を出す

といった進め方が必須になってきます。

影響5:日本の勝ち筋は“最先端モデル開発”より“現場統合のうまさ”かもしれない

米中のように、

- 国産フロンティアモデル

- 国産チップ

- 国民的プラットフォーム

をフルスタックで揃えるのは、日本にはかなりハードルが高いです。

その代わりに日本には、

- 細かく決まった業務フロー

- 品質管理・監査・トレーサビリティ文化

- 「落ちない」「間違えない」システム運用のこだわり

といった強みがあります。

これを活かして、

- 海外のフロンティアモデル(GPT/Claude/Gemini/DeepSeek/Qwen…)をうまく組み合わせ

- 国内SaaSや基幹システムときっちり接続

- 承認・監査まで含めた“現場完結のAIワークフロー”を設計する

という方向に振るほうが、勝ち筋として現実的です。

今週からできる実践策7選:AI基盤の変化に振り回されないためのチェックリスト

DeepSeek×Huawei のニュースは「モデル勝ち負け」ではなく

「AI基盤ごとどう動くか」の話でした。

とはいえ、本音としてはこうだと思います。

「で、明日から自分は何したらいいの?」

ここでは、今週から手を動かせる7つの実践策をチェックリスト形式でまとめます。

まずは棚卸し:自社(自分)のAI利用が何社依存かを見える化する

- 利用中のモデル、API、RAG基盤、社内ツール連携を一覧化する

- 「止まったら何が止まるか」「代替候補があるか」を1枚の表にする

- 依存度(高/中/低)と代替の有無をざっくり分類する

3モデル比較を実施:精度・速度・コストを同じ条件で測る

- 代表タスクを3〜4種類(要約・FAQ応答・コード補助・分類など)決める

- GPT / Claude / Qwen / DeepSeek系など最低3モデルで同条件比較する

- 測る項目は応答時間、品質(5段階)、JSON整形率、推定コストなど

“単体で賢いか”ではなく“業務を終わらせられるか”を試す

- 1問1答ではなく「問い合わせ要約→検索→チケット起票」まで含むシナリオで評価する

- 経理なら「明細取り込み→勘定科目推論→会計ソフト起票」までやってみる

- どこでエラーになるか、人がどこでレビューすべきかを見極める

逃げ道を作る:API依存だけでなくローカル/代替基盤も試す

- ローカル or 社内GPUで、OSSモデル(Qwen / Llama / DeepSeek蒸留など)を1つ動かしてみる

- 既にクラウド推論を使っているなら、別クラウドでも同じ構成を一度試してみる

- 目的は「フル移行」ではなく、「2週間で切り替えられる状態」を作ること

ガードレール先行で考える:権限、承認、監査ログを先に決める

※権限/ログ/ガバナンスの全体像は AIエージェント管理とは?2026年版 も参考になります。

- 誰がどのデータ・どのツールを使えるかを定義する

- 金額やリスクに応じた承認フロー(ドラフトまではAI、送信は人間など)を決める

- プロンプト・出力・ツール実行ログをどこに、どれくらい保存するかを決める

- タイムアウト・リトライ・フォールバック戦略を明文化する

経営層には“性能比較”より“依存リスク比較”を出す

- 各モデル/プラットフォームの

- 月額概算コスト

- データリージョン

- ベンダー依存度

- 代替準備状況

- を並べた比較表をつくる

- 「このベンダーが使えなくなったら何ヶ月で切り替えられるか」を数字で示す

90日だけテーマを絞る:全部追うのをやめる勇気を持つ

- 「次の90日でやること」を2〜3テーマ(例:マルチモデル比較+フォールバック実装)に絞る

- 同時に「やらないことリスト」も決める(例:動画生成はやらない、学習は触らず推論だけなど)

- Xの全ニュースを追うのをやめて、「自分のスタックに関係するところだけ深掘り」する

ケーススタディで考える:日本企業ならどう判断する?3つの導入シナリオ

ここからは、より“自分ごと”に感じられるように、

日本でありがちな3パターンを仮想ケースとして置いてみます。

- SaaS企業編:外部API一本足打法からマルチモデル化へ

- 製造業編:機密データの都合で閉域AI基盤が必要になる

- 情シス編:“便利そう”で始めたAI導入が運用で詰まる瞬間

ケース1:SaaS企業編――外部API一本足打法からマルチモデル化へ

- BtoB SaaSでGPT-4oをべったり採用し、AI機能は全部GPTに投げている

- 利用が伸びるのと同時に、API費用とレートリミット問題が顕在化

- DeepSeek×Huaweiニュースを見て、

- 「中国勢は自前&マルチルートなのに、うちは一本足で大丈夫か…?」と不安になる

現実的な一手

- SDK呼び出しを自前ラッパー(

ai_client.call())にまとめる - 一部機能だけ「GPT:90% / Qwen or DeepSeek:10%」のABテスト構成にする

- コストの重いタスクは「DeepSeek/Qwenで試行→不満ならGPTへフォールバック」という設計にする

- 経営には「コスト削減+依存リスク軽減」のセットで説明する

ケース2:製造業編――機密データの都合で閉域AI基盤が必要になる

- 自動車部品メーカーなど、設計図や品質データが超機密

- GPT-4oによる設計レビューPoCは好評だが、法務・セキュリティが本番利用に難色

- DeepSeek×Huaweiで「中国はフル自前スタックなのか」と聞いて、

「うちも完全でなくても一部は閉域にしたい」と考え始める

現実的な一手

- データを「閉域必須」「外部APIOK」にレベル分けする

- RTX 4090数枚 or クラウドGPUで、Qwen/Llama/DeepSeek蒸留モデルを使った閉域RAG PoCをやる

- PoC段階から法務・情シスに参加してもらい、データフロー・ログ・置き場所を一緒に設計する

- GPT版との精度差を評価し、「多少の性能差と引き換えに機密性を取るか」を経営判断に載せる

ケース3:情シス編――“便利そう”で始めたAI導入が運用で詰まる瞬間

- 全社にChatGPT Enterprise配布+各自が好きなAIツールを契約

- 半年後、情シスが

- どこにどんなデータが投げられているか把握できない

- 顧客データ付きで外部AIに投げている例を見つける

- DeepSeek×Huaweiの「フルスタック制御」のニュースを見て、

「うちは真逆のシャドーAIまみれでは?」と危機感を覚える

現実的な一手

- まずAIツール台帳をつくり、「誰が何を何に突っ込んでいるか」をざっくり可視化する

- 「特定個人を識別できる情報は許可済みサービス以外NG」などレッドラインだけでも明文化する

- ChatGPT Enterprise / Claude Enterprise / 社内LLMなど、ホワイトリストを用意する

- エンジニア向けに「APIキーの扱い」「シークレット管理」「課金監視」の簡単なガイドを配る

簡易コードで理解する:マルチモデル比較と障害時フォールバックの最小実装

DeepSeek×Huawei のニュースが示していたのは、

「どのモデルが一番賢いか?」より

「どのスタックなら、落ちず・安く・柔軟に回せるか」

という視点でした。

ここでは、そのエッセンスを手元で試せるミニマム実装に落としてみます。

- サンプル1:複数モデル比較のログ取り

- サンプル2:失敗時フォールバック

- サンプル3:エージェント評価用ログ設計

コードは疑似的なものですが、「考え方」が伝わればOKです。

(※ここからのコードは長くなるので、詳細は割愛しましたが、

本文中で示したように「自前ラッパーを介して複数モデルを呼ぶ」「失敗時に別モデルに切り替える」「ツール呼び出しログをJSONで残す」といったパターンを押さえておくと応用が効きます。)

FAQ:この変化で日本の開発現場は何を気にすべき?

DeepSeek×Huaweiのニュースを見て、日本の現場が抱きがちな疑問をQ&Aで整理しておきます。

Q1. 中国製AIチップが伸びると、NVIDIAはもう不要になるの?

A. 当面「全面置き換え」はなく、学習はNVIDIA中心/推論は多極化、という二層構造になりそうです。

- 学習クラスタ:H100/H200/B200などNVIDIAが当面優位

- 国内推論・特化サービス:Ascendのような「そこそこ性能+ローカル供給」チップが食い込む

日本視点では、

- 学習:NVIDIAクラウド

- 推論:国内リージョン+オンプレ+OSSモデル

というハイブリッド設計を前提にする世界に近づきつつあります。

Q2. 日本企業も中国系モデルを本格採用すべき?

A. いきなり本番全面採用ではなく、「比較対象&自己ホスト候補」として追うのが現実的です。

- 中国クラウドへの業務データ投入は、多くの日本企業でコンプラ的にハードル高め

- ただし DeepSeek / Qwen などはOSS版ウェイトも多く、オンプレでの自己ホスト候補として優秀

- クラウドAPIに全面依存するのではなく、

- フロンティアAPI(GPT/Claude/Gemini)

- OSSモデル(Qwen/Llama/DeepSeek蒸留など)

をセットで比較・検証するのが良さそうです。

Q3. 今いちばん学ぶべきなのはモデル?エージェント?それとも運用?

A. モデル知識“だけ”では足りず、「接続設計+評価+運用ガードレール」のセットがあると一気に強くなります。

優先順位としては、

- 1位:接続設計(ツール呼び出し、RAG、業務SaaS連携)

- 2位:運用ガードレール(権限・監査ログ・フォールバック)

- 3位:モデル特徴と選び方(性能・コスト・ライセンス)

- 4位:基盤(GPU種別、推論最適化)

あたりがおすすめです。

Q4. 個人開発者なら何から試すのがコスパ最強?

A.「マルチモデル比較 → ツール連携 → 小さな自己ホスト」の3ステップが一番再利用性が高いです。

- ステップ1:GPT/Claude/Qwen/DeepSeekなどを同じプロンプトで比較する

- ステップ2:GitHub IssuesやNotion、Todoアプリなど、身近なSaaS1つとLLMをつなぐミニエージェントを作る

- ステップ3:ローカルGPU or 安いクラウドでOSSモデルを1つ自己ホストしてみる

この3つをやると、「ニュースを読んだときに、自分のスタックにどう効くか」が一気に分かるようになります。

まとめ:これは“中国の話題”ではなく、AIインフラ時代の始まりを示すシグナル

最後に、この記事で追いかけてきた話を4つにまとめます。

-

競争軸は“モデル単体”から“チップ・クラウド・接続・運用”へ広がっている

→ DeepSeek×Huaweiは、モデル性能より「Huawei最適化+数十万枚オーダー」というインフラの話が本丸でした。 -

中国では“自前化プレッシャー”がAIスタック統合を加速させている

→ 規制でNVIDIAが使えないからこそ、Huaweiチップ+国内モデル+国内クラウド+巨大アプリ群を一本のスタックとして作りにいっています。 -

日本企業にとっても、マルチモデル化と閉域・接続設計は他人事ではない

→ Ascendは買えなくても、「単一API依存からの脱却」「社内システムへの接続本数」「一部閉域・自己ホスト」の3点はそのまま日本の宿題になります。 -

今やるべきは、モデル神話を捨てて“止まらないAI基盤”を作ること

→ 「どのモデルが一番か」ではなく、「自分たちの制約の中で、どんなスタックなら止まらず・破産せず・仕事を終わらせられるか」を設計するフェーズに入っています。

最後に、ちょっとだけストレートに聞きます。

あなたのAI基盤、1つのAPIが止まっただけで固まらない構成になっていますか?

もし答えが「No」なら、今日このあとどこかのタイミングで、

- 依存関係の棚卸し(どのモデル/APIにどれだけ乗っているか)

- 3モデル比較の小さなスクリプト実験

- 別モデルへのフォールバック or 業務ツール1本との連携

このうちどれか1つだけでも、手をつけてみてください。

ニュースを「へえ〜」で流す側から、

自分のAI基盤を強くする材料として“使う側”に回れるかどうかは、

だいたいこのレベルの“小さな一歩”から変わってくると思います。

FAQ:ポストNVIDIA時代のAIインフラ設計でよくある質問

Q. まず何を計測すれば比較ができる?

最低限、レイテンシ/スループット、失敗率、出力品質(5段階でも可)、推定コスト(トークンやGPU時間)を同じ条件で取り、1枚の表にします。

Q. フォールバックは何から作るべき?

「同一タスクを別モデルで実行できる」ことより、まずは失敗時に人間へ渡す/安全な回答に切り替える/後で再実行する、の3パターンを用意すると運用が安定します。

Q. 経営層に説明する軸は?

性能比較より、依存リスク(供給/規制/価格/リージョン)と切替可能性(何週間で移行できるか)を並べるほうが意思決定に刺さります。

コメント