「Llama 3 か Qwen 2.5 を入れるだけで週末が溶けるのに、また新モデル?」

そんな気持ちになっているエンジニア、多いと思います。

でも今回は、ちょっとだけ立ち止まってもいいかもしれません。

Google DeepMind の Gemma 4 は、「また1個モデル増えた」ではなく、エンタープライズが本気で“オープン”に振れるかもしれない境界線に見えるからです。

結論(導入判断)

- まずは比較対象の標準に入れる:Gemma 4(12B/27B)はApache 2.0+主要ランタイム対応で、企業の“オープン選択”を検討するなら外せない。

- 全面置換はまだ早い:まずは社内ツール/RAG/コード補完など部分適用で実測し、フロンティアAPIは“保険”として残す。

- 法務・運用の論点を先に潰す:自前ホスティングの運用コストと、セーフティ/ポリシー責任を織り込んで判断する。

想定読者:情シス/CTO、LLM基盤担当、プロダクト責任者(自社ホスト vs API の判断をしたい人)

いきなり結論:Gemma 4 は「Kubernetes が出てきたとき」に近い空気がある

一言で言うと、AI界の Kubernetes っぽい動きだと感じています。

- Kubernetes 前夜:

- いろんなオーケストレーターはあったけど、企業が「これにベットしていい」と言える決定版はなかった。

- Kubernetes 登場:

- Apache 2.0 で Google 謹製。

- 「これならロックインされすぎずに、でも真面目に使える」と企業が判断。

- 結果として、エコシステムが一気に標準化・加速。

今回の Gemma 4 も構図がかなり似ています。

- モデル群は 1B / 4B / 12B / 27B と「小〜中型」だが、性能は“サイズの割にフロンティア級”。

- そして何より重要なのは、全部 Apache 2.0 ライセンスで出てきたこと。

- 商用利用可

- ファインチューニング可

- 再配布可

- 変な「責任ある利用」ライセンスではなく、普通の OSS と同じノリで扱える

正直、「Google がここまで“ちゃんとオープン”をやる日は来ない」と思っていたので、これはかなり大きい転換点です。

何がそんなにヤバいのか:Gemma 4 の “現実的に嬉しい”ポイント

-1. 「バイトあたり最強」クラスの性能

Google 曰く、Gemma 4 は “Byte for byte, the most capable open models”。

つまりパラメータ数・メモリあたりの性能が頭一つ抜けている、と。

ベンチマーク的にざっくり整理すると:

- Gemma 4 27B

- MMLU, GSM8K, コード系で Qwen2.5‑32B と同等〜上回る。

- 場合によっては LLaMA 3.1 70B に迫る / 追い抜く場面もある。

- Gemma 4 12B

- 一世代前の 30B クラスのオープンモデルに匹敵、あるいは上回る。

- 24GB クラスの GPU 1枚で「かなり強い汎用モデル」が回るライン。

つまり、「でかいモデルを回すインフラ予算はないけど、しょぼい性能も困る」という現場にちょうど刺さるレンジです。

“そこそこの GPU 1枚で、それなりどころかかなり強い”。ここは現場目線だとかなり重要です。

-2. ライセンスがシンプルすぎて、法務が文句を言いにくい

ぶっちゃけ、現場として一番嬉しいのはここです。

- Apache 2.0 なので:

- SaaS に埋め込んでも OK

- モバイルアプリに組み込んでも OK

- 社内ツールのバックエンドにしても OK

- Meta の LLaMA 系みたいな、「○○以上の MAU/売上だと要相談」系の地雷がない。

日本語圏のブログでも「Google が『本気のオープン』に踏み出した日」という表現が出ていましたが、これは誇張ではなくて、

「Google が出しているから社内政治的に通しやすい」+「Apache 2.0 で法務的にも通しやすい」

という、企業エンジニアにとって最強コンボです。

-3. ちゃんと最初からエコシステムに乗っている

Gemma 4 は「重たい tarball 置いておきました、あとはよろしく」ではありません。

- 対応ランタイム:

- Ollama

- vLLM

- LM Studio

- Hugging Face Transformers / safetensors

- クラウド:

- Google AI Studio

- Vertex AI

つまり、既に LLaMA や Qwen を回しているスタックにほぼそのまま乗せられる。

モデルの差し替えコストが低いのは、採用のハードルを一気に下げます。

競合との比較で見える「Gemma 4 のリアルな立ち位置」

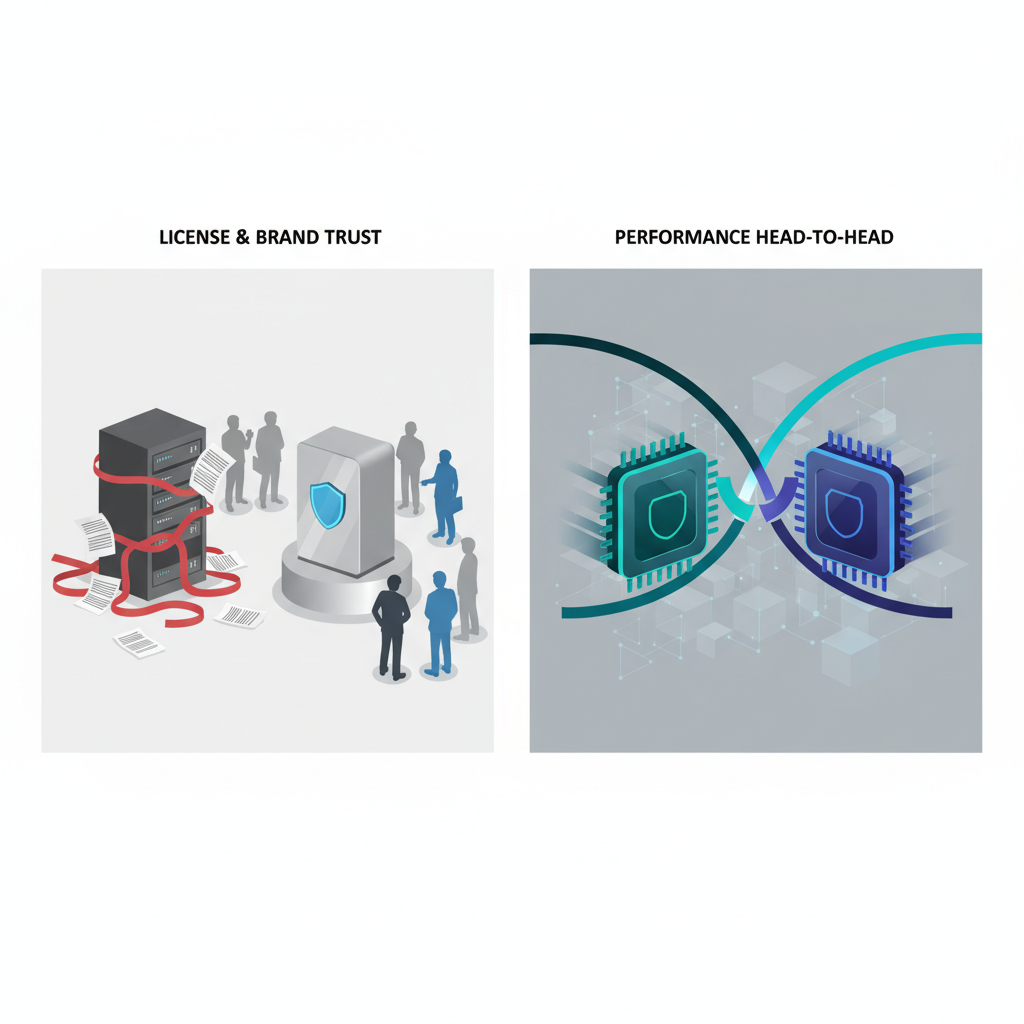

-1. Meta LLaMA vs Google Gemma:ライセンス政治の逆転

これまでオープンウェイトの主役は Meta の LLaMA 系でしたが、Gemma 4 の登場で状況が少し変わります。

- ライセンス面:

- LLaMA:商用は原則 OK だけど、条件が細かくて法務が嫌がるパターンもある。

- Gemma 4:Apache 2.0 で、法律的にはほぼ「普通の OSS ライブラリ」扱い。

- ブランド面:

- 保守的な企業にとって、「Google / DeepMind 謹製で Apache 2.0」は安心材料になりやすい。

正直なところ、「ライセンス周りめんどいから LLaMA やめて Gemma でいいじゃん」という意思決定は、

日本企業の中だとかなり現実的に起きると思います。

-2. Qwen2.5 vs Gemma 4:「性能ガチ勢」同士の殴り合い

技術的には、今のオープンウェイトで一番強いのは Qwen2.5 系だと感じている人も多いはずです。

その Qwen2.5 と Gemma 4 をざっくり比べると:

- ライセンス:

- どちらも Apache 2.0。

- ただし、「Google の Apache 2.0」 というブランドは、やはり安心感が違う。

- 性能レンジ:

- Gemma 4 27B ≒ Qwen2.5‑32B(ときどき上回る)。

- Gemma 4 12B ≒ Qwen2.5‑14B クラス。

- コスト:

- パラメータ数が少ない分、同等性能なら Gemma 側が VRAM・計算コストで有利。

中国・多言語サポートは Qwen2.5 に軍配が上がる可能性が高く、日本語も Qwen の方が有利なケースはあると思います。

一方で、英語中心のグローバル企業の「第1候補モデル」としては、Gemma 4 がかなり強い候補に躍り出た、という印象です。

-3. 「中堅プロプライエタリ API ベンダー」はかなり厳しくなる

一番影響を受けそうなのは、「GPT‑4 には負けるけどそこそこ安い LLM API」を売りにしてきたスタートアップです。

- もし Gemma 4 27B を自前ホスティングして:

- そこそこのスケールで

- きちんとオペレーション回せるなら

- 「ちょっと安い中堅 LLM API」を買う意味は薄くなる。

もちろん、自前運用のオペレーションコストがあるので単純比較はできませんが、

TCO で「Gemma 自前 vs 中堅 API」が競るケースが増えるのはほぼ間違いないと思います。

とはいえ、懸念もかなりある(ここを見落とすと痛い)

-1. GPT‑4 / Gemini Ultra の代わりにはならない

まず押さえておきたいのは、Gemma 4 はあくまで 27B 以下ということです。

- 超長文コンテキスト(数百万トークン級)

- 超複雑なマルチステップ推論

- 多言語・マルチモーダルを完璧にこなす万能エージェント

このあたりは、正直まだ GPT‑4 系や Gemini 1.5 Pro/Ultra といったフロンティアモデルの領域です。

Gemma 4 は「サイズの割に強い」のは確かですが、「全部これで置き換え」は現実的ではありません。

-2. 自前ホスティングの運用コストは普通に重い

Gemma 4 27B をオンプレでガチ運用しようとすると:

- 最低限:

- 4bit 推論でも 24GB クラス GPU。

- 余裕を持たせるなら 48GB 以上 or マルチ GPU。

- 必要な仕組み:

- vLLM/TGI 等の高効率サーバ

- オートスケール

- ログ・メトリクス・トレース

- モデルバージョニング

- 継続的なファインチューニング・評価

ぶっちゃけ、ただの API 利用よりは全然重いです。

トラフィックが少ないうちは、素直に Gemini / GPT‑4 API を叩いた方が安いし楽、というケースも多いはずです。

-3. セーフティとポリシーは「全部あなたの責任」

Gemini API を使うと、Google 側に:

- コンテンツモデレーション

- 有害出力のフィルタリング

- セーフティ評価

がある程度組み込まれています。

ですが、オープンウェイトの Gemma 4 では、そのレイヤーがすべて自分の責任になります。

- プロンプトのバリデーション

- 出力のモデレーション

- 社内ポリシーや法規制への準拠

ここを軽視すると、「性能はいいけどリスクが高すぎて本番に乗せられない」というありがちなパターンになります。

-4. モデル断片化の加速という懸念

Gemma 4 が強いのは歓迎ですが、一方で:

- LLaMA 3.x

- Qwen2.5

- Phi‑3

- Mistral 系

- そして Gemma 4

と、**「似ているけど微妙に違う」モデルがさらに増えます。

- チャットフォーマット

- ストップトークン

- ツールコーリング仕様

- トークナイザの癖

など、ちょっとした違いでアプリ側のロジックがバグる、というのはよくある話です。

フレームワーク(LangChain, LlamaIndex 等)は頑張って抽象化してくれますが、「モデルを差し替えるのはタダではない」ことは意識しておく必要があります。

じゃあ、プロダクションでどうする?(私の結論)

正直に言うと、「明日から全部 Gemma 4 に乗り換えるぞ!」というフェーズではないと思っています。

とはいえ、「様子見で完全スルー」するにはもったいないレベルの出来でもある。

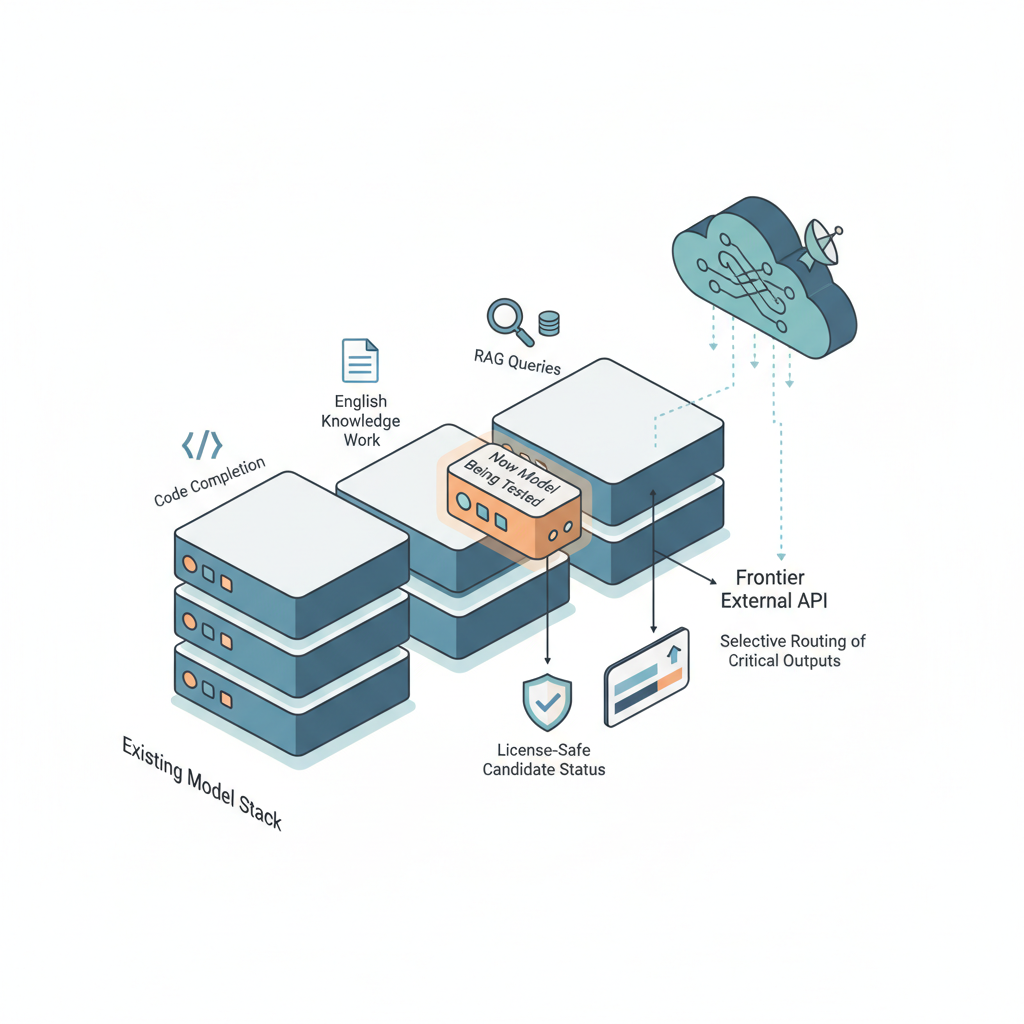

-1. 実務的なおすすめスタンス

自分が今プロダクト側にいるとしたら、こんなポジションを取ります:

- 1. まずはサイドカー的に検証環境に入れる

- 既存の LLaMA / Qwen / API ベースのスタックの横に、Gemma 4 12B / 27B を立てて比較。

- 少なくとも:

- コード補完

- 英語ベースのナレッジワーク

- シンプルな RAG クエリ

では性能を実測する。

- 2. ライセンス事情がシビアな案件では、Gemma を“本命候補”にする

- 特に B2B SaaS / エンタープライズ向け製品で、「将来のライセンス変更リスクを極力減らしたい」場合。

- 法務との議論で「Google / Apache 2.0」の名札はかなり強いカードになる。

- 3. フロンティア API は“保険”として残す

- ユーザーに見せる最終出力の一部(高度な要約・重要な判断)だけ Gemini/GPT‑4 に投げるハイブリッド構成。

- Gemma 4 はローカル・プライバシーセンシティブ・低レイテンシ用途に使う。

-2. 「今すぐ本番で全面採用か?」という問いへの答え

- プロダクション全面移行?

正直、まだ様子見寄りです。 - 長期的なモデル更新ポリシー

- 実運用ベンチ(特に日本語・業務ドメイン)

- セーフティ周りの運用コスト

このあたりが見えてこないと、「全てを預ける」のはリスクが高い。

- ただし、PoC / 部分適用の価値は高い

- 特に Gemma 4 12B は「単一 24GB GPU で本気運用できそう」という甘いスポットにいるので、

社内ツール・開発者向けコパイロット・一部ワークロードから試す価値はかなりあると思います。

最後に:Gemma 4 は「オープンモデルに本気で賭けても良いかも」と思わせる一手

Gemma 4 そのものの性能云々ももちろん大事ですが、

個人的にはそれ以上に、「Google がこのクラスのモデルを Apache 2.0 で出した」というメッセージの方が重いと感じています。

- これまでは:

- 本当に強いモデルは API(Gemini, GPT‑4 等)

- オープンウェイトは「一段落ちるが自由度は高い」という位置づけ

- これからは:

- 「トップベンダー同士が、“本気のオープンモデル”でも殴り合う時代」に入る

そうなると、エンタープライズ側も:

- 「LLM = 特定クラウド API にロックイン」ではなく

- 「オープンウェイト+フロンティア API のハイブリッドを前提にアーキテクチャを組む」

という発想にシフトしていくはずです。

Gemma 4 は、そのスイッチを押すきっかけとしては十分すぎる存在感があります。

だからこそ、完全スルーするには惜しいし、全面移行するにはまだ早い。

この微妙なバランスが、今の「ちょうどいい距離感」ではないかと思います。

FAQ:Gemma 4(Apache 2.0)導入でよくある質問

Q. まず 12B と 27B、どちらから触るべき?

A. まずは手元のGPU/予算に合わせて、12Bで回し方とユースケース適合を確認→必要に応じて27Bで品質差を測るのが現実的です。

Q. LLaMA / Qwen と比べたときの決め手は?

A. 性能だけでなく、ライセンス(Apache 2.0)とベンダー由来の社内合意の取りやすさ、既存スタック(Ollama/vLLM/Transformers等)への載せ替えコストで判断すると失敗しにくいです。

Q. いきなり本番の主要機能に使ってよい?

A. まずは“影響範囲が限定できる”領域(社内向け、下書き生成、補助回答など)から。評価指標(品質/コスト/リスク)を揃えて段階的に広げるのが安全です。

Q. セーフティやポリシー対応はどう考える?

A. オープンウェイトは基本的に自社責任です。入力バリデーション、出力モデレーション、監査ログ、禁止事項(PII/機密)の扱いを先に設計してから本番に寄せるのがおすすめです。

コメント