「自分のプロダクト、気づいたら“ただのGPTラッパー”になっていた」

そんな不安、ありませんか?

- せっかくSaaSを作ったのに、ユーザーから「これ、ChatGPTにコピペすればよくない?」と言われる

- LLM連携をゴリゴリ実装したのに、数か月後のモデルアップデートで差分がほぼ消える

- 「うちはUXで差別化!」と言いつつ、結局はテキストボックス+レスポンス画面に落ち着いてしまう

正直、ここ1〜2年でこういう相談をエンジニア仲間からかなり聞きます。

そんな中で出てきたのが、「OpenAIが約19兆円をAIスーパーアプリ構想に投下する」という話です。

結論(導入判断)

- OpenAIの「AI版iPhone+App Store」構想は本物。配布/審査/収益化などエコシステムのルールは継続ウォッチ必須

- ただし本番は「全振り」より差し替え前提(2〜3社)+コスト/規約変更リスクを織り込む設計が安全

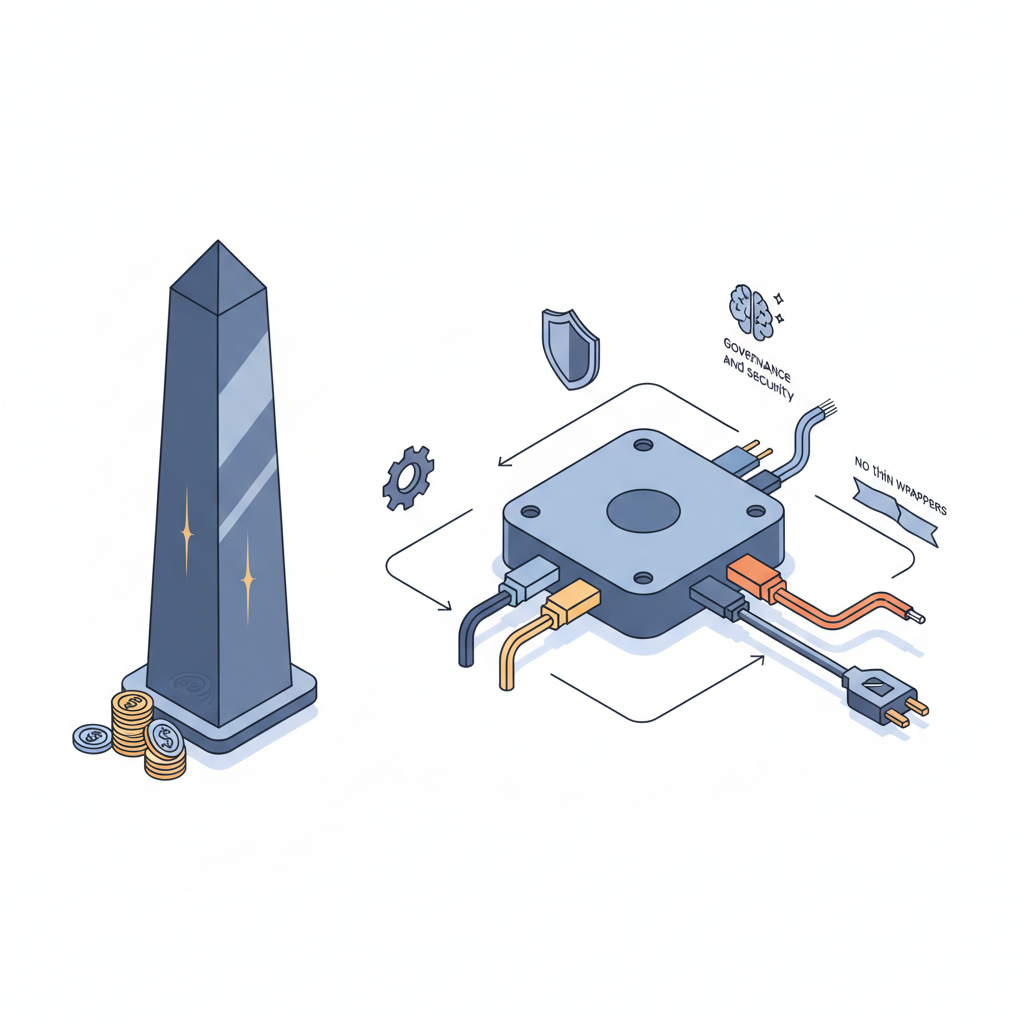

- 差別化はモデルではなく、業務ワークフロー設計・権限/監査・データ連携に寄せる(“薄いGPTラッパー”脱却)

想定読者:SaaS/プロダクト開発者、情シス、テックリード(LLMを本番導入し始めた/これからの人)

関連(先に読む):Anthropic内部文書リークで見えた「PSM」とClaude Mythos:LLM本番導入の判断ポイント / Gemini移行支援とは?ChatGPT/Claude→Gemini乗り換えの要点と落とし穴【導入判断】

一言で言うと、「iPhone+App Store をまるごとAIでやる宣言」です

一言でまとめると、この19兆円は:

「LLM APIベンダー」から「インターネットと仕事と生活のフロントドア」へ

= AI版 iPhone+iOS+App Store を自前で作りに行く

という宣言にかなり近いです。

- チップ・データセンター・電力まで含めたインフラ

- GPT系モデルそのもの

- そしてユーザーが毎日触るクライアント(ChatGPT的スーパーアプリ)

これを全部、ほぼ垂直統合で押さえに行くという読み方が自然です。

歴史的に見ると、かなり「iPhone登場前夜」に似ています。

- iPhone前:みんなキャリア公式メニュー向けにチマチマとアプリを作っていた

- iPhone後:

- 「ユーザーの入り口」がiPhoneホーム画面にほぼ一本化

- 開発者は「OSの上にアプリを載せる」側に回り、

- キャリア公式メニューに全力投資していたプレイヤーは一気に存在感を失った

今回、OpenAIが目指しているのは:

- ホーム画面 → ChatGPT(あるいはその後継スーパーアプリ)

- アプリ → GPTs / エージェント / プラグイン

- OS → モデル+ツール群+メモリ+ユーザーグラフ

という構図です。

なぜ大ごとなのか:Googleとの比較で見える「重心の違い」

OpenAIは「新しい入口を作る」、Googleは「既存の入口にAIを染み込ませる」

- OpenAI側

- ChatGPT(将来はAIスーパーアプリ)が1つの“フロントドア”になる発想

- 「何かしたいとき、とりあえずここを開く」存在を狙っている

-

ここに:

- 検索

- オフィスワーク(文書、表、メール)

- コーディング

- 個人アシスタント

- さらには買い物や予約まで

を全部突っ込もうとしている

-

Google側(Gemini)

- 既存サービスにAIを埋め込むアプローチ

- Searchの一部としての生成AI

- Gmail/Docs/Sheetsの中のGemini機能

- Android OSの中のアシスタント機能

- ユーザーはあくまで「Google検索を開く」「Gmailを開く」という行動の延長線上

正直、プロダクトの発想としては OpenAIの方が“全部乗せで新しいOSを作る”匂いが強い です。

Googleは「いまの帝国をAIで延命しつつ強化する」動きに見える。

開発者目線でいうと:

- OpenAI:

- 「新しいホーム画面の上に乗るアプリを作りませんか?」と言われている感覚

- Google:

- 「既存のGmailやDriveの中で動くアドオンを強化しませんか?」という延長

どちらがいい悪いではないですが、ビジネスの“入り口”をどこに握られるかはかなり違います。

Developer Experience:APIベンダー vs. アプリ・マーケットオーナー

- OpenAI

- すでにHTTP APIで「モデルを叩く」体験は比較的シンプル

- そこに加えて、ChatGPT内部の「GPTs / エージェント」を作れるようにしている

-

つまり:

- ① APIとして使える

- ② OpenAIのアプリ内で配布もできる

→ これはほぼApp Store + SDKの関係性です

-

Google

- Gemini API(Vertex AI等)での提供

- WorkspaceアドオンやApps Scriptでの拡張

- ただし、「Geminiアプリ1つの中にエージェントを並べる世界観」まではまだ弱い

正直、「新しいホーム画面+アプリマーケット」を握ろうとしているぶん、OpenAIのほうがプラットフォーム支配力を取りに来ているように見えます。

エンジニアとしては:

- OpenAI上にGPTs/エージェントを出す=将来の「AI版App Store」に乗る

- → 流通は魅力的だが、審査ポリシー・手数料・ランキング依存というiOS時代の悩みがそのまま来る可能性がある

この「重力の強さ」が、19兆円規模の資本と組み合わさるとかなり効いてきます。

何が起きるか:プロダクト/エンジニアリング観点での“地殻変動”

「ChatGPTで十分じゃない?」と言われがちなプロダクトは、さらに厳しくなる

19兆円を投下してスーパーアプリが強化されると、

- 「チャットUIで、入力テキストをGPTに投げて、ちょっと整形して返すSaaS」

- 「文章要約・メール草案生成・簡単なQ&Aだけをやるツール」

こういう薄いラッパー系プロダクトは、ほぼ確実に飲み込まれると見たほうがいいです。

なぜかというと:

- OpenAI自身がChatGPT内で似た機能をどんどん出す

- あるいは、他の誰かがGPTsとして同じことを0日で公開する

- ユーザーは、わざわざ別アプリを開かず「スーパーアプリ内のGPT」を選びがち

エンジニアとしては「作れるかどうか」よりも、

「ユーザーがそこにわざわざ来る理由があるか?」をかなりシビアに見る必要が出てきます。

コーディングの仕事の中身が変わる

記事でも言われている通りで、ぶっちゃけ:

- ジュニア〜ミドルレベルの「仕様に沿ってCRUDとちょっとしたビジネスロジックを書く」仕事

- APIのラッパーを作って、画面を3枚つなげる程度のSPA

このへんはかなり早いタイミングで「エージェント+ちょっとしたグルーコード」で置き換えられる可能性があります。

代わりに必要になるのは:

- どの権限でどのツールを使わせるか

- どのデータには絶対触らせないか

- どこで人間の承認を挟むか

- 失敗したときにどこまでロールバックできるか

といった、ワークフロー設計+ガバナンス設計です。

正直、「とりあえずフルスタックで一通り書けます」だけだと心許なくなりつつあるのは事実です。

バックエンドは「LLMインフラを持つ」から「LLMインフラをうまく借りる」に

19兆円規模のインフラ投資が通れば:

- 自前で大規模モデルをトレーニング/推論運用するコストとリスク

- OpenAI等の巨大プレイヤーから“電気や水道のように”LLMを借りるコスト

この差はどんどん開いていきます。

多くの企業にとっては:

- モデル運用は外部に任せ

- 自分たちは:

- データパイプライン

- ドメイン固有のビジネスロジック

- セキュリティ・権限管理

- 規制対応(監査ログ、説明責任)

に集中する形が現実解になります。

ただ、懸念点もあります…(ここ大事)

ここまで読むと「全部OpenAIに乗っかればよくない?」と思うかもしれませんが、正直、懸念もかなりあります。

コスト構造と値上げリスク

19兆円を使うのはきれいごとではなく、がっつり回収する必要があるということでもあります。

- 巨大データセンター

- チップ調達

- 電力コスト

これらはすべて、最終的にはAPI利用料金や企業向けプランに跳ね返ります。

開発者としては:

- 「プロダクトの原価のかなりの部分が“外部LLM API”」という構造になる

- その状態で値上げ・クォータ制限・利用規約変更が来たとき、逃げ道がない

というリスクがあります。

正直、プロダクションでがっつり依存するなら:

- LLMベンダーは最低でも2〜3社切り替え可能にする抽象レイヤー

- 重要機能については、fallbackの簡易モデル(オープンモデル等)も検討

くらいは最初から設計しておいたほうが安全です。

プラットフォームロックインと「AI版App Store問題」

もしChatGPTスーパーアプリが「ユーザーのデフォルト入口」になった場合:

- あなたのエージェント/GPTが

- その中の「1つのタイル」になる

- ランキング・レコメンド・レビューに依存する

- 手数料や規約変更の影響をモロに受ける

という、まさにApp Storeそのものの世界がやってきます。

- 「似た機能のファーストパーティーGPT」が突然公式に追加される

- ガイドライン変更で機能の一部が制限される

- 収益シェアが変わる

というリスクも十分ありえます。

正直、「流通の旨味」と「プラットフォーム依存リスク」はセットなので、

- コア事業は自社のUX・自社ドメインで握りつつ

- 集客用・ライトユーザー向けの“窓口”としてスーパーアプリ内エージェントを出す

くらいのバランス感覚が現実的かなと感じています。

技術的複雑さ:エージェントは「作ったら終わり」ではない

マルチエージェント+ツールオーケストレーションは、聞こえは華やかですが、実装はなかなか泥臭いです。

- 同じ入力でも挙動が揺らぐ(非決定的)

- 外部APIの失敗・タイムアウトとLLMのリトライが絡んでバグが読めない

- 「なぜその判断をしたか」の説明が難しい

- 規制産業では監査証跡・責任の所在が求められる

正直、今まで以上にログ設計・モニタリング・A/Bテスト・評価フレームワークが重要になります。

従来の「ユニットテスト+E2Eテスト」感覚で行くと、痛い目を見る可能性が高いです。

じゃあ、プロダクションでガッツリ乗るべきか?正直、まだ様子見です

エンジニア/テックリード目線での自分の結論をまとめると:

- スーパーアプリ構想そのものは、かなり本物

- 19兆円規模の投資

- インフラ〜モデル〜アプリまでの垂直統合

-

iPhone+App Store級の「入口支配」を狙っている

→ 中長期で無視するのは危ないレベル -

ただし、「全部OpenAIに乗せる」は危険

- コスト・ロックイン・ポリシー変更リスク

-

「AI版App Store依存業者」になる可能性

-

今やるべきことは “全振り” ではなく “備えること” だと思っています:

「薄いラッパー」をやめる/卒業する準備をする

- 自分たちの価値はどこにあるのかを問い直す

- 専門ドメインの知識・データ

- 他システムとの深い連携

- プロセス・ガバナンス

- 「ChatGPTにprompt書けばできること」を売りにしない

LLMベンダーは最初から“差し替え前提”で設計する

- LLM呼び出しを1箇所に抽象化する

- 提供元依存の仕様(トークン制限・レスポンス形式・ツール呼び出し仕様など)を吸収できるようにしておく

- 重要なところは、最低限他ベンダーやオープンモデルに切り替え可能にしておく

エージェント設計・ワークフロー設計の経験値を少しずつ溜める

- いきなり全部エージェント化しない

- まずは社内ツール・一部業務フローから

- どの権限を渡すと危ないか

- どこに人間の承認を置くとちょうどいいか

- 評価・ロギング・アラートの型を作る

OpenAIの「スーパーアプリ内エコシステム」のルールをウォッチする

- GPTs / エージェントの配布・マネタイズの仕様

- 審査ポリシー

- 今後の料金体系の変化

を追いながら、

- 自社は「中で戦う」のか

- 「外で自前UXを軸に戦う」のか

- あるいはそのハイブリッドなのか

を数年スパンで設計していく必要があります。

正直、19兆円という数字はインパクトが強すぎて、「なんかすごいことが起きそう」以上の思考を止めがちです。

でもエンジニアとして重要なのは、「何が自分たちの手から離れていき、何がまだ自分たちの裁量に残るのか」を冷静に切り分けることです。

- モデルそのものと巨大インフラは、ほぼ確実に“電気・水道側”に寄っていく

- でも、ドメイン理解・業務設計・データモデリング・ガバナンスは、まだまだ各社の腕の見せどころです。

プロダクションでOpenAIスーパーアプリに“全賭け”するのは、正直まだ様子見。

ただし、「その上で動く世界」を前提に設計とキャリア戦略を組み直すのは、もう待ったなしだと思っています。

FAQ(導入判断のよくある質問)

Q. 「AIスーパーアプリ」って結局なに?

A. 1つのアプリ(フロントドア)に、検索・文書作成・コーディング・予約/購買などのタスクと、ツール/エージェント配布の「マーケット」を統合する構想です。入口が一本化すると、周辺SaaSの集客やUX設計が大きく変わります。

Q. 既存SaaSはどう差別化すべき?

A. 「生成する」だけだと代替されやすいので、社内データ/権限/監査に踏み込んだ“業務プロセス”側に価値を寄せるのが堅いです(ワークフロー、承認、人間介在、ログ、連携)。

Q. ロックインを避ける最低限の設計は?

A. LLM呼び出しの抽象化、モデル/プロンプト/ツールのバージョン管理、評価(回帰テスト)と、代替ベンダー/軽量モデルへのフォールバックを用意しておくのが基本です。

Q. いま何から着手するとよい?

A. まずは「権限境界」と「失敗時の巻き戻し」を前提に、小さな業務フローからエージェント化して経験値を貯めるのが安全です。運用ログとアラートの型を先に作ると後が楽になります。

コメント