「LLMの料金レポート、見るたびに気が重くなるんだよね…」

そんな経験、ありませんか?

トークン課金を気にしてプロンプトを削ったり、PoCなのにコスト試算表を作らされたり。正直、「とりあえずガンガン叩いて試す」がやりづらいのが、ここ1〜2年のAI開発の一番のストレスだと思います。

そんな中で出てきたのが Google Gemini 3 Flash の「無料」公開。

これ、単なる「新モデル出ました」ではなくて、コストとUXのボトルネックを一段崩しにきたアップデートです。

一言でいうと:「GPT‑3.5 Turboが無料で来た」あの瞬間の再演

一言で言うと、Gemini 3 Flash はこういうポジションです:

「Google版 GPT‑3.5 Turbo / GPT‑4o mini が、本気で“デフォルトLLM”を取りに来た」感じ

歴史でいうと、

- GPT‑3.5 → GPT‑3.5 Turbo

- そして GPT‑4o mini が出てきた時、

多くのプロダクトが「重いモデルだけに頼らず、安くて速いモデルを全面採用する」方向に一気に振れましたよね。

今回の Gemini 3 Flash は、Google陣営でそのポジションをやや遅れて、本気クオリティで奪いに来たという印象です。

- 「Frontier クラスのインテリジェンス」だけど

- 低レイテンシ & 高スループットで

- 開発者にも無料枠ガッツリ開放

- 一般ユーザーにも gemini.google.com や Gemini アプリ、Workspace で無料利用

ぶっちゃけ、これは「研究用お試し無料」じゃなくて、プロダクション前提のモデルを“最初から無料で触らせにきた”動きです。

何がそんなにヤバいのか:デフォルトモデルの世代交代

「とりあえず Flash でいいじゃん」が成立する

Gemini 3 Flash は、明確にこう位置づけられています:

- 「ほとんどの本番ワークロードはこれで良い」

- 「Ultra は本当に重い推論だけに使ってね」

つまり:

- チャットボット

- 社内向けアシスタント

- RAG検索

- 書類要約・抽出

- 軽めのマルチモーダル(画像+テキスト)

このあたり全部、「まずは Flash から」で考えてよくなった。

これ、エンジニア目線だとかなりデカい変化です。

今までは、

- GPT‑4クラス:高いけど質は良い

- 3.5 / miniクラス:安いけど、挙動と品質がギリ許容ライン

だったのが、

Gemini 3 Flash は「ほぼフラグシップ級の知能だけど、3.5並みの運用感」を狙ってきている。

正直、マーケの「frontier intelligence built for speed」というコピーをそのまま信じる気はないですが、

少なくとも Google 自身が「このクラスを本気のメインストリームにするつもり」なのは伝わってきます。

競合とのガチ比較:OpenAI / Anthropic / 中間レイヤーはどうなる?

OpenAI と比べると…

機能ポジション的には、GPT‑4o mini 直撃です。

- どちらも

- 高速

- 安価(あるいは無料枠)

- マルチモーダル対応

- エージェント / ツール呼び出し向けに最適化

違いはここです:

✅ Gemini 3 Flash が有利になりそうなポイント

- Googleエコシステムとの結合度

- Workspace(Docs, Gmail, Sheets)

- Android / Chrome / Android Auto

-

YouTube, Maps, Search との統合

ここに AI が「ネイティブ搭載」されてくると、

「社内ポータルを作るより、Docs+Gmail上にGemini拡張を乗せた方が早い」みたいな世界が現実になってきます。 -

クラウドのデータ重力

- BigQuery, Cloud Storage, Vertex AI, Cloud Run…

-

既に GCP を使っているチームにとっては、

- ネットワークレイテンシ

- 認証・課金の一元管理

がそのまま効いてくる。

わざわざ別クラウド(OpenAI API)に叩きに行く理由が1個減るんですよね。

-

「Flash=安物」ではなく「Ultraの弟分」路線

- メッセージとして、「小さい別モデル」ではなく

- 同じ Gemini 3 ファミリの “高速版”

として見せている。

これは「品質」を気にするエンタープライズには効きます。

- 同じ Gemini 3 ファミリの “高速版”

✅ 逆に GPT‑4o mini(OpenAI)がまだ強いところ

- ツール・エコシステムの厚さ

- OSSライブラリ

- LangChain / LlamaIndex の「OpenAIファースト」感

- VSCode拡張、ブラウザ拡張、SaaS連携の多さ

正直、開発者コミュニティの厚みはまだOpenAIが頭一つリードしています。

- Assistants / Realtime などのAPI体験

- Meta-tools的な API(会話管理やマルチモーダルストリーミング)に関しては、

- ドキュメント・サンプルの多さ

- 実戦投入されたケース

で OpenAI が一歩前に出ている印象。

結論としては:

「どっちが“最強”か」より、「どっちをデフォルトにしやすいか」の勝負になった

そして、Googleは「無料+エコシステム統合」で殴ってきているという構図です。

「無料」は誰を一番刺すか:中間レイヤーのビジネスがきつくなる

個人的に一番インパクト大きいと思っているのは、

「LLM仲介業」みたいな中間レイヤーへの圧力です。

- 複数LLMをまとめて安く・速く・簡単に提供しますよ

- 当社のダッシュボードからプロンプト・ログを一元管理できます

- ベーシックなRAGとエージェントフレームワークも付けます

みたいなサービスって、ここ1年で爆増しましたよね。

Gemini 3 Flash が:

- エンタープライズ向けにも

- 開発者にも

- 一般ユーザーにも

無料かつネイティブにばら撒かれるとなると、

- 「安くて速いLLMを提供する」だけの価値は一気にコモディティ化します。

- そこに乗っかってるビジネスは、正直かなり厳しくなる。

今後生き残れる中間レイヤーは、

- 特定業界向けの深いドメイン知識

- LLMの上にさらにワークフローやUIを厚く乗せる

- もしくは「オンプレ+クラウドハイブリッド」などインフラ面で差別化

までやらないと、

「Google(やOpenAI)のAPIそのまま直で叩かれて終わり」になる未来がかなり現実味を帯びてきました。

「無料で高性能」にはちゃんと落とし穴もある

ただ、いい話だけではありません。

正直、エンジニア視点では警戒ポイントもかなりあると思っています。

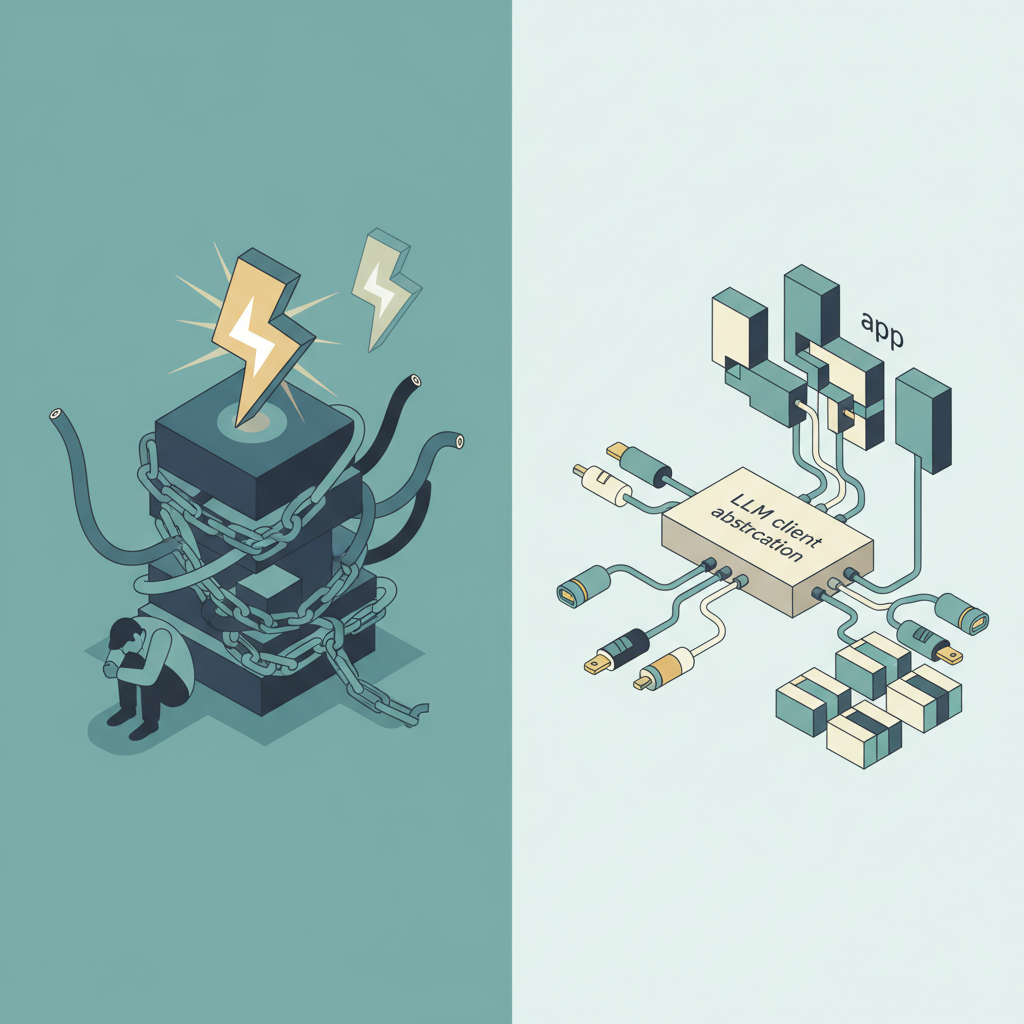

ベンダーロックインはさらに深くなる

- プロンプト設計

- ツール呼び出しの形式

- モデル固有の癖(JSONの出力傾向、ツールを呼びたがる頻度、拒否ポリシー)

こういうものを全部 Gemini 3 Flash 前提で作り込むと、

後から「やっぱ Anthropic に変えよう」とか「一部だけ OpenAI に寄せよう」としたときに、

- テスト書き換え

- プロンプト再調整

- 出力パーサの修正

が地味に地獄になります 🤔

ぶっちゃけ、「無料だから」といって何も考えず Gemini 一本足打法にするのは、

3年後に自分の首を絞める未来が見えているのでおすすめしません。

少なくとも:

- アプリ側に「LLMクライアントの抽象インターフェース」を用意する

- 重要なビジネスロジックは「モデル非依存のDSL」や「構造化スキーマ」で定義する

くらいは、最初からやっておいた方がいいと思います。

無音アップグレードによる「挙動ズレ」問題

Gemini 3 Flash は、1.5 Flash / 2.0 Flash の後継です。

APIレベルでは大きくは変わらないですが、挙動は普通に変わります。

- ツールを呼ぶ頻度が変わる

- 安全ポリシーが強く(あるいは緩く)なる

- JSON出力の「厳密さ」が変動する

- 文章のトーンや冗長さが変わる

構文解析や自動ワークフローが絡むシステムでは、

これはもはや「ソフトウェアのメジャーバージョンアップ」と同じ扱いにすべきです。

つまり:

- テストスイートをちゃんと用意する

- モデル切り替え時はステージング環境で回す

- 出力検証(スキーマバリデーション)とフォールバック処理を入れておく

このあたりをサボると、

「ある日を境に突然、本番で変なJSONが返ってくる」

という2025年版“DLL地獄”にハマります。

「無料だから無限に叩ける」と思うと死ぬ

Google AI Studio / Gemini API の無料枠は、かなり太っ腹です。

- 入力・出力ともに無料枠あり

- Flash は有料でも $0.5 / 100万トークン(標準)と相当安い

とはいえ、無料枠はあくまで開発・小規模向け。

本番でユーザ数が増えたとき、いつの間にか料金メーターが回り始めます。

ありがちな罠:

- PoCで「1操作=10回ツール呼び出し」が当たり前のUXを作ってしまう

- 一人あたりの「隠れトークンコスト」が増殖

- いざ有料に切り替えたら営業に「この単価は出せない」と怒られる

なので、無料のうちから「1ユーザーあたりのLLMコスト」を頭の片隅に置いて設計するのが吉です。

実務エンジニア視点:「Gemini 3 Flash、プロダクションで使うか?」の本音

ぶっちゃけ、現時点の自分の結論はこうです:

- 新規プロダクト/PoC:Gemini 3 Flash をガンガン試す価値あり(むしろ使わない理由がない)

- 既存プロダクト:いきなり全面移行はせず、まずはA/Bテストと限定機能から

もう少し分解すると…

今から何か作るなら「デフォルト候補」に入れるべき

- 既に GCP / Workspace を使っているチームなら、ほぼ間違いなく「メイン候補」です。

- gemini.google.com や Gemini アプリでエンドユーザーとして挙動を体験できるのも大きい。

- 用語のトーン

- 回答の粒度

- マルチモーダルの使い方

これらをユーザー目線から掴んだ上でAPI設計に落とせるのは、実はかなりの強みです。

既存スタック(OpenAI 等)を全部捨てて乗り換えるか?→ さすがに「まだ様子見」

- ビジネス上の理由(コスト / レイテンシ / データ所在地)がハッキリあるなら別ですが、

- 「なんとなく新しそうだから」「無料らしいから」という理由だけで全面移行するのは危険です。

やるなら:

- 主要なユースケースごとにベンチマーク

- コーディング支援

- RAG QA

- 要約・抽出

-

ツールチェーンを含むエージェント系

-

その上で、

- 速度

- 品質

- 成功率(構造化出力の安定度)

- コスト見積もり

をちゃんと比べる。

それをせずに移行するのは、DBを「なんとなく流行ってるから」で乗り換えるレベルの暴挙です。

「これ、どこで使うのが一番おいしいの?」という話

個人的に「ここは刺さる」と思っているユースケースを最後に挙げておきます。

社内アシスタント / 業務自動化ボット

- Gmail, Calendar, Docs, Sheets と組み合わせた 「社内版Copilot」 を作るとき、

- Gemini 3 Flash + Workspace の組み合わせはかなり強いです。

UX的には:

- Gemini アプリで普段から使ってもらう

- 同じモデルを社内ツールでも使う

→ ユーザーの「AIへの期待値・使い方の学習コスト」が共通化される

これは、エンタープライズ展開する上でかなり効いてきます。

高頻度のツールチェーン(RAG+外部API呼び出し)

Flash の設計フォーカスは明確に「ツール呼び出し」「エージェントワークフロー向き」です。

- 検索API

- 社内DB

- 社内マイクロサービス

などを叩きながら結果をまとめるようなデザインでは、

- レイテンシがボトルネックになりやすい

- コール数が増えるのでコストも雪だるま式になりがち

ここが高速かつ激安な Flash には一番向いている領域です。

教育・学習系サービス

Google は元々、学生向けに Pro プラン無料施策をやるくらい教育市場を狙いに来ています。

- Guided Learning

- ビジュアルな説明(YouTube連携、図解)

- 無制限クイズ生成

こうした機能+Gemini 3 Flash の無料枠を組み合わせると、

- 「自前でLLMを貼った学習アプリ」 vs 「Geminiを前提にした学習UX」

の勝負になります。

正直、個人や小規模スタートアップがここでGoogleと真正面から勝負するのはかなりしんどくなると見ています。

まとめ:Gemini 3 Flash は「無料の新おもちゃ」じゃなくて「戦略兵器」

整理すると、Gemini 3 Flash のポイントはこうです:

- ただの「新モデル」ではなく

→ 「デフォルトLLMの世代交代」を狙った、無料+高速なフロントラインモデル - Google エコシステムとの結合で

→ OpenAI とは別方向の強烈なロックイン戦略 - 開発者には超嬉しいけど

→ ベンダーロックイン / 挙動ドリフト / 無料枠依存 というクラシックな落とし穴もちゃんとある

なので、自分のスタンスとしては:

- PoC・新機能:積極的に触るべき。使わないのは損。

- 全面プロダクション移行:正直まだ様子見。でも、真面目にベンチ対象には入れるべき。

という感じです。

少なくとも、

「ChatGPTしか触ってない」「LLMはOpenAI一択でしょ」と思考停止していると、

2025年〜26年のAIプロダクト設計で後悔する可能性はかなり高いです。

無料なんだから、一度は早めに手を動かしてみる。

その上で「自分たちのプロダクトにとって、どこまでFlashに寄せるか?」を冷静に決める。

Gemini 3 Flash は、そういう“戦略を考えさせるレベル”のリリースだと感じています。

コメント