「また新しい画像モデル出たの?QwenにFLUXにLoRAに、どれ使えばいいのか分からん…」

そう思ってプロンプト調整で一日が溶けたこと、ありませんか?😇

正直、2025年末〜2026年頭の「生成AI新プロダクト祭り」は、

もはや「追う」だけでは時間のムダです。

重要なのは “どれを採用するか” ではなく “どこまで外部に任せるか” の設計になりつつあります。

この記事ではニュースを並べるのではなく、

Qwen-Image-2512 や FLUX.2 Turbo LoRA、Grok for Business など最近のアップデートを、

「実務エンジニア目線でどう線引きするか」という観点で噛み砕いてみます。

一言でいうと:2025年の生成AIは「Docker 2014年問題」に突入した

一言で言うと、今年の生成AI界は Docker 初期のカオス期 にそっくりです。

- LLM や画像モデル本体 = Docker 本体

- Maestro や Genspark AI Developer = Docker Compose / Swarm 的オーケストレーション

- MAI-UI, ComfyUI エコシステム = Portainer や Rancher 的 GUI / ノーコード層

- UltraShape, Stream-DiffVSR, ComfyUI-SAM3DBody など特化モデル = 各種監視・CI ツール群

当時と同じで、

「何でもできるけど、何を標準スタックにするか決められない」

状態に入りました。

ここを「面白そうだからとりあえず全部使う」で進むと、

2年後に “AIスタック大改修プロジェクト” で泣くパターンになります。

Qwen-Image-2512 と FLUX Turbo LoRA:

画像周りは「本番モデル」と「プレビュー専用」を分けないと死ぬ

まずは一番触りやすい画像系から。

Qwen-Image-2512:もはや「LLM 付きフォトストック」になりつつある

Qwen-Image-2512 は、

- フォトリアル寄りの質感向上

- 画像理解(caption / OCR / grounding)強化

- Qwen LLM とのエコシステム統合

が売りですが、個人的に一番インパクトがあるのは以下の2点です。

- 「LLM+画像」をワンベンダでまとめられる

- テキスト: Qwen 2.5 系

- 画像生成/編集: Qwen-Image, Qwen-Image-Edit

-

さらに Lightning LoRA まで純正エコシステム

→ システム構成がだいぶスッキリします。 -

出力特性がバージョンごとに微妙に変わる

- 2512は 2511 よりディテール重視

- 「AIっぽいツルッとした質感」が減った代わりに、ちょっとした違和感は残る

→ 既存のプロンプトは ほぼ確実に再調整が必要。

ぶっちゃけ、

「毎月のようにモデル特性が変わる世界で、

広告クリエイティブを“完全再現”したいという要求自体が、そろそろ時代遅れ」

だと思っています。

実務的にはこう割り切った方が楽です👇

- 「完全再現」は諦めて、

- スタイル LoRA やテンプレート PSD で「方向性だけ固定」

- モデルバージョンアップは「毎回テストして、合格なら一括切り替え」

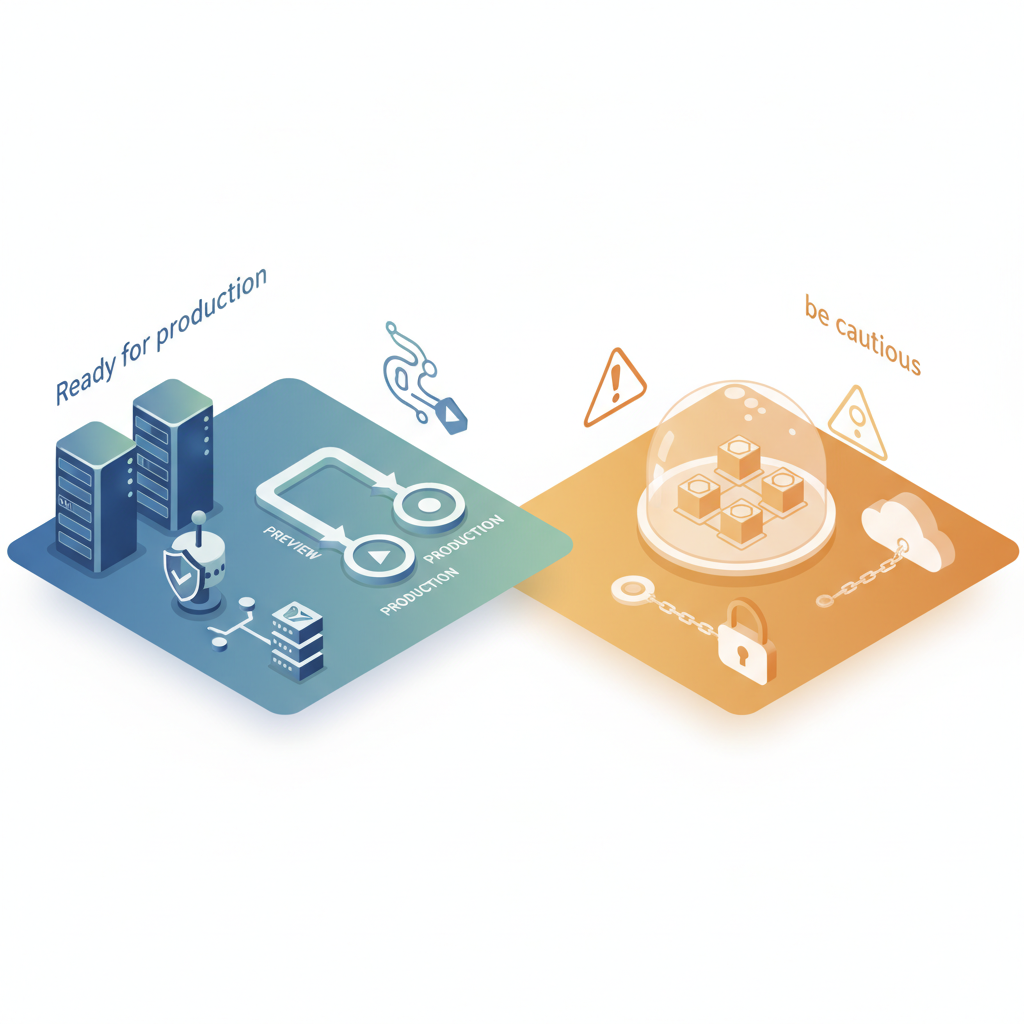

FLUX.2 [dev] Turbo LoRA:プレビュー用モデルを持たないのは損

Turbo LoRA も発想がかなり実務的で、

- 高品質フルモデル: 本番レンダリング用 FLUX.2

- LoRA 差分: プレビュー&ラフ案出し用 Turbo LoRA

という 二段構成を公式に認めた 形です。

正直、これは「ようやくみんな諦めたな」という感じがします。

- 1枚レンダリング30秒〜1分かかるモデルで、

デザイナと「もうちょい右に」「もうちょい光を弱く」みたいな会話をしていたら破産します。 - プレビュー専用モデルで 4〜8ステップ高速生成 → 気に入ったら本番 FLUX.2 で焼き直し

この運用が現実路線。

Qwen-Image-2512 と組み合わせるなら:

- 汎用イラスト・フォトリアル系: Qwen-Image-2512

- アート寄り・作風重視: FLUX.2 本体

- ラフ案・サムネ案乱造: Turbo LoRA & Qwen-Image Lightning 系

という「三段ロケット」を組んでおくと、

チーム内の会話がかなりスムーズになります。

DreamOmni3, UltraShape, Stream-DiffVSR:

「全部入りモデル幻想」から「用途ごとの専用チップ」時代へ

ここ数ヶ月で目立つのは「なんでもできる1モデル」ではなく、

極端に用途特化したモデル の登場です。

DreamOmni3:全部入りは便利だが、ロックインの塊

DreamOmni3 は名前からしてマルチモーダル統合モデル臭がプンプンしますが、

正直「便利そう」であるほど、インフラ設計者としては怖い存在です。

- チャットも、画像も、動画も、音声も「全部これ」で済む

→ アーキテクチャは超シンプル - でも「これにしかない機能」にどんどん依存していく

→ 数年後に他社モデルに移行したくなったとき、地獄を見る

Docker でいうと「Compose も監視もデプロイも全部入りの謎ツール」に近い。

短期的には楽だけど、長期的には逃げ道がなくなるパターンです。

個人的なスタンス:

- 「PoC や小規模サービス」は Omni 系1本で割り切るのはアリ

- 会社全体の基盤は テキスト / 画像 / 動画 / 音声 を別コンポーネントに分離 した方が安全

UltraShape 1.0:3D / AR チームには“ようやく来たか”の一手

UltraShape 1.0 は、名前からして 形状一貫性ガチ勢 なモデル。

- プロダクトデザイン

- AR/VR 向けアセット

- 配置・レイアウト付きの 3D シーン生成

この辺りで今まで Stable Diffusion 系を無理やり使っていた人たちは、

「ようやく 3D 前提で殴れるモデルが出てきた」という印象ではないでしょうか。

ただし、ここにはデカい落とし穴があります👇

- 形状データ(mesh, depth, normal, UV……)の前処理・後処理がほぼ必須

- ゲームエンジン (Unity / Unreal) や DCC (Blender / Maya) との連携が前提

つまり 「画像チームだけで完結しない」。

UltraShape 1.0 を導入するかどうかは、

- 社内に 3D パイプラインをちゃんと握っているチームがいるか

- 彼らと一緒にワークフローを再設計する覚悟があるか

で決めた方がいいです。

Stream-DiffVSR:低ビットレート時代の“エッジ救世主”候補

Stream-DiffVSR は Diffusion ベースの Video Super Resolution(アップスケーラ)を、

ストリーミング前提のアーキテクチャ に振ったモデル。

- 「720p 低ビットレート配信 → クライアントで高画質復元」

- オンライン会議・ライブ配信でのリアルタイム補完

RTX 4090 で 720p フレームを 0.328秒とのことで、

4fps〜8fps 前後が現実ラインですが、

いくつかポイントがあります。

良い点

- コーデック側で無理に圧縮率を下げなくてよくなる

- モバイル回線でも「視聴体験」を守れる可能性

懸念点

- エッジ側 GPU 要件次第で、ユーザ母数が一気に絞られる

- 「アップスケーラ搭載クライアント」と「非対応クライアント」で画質差が出る

→ QA・サポートが地味にしんどい

正直、いきなりクライアントに埋め込むより、

まずは 配信インフラ側で VOD の高画質化に使ってみる 方が安全だと思っています。

MAI-UI, Maestro, LiveTalk, SpotEdit:

「ノーコードでつないでみた」は、本番運用の敵にもなる

次に UI/オーケストレーション層。

MAI-UI:プロトタイピングツールとしては神、本番には向かない

MAI-UI は、マルチモーダルを一元管理するハブ UI。

イメージ的には 「マルチモーダル版 Runway + ComfyUI Lite」 みたいなポジションです。

- PoC 的には最高:

- 「画像生成 → 動画 → 音声合成」を GUI でチャチャっとつなげる

- ただし、本番を考えると:

- IaC (Terraform / Ansible) との連携

- CI/CD パイプラインとの統合

- 設定のバージョン管理

ここが圧倒的に弱くなりがちです。

ぶっちゃけ、MAI-UI を“設計ツール”として割り切るのがベストです。

- MAI-UI 上でワークフローを試作

- 落ち着いたら

- Python / TypeScript / YAML ベースのフロー定義に書き起こす

- 本番は Airflow / Temporal / 自前マイクロサービスで回す

この二段構えを最初から決めておかないと、

「GUI ベタベタ環境」が数年後の負債になります。

Maestro:LangChain 世代とどう付き合うか問題

Maestro は、「マルチエージェント・マルチツールのオーケストレーションレイヤ」

= LangChain / LlamaIndex / Flowise と完全にバッティングする層 に見えます。

ここで一番まずいのは、

「各プロジェクトごとに違うフレームワークを採用してしまうこと」

です。

- A チーム:LangChain

- B チーム:Maestro

- C チーム:Flowise

…という状態になると、

- ノウハウが分散

- コードレビューできる人が限られる

- 共通ライブラリ化が阻害される

という「マイクロ・フレームワーク地獄」にハマります。

会社や組織としては、2026年内にはこう決めた方がいいです👇

- 「RAG / エージェントの標準スタック」を 1〜2種類に絞る

- それ以外は「検証用」「個人実験用」の扱いにする

技術的には Maestro も面白そうですが、

「乗り換えコスト」 を冷静に見ないと後悔します。

LiveTalk:リアルタイム音声LLMは“別物のインフラ”だと覚悟すべき

LiveTalk はリアルタイム音声対話フロント。

- WebRTC / gRPC / WebSocket 前提

- 音声 I/O + ASR + LLM + TTS のストリーム処理

- P95 レイテンシ / 音声認識精度 / ネットワーク不安定時の挙動

…つまり、

今までの「REST チャットボット」を運用していたチームが、そのまま扱える領域ではありません。

正直、「チャットボットチーム」と「リアルタイム通話チーム」を分けるレベルで考えた方がいいです。

LiveTalk を検証するなら、最低限この3つは計測した方がいいです👇

- ユーザの発話開始〜アシスタント応答開始までのレイテンシ

- ノイズ環境での誤認識率

- 同時接続数と GPU 消費の関係

SpotEdit:UX は神だが、ピクセル単位のバージョン管理がしんどい

SpotEdit は、局所編集に特化した画像/動画エディタ。

- Photoshop / After Effects 的なワークフローに

生成 AI のインペインティングを自然に載せられる - クリエイタには圧倒的に受けるやつです。

ただし、運用側から見ると厄介で:

- どのバージョンの SpotEdit / モデルで編集したか

- ピクセル単位の差分をどう管理するか(Git はほぼ無力)

- 動画の場合、どのフレーム範囲が AI 編集されたか

コンプライアンス(広告・放送・映画)を意識する組織ほど、ここが爆弾になります。

「AI 編集された範囲をメタデータとして埋め込む」

「バージョンごとに“どのモデルを使ったか”を自動記録する」

あたりをワークフロー側で追加しないと、

後でトラブったとき検証不能になります。

GR-Dexter と Genspark AI Developer:

「AI にコードを書かせる」の次は「AI にプロダクトを作らせる」フェーズ

GR-Dexter:Copilot の“次の一手”はリポジトリ単位リファクタリング

GR-Dexter は名前からして コード操作エージェント 系。

IDE プラグインか、Git リポ単位のバッチリファクタリングかで立ち位置が変わりますが、

個人的には後者に本命感があります。

- 「特定のコード規約に沿うように全ファイルを書き換える」

- 「API v1 → v2 への一括移行」

- 「型付け / ログ追加 / エラーハンドリングの全体自動挿入」

ここを人力でやるのは、もう時代錯誤になりつつあります。

ぶっちゃけ、

Copilot = “今書いている行のオートコンプリート” に過ぎません。

本当にしんどいのは「既存10万行にポリシーを適用する」部分です。

GR-Dexter みたいなツールは、

「レビュー前提・PR ベースの自動変換ボット」として使うのが一番現実的です。

Genspark AI Developer:

「プロダクトを丸ごと AI に作らせる」なら、ガバナンスを最初に設計しないと詰む

Genspark AI Developer は、

- 要件 → 画面モック → コード → テスト

を一気通貫でやろうとする「メタ開発環境」。

ここで一番やってはいけないのは、

「試しに1プロジェクトだけ任せてみるか」 です。

なぜかというと:

- 生成されたコードのライセンス由来が分からない

- 依存ライブラリが何を引いているか不透明

- テストが「実質 AI 自作自演」になってないか確認しづらい

→ 後でセキュリティ監査に引っかかったとき、

“誰も説明できないシステム” が出来上がるリスクがあります。

なので、Genspark 系を導入するなら 「ガバナンス設計が先」です。

- 自動生成コードにも必ず SCA / SAST / DAST をかける

- ライセンス・依存ライブラリを SBOM (CycloneDX / SPDX) として出させる

- セキュリティレビューの責任者を人間に明確に割り振る

この辺を決めずに「AI がアプリ作ってくれるらしい!ラクしよう!」は、

正直、経営的にアウトだと思っています。

Grok for Business:

Copilot vs Grok、「どっちを入れるか」ではなく「どこに特化させるか」

Grok for Business は、X/Twitter 由来 Grok LLM のエンタープライズ版。

ざっくり比較:Grok for Business vs Microsoft Copilot

共通する使い方

- 社内ドキュメントから Q&A・要約

- メール・チャット・会議メモのドラフト生成

- RBAC ベースのアクセス制御

Grok for Business が刺さるところ

- X/Twitter ネイティブ統合の可能性

- 社内ナレッジ + リアルタイム SNS を一体で扱える

- ブランド監視 / 炎上検知 / トレンド分析と社内対応を繋げやすい

- メディア / SNS マーケ / 広報部門にはかなり魅力的

Microsoft Copilot が強いところ

- M365 (Teams / SharePoint / Outlook / Excel / Word…) への深い統合

- 既に多くの企業が契約済み → 調達が楽、稟議も通しやすい

- DLP / 情報保護 / 組織ポリシーとの統合が成熟

結局のところ、

「どちらが強いか」ではなく「社内のどこで何をさせたいか」 が重要です。

個人的な結論:

- すでに M365 でガチ運用している企業 → Copilot が “デフォルト選択肢”

- X/Twitter を事業の生命線としている企業 → Grok for Business を “特化アシスタント” として横に置く

「全部 Grok に乗り換える/全部 Copilot に一本化」は、

2026年時点ではやりすぎだと感じています。

ComfyUI 拡張たち:

「ノード地獄」をどうやって制御するかが勝負

最後に、ComfyUI エコシステム周り。

- ComfyUI-Trellis2

- ComfyUI_FL-SongGen

- ComfyUI-SAM3DBody

など、機能としてはどれも魅力的です。

正直、自主制作や個人プロジェクトなら「全部突っ込め」でいいと思います。

ただ、業務で使うなら話は別です。

実務での ComfyUI の“本質的な課題”はここ👇

- ノードのバージョン管理をどうするか

- 依存モデル(チェックポイント / LoRA / VAE)の取得・更新をどう固定するか

- 同じワークフローを別マシン・別拠点で再現できるか

「github から zip ダウンロードして custom_nodes にぶち込む」文化のまま、

クライアントワークや商用案件を回し始めると、

1年後に “どの環境でどの絵が出たのか、誰も再現できない” 状態になります。

なので、ComfyUI を業務に入れるなら 最初からインフラ化する のがオススメです。

requirements.txt/pip/git submoduleでバージョン固定- Docker イメージにノードとモデルを封入

- ワークフロー JSON も Git 管理

このあたりを徹底すれば、

ComfyUI-SAM3DBody や SongGen も普通にプロダクションで使えます。

「ただ、懸念点もあります…」

コスト爆発・ロックイン・再現性という 3 大地雷

ここまで「おもしろいぞ!」の話をしてきましたが、

正直、この波にはハッキリした地雷もあります。

コストとインフラ複雑性:

「全部 GPU の上に載せる」時代は終わった

- Qwen-Image / FLUX / UltraShape / Stream-DiffVSR …

それぞれ求める GPU / RAM / スループットが違う - 1台の GPU サーバに全部詰め込んで「使うときに呼ぶ」は、もう現実的じゃない

これからの設計で意識した方がいいのは👇

- 「モデルごとの推論サーバ」をマイクロサービス化

- モデルロードを前提にした MLOps レイヤ (KServe, Sagemaker, vLLM, TGI…) を採用

- 「このプロダクトでは どのモデル群をサポートするか」を最初に決める

ベンダーロックイン:

UI / DSL に資産を閉じ込めない

- Grok for Business

- Genspark AI Developer

- Maestro

- GR-Dexter

これらの多くは、

独自 UI / DSL / 設定フォーマットの上に価値を積み上げる タイプです。

一度ここにワークフローやアプリ定義を全部書き溜めると、

- 別ツールに乗り換えるとき、

「ロジックをエクスポートできない / 変換できない」 - 結局、人力で再実装する羽目に

契約時・設計時に必ず確認した方がいいのは👇

- フロー定義やプロジェクト定義を テキスト(YAML/JSON)でエクスポートできるか

- API 経由で設定を取得して、自前の Git に保存できるか

- 他ツールから同様の形式でインポートできるか

ここを見ないまま「便利そうだから」で採用すると、

数年後の CTO が地獄を見ます。

品質・再現性・コンプライアンス:

「毎回少し違う」が許される仕事かどうか

- 画像・動画:モデルアップデートで出力が変わるのはほぼ避けられない

- 音楽・音声:著作権・権利処理がまだ国ごとにバラバラ

- コード:OSS ライセンス汚染や脆弱性混入リスク

なので、用途ごとにこう線引きするのが現実的です👇

- 広告クリエイティブ / アート:

- 「毎回違っていい」

- モデルアップデートも積極的に受け入れる

- ロゴ / CI / ブランドアセット:

- 「完全一致が必要」

- 可能なら AI での自動再生成は避ける or 人間のチェック必須

- コード生成:

- 生成コードは 全て CI で SCA / SAST を通す ことをルール化

- 「AI が書いたから安心」は真逆で、「むしろ疑ってかかる」 方が安全

結論:プロダクションで使うか?

正直、「全部」には乗らない方がいい。でも「どこまで自前で握るか」は今決めるべき

最後に、現実路線の「使う / まだ様子見」をざっくり分けてみます。

いまでも積極的に使っていいライン

- Qwen-Image-2512 / FLUX.2 Turbo LoRA

→ プレビュー / 本番の二段構成を取り入れる価値あり - Stream-DiffVSR(VOD or バックエンド用途)

→ まずは配信インフラ側で PoC する価値大 - GR-Dexter(リポジトリ単位の自動変換ボット)

→ PR ベースで運用すればリスク管理しやすい - ComfyUI 拡張群(Trellis2 / SongGen / SAM3DBody)

→ Docker+Git 管理前提ならクライアントワークにも十分耐える

正直、まだ慎重にいきたいライン

- DreamOmni3

→ 小規模サービスや PoC には良いが、全社基盤を丸ごと載せるのはロックインが怖い - MAI-UI / Maestro

→ 標準スタックに採用するかは、社内の LangChain 等との併存戦略を決めてから - Genspark AI Developer

→ ガバナンス設計なしで「実サービスの新規開発」に使うのは危険 - Grok for Business

→ X/Twitter 依存度が高い企業には刺さるが、M365 企業は Copilot との棲み分け前提で

じゃあ、開発組織として「いま」何を決めるべきか?

まとめると、2026年の設計課題は 技術選定 ではなく “どのレイヤーを自前で握るか” です。

- モデル層(Qwen / FLUX / UltraShape / Stream-DiffVSR):

→ ここはどんどん新陳代謝するので、入れ替え前提の MLOps 設計 にする - オーケストレーション層(LangChain / Maestro / 自前):

→ 組織として標準を 1〜2 個に絞る - UI / ノーコード層(MAI-UI / ComfyUI 等):

→ **「設計と PoC 用」か「本番用」か」を最初に線引きしておく - コード生成 / AI Developer 層(GR-Dexter / Genspark):

→ 生産性より先に セキュリティとライセンスガバナンスの仕組み を決める - エンタープライズアシスタント層(Grok for Business / Copilot):

→ 「どこで何をさせるか」を部署単位で設計し、

全部を一社に寄せない

ぶっちゃけ、新しいモデルやツールに飛びつくのは楽しいです。

でも数年スパンで見ると、「何を採用したか」よりも、

「どこを抽象化しておいたおかげで、後からいくらでも入れ替えられたか」

が勝負になります。

今のこの「Docker 2014年みたいなカオス期」で、

どのレイヤーを自前で握るか、一度立ち止まって考えてみる価値はかなり大きいはずです。

コメント