「またプロンプトをいじる一日が終わった……」

そんな日、まだ続いていませんか?

- ちょっとタスクが複雑になるとすぐに変な推論を始める

- モデルを変えたら、同じプロンプトなのに挙動がまるで別物

- コストはじわじわ上がるのに、品質は頭打ち感…

正直、ここ1〜2年のLLM界隈って「パラメータ増やしてお祈り」「お高いモデルを信仰」でゴリ押ししてきた感があります。

そんな中で、DeepSeekが「モデルの訓練手法そのもの」をチューニングしてきたのは、個人的にはかなり刺さるニュースでした。

一言でいうと:スパコン買うんじゃなくて、コンパイラを賢くした感じ

今回のDeepSeekの話、ざっくり言うと:

「もっとデカいGPUを積む」のではなく、

「同じGPUで、もっとマシなAIを育てる訓練レシピを作った」

という方向性です。

歴史的にいうと、これは 「Transformer発明」級の話ではない けど、

CUDA/cuDNN が出て「同じ行列計算なのに、実用レベルの速さになった」あの転換に近いです。

- アーキテクチャはこれまで通り Transformer ベース

- でも:

- 学習のフェーズを分ける(巨大事前学習 → SFT → アラインメント)

- カリキュラム的にタスク難易度を上げていく

- GPUクラスタでの並列化・通信をガチで最適化

…という「トレーニング戦略」をいじることで、

- 同じ or 少ない計算量で

- 複雑な推論の安定性を上げて

- 制御性と一貫性を改善する

という方向に振ってきています。

ぶっちゃけ、「パラメータ増量ガチャ」から卒業した最初の勢力のひとつと言ってもいい。

何がそんなに重要なのか:これは「OpenAI路線のローカル版競争」になりうる

OpenAI vs DeepSeek:思想の違い

かなり乱暴にまとめると、

- OpenAI

- 超巨大汎用モデル(GPT-4/4o 系)

- 地球規模での安全性・汎用性

-

「とにかくデカく・多様に・安全に」路線

-

DeepSeek(今回の報道ベース)

- 「高度AIモデルのための新しい訓練手法」が主役

- 限られた計算資源でも、推論品質と制御性を稼ぐ

- 特に日本語などリージョナル対応にも強みを持ちたい雰囲気

ここでポイントなのは、DeepSeekが「計算あたりの賢さ」を狙ってきていることです。

もし本当に、

- GPT-4-ish な推論品質を

- それ以下のFLOPsやGPU枚数で出せる

なら、

- 価格競争で有利になる

- 同じコストで、より大きい内部モデルを回せる

- 特定言語(日本語など)や特定ドメインに寄せやすい

という、OpenAI とは別方向の「合理的な強さ」を持ってしまいます。

誰が一番困るか?

正直、一番やばいのは以下の層です👇

- OSSモデルをほぼ素のままホスティングしてるだけのベンダー

- 「うちはコストが安いです!」とだけ言ってるリージョナルLLMプロバイダー

- 自前でトレーニングの工夫をほぼしていないクラウド系推論API

こういうプレイヤーって、

「パラメータ数 × それなりのGPU × OSSモデル」

で勝負してることが多くて、

訓練パイプライン自体の工夫という“参入障壁”を持っていない。

そこに、DeepSeekみたいな「トレーニング効率番長」が出てくると、

- 同等性能で価格を下げる

- 同じ価格で性能を上げる

どちらのカードも切られてしまうので、ぶっちゃけ分が悪いです。

これ、開発者にとって何が嬉しいの?

プロンプト職人の仕事が一部減るかも

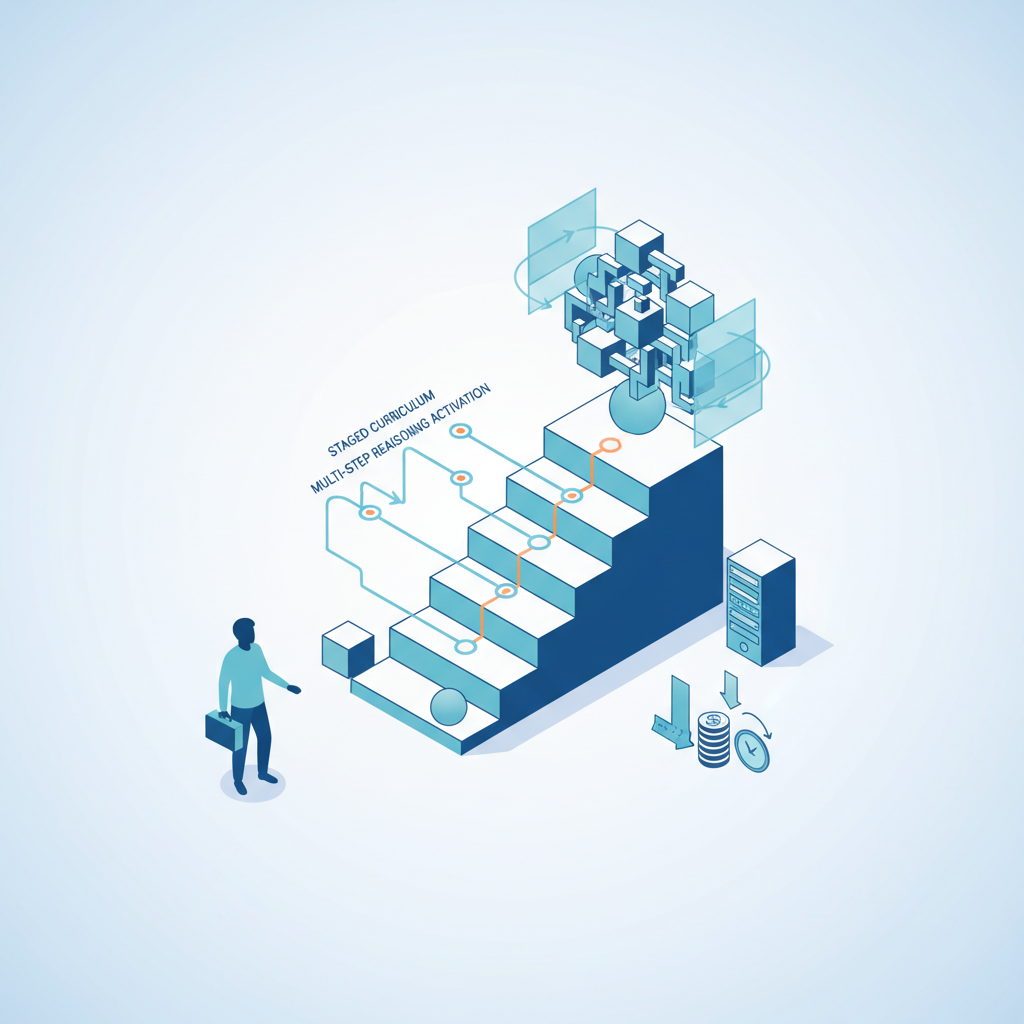

今回の手法は、

- カリキュラム学習的にタスクを段階的に難しくしていく

- マルチステップ推論を意識して最適化

- アラインメント(RLHF/RLAIF 的なもの)をきちんと重ねる

という形で、「最初からマルチステップ思考をする前提」で育てているのがミソです。

その結果として期待できるのは:

- 「とりあえず chain-of-thought っぽく書いてお祈り」みたいな

無理筋プロンプトの必要性が減る - ちょっと複雑なワークフローでも、

無理にエージェントごりごり組まなくて済む場面が増える

もちろん、プロンプトエンジニアリングが完全に不要になることはないですが、

「モデル側の地頭が上がることで、無茶な小細工を減らせる」のは地味にデカいです。

同じ品質なら、安く・速くなる可能性

訓練段階で効率を稼いでおくと、実運用にも波及します。

- 小さめのモデルで大モデル級の性能 → レイテンシ改善 or コスト削減

- あるいは、同じサーバコストでより高品質なモデルを提供できる

これは、特にスタートアップや社内PoCには効きます。

- これまで「GPT-4級はコスト的にきついから3.5で…」だったところが

- 「DeepSeekのXモデルなら、実用ライン+コストOK」という選択肢になるかも

エンタープライズ案件との相性が良さそう

記事のトーンからすると、

- 一貫した振る舞い

- 幻覚(hallucination)の抑制

- コントロール性の向上

あたりも明確に狙っているので、

- 金融・医療・法務の要約

- コールセンター支援

- マニュアル生成・更新

といった「ミスしたら本当に怒られる」領域には相性が良さそうです。

ただ、懸念点もあります… 🤔

ここまで褒めたので、ちゃんと落とし穴も書いておきます。

トレーニングスタックのブラックボックス化

マルチフェーズ・高効率トレーニングって、だいたいこうなります:

- 社内しか知らない大量のトリックとハック

- データのカリキュラムや重みづけが超複雑

- 振る舞いの理由が説明しづらい

つまり、再現性と解釈性がどんどん下がる。

- 「なぜこのケースだけ変な推論をしたのか?」

- 「なぜA社のデータではうまくいくのに、B社のデータでは崩れるのか?」

といった問いに対して、

開発者側で理由を推測するのがどんどん難しくなります。

正直、「高性能だけど理由はよく分からん箱」は、

エンタープライズには導入しづらい一面もあります。

モデル更新時の“静かな破壊”

今回の手法が本番モデルに反映されると、多分こうなります:

- API仕様は変わらない(互換インターフェース)

- でも、出てくる文章・推論パターンはそこそこ変わる

普段からLLMをサービスに組み込んでいる人なら分かると思いますが、

これは割と致命的になりえます。

- テストが「だいたいこの言い回しで返る前提」になっている

- 分類タスクなのに、表現ゆらぎが増えて評価が狂う

- 既存の評価指標や自動チェックが壊れる

つまり、“非破壊アップデート”のはずが、地味に破壊的になりがちです。

ベンダーロックインの加速

訓練レシピがユニークであればあるほど、

- 同じ挙動を他社モデルで再現しづらい

- OSSモデル + 自前微調整では追いつけない部分が増える

- DeepSeek 特有の「癖」を前提にしたプロンプトやワークフローが積み上がる

という形で、ユーザー側の「逃げにくさ」が増えます。

短期的には「高性能で安い、最高!」なんですが、

長期的にはクラウドロックイン問題とほぼ同じ構図になります。

「いつでも他社に逃げられる状態をキープするプロンプト設計」や、

モデル差分を吸収するミドルレイヤーの整備はこれまで以上に重要になりそうです。

プロダクションで使うか?正直、まだ“戦略的様子見”

エンジニアとして、そしてプロダクト寄りの立場として、

自分ならこう判断します👇

すぐにでも試してみたいユースケース

- 日本語やリージョナルなテキストが多い

- コストとレイテンシがシビア

- 「GPT-4級ほしいが、そこまでの予算はない」

みたいな条件が揃っているなら、

- PoCや小規模ワークロードでのパイロット導入

- 既存プロバイダとの A/B テスト

はかなりアリだと思います。

特に、

- マルチステップ推論(プランニング、コード生成、長文要約)

- フォーマット厳守が必要な出力(JSON, 特定テンプレート)

あたりは、今回の訓練手法の良さが出やすいはずです。

ただし、本番クリティカル導入は「証拠待ち」

一方で、

- ミッションクリティカル(金融取引、医療判断など)

- 大規模ユーザートラフィックを受ける本番サービス

- 長期運用前提(1年以上)での採用

となると、正直まだ様子見です。

理由は:

- ベンチマークの透明性

- どのタスクで、どのモデルと比べて、どう勝っているのか

-

自分たちのユースケースに近い評価軸でのデータが欲しい

-

バージョンアップポリシーと安定性

- どの頻度で中身が変わるのか

-

旧挙動を維持できるオプションがあるのか(version pin など)

-

SLA とサポート体制

- 単なる「API提供」以上の、企業利用向けのケアがあるか

ここが見えないうちは、サブ or バックアッププロバイダとしての位置づけが妥当かなと感じています。

結局、僕らは何をすべきか

最後に、現場エンジニア/Techリード目線での「次の一手」をまとめると:

- モデル依存の“癖”に頼りすぎない設計へシフトする

- なるべく構造化出力に寄せる

- プロンプトを「人間向け文言」に依存させすぎない

-

モデル差を吸収する評価・検証レイヤーを用意する

-

DeepSeek含め、複数プロバイダで同じワークロードを回してみる

- コスト/レイテンシ/品質を定量比較する

-

「特定プロバイダでしかうまくいかないワークロード」をあえて洗い出す

-

訓練戦略のイノベーションをちゃんとウォッチする

- もう「パラメータ数だけ見ればいい」時代ではない

- 学習レシピ・アラインメント手法・並列化アーキを意識して選ぶ

DeepSeek の新しい訓練手法は、

「AIの進化 = ひたすらデカくする」から

「どう賢く育てるか」にフェーズが変わりつつあるサインだと思います。

正直、これから数年は、

- モデルサイズの戦争 から

- トレーニングレシピと運用効率の戦争 へ

シフトしていくはずです。

そのときに、「どのベンダーを使うか」だけでなく、

「どの前提でモデルを選び・乗り換えられるように設計するか」が、

エンジニアとしての腕の見せどころになってくると感じています。

コメント