「Opus使いたいけど、コストで毎回プロダクトオーナーに突っぱねられる」

「Sonnetだとギリ足りない。けどOpus常用するほどの予算はない」

そんなモヤっとした板挟み、経験ありませんか?

そのど真ん中に、かなりヤバい球を投げ込んできたのが、今回リークされた Claude Sonnet 5 “Fennec” です。

一言で言うと?──LLM界の「前世代フラッグシップをミドルレンジ価格でぶっ壊したGPU」

Qiitaやnoteで取り上げられているとおり、Fennecはまだ“正式発表前”の存在です。

でもログ上の痕跡と関係者のトーンから見える絵はかなりはっきりしていて、

「価格はSonnet寄り、性能はOpus 4.5超え」

という、普通に考えたらビジネスとして成立してるのか心配になるレベルのポジショニングになりそうです。

歴史的アナロジーで言うと、

- RTX 4070 クラスの値段で、前世代の 3090 Ti 並みに回るGPUが出てきた瞬間

- それで一気に「4Kゲーミング」「個人でのGPU学習」が現実になったあの感じ

にすごく近いです。

「ハイエンド遊び」だったはずのユースケースが、突然“標準機能”に落ちてくる転換点。

この記事ではニュースの焼き直しではなく、

- なぜこれが「特異点級」と言われているのか

- 競合(特にGPT-4o/Gemini)から見ると何が起きるのか

- エンジニア/アーキテクトとして、どこまで乗るべきか・どこは冷静に距離を置くべきか

を、ぶっちゃけ目線で整理してみます。

「Fennec」が本当にヤバいのは“性能”よりも“価格カーブ”の歪み

性能面のリークはだいたいこんな感じに集約できます:

- 推論能力: Opus 4.5 超え(マルチステップ推論の一貫性がかなり良い)

- コーディング: SWE-bench Verified で 82–85% 前後(Opus 4.5 や GPT-5.x コーディング特化系を上回るレンジという噂)

- コンテキスト: 100万トークン級 + 「古い情報を構造ごと圧縮して保持」するコンパクション

- エージェント前提設計: Dev Teamモード / 並列サブエージェント / Memory Tool / System 2 Reasoning など

正直、このへんは「あぁ、次の世代ならそうなるよね」という範囲でもあります。

個人的に一番“特異点”だと思っているのはそこではなくて、

「ミドルレンジ価格帯のまま、性能だけフラッグシップに突き抜けた」

という価格性能カーブのねじれ方です。

従来の常識だと:

- Haiku … 安いけど力不足

- Sonnet … だいたいこれでいい、が、やや物足りないケースもある

- Opus … メチャ賢いけど、毎回コストと相談

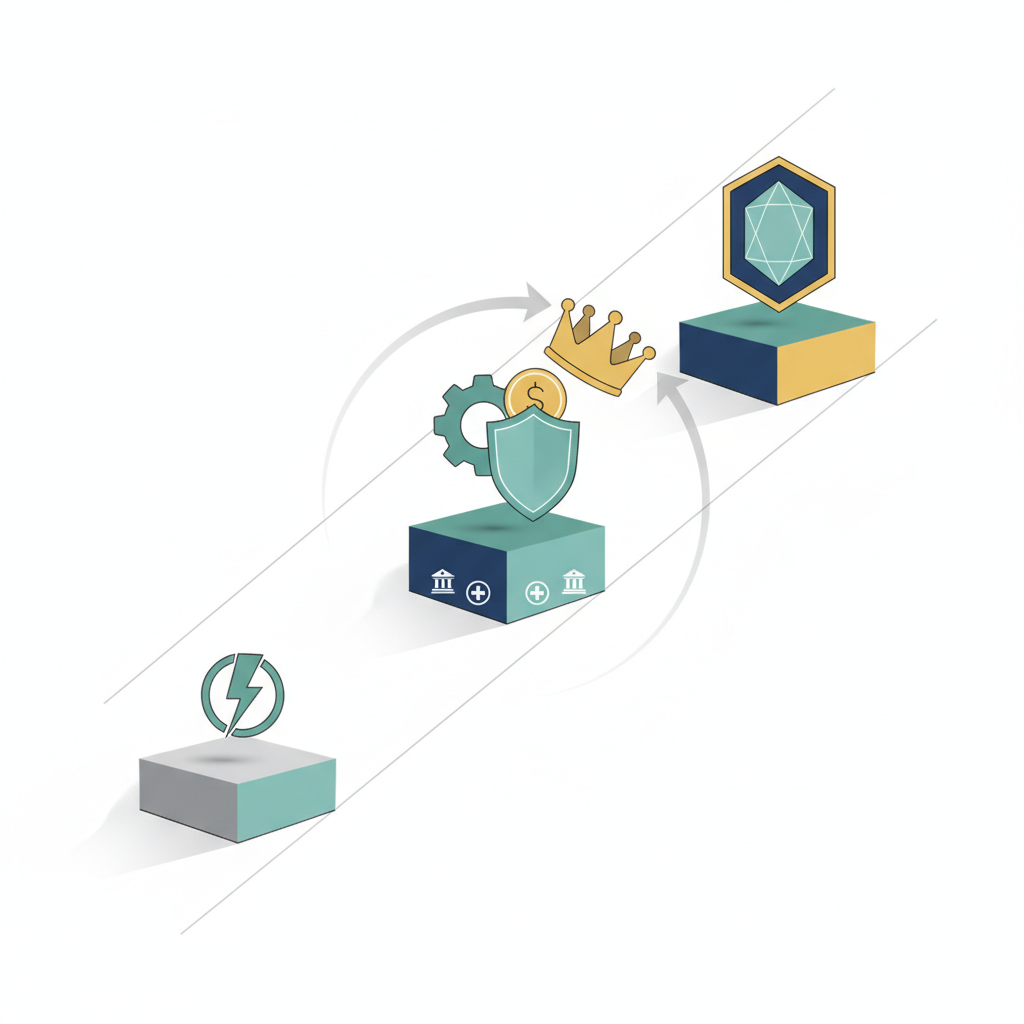

ここに「Fennec」が入ってくると、おそらくこうなります:

- 「本当はOpus使いたいタスク」 → Fennecでだいたい十分、コスト半分

- 「今のSonnetだとちょい弱いタスク」 → Fennecに変えるだけでPoC→本番レベルの性能に

つまり、「ハイエンドを選ぶ理由」がかなり減ります。

GPU界で言うと「80番Tiを買う動機がほぼ消える」状態ですね 🤔

なぜこれが重要か──OpenAI / Google とのポジション争いが一気に変わる

GPT-4o vs Fennec: 「高品質×中価格」ゾーンのガチ殴り合い

今まではざっくりこんなイメージだったはずです:

- 「とにかく最高品質」 → GPT-4.x / Claude Opus

- 「かなり高品質だけどコスパ重視」 → GPT-4o / Claude 3.5 Sonnet

- 「ライトユース」 → 小型モデル(Haiku / gpt-4o-mini / Gemini Flash など)

Fennec が Opus 4.5 超え性能 & Opus 半額だとすると、

このマトリクスの真ん中、「高品質 × 中価格」ゾーンの王座をAnthropicが取りに来ることになります。

OpenAI から見るとかなり嫌な構図で:

- GPT-4o の「コスパ最強」のポジションが一気に揺らぐ

- 「品質はGPT-4oと同等以上、でも安全性と安定性はClaudeのほうが上では?」という議論になりやすい

- エンタープライズはすでにClaudeの「憲法AI」「安全性設計」を評価している

特に、金融・医療・公共系の案件では、

- 仕様:GPT / Claude / Gemini いずれも技術的には要件を満たす

- 非機能:安全性・透明性・契約条件・監査対応

というフェーズでClaudeが勝つケースがじわじわ増えていました。

そこに「性能でも、しかも価格でも有利」が乗っかると、

「じゃあまずはClaudeで検討しようか」

という会話が起点になりやすくなります。

“第二候補”から“第一候補”への格上げです。

Google / Vertex AI は「自社クラウドが他社モデルの踏み台になる」リスク

面白いのは、このリークが Vertex AI のログから見つかった ことです。

- Anthropic は Google Cloud と大規模提携し、TPUインフラをガッツリ使い始めている

- その成果として「速くて安いClaude」を Google のクラウドで提供

- でもそれは同じVertex AI上で動く Geminiシリーズの商売を食う可能性 がある

つまり、

「Googleが用意した最高のインフラの上で、Anthropic がGeminiのシェアを奪う」

という皮肉な構図になりかねません。

実際、企業側から見ると:

- すでにGCPを使っている

- Vertex AI でGPT/Gemini/Claudeを横並びで試せる

- そこで「一番賢くて安い」のがFennecだったら?

正直、Geminiをあえて選び続ける理由はぐっと減ります。

Googleは「マルチモデルを選べるプラットフォーム」としては強くなりますが、自社LLMの相対的な価値は下がるリスクがあります。

Fennec の「本当のキラー要素」はエージェント前提設計かもしれない

性能・価格の話は分かりやすいですが、

エンジニアとして気になるのは、開発フローがどれだけ変わるかです。

リークやnoteでの記述を整理すると、Fennecの世界観はかなりはっきりしていて、

- 「AIを呼び出す」というより「AIチームと一緒に働く」

- Dev Teamモードで、仕様書を渡すと:

- Gitブランチを切る

- 実装する

- テストを書く

- PRを出す

- それらが 並列サブエージェント として分担される(Backend / Frontend / Security など)

になっているようです。

ここでポイントなのは、

- 各エージェントが独立したコンテキストとメモリを持つ

- メインの会話コンテキストを「汚染」しない形でサブタスクを回せる

- 結果だけをサマリーして統合することで、トークンも混乱も最小化

という設計思想です。

正直、これは「ようやく来たか」という感じがあります。

今まで我々がLangChainや自前フレームワークで頑張って組んでいた、

- タスク分解

- 専門エージェントへの割り振り

- コンテキストの分離と統合

を、モデル側が前提機能として持ち始めている。

「LLMの上にエージェントを乗せる」から「エージェントが前提のLLM」になっていく流れです。

ここに、100万トークン級の長文コンテキストと、

「古い情報を構造ごと圧縮して保持する」コンパクションが組み合わさると、

- 仕様書

- 既存コード数十万行

- 関連ドキュメント

- 過去の議論

を全部突っ込んだ上で、数日〜数週間にわたる開発サイクルを「同じAIチームと継続して進める」世界がけっこう現実味を帯びます。

ただし、懸念もデカい──「これ、そのまま全面移行すると死ぬやつでは?」

ここまで持ち上げておいてなんですが、

ベテランの目線で見ると、手放しで飛びつくと危ないポイントもかなりあります。

リークベースの「Opus超え」を鵜呑みにすると痛い目を見る

まず大前提として、

- 公式なベンチマーク(MMLU / GSM8K / HumanEval / SWE-bench正式値)はまだ出ていない

- 言われている数値は「内部テスト」「関係者の感触」レベルのものが多い

という点は、冷静に押さえておくべきです。

LLMの「すごい!」は、以下を自前データで叩いてみないとまったく信用できません:

- 自社ドメインのテキスト推論(FAQ / 社内規程 / 業界用語)

- 自社コードベースでの修正・リファクタ

- 業界特有のフォーマット(医療レポート、金融商品説明、契約書など)

OpusからFennecに切り替えても、期待通りに精度が出ないタスクは必ず出ます。

価格だけ見て全面移行すると、「局所的に地獄」が発生します。

Claude特有の“安全過多”問題がどう出るかは未知数

Anthropicの強みでもありクセでもあるのが、安全性設計の強さです。

- かなりマイルドに回答しようとする

- 「リスクがある」と判断すると、平気で回答拒否をしてくる

- 法務・医療・セキュリティ系のエッジなケースは特にナーバス

Fennecがこれをどうチューニングしてくるかはまだ見えません。

- コスト・性能が魅力的だからといって、医療/法務/金融の本番系を即切り替える

- → 「前のモデルでは答えてくれていた処理が、Fennecでは“安全のため拒否”になる」

みたいなパターンは普通にありえます。

ビジネスプロセスがAIのガードレール挙動に依存しているのは、かなり危険な構造です。

ベンダーロックインが一気に進む

価格性能比で明確に頭一つ抜けたモデルが出てくると、

組織としては「Anthropic前提で最適化したくなる」誘惑に駆られます。

- System Prompt の書き方

- ツール呼び出しのパターン

- エージェント構成の前提(Dev Teamモードなど)

をガッツリ組み込み始めると、

将来 GPT / Gemini / ローカルLLM に切り替えたくなったときに想像以上の移行コストがかかります。

特に、

- Vertex AI 経由でClaudeを使う

- → GCPロックイン + Anthropicロックイン の二重構造

というコンボは、それなりに腹を括った意思決定です。

「気軽に試したはずが、いつのまにか本番の大半がその上に乗っていた」というのは、クラウドあるあるの失敗パターンなので注意したいところです。

組織側のプロセスが“AIの進化速度”に追いつかない

Fennecクラスのモデルが本当に使い物になると、

- コードレビュー

- 設計ドキュメント

- テストコード生成

あたりは、人間が全部やる意味がだんだん薄れてきます。

ぶっちゃけ、

「AIにやらせたほうが圧倒的に速いし、そこそこ正確」な世界になります。

ここで問題になるのは、

- 最終責任は誰が持つのか

- どこまでをAIに任せて、どこからを人間がレビューするのか

- AIが出した判断(特に仕様レベルの解釈ミス)をどう検出するのか

といった「ガバナンスとプロセスの設計」です。

モデルだけ先に“Fennec級”になっても、

組織側が「昭和の開発プロセス」のままだと、品質事故か、開発ボトルネックか、そのどちらかに振り切れます。

じゃあ、プロダクションで使うか?──正直「段階的に囲い込む準備をする」が現実解

個人的な結論を書いておきます。

「全面移行はまだ様子見。ただし、“いつでも切り替えられる体制”は今から作っておくべき」

だと思っています。

まずやるべきこと

- モデル抽象化レイヤーをちゃんと作る

model = "claude-sonnet-5-fennec"を直接コード中に書かない- 「ユースケースごとに最適モデルを選択するレイヤー」を用意する

-

Prompt / Tool呼び出し / エージェント設定を モデル非依存なインターフェースで包む

-

社内ベンチマークをいつでも叩ける仕組みを作る

- テキストタスク用の社内評価セット

- コードタスク用の代表的なリポジトリ & テストシナリオ

- コストとレイテンシも含めた自動計測

-

これを GPT-4o / Opus / 現行Sonnet と 横並びで比較できる状態にしておく

-

“高コストモデルを使っているところ”から試験導入を検討

- すでに Opus / GPT-4 クラスを本番で使っている領域

- → 品質が維持できるなら、そのままFennecに切り替えれば直接コスト削減

-

品質が落ちるが許容範囲のところは「夜間バッチ」などから段階的に移行

-

安全性・コンプラ要件のすり合わせ

- Anthropic / GCP 側の

- データ保持

- モデル更新ポリシー

- 監査ログ / 追跡可能性

- を、法務・セキュリティチームと一緒に精査しておく

逆に「今はまだやらないほうがいい」と思うこと

- 「社内標準モデルを全部Fennecにする」宣言

- 「AIにPR作成まで全自動で任せて、人間レビューを大幅削減」

- 「AIチームにまるっと仕様書を投げて、プロダクトを作らせる」系のフルエージェント運用

このあたりは、モデル性能だけではなく、組織・プロセス・責任範囲の設計が追いついたときに初めて真価を発揮するレイヤーです。

Fennecがいくら賢くても、そこをすっ飛ばすと炎上案件まっしぐらです。

まとめ:Fennecは「AIを使う」時代のラストモデルかもしれない

Fennecが象徴しているのは、

- Google TPUインフラで「速くて安いClaude」が常態化する未来

- エージェント前提設計で「AIとチームを組む」ワークスタイル

- ミドルレンジ価格帯でフラッグシップ級性能が“当たり前”になる時代

です。

正直、「AIをツールとして使う」という発想だけで向き合っていると、

Fennec以降の世代には確実についていけなくなります。

我々に求められるのは、

- どのモデルを使うか、ではなく

- モデルが1〜2年で激変することを前提に、アーキテクチャと組織をどうデザインするか

という視点です。

プロダクションでFennecを即フル採用するか?

正直、まだ様子見。

でも、

- ベンチマークの枠組みを用意し

- モデル抽象化レイヤーを整備し

- 「いつでもFennecに乗り換えられる体制」を作っておく

ところまでやっておく価値は、かなり高いと思っています。

GPU世代交代のたびにPCごと買い直す人ではなく、「ボトルネックだけ差し替えられるマシン」を組んでおく人側に回れるかどうか。

その差が、これから数年のプロダクトと組織の差になっていくはずです。

コメント