「70B 以上じゃないと精度が足りない。でもそんな GPU 台数、現実的じゃない。」

ここ半年くらい、プロダクション導入の相談を受けると、だいたいこの会話から始まります。

- eval では 8B/13B だとギリギリ

- 70B にすると精度は良いけど、推論コストが一気に跳ね上がる

- オンプレで回すには VRAM も電気代もつらい

- 結局「API で外部 70B+ モデル使うか…」となってベンダーロックイン

この「品質を取るか、コストを取るか」二択ゲームにうんざりしている人、多いのではないでしょうか?

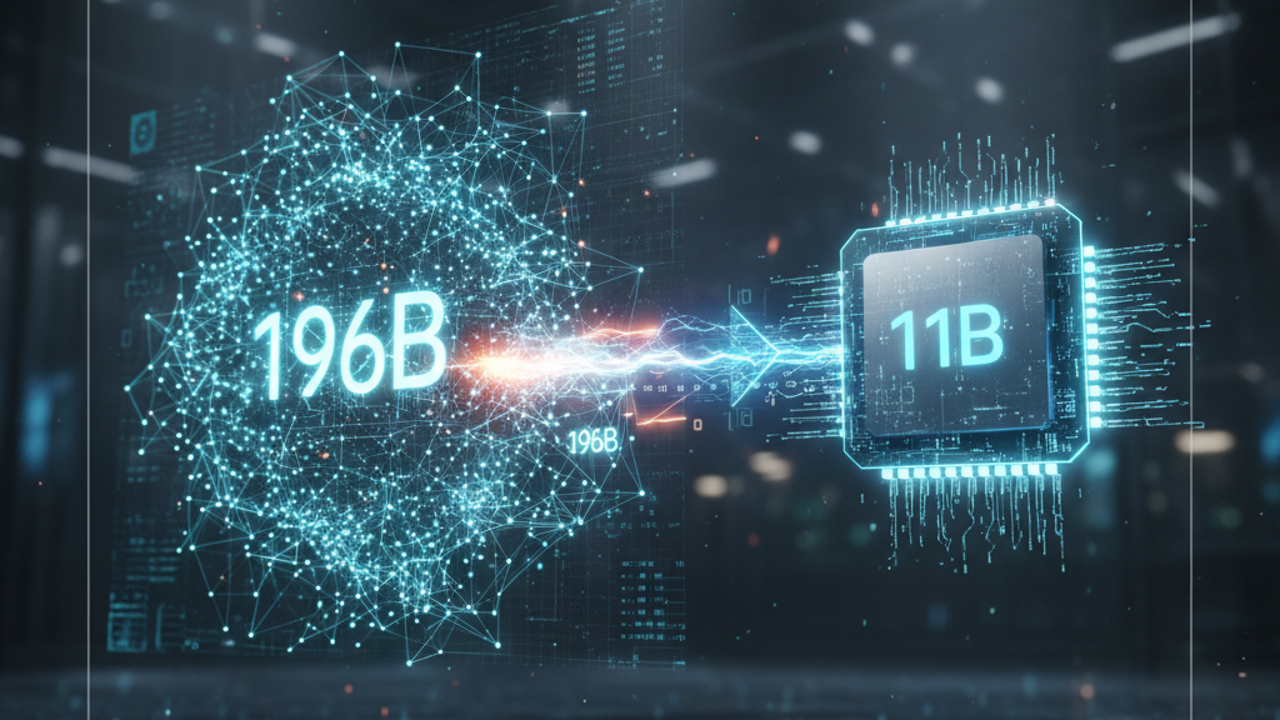

そんな中で出てきたのが、Step 3.5 Flash:「196B 相当を 11B で動かす」LLMです。

正直、このコピーだけ見ると「また誇大広告かな?」と思ったのですが、技術構造を読んでみると、

「これは CUDA 初期〜Docker 登場のときと同じ匂いがするな」と感じました。

一言で言うと、「196B を 11B コンテナに詰め込む Docker」っぽい

Step 3.5 Flash を一言で雑にたとえると、

「200B 級 LLM の体験を、11B 級のリソースに“コンテナ詰め”したモデル」

です。

- モデル全体としては 196B クラスのパラメータを持っている

- でも、推論時に実際に動くのは 11B 相当の一部だけ

- タスクやトークンごとに、必要なサブネット / エキスパートだけをアクティブにする

昔、まともな分離環境といえば「VM 一択」で、

「軽いコンテナでほぼ同じ隔離ができます」と Docker が出てきたとき、インフラ前提がひっくり返りましたよね。

今回もそれに近くて、

「高品質 LLM = 70B〜200B = デカい GPU クラスタ必須」

という暗黙の前提に、

「いや、実効 11B でもかなり近いところまで行けますよ?」と殴り込んできた感じです。

いちばんヤバいポイント:“開発用 11B” でそのまま本番を張れるかもしれない🚀

個人的にいちばんインパクトあるのはここです。

従来の現実的なフローはこんな感じでした:

- 開発・PoC:

- 8B〜13B を手元や小さい GPU で回して評価

- 本番:

- 実際にユーザーに出すと精度が足りず、70B 以上に切り替える

- インフラも API ベンダーも別物になり、挙動もコスト構造も大きく変わる

つまり、「開発用モデルと本番モデルのギャップ」が常にあった。

Step 3.5 Flash はコンセプト的に、

実行コスト:11B

品質レンジ:70B〜100B クラス

を狙っているので、極端に言えば、

- 開発も本番も 同じインフラ(1〜2枚 GPU)

- なのに体験としては 70B 級に近い

という構図が見えてきます。

ぶっちゃけ、これが実現できると、

- PoC 専用クラスタと本番専用クラスタを分ける必要が薄くなる

- 「PoC はうまくいったけど、本番で 10 倍コストになって死ぬ」というあるあるを少し避けられる

- 中堅規模の会社でも、オンプレで“ほぼハイエンド品質”を現実的に運用できる

この「プロトタイプと本番のギャップを詰める」効果は、地味ですがかなり効いてきます。

なにがそんなに効いているのか:MoE + スパース + Flash を前提から作り直した発想

技術的な中身は、超ざっくり言えば:

- Mixture-of-Experts(MoE)系の発想

- 全体としてはでかいモデル(196B 相当)

- でも各トークンが実際に通るエキスパートはほんの一部

- レイヤ・ヘッドのスパース有効化

- 全レイヤ x 全ヘッドを毎回フルで回さない

- ルーターが「この入力にはこのブロックだけ動かす」と選ぶ

- Flash 系のカーネル & メモリ最適化

- 長コンテキストでも GPU メモリ消費を抑える計算・メモリレイアウト

MoE 自体は目新しいアイデアではありませんが、

Step 3.5 Flash のポイントは「最初から“フラッシュ実行前提”でアーキテクチャを組んでいる」ところです。

多くの既存モデルは、

- まずは普通の Transformer を作る

- あとから最適化カーネルを当てる / MoE を載せる

という「後付けチューニング」発想が多いのに対し、

Step 3.5 Flash は逆で、「どうやって 11B 負荷で 196B 級を動かすか」から設計されている。

正直、この「最初から効率性を一次設計に入れている」姿勢はかなり好感が持てます。

CUDA 普及期に、「GPU 前提でアルゴリズムを作り直した」ライブラリが一気に勝っていったのと同じ匂いがします。

競合と比べてどうなのか:Llama 3 70B / 8B あたりと並べてみる🤔

開発者目線では、「で、Llama 3 と比べてどうなの?」が気になるところだと思います。

ざっくり整理するとこういう構図です:

インフラ要件の比較

- Llama 3 70B

- 4bit 推論でも実用運用しようとすると 2〜4 GPU はほぼ必須

- 長コンテキスト・高スループットはクラスタ前提

- Step 3.5 Flash

- 公称:実行時 11B クラス → 24〜48GB の GPU 1 枚〜小規模構成で現実的

- 「70B 近い品質を 8B〜13B コストで」というポジショニング

ここだけ聞くと、「8B コストで 70B 体験」にかなり近い。

「オープン vs ベンダー専用」の違い

- Llama 系

- モデルはオープン(ライセンス次第)で自前最適化し放題

- 逆にいえば、MoE 化・ルーティング最適化・カーネルいじりを自分でやらないといけない

- Step 3.5 Flash

- ルーティングも Flash 最適化もすべてベンダー側で隠蔽

- 開発者は「ふつうの LLM API」と同じ感覚で使える

- 内側のチューニングを気にしなくてよい

スピード重視でプロダクトを作りたいチームからすると、

「オープンモデルで 70B を自前最適化する」

vs

「Flash をベンダー API で借りる」

を比べたとき、後者がだいぶ魅力的に見えるのは事実です。

一方で、

- 自前クラウド/オンプレに完全に閉じたい

- ライセンスやデータ扱いを完全にコントロールしたい

- モデルの中身まで含めてチューニングしたい

という組織にとっては、

「効率は魅力だが、ベンダーロックインとブラックボックス性が怖い」という、別の悩みが出てきます。

本当に「ルールチェンジ」なのか?

歴史的な感覚で言うと、今回のインパクトは

CUDA 普及で「スパコン専用だった計算」がコンシューマ GPU に降りてきた

+

Docker で「VM 必須の重さ」がコンテナで軽量化された

この二つを足して 2 で割ったくらいの変化に見えます。

- これまで:

- 「ちゃんとした品質」はクラウドの巨大モデル +

- 「ローカル / 小規模 GPU」はあくまで簡易版

- これから:

- 小規模 GPU でも、かなり“本気品質”に近い体験ができるかもしれない

特に、スタートアップや小さめの事業部にとっては、

- いきなりマルチ GPU クラスタを抱える必要がない

- でも PoC レベルの品質で妥協しなくていい

というのは戦い方を変えうるポイントです。

「ハイエンド品質=大企業専用」という空気が、じわじわ壊れていく可能性があります。

ただ、懸念点もかなりデカいです…⚠️

ここまで割とポジティブに書いてきましたが、

エンジニアとして冷静に見ると、「これは怖いな」というポイントもいくつかあります。

モデルサイズ vs 実行サイズのギャップ

「196B 相当を 11B で動かす」というフレーズ、

裏を返せばこうです:

ストレージ上は 196B 規模の何かを抱えている(可能性が高い)

- ディスク上のモデルサイズは依然として巨大

- 推論時にどのエキスパートをどのタイミングでロード・キャッシュするかの戦略が必要

- モデルのバージョン管理やデプロイが、素の 11B より一段複雑になる

クラウドベンダー側は隠蔽してくれますが、

オンプレで同じことをやろうとすると、インフラ設計はやっぱり結構しんどいはずです。

ルーティングの安定性リスク

MoE / スパースモデルあるあるですが:

- 特定のエキスパートに負荷が偏る「ルーター崩壊」

- ドメイン外タスクで妙なエキスパートを踏んで急に品質が落ちる

- ロングテールでだけ出る謎の不安定挙動

このあたりのリスクは、Step 3.5 Flash も当然抱えています。

ベンチマークの平均スコアや、有名なタスクでは強いけれど、

- 特定の業務ドメイン

- 日本語+専門用語の長文

- 変なフォーマットの入力(崩れた JSON、半端なログ)

みたいなところで突然「穴」が出る可能性は、正直かなりあると思っています。

プロダクション導入前には、

- 自分たちの実タスク・実データでの PoC

- ロングテールケースの徹底検証

をサボると痛い目を見るタイプのモデルです。

ベンダーロックイン問題

ここが一番エンタープライズ的には重い。

- 196B-equivalent @ 11B という効率は、高度に専用設計されたアーキテクチャ+実装最適化の結果

- 同じものを自前で再現するのは、現実的にはほぼ不可能

つまり、

一度「Step 3.5 Flash を前提としたコストモデル・SLA」でプロダクトを組むと、

他モデルへのマイグレーション時に、性能かコストのどちらかをほぼ確実に失う

という構図になります。

- 別ベンダーの 70B に移行 → コスト増

- オープン 13B に落とす → 品質ダウン

この「後戻りコスト」がデカいので、

短期の API 料金だけ見て飛びつくと、数年後に苦しくなるパターンが普通にありえます。

Fine-tuning / 拡張の難しさ

MoE / スパース構造は、微調整がかなりクセがあります。

- どのエキスパートがどのタスクに効いているのか見えにくい

- Fine-tune すると一部エキスパートだけ過学習して、ルーターが偏る

- LoRA などの既存ノウハウがそのまま効くかは怪しい

結果として、

- ベンダーが用意する Fine-tune / Adapter / RAG フレームワークに依存せざるを得ない

- 自社でモデルに手を入れる自由度は、素の Transformer より確実に落ちる

ここもまた、ロックイン要因です。

「プロダクションで使うか?」と言われたら、正直こう答えます

エンジニアとしての本音を言うと、

「即フルコミットするのは怖い。でも PoC しない手はない」

というスタンスです。

こういう組織は PoC すべきだと思う

- 既に 70B クラスの API コストに悩んでいる

- 8B〜13B では品質がギリギリ足りない

- GPU インフラは 1〜4 枚程度で抑えたい

- 開発スピードを優先して、モデル内部にガッツリ手を入れる予定は薄い

こういうチームにとっては、Step 3.5 Flash はかなり“刺さる”選択肢になるはずです。

一方で、即採用をためらうべき条件

- モデルをがっつり自前チューニングしたい

- 長期的にベンダーフリーでいたい

- 規制やコンプラ的に、モデル内部や学習ルールまで把握しておきたい

こういう条件が強い組織は、

むしろ Llama 3 系 + 自前最適化の路線を強化したほうが健全だと思います。

最後に:この「11B で 196B 体験」は、一度触ってみないと損

ぶっちゃけ、Step 3.5 Flash の一番の価値は、

「高品質 LLM はデカいモデルじゃないと無理」という思い込みを、一度壊してくれること

だと思っています。

- 実際に 11B クラスの負荷でどれくらいの体験が出せるのか?

- 自分たちのユースケースで、どの程度「70B 卒業」が可能なのか?

- その代わりにどんなロックインとトレードオフを飲む覚悟が必要か?

このあたりは、記事を読むだけでは絶対に見えてきません。

正直、プロダクション前提で即採用するのはまだ様子見ですが、

「自社ユースケースでの PoC」をしないのは逆にリスクだとすら思います。

- コストメリット vs ロックインリスク

- ベンチマーク性能 vs ロングテール安定性

この 2 軸で、自分たちの現実のデータで冷静に評価してみる。

そのうえで「70B 依存から卒業できるか?」を判断するのが、

2025 年に向けて賢いやり方かな、というのが現時点での結論です。

コメント