「また“最強モデル”って言ってるけど、

・APIはバラバラ

・料金は読めない

・結局、社内導入はセキュリティレビューで止まる

……そんな経験、ありませんか?」

そんな中で出てきたのが「Google Gemini 3 Pro 逆転勝利」のニュースです。

でもこの記事では、スペック自慢やお祭り騒ぎよりも、

「エンジニア目線で、本当にゲームチェンジなのか?」

というところを、かなり辛口寄りに整理してみます。

一言でいうと:これは「GPT-5に勝った」話じゃなくて「Docker後にGKEが標準化した」話

ニュースのトーンは派手です。「逆転勝利」「ChatGPT帝国崩壊」「今年最強AI」…。

でも技術的に落ち着いて見ると、一言でこう言い換えた方が正確だと思っています。

ChatGPT が「生成AIという概念」を世界に広めた。

Gemini 3 Pro は、「エンタープライズで回せる標準スタック」として一気に台頭してきた。

これはちょうど、

- Docker が「コンテナ」という概念を普及させて、

- その後 Kubernetes + GCP が「企業の標準インフラ」として伸びた

あの流れにかなり近いです。

ぶっちゃけ、

「モデル単体のIQ勝負でOpenAIを完全に粉砕した」という話ではなくて、

「モデル+クラウド+Workspace+エージェント基盤、の“総合点”で企業案件を取りに来た」

ここが今回いちばん重要なポイントです。

何が本当に新しい?:モデルより「プラットフォームのかたち」が変わった

「Gemini 3 Pro 世代」= GPT-4.1 / o3 への世代交代クラス

スペック面の主張はこんな感じです。

- 推論能力は GPT-4〜4.1 競合、ケースによっては上回る

- 数十万トークン級の長文処理を、実務的に扱える

- 画像・音声・テキスト・一部動画を 単一モデル でネイティブ処理

- コーディングもかなり強く、特にコード変換やリファクタが得意という体験談多数

正直、このレベルになると「どっちが1割強いか」なんて、

現場の開発者からするとあまり重要ではありません。

実際のプロダクトで効いてくるのは、

- レイテンシ(どれだけ待たされないか)

- 価格 / トークン単価

- マルチモーダルの“つなぎの良さ”

- そして何より 既存システムとの統合コスト

で、今回の Gemini 3 Pro は、まさにこの「統合コスト」の部分に全振りしてきた印象があります。

マルチモーダル前提の設計が“ほんとに”前提になった

Gemini 3 Pro が掲げる「単一モデルで画像・音声・テキスト・一部動画」がなぜ重要か。

ここが変わると、設計の初手が変わります。

- これまで:

「まずチャットUI作って、PDFアップロード機能つけて、あとで音声も…」 - これから:

「画面キャプチャ+ログ+仕様書PDF+音声メモをまとめて投げられるエージェント」を

最初から設計に入れやすい

たとえば、こんなユースケースが現実味を帯びます。

-

バグ報告エージェント

→ ユーザーの画面キャプチャ、ブラウザログ、仕様書PDFをまとめて解析して、

再現手順・原因候補・修正案パッチまで出してくれる -

営業支援エージェント

→ 商談録音、送付資料、過去のメールスレッド、社内ナレッジを一括で食わせて、

「この案件の次の一手」を提案

正直、GPT-4.1 でも「頑張れば構成できる」世界でしたが、

Google はここを 標準機能として「当たり前」にした というのが大きい。

「逆転勝利」の本質:OpenAI と比べて何が“実務的に”効くのか

ここが今回いちばん議論したいポイントです。

モデルの強さより「プラットフォームの深さ」が効いている

OpenAI との比較を、エンジニアが気にする4つの項目でざっくり整理すると:

① モデル能力

- GPT-4.1 / o3

- 依然としてコーディング・推論はトップクラス

- o3 は「思考時間を伸ばして精度を上げる」という設計

- Gemini 3 Pro

- 「総合力で逆転」という主張

- 特に

- マルチモーダル(画像+テキスト+コード)

- ドキュメント QA

- 社内ワークフロー連携

に強いという声が多い

純粋な「数学・論理パズル・アルゴリズムコンテスト」でどっちが勝つか、正直もうどうでもよくて、

業務アプリに落とした時の「総合点」で見るべきフェーズに入ったと思っています。

② エージェント・プラットフォームとしての完成度

- OpenAI

- Assistants API / Realtime API は素直で使いやすい

- ただし、ID管理・権限・監査ログは自前実装 が基本

- Gemini 3 Pro + Google Cloud / Workspace

- IAM / Cloud Logging / VPC など GCP のガバナンス基盤と直結

- Gmail / Docs / Sheets / Drive / Calendar との連携がテンプレ化

- 「社内Copilot」系エージェントを、ISMSレビューを通る形で 組み込みやすい

ここが「逆転勝利」と言われる一番の理由だと思います。

AIそのものではなく、企業ITの文脈での“勝ち筋”を取りに来た。

正直、情報システム部やセキュリティ部門と話したことのある人なら分かると思いますが、

「OpenAI の API を社外SaaSとして叩きに行く」のと、

「既に契約済みの Google Cloud / Workspace の延長として Gemini を使う」のでは、

社内稟議の通りやすさがまるで違います 🤦♂️

③ コスト構造

逆転勝利報道では「同じ価格帯なら GPT-4 クラスを超える」「price/perf で優位」といったトーン。

- トークン単価が数%安いだけでも、

- 大量トラフィックのB2Bサービスでは、月数百万円レベルの差 になり得る

しかも Google は自社TPU(Ironwood など)でスケールさせていて、

NVidia依存を減らそうとしている。

これは中長期的には「コスト面での武器」になるのはほぼ確定です。

④ エコシステムの厚み

- OpenAI

- LangChain / LlamaIndex / LangGraph など、OSSエコシステムの中心

- Qiita / Zenn / Stack Overflow に転がっているサンプルの大半が OpenAI 前提

- Gemini

- 最近ようやく主要ライブラリが対応してきたが、

- まだ「まずOpenAIで書かれた記事を、Geminiに読み替える」フェーズ

ここは正直、まだ OpenAI が圧勝です。

ただし、企業案件の実装 においては、

- OSSサンプルの多さ <<<

- 既存クラウドスタックとの統合しやすさ

になる場面も多い。

この分野で Google はようやく“本気モード”に入った、という印象です。

エンジニア目線の「本当のキラーフィーチャー」はどこか

「エージェント指向」がデフォルトになったこと

Gemini 3 Pro では、

- モデル呼び出し

- ツール(関数)呼び出し

- ベクトル検索

- ワークフロー(マルチステップ)

が 「エージェント」という一枚の抽象レイヤ にまとまってきました。

これが何を意味するかというと:

- 従来:

- フロントエンド → API Gateway → 自前のLangChain / 自作フレームワーク → OpenAI API

- これから(Gemini前提設計):

- フロントエンド → 「Geminiエージェント」(クラウド側)

- 自分たちは

- ツール(業務API)を定義し

- プロンプトと権限設計に集中すればよい

要するに、バックエンドが「LLMフレームワークの自作」から

「エージェントへのタスク指示とツール提供」に役割シフト する。

これ、実はかなり大きい変化です。

アプリを作るより「エージェントを作る」方が標準になると、

- チーム編成

- 認証設計

- ロギング

の考え方がガラッと変わる。

Google スタックに乗っている企業にとっての「ずるいくらいの優位」

既に

- Google Workspace(Gmail / Docs / Drive)

- Google Cloud(GKE / Cloud Run / BigQuery / Cloud SQL)

にお世話になっている企業にとっては、

Gemini 3 Pro はもはや

「AIを新しく導入する」のではなく

「既存システムに、エージェントを追加する」

くらいの感覚に近くなります。

ID管理・SSO・監査ログ・データ所在地…

この辺を“もう一社分”説明しなくていいのは、

プロダクション導入の現場ではとんでもなく効きます。

正直、

「技術的な好みではOpenAI派だけど、

社内政治とコンプラを考えるとGemini一択なんだよな…」

という状況、これから一気に増えると思います。

ただし、懸念点もかなりデカい

ここまでベタ褒め気味に書きましたが、当然ネガティブ要素もあります。

むしろここを見ずに「逆転勝利だ!全部乗り換えだ!」となるのは危険です。

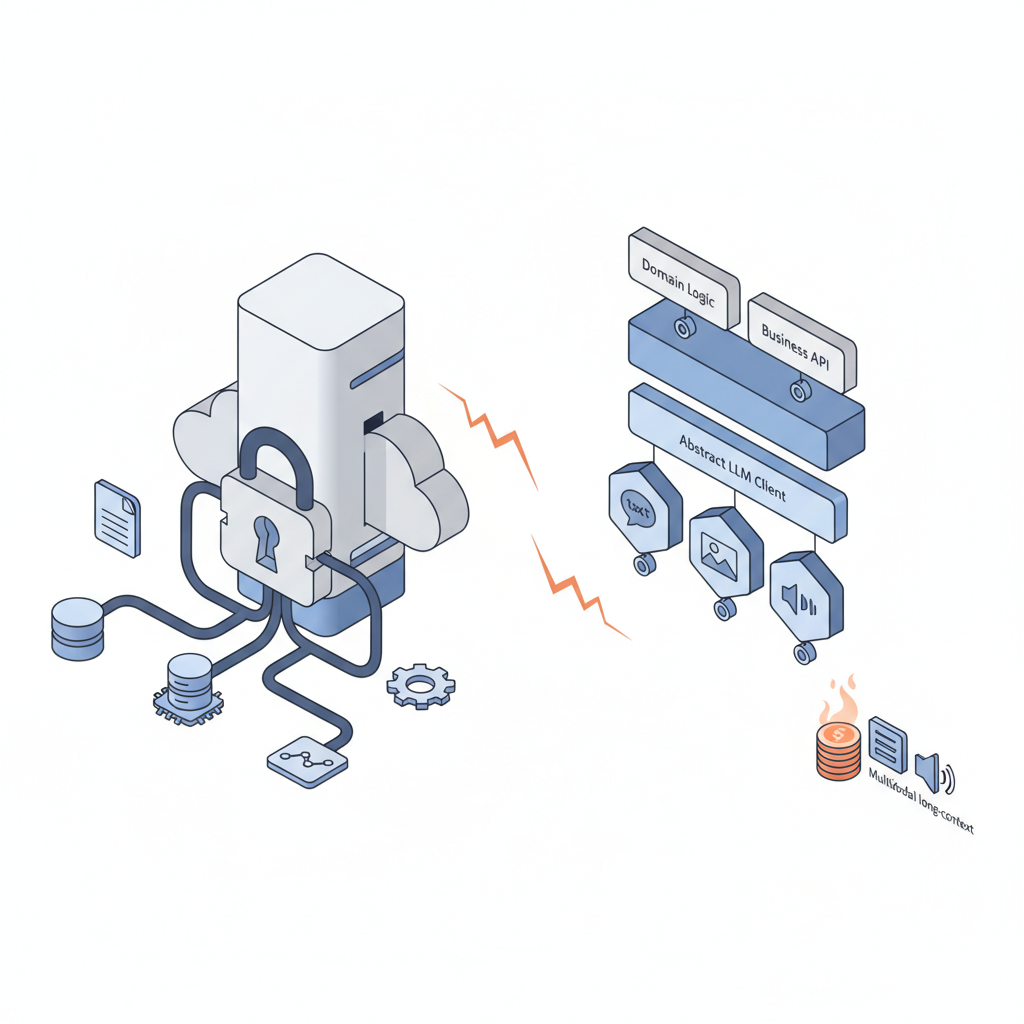

ベンダーロックインがガチで強烈になる懸念

Workspace / IAM / Drive / BigQuery / Gemini エージェント…

このあたりをフル活用すればするほど、

「インフラ全体を Google 前提で固めてしまう」

リスクが一気に高まります。

- モデル差し替えが難しくなる

- 料金改定に振り回される

- 他社モデル(Anthropic / オンプレLLM)を混ぜにくくなる

対策としては、

- 必ず モデル抽象レイヤ(LLMクライアント) を挟む

- 業務ロジックやワークフローは「Geminiに依存しないドメイン層」として切り出す

- 重要なビジネスAPIは、LLM抜きでも動くように保つ

この辺りを最初から設計に入れておかないと、

数年後に「これ、Gemini以外に移せないじゃん…」となる未来が普通に見えます。

コスト爆死リスク:マルチモーダル+長コンテキストは財布を焼く

「長文も一気に読めます!」「画像も音声もOK!」

──これはすべて、財布への攻撃力が高い という意味でもあります。

ありがちなパターン:

- PoC:

- 社内文書をとりあえず全部入れてみる

- 音声もPDFもスライドも雑に食わせて「おお、動いた!」となる

- 本番運用:

- ユーザー数と問い合わせ頻度が増えていく

- 月のクラウド請求書を見て青ざめる

特に、

- 一回のリクエストで数十万トークン食う設計

- 画像数ページ+PDF数十ページを毎回投げる

- 音声文字起こし+要約+議事録生成を全会議で自動実行

このあたりは、Gemini 3 Pro であっても容赦なくコスト地獄行きです。

正直、PoC段階で「本番トラフィックを想定したコスト試算」をやらないのは、自殺行為。

ここは「モデルが強くなったから解決」という話では全くありません。

期待値バブルと現実のギャップ

メディアのトーンは明らかにバブルです。

- 「フロントエンドエンジニア終了」

- 「OSを一撃で生成」

- 「Nano Banana 2 でPhotoshop終焉」

- 「バフェットが 43億ドル即決投資」

こういうデモは確かにすごいし、技術的ジャンプもある。

ただ、プロダクションに落とすときに重要なことはだいたい次の3つです。

- どれだけ 安定して 同じ品質を出せるか

- 異常系(ツール呼び出し失敗・タイムアウト・ハルシネーション)をどう扱うか

- 人間のレビュー・承認フローをどう組み込むか

ここは Gemini 3 Pro になっても魔法のようには解決しません。

むしろ「逆転勝利」という見出しによって、

経営層の期待値が変に上がり、現場が火消しに走る未来すら見えるレベルです。

エコシステム・ナレッジの薄さ

Google のドキュメントやコンソールが劇的に良くなった、とはまだ言い難いです。

そして、

- 「Gemini 3 Pro + エージェント + GCP + Workspace」

の組み合わせに特化したノウハウは、

まだ世の中にほとんど出回っていない。

OpenAIまわりなら、

- 何か困れば GitHub / Zenn / Qiita / Stack Overflow で

同様のハマりポイントがだいたい見つかる

この差は、実務ではかなり効きます。

初期導入で「全部自分たちで試行錯誤する覚悟」がないと、

Gemini陣営に寄せすぎるのは危ないタイミングでもあります。

じゃあ、プロダクションで使うか?:自分ならこう判断する

正直に書きます。

「今すぐすべてを Gemini 3 Pro に乗り換える」はおすすめしません。

ただし、「Googleスタック前提の新規案件」なら、

第一候補として真剣に検討するフェーズに入った のは間違いない。

自分ならこう使い分けます

既に Google Cloud / Workspace にどっぷりな企業

- 社内向けエージェント(ナレッジ検索、社内Copilot)

- コールセンター支援 / 営業支援

- ドキュメント・メール・カレンダー・Driveを跨ぐワークフロー

このあたりは Gemini 3 Pro を第一候補 にします。

理由は単純で、

- 認証・権限・監査ログの話が一気に楽になる

- 社内稟議が通りやすい

- 「エージェント基盤」を再発明しなくていい

からです。

OSS・研究寄り・プロトタイプ重視のプロジェクト

- LLMエージェントの新しいパターンを試す

- コーディング支援やペアプロツール

- OSSフレームワークと連携したRAG実験

この領域では、まだ OpenAI(+Anthropicなど)優位 だと見ています。

- 情報量

- サンプルコード

- OSSとの噛み合わせ

ここでの差は、モデルの差数%では埋まりません。

長期的に複数クラウドを跨ぎたいプロダクト

- そもそもベンダーロックインを避けたい

- 既に AWS / Azure / GCP が混在している

- オンプレLLMも射程に入れておきたい

こういうプロジェクトでは、

- まず自前の LLM抽象レイヤをきちんと定義する

- Gemini 3 Pro / GPT-4.1 / Claude / OSS モデルを切り替え可能にする

- そのうえで、

- 社内向けエージェント部分だけ Gemini に寄せる

- 外部API向けサービスは OpenAI 前提で作る

といった ハイブリッド構成 を取ります。

最後に:これは「OpenAIの終わり」ではなく「一強時代の終わり」

個人的な結論はこれです。

- 「Gemini 3 Pro が OpenAI を蹂躙した」という話ではない

- 「OpenAI 一強で“とりあえずGPT前提”だった空気が、ようやく崩れた」が近い

- 特に 企業IT / Googleスタック依存組 にとっては、

真面目に乗り換えを検討していいレベルに到達した

正直、エンジニアとしてはこの状況がいちばん健全です。

- モデル同士が切磋琢磨して性能が上がる

- 価格競争が起きる

- 各社がエージェント基盤や統合UXを磨かざるを得なくなる

そして我々がやるべきことはシンプルで、

- ベンダーのマーケではなく、自分の手でベンチを回す

- モデルではなく「プラットフォームとしての総合力」で評価する

- ロックインとコストの落とし穴を、最初から設計に織り込む

そのうえで、

- ChatGPT も

- Gemini も

- 他のモデルたちも

冷静に「道具」として選び分ける。

「Gemini 3 Pro 逆転勝利」という見出しに乗って右往左往するより、

エンジニアとしては、そこまで含めて静かに設計図を書き直すタイミングなんだろうな、

というのが正直な感想です。

コメント