- 「またLLM出たのね」で終わらせるには惜しい:Gemini 3.1 Pro が開いた“次のフェーズ”

- 一言でいうと:「チャットモデル」ではなく「オーケストレーター」としてのLLM

- Docker → Kubernetes に似ている理由

- “ニュース”として何が新しいのか(雑に整理)

- じゃあ、Claude や他社と比べて何が“ガチ”なのか?

- 導入前に押さえるべきリスクと注意点

- コスト設計:トークン単価の安さに騙されない

- 結論:本番導入は「用途と統制」次第(段階導入が現実解)

- ビジネス視点:Gemini 3.1 Pro導入判断のチェックリスト(ROI/リスク/運用)

- まとめ:Gemini 3.1 Pro は“PoC時代の終わり”を知らせるベルかもしれない

- 関連リンク

- FAQ

「またLLM出たのね」で終わらせるには惜しい:Gemini 3.1 Pro が開いた“次のフェーズ”

結論(忙しい人向け)

- Gemini 3.1 Proは「チャットが賢い」よりも、マルチモーダル統合+ツールコール前提で“業務ワークフローを回す基盤”に寄ったのが本質。

- PoCは回るのに本番で崩れる(権限・監査・コスト・再現性)問題に、モデル側の安定度が少し追いついてきた。

- 一方でガバナンス/セキュリティ/ベンダーロックイン/コスト爆発は重要度が増えるので、導入はチェックリスト前提で。

想定読者:CTO/PM/情シス/AI推進(導入判断)、および実装するエンジニア

「LLM使ってPoCはうまくいくのに、プロダクションに乗せると途端にグダグダになる…」

「マルチエージェント?とりあえずLangChainつないでみたけど、メンテつらすぎない?」

そんな経験、ありませんか?

正直、ここ1年くらいのLLMアップデートって、

「精度上がりました」「トークン増えました」以上のインパクトが見えにくいものが多かったと思います。

ところが今回の Google Gemini 3.1 Pro は、

関連記事:Gemini 3.1 Proの発表まとめ / Gemini 3.1 Proのリリース整理

「また新モデルね」で流すにはちょっと惜しい。

一言でいうと、

「Chatbot界のKubernetes」になり得る存在が、やっとちゃんと出てきた

という印象です。

この記事はニュース要約ではなく、

エンジニア視点で “どこが本当にヤバいのか/どこはまだ信用できないのか” を整理した意見記事です。

一言でいうと:「チャットモデル」ではなく「オーケストレーター」としてのLLM

まず、今回のポイントを雑にまとめると

- Gemini 3.1 Pro = 3.1世代の“事実上のフラグシップ”

- 性能は Ultra クラス寄り、価格とレイテンシは Pro クラスに近いポジション

- 推論性能は 1.5 Pro 比で 2倍以上速いという検証がちらほら

- 完全マルチモーダルが “ガチで統合” された

- テキスト / 画像 / 音声 / ツールコールが 1モデルで完結

- もはや「テキストモデル + Visionおまけ」ではなく、

日本語の解説でも「完全なマルチモーダルLLM」と呼ばれている - ツールコールが “実験的” から “前提機能” に昇格

- JSON出力やチェインされたツール利用がかなり安定

- マルチエージェント構成が「無茶な遊び」ではなく現実解に近づいた

つまりこれは、

「LLM = チャットボット」から

「LLM = ツール・エージェントを束ねる基盤レイヤ」

へのシフトを、Googleがはっきり宣言した一手だと感じています。

この感覚、どこかで見たことありませんか?

そう、Docker → Kubernetes の転換期にかなり近いです。

Docker → Kubernetes に似ている理由

Docker が出てきたとき、みんな「コンテナ便利じゃん」で終わってた。

でも K8s が出てきて初めて、

- コンテナが「アプリ実行の前提レイヤ」になり、

- インフラ設計そのものが「K8s前提」で再構成された

LLM も同じフェーズに入りつつあると感じています。

- GPT-3〜4、Gemini 1.5 時代

→ 「LLM使うと便利」「PoC作りやすい」=Docker期 - Gemini 3.1 Pro や Claude Opus 4.6 世代

→ 「LLMを前提にしたアーキテクチャを組める」=Kubernetes期

Gemini 3.1 Pro が面白いのは、

この「Kubernetes期」を意識してチューニングされているのが露骨に見えるところです。

- 長文コンテキスト(5万トークン超でも安定)

- ツールコール前提の推論エンジン

- マルチエージェント構成を想定した一貫したJSON出力

- テキスト / 画像 / 音声を、全部同じAPIコールで扱える

ぶっちゃけ、

「LLMを UI としてではなく、“分散オーケストレーター” として本気で使うなら、もう 3.1 Pro クラスが最低ラインになってくる」

そんな時代への入口だと思います。

“ニュース”として何が新しいのか(雑に整理)

事実関係だけ最小限で整理すると:

モデル:Gemini 3.1 Pro は「Ultra級Pro」

- 位置づけは 3.1 世代の汎用フラグシップ

- Googleはあえて「Ultra」とは呼んでいないが、

実効性能は 1.5 Pro から見るとだいぶ別物 - ベンチマークや Qiita/Qiita note 系でも:

- 推論スループット・速度が 1.5 Pro 比で 2倍以上

- 特にコード生成・ツール使用・長文タスクで差が大きい

完全マルチモーダル:Visionが「おまけ」じゃなくなった

- テキスト / 画像 / 音声 / ツールコールが1つのモデル・1つのエンドポイント

- つまり:

- 「画像理解したあと、その結果を元に社内APIを叩く」

- 「音声→要約→タスク登録→コード生成」

みたいなのが 1つのLLMコンテキストの中で完結 しやすい

これ、地味に他社との差別化ポイントです。

いまだに「textモデル」「visionモデル」「audioモデル」がバラバラで、

API設計も別物なプラットフォームは多いので。

ツールコールが “Labs” から “前提機能” へ

- 以前は「function calling あります、でも挙動ちょっと不安定です」レベル

- 3.1 Pro では:

- JSONスキーマにほぼ忠実

- 複数ツールを一度に計画して呼び出す

- 間違ったスキーマ利用を自力で自己修正する挙動も観測されている

Zenn の「Gemini 3.1 Proで構築するマルチエージェント協調コーディング」の記事では、

- Architect / Planner / Coder / Reviewer といった複数ロールのエージェントを全部 Gemini 3.1 Pro で構成

- ファイル読み書き、テスト実行、リポジトリスキャンなどをツールコールで実施

- コンテキストにリポジトリ全体をそこそこ突っ込んでも破綻しにくい

といった例が出てきます。

ここまで来ると、

「マルチエージェント = 変態的なプロンプト職人芸」

から

「普通のアプリケーションコード + LLM ツールコール」

に徐々に降りてきている感じがあります。

じゃあ、Claude や他社と比べて何が“ガチ”なのか?

正直、「一番頭がいいモデル」の椅子は、まだ Claude Opus 4.6 の方が強い、という見方が多いです。

Claude Opus 4.6 が勝っているところ

- 数学・論理パズル・法律/哲学っぽい純粋推論タスク

- 特に日本語の長文での「ニュアンス」「丁寧さ」「論理の一貫性」

ある検証ノートでは、

Gemini 3.1 Pro との比較で「純粋な推論では “絶対的な壁” がまだある」とまで書かれていました。

つまり:

- 「数学的に絶対に間違えたくない」

- 「法務/コンプラで、1文のニュアンスミスも許されない」

みたいなユースケースなら、

いまだに Claude を選ぶ理由は十分あると思います。

一方で、Gemini 3.1 Pro が “現場で勝ちやすい” ポイント

マルチモーダル実務タスク

- テキスト + 画像 + (場合によっては音声)を一発で投げられる

- 例:

- UIスクリーンショット + 仕様テキスト → フロントのコード + テストケース + コピー案

- 機械の写真 + マニュアルの一部 → 故障推定と対応手順

- これを1モデル / 1エンドポイント / 1課金体系で完結できるのは、実務的にはめちゃくちゃ楽です。

「マルチモーダル特化スタートアップ、また死ぬのでは…」という悲観的コメントがあるのも正直わかります。

「まあまあ強いマルチモーダル」がGCPの請求書1枚で全部揃うなら、

よほどドメイン特化(医療画像とか)しないと差別化はきつい。

ツールコール & マルチエージェント適性

- JSON出力の安定度が高い

- ツールチェーンを自分で計画して複数回呼び出す挙動

- 長コンテキストでも「ツール忘れ」が減っている印象

これ、何が嬉しいかというと:

「LangChainやLlamaIndexが、“弱いモデルを何とかするための魔術ツール” から、

“エンタープライズ向けの接着剤・監査基盤” に役割がシフトしつつある」

ということです。

Gemini 3.1 Pro 自体がある程度「自律的に」ツールを扱えるので、

過剰なルーティングやガードレールをプロンプトでゴリ押しする必要が減る。

もちろん LangChain 等が不要になるわけでは全くなくて、

今後はもっと「ポリシー管理」「ログ・観測」「データインデックス」といった上位レイヤの価値が重要になっていくと思います。

スピード & コスト効率

- 1.5 Pro 比で 2倍以上の推論スループット

- 長文タスクでも Opus と比べて速いことが多いという報告

- 価格も「Ultra級の頭脳」ほどは高くないレンジに収まっている

エンタープライズ視点だと、

- 「各チームが自由にエージェントを生やす」

- 「内部ツールの裏側に全部LLMがいる」

みたいな“LLMがOS化” する未来を考えたとき、

このスピード/コスト特性はかなり重要です。

「一番頭がいいか」よりも

「大量のワークロードを、破綻せず・安く・統一APIで回せるか」

Gemini 3.1 Pro は、明らかにこちらを狙ってきています。

導入前に押さえるべきリスクと注意点

ここまで褒めましたが、もちろん「これで全部解決!」とは全く思っていません。

運用は楽にならない:複雑さは「モデルの外」に残る

モデルが賢く・速くなった代わりに、

複雑さの主戦場がアプリケーションアーキテクチャ側に押し出されています。

- マルチエージェント構成

- ツールの権限管理(どのエージェントが何を実行できるか)

- 長大コンテキストでのプロンプトインジェクション対策

- ログ・監査・リプレイ

これらは Gemini 3.1 Pro がどれだけ賢くなっても、勝手には解決してくれません。

ぶっちゃけ:

「LLMオーケストレーション = 新しい分散システム設計」

という認識を持たないと、そのうち痛い目を見ると思います。

性能が上がっても「再現性」は別問題

いくらツールコールが安定したとはいえ、

- 生成はあくまで確率的

- たまにフォーマットを壊す

- 思いもよらない解釈をする

という現実は変わりません。

- スキーマバリデーション

- リトライ & 自己修正ループ

- 危険な操作(削除・課金系API)には人間の承認フロー

こういったシステム側の安全装置は、

Gemini 3.1 Pro 時代でも絶対に必要です。

Zenn のマルチエージェント記事でも、

- ファイル差分の検証

- テスト実行

- 最終マージ前の人間レビュー

といったループが結局必須になっていました。

ここはモデルが賢くなってもショートカットできない部分だと思います。

マルチモーダルでセキュリティの攻撃面が広がる

画像・音声を食えるということは、

- スクリーンショット内に埋め込まれた誘導テキスト

- 図表へのステガノグラフィ的な指示

- 音声による「隠れプロンプト」

など、新しいタイプのプロンプトインジェクションが普通に出てきます。

さらに、

- 画像・音声データの保存ポリシー

- マスキング / 匿名化のやり方

- 規制対象データ(医療画像など)の扱い

など、法務・コンプラとのすり合わせコストも確実に増えます。

技術的には面白いのですが、

企業導入の現場では「やればやるほどガバナンス仕事が増える」側面は無視できません。

ベンダーロックインはより強くなる(移行コスト増)

Gemini 3.1 Pro は

- Vertex AI

- Google Cloud IAM / ログ

- Workspace(Docs, Slides など)

と、がっつり絡めて使う設計が想定されています。

メリット:

- 認証・監査・ネットワーク周りを GCP で完結できる

- 既存の GCP スタックときれいにつながる

デメリット:

- Gemini前提のツールコール設計やプロンプトパターンにどっぷり浸かると、他社LLMへの乗り換えコストが爆上がりする

「マルチクラウド戦略だから…」と言いつつ、

実際には運用チームとプロンプト・ツール設計が1社にベッタリ、という未来が普通に見えます。

コスト設計:トークン単価の安さに騙されない

トークン単価だけ見ると「結構安いじゃん」と感じるケースも多いですが、

マルチエージェント & 長コンテキスト & マルチモーダルを真面目にやると:

- エージェントの数だけプロンプトが増える

- 長コンテキストで1回の呼び出しトークンが爆増

- 画像 / 音声は別課金体系だったりする

結果として、

「月のGCP請求書、気づいたらLLM関連が一番デカい科目になっていた」

みたいな未来は普通にありえます

- チームごとのクォータ

- 明示的なコストアラート

- ログベースでの“1ワークフローあたりコスト”の可視化

このあたりを、最初からシステム設計に織り込むべきフェーズに入りつつあると思います。

結論:本番導入は「用途と統制」次第(段階導入が現実解)

エンジニアとしての自分の暫定スタンスはこんな感じです

Gemini 1.5 Pro利用中なら:移行PoCの進め方

- 3.1 Pro への移行 PoC は“今すぐやるべき”レベル

- モデル名を差し替えて A/B テスト

- 特に:

- コーディング支援

- 長文ドキュメントQA

- ツールコール前提のワークフロー

- ここは実際に比較すると体感で分かる差が出るはず

ただし:

- 既存のツールスキーマとの互換性チェック

- 出力フォーマットの回帰テスト

- レイテンシ / コストの計測

このあたりは普通のバージョンアップと同じレベルで慎重にやる必要はあります。

Gemini vs Claudeで迷ったら:判断軸(品質/運用/コスト)

自分なら、こう切り分けます:

- Claudeを選ぶケース

- 数学・法律・論理パズル系など純粋推論の精度がクリティカル

-

日本語の文体やニュアンス品質を最重要視するサービス(長文生成メイン)

-

Gemini 3.1 Pro を選ぶケース

- ツール連携・マルチエージェント・マルチモーダルがガチ本命

- コスト/レイテンシも含めた大量ワークロード前提

- すでに GCP / Workspace にどっぷり浸かっている

個人的には、

「LLMが裏方としてガンガン仕事をする社内ツール群」には Gemini 3.1 Pro、

「一撃の答えの正確さがすべてな専門業務」には Claude、

という棲み分けがしばらく続くと見ています。

新規でエージェント基盤を作るなら:採用判断と前提条件

Gemini 3.1 Pro を “中央オーケストレーター” として採用するのは十分アリだと思います。

ただし前提として:

- 各エージェントのロールと権限をシステム側で明示的に制限

- すべてのツールコールをログ & 監査可能に

- JSONスキーマ・バリデーション・テストを最初から組み込み

「LLMが賢くなったから守りをサボっていい」ではなく、

“より強力なオートメーションを導入するからこそ、ガバナンスを強化する” という発想が必要です。

ビジネス視点:Gemini 3.1 Pro導入判断のチェックリスト(ROI/リスク/運用)

技術的に魅力があっても、社内導入で詰まりやすいのは「モデル性能」より運用と意思決定です。判断を前に進めるための観点を、最低限だけ並べます。

① どの業務を置き換える/拡張するか(ROIの源泉)

- 対象は「チャット」ではなく、入力→判断→ツール実行→ログ→承認までの一連のワークフロー。

- まずは“人が多い・反復が多い・品質のばらつきがコストになる”業務が相性良い。

② ガバナンス:責任範囲と承認フローを先に決める

- 削除・課金・顧客連絡など不可逆な操作は、人間承認を必須に。

- ツール呼び出しは全件ログ(誰が/何を/いつ/なぜ)。監査できない自動化は後で止まります。

③ セキュリティ:マルチモーダルで“攻撃面”が広がる

- 画像/音声入力は、プロンプトインジェクションや情報混入の入口になり得る。

- アップロードデータの保存・マスキング・保持期間をルール化。

④ コスト:トークン単価より「ワークフロー単価」で見る

- マルチエージェント化すると呼び出し回数が増え、気づかぬうちに月額が跳ねる。

- 1ワークフローあたりの平均コスト、上限、アラートを最初から設計に入れる。

⑤ ロックイン:APIだけでなく“プロンプト/ツール設計”が資産になる

- 移行コストが大きいのはモデル切替そのものより、周辺の運用・監査・評価の仕組み。

- 可能なら、ツールスキーマやログ形式を特定ベンダーに寄せすぎない形で持つ。

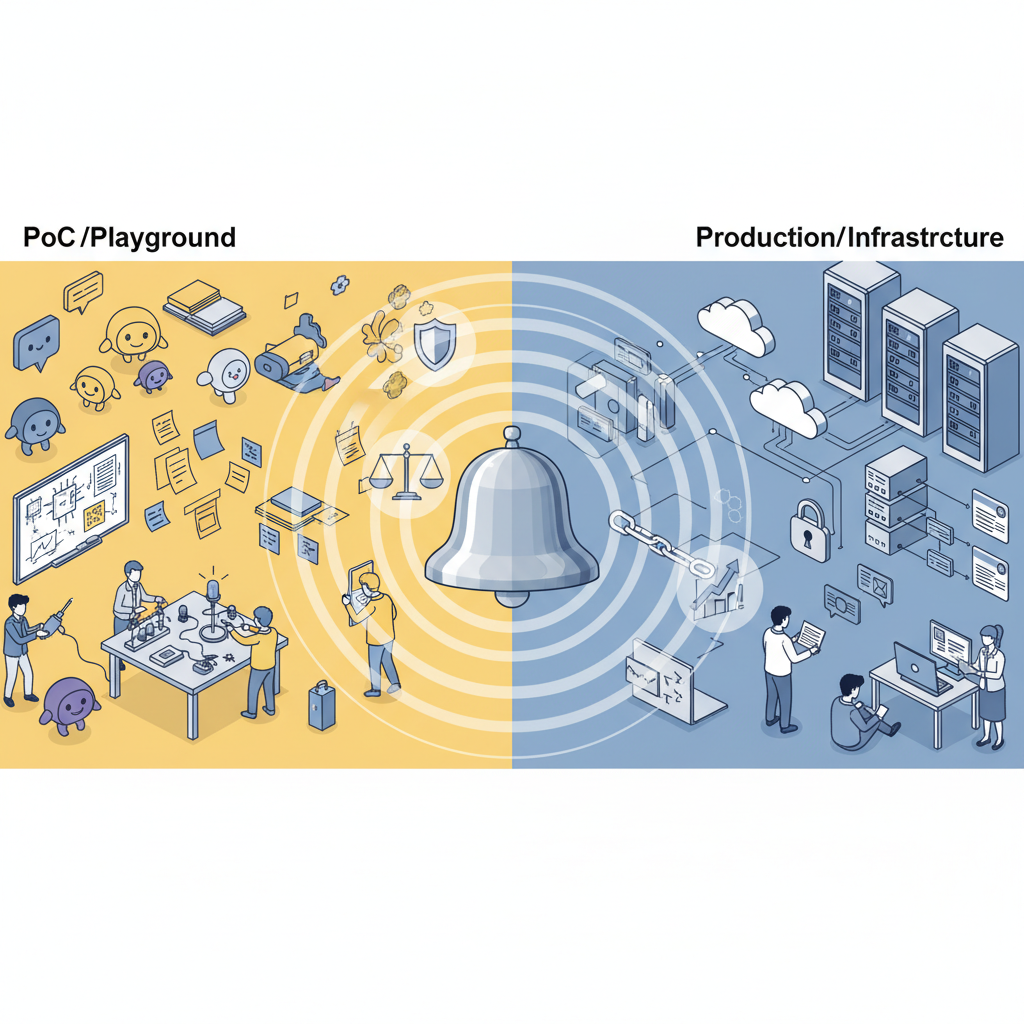

まとめ:Gemini 3.1 Pro は“PoC時代の終わり”を知らせるベルかもしれない

正直、Gemini 3.1 Pro の発表を最初に見たときは、

「はいはい、また新しいモデルね。ベンチマークでちょっと強いんでしょ?」

ぐらいのテンションでした。

でも、技術解説や日本の Qiita/Zenn 記事、マルチエージェントの実践例を一通り追ってみると、

- モデル単体での“頭の良さ”よりも、

“プラットフォームとしての完成度”が一段階変わった - それによって、エンジニアが真面目に

「LLMを前提にしたアーキテクチャ」を検討すべきフェーズに入ってきた

と感じます。

ぶっちゃけ、

「PoCで遊ぶためのLLM」から

「基盤インフラとして組み込むLLM」への境界線に、

Gemini 3.1 Pro はかなり太い線を引いた

そんな印象です。

プロダクションで“何も考えず全面採用”できるか?と言われると、

- ガバナンス

- 責任範囲

- ベンダーロックイン

- コスト爆発

このあたりの懸念があるので、正直まだ用途次第で慎重に選ぶべきだと思います。

ただ一つだけはっきり言えるのは:

「LLMはチャットボットでしょ?」と片付けていると、

数年後にアーキテクチャ面で取り返しのつかない差がつく

その“次の地層”を、Google は Gemini 3.1 Pro で明確に見せてきた——

そういう意味で、このリリースは見落とすには惜しいターニングポイントだと思います。

関連リンク

- Google DeepMind Gemini 3.1 Pro Launch

- Google DeepMind Gemini 3.1 Pro Release

- Anthropic announces Claude Sonnet 4.6

FAQ

Q. Gemini 1.5 Proを使っているなら、今すぐ移行すべき?

A. まずは限定用途でA/Bテストが現実的です。ツールコール互換、出力フォーマット回帰、コスト/レイテンシ計測は必須。

Q. Claude(Opus系)と迷ったらどう判断する?

A. “一撃の正確さ/文章品質”が最重要ならClaude寄り、ツール連携・マルチモーダル・大量ワークロードを現場で回したいならGemini寄り、という切り分けがしやすいです。

Q. ツールコールを本番運用する時の最低限の安全策は?

A. 権限分離(できる操作を絞る)、スキーマバリデーション、リトライ戦略、不可逆操作の人間承認、そして全ログ保存です。

Q. コスト爆発を防ぐコツは?

A. トークン単価ではなく1タスク/1ワークフロー単価で上限とアラートを設け、長コンテキスト/マルチエージェントを“使いどころ限定”にするのが効きます。

コメント