「またLLM用のワークフローを書き換えてるだけで一日が終わった…。」

「プロンプトは太ったYAML、コードはただのif文地獄。」

そんな経験、ありませんか?

正直ここ1〜2年、LLMまわりの開発って「同じことを抽象度だけ変えて何度も書かされている感」が強かったと思います。

LangChainだのフレームワークだの、Agentだの。名前は変わるけど、やっていることは「LLMの穴埋めと後片付け」です。

そんな中で出てきたのが Gemini 3.1 Pro。

これ、ただの「新しいモデル出ました」ではなく、ワークフロー設計そのものを変えにきている、というのが今回のポイントです。

一言でいうと:「Dockerが出てきたときのあの感覚」に近い

ニュースとしての説明をあえて一言に雑にまとめると、

「LLM界の Docker っぽいものが、ようやく実用レベルで降りてきた」

という印象です。

- これまでのLLM:

- 「賢いけど、運用する側が全部面倒をみないといけないスクリプト」

- Gemini 3.1 Pro:

- 「中で何やってるか全部は見えないけど、“仕事” 単位で任せられるコンテナ」

というポジションにだいぶ近づいた、と感じました。

「考えるだけのAI」から「自分で働くAI」へ

Google側のメッセージングも(日本語記事経由ではありますが)かなりはっきりしていて、

- 以前:

- 「よく考えるチャットボット」

- 今回:

- 「自分でツールを呼び、段取りを組んで作業する“ワーカー”」

というトーンです。

実際の中身としては:

- ツール/関数呼び出しの精度と安定性が上がった

- マルチステップの計画・実行を モデル内 にかなり押し込める

- 人間側の「ステップごとの誘導」や「細かいオーケストレーション」が減らせる

という変化が主役になっています。

ぶっちゃけ「新しいAPIです!」よりもこっちの方がインパクトが大きい。

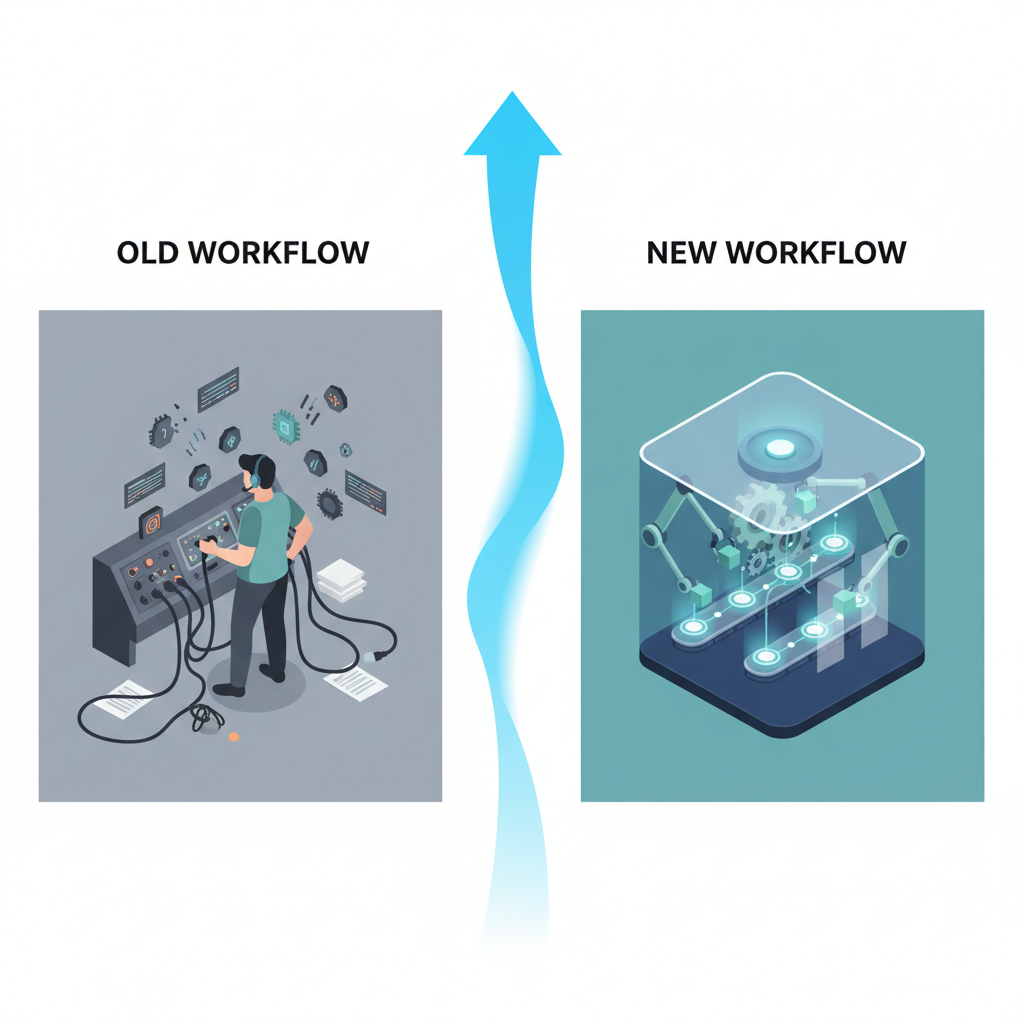

何が変わるのか:プロンプト職人から「ツール設計者」へのシフト

開発者目線での一番の変化は、

「プロンプトエンジニアリング」より「ツール設計」と「権限設計」が重要になる

ことだと思います。

これまでの典型パターン

- LangChainなり自前Pythonで:

- ① 要件の解釈

- ② サブタスク分割

- ③ ツール呼び出し

- ④ 結果の評価と再実行

- ⑤ 最終サマリ

- それぞれを別プロンプト・別関数にしてつなぐ

つまり、LLMは基本“一手”しか読めない前提で、まわりを人間のロジックで固めていたわけです。

Gemini 3.1 Pro の世界観

3.1 Proでは、かなりの部分をモデルに押し込めます。

- 開発者がやること

- ツール(API)を定義する

- ざっくりしたゴールを指示する

- ガードレール(できること・ダメなこと)を設定する

- モデルがやること

- ① ゴールをタスクに分解

- ② 適切なタイミングでツールを選択

- ③ 何度か試行錯誤しながら手順を進める

- ④ 最終結果をまとめる

つまり、今までPythonやTypeScript側で組んでいた「オーケストレーションのロジック」が、かなりの割合でモデル内部に吸い込まれるイメージです。

正直、これは楽になります。

同じことを3箇所のYAMLと2つの関数にまたがって書かなくてよくなるので。

競合との比較:「誰が一番“実務”を任せられるか」の戦いに入った

OpenAI(GPT-4.1 / o3)との違い

性能面のベンチマークはここでは割愛しますが、戦っている土俵が微妙に違います。

- 共通点

-

どちらも

- 高性能な汎用LLM

- ツール/関数呼び出しサポート

- 長文コンテキスト対応

- 「エージェント的な使い方ができます」と主張

-

違い(あくまで印象ベース)

- OpenAI:

- 「モデル+Agents API+外部フレームワークで明示的に組んでください」というスタイル

- 「外側のオーケストレーションをしっかり設計しましょう」というメッセージが強い

- Google Gemini 3.1 Pro:

- 「オーケストレーションのかなりの部分はモデルに任せていいですよ」というスタイル

- Google Workspace / Google Cloudとの親和性を前提に、「業務オートメーションの母艦」を狙っている感じ

どちらが正しいかというより、思想が違うという話です。

- OpenAI陣営:

- 「ロジックは人間(コード)側に、認知タスクはモデルに」

- Gemini陣営:

- 「ツールとゴールだけ定義してくれたら、あとは中でなんとかやる」

という割り振りになってきています。

フレームワーク勢(LangChainなど)はどうなるか

正直、LangChain 的な「チェーン組みフレームワーク」は一番割を食うと思っています。

- 生き残る領域

- SaaS / DB / SaaS への大量のコネクタ

- ログ/トレース/メトリクスなどの可観測性

- RBACやコンプライアンスを含めたガバナンスレイヤ

- 厳しくなる領域

- 「LLMがバカなので一手ずつラップしてあげるためのチェーン」

- 「プロンプトをわざわざ分割して渡すだけの抽象レイヤ」

Gemini 3.1 Pro のような「中でかなりやれるモデル」が当たり前になると、

“チェーンそのもの” を売りにするのは厳しいと感じます。

逆に言うと、フレームワーク側も「ポータビリティ」「観測」「統制」にシフトしないと、

単なる“LLM時代の jQuery” で終わるリスクが出てきました。

コミュニティの空気感:すごいけど、正直まだ「信じ切れない」

日本語圏の開発者のリアクションをざっと追っていて、かなり象徴的だなと思ったのがこの二つです。

- 「2時間も『APIモデルを追加中』で、まだ終わってない。MacBook Proが電気ストーブになってる」

- 「Gemini 3.1 Pro で、1年間ハマってた Next.js + Tailwind のビルドエラーがやっと直った」

つまり、

「体験としてはボロボロなところもあるけど、刺さるときはめちゃくちゃ強い先輩エンジニア」

みたいな立ち位置になっている。

ツールチェーンとしての不安

- モデル追加がいつまでも終わらない

- CPU張り付きでマシンが熱くなる

- それに対するフィードバックループが弱い

この辺は「プラットフォームとして本当に信頼していいの?」という不安を生んでいて、

「プロダクションにガッツリ載せたい」と思う人の足を、確実に引っ張っています。

それでも評価されているところ

一方で、デバッグ能力の高さにはかなりポジティブな声が多い。

- 1年ハマり続けた Next.js + Tailwind + Webpack のビルドエラーを一発で解消

- 依存関係やビルド設定のグチャグチャを、かなり冷静に整理してくれる

- CSS minify 周りや Tailwind の細かい罠も含めて、文脈をちゃんと追えている

ここは「LLMがようやく “Stack Overflow + α” を本当に超え始めた」瞬間だと思っています。

単なるコピペ回答ではなく、プロジェクト固有の積年の闇に付き合ってくれる感じ。

ただ、懸念点もかなりはっきりしている

ベンダーロックインが一段とキツくなる

「オーケストレーションをモデル側に寄せる」ということは、

- ワークフローの大部分が「Geminiの考え方」に依存する

- ツールのスキーマ設計も Gemini 仕様に最適化される

- 他社モデルにはそのまま差し替えづらくなる

という意味でもあります。

正直、「とりあえずOpenAIとGeminiを切り替えながらベンチマークしてみるか」という

今の気軽なマルチベンダー戦略は、段々と重くなっていくと思います。

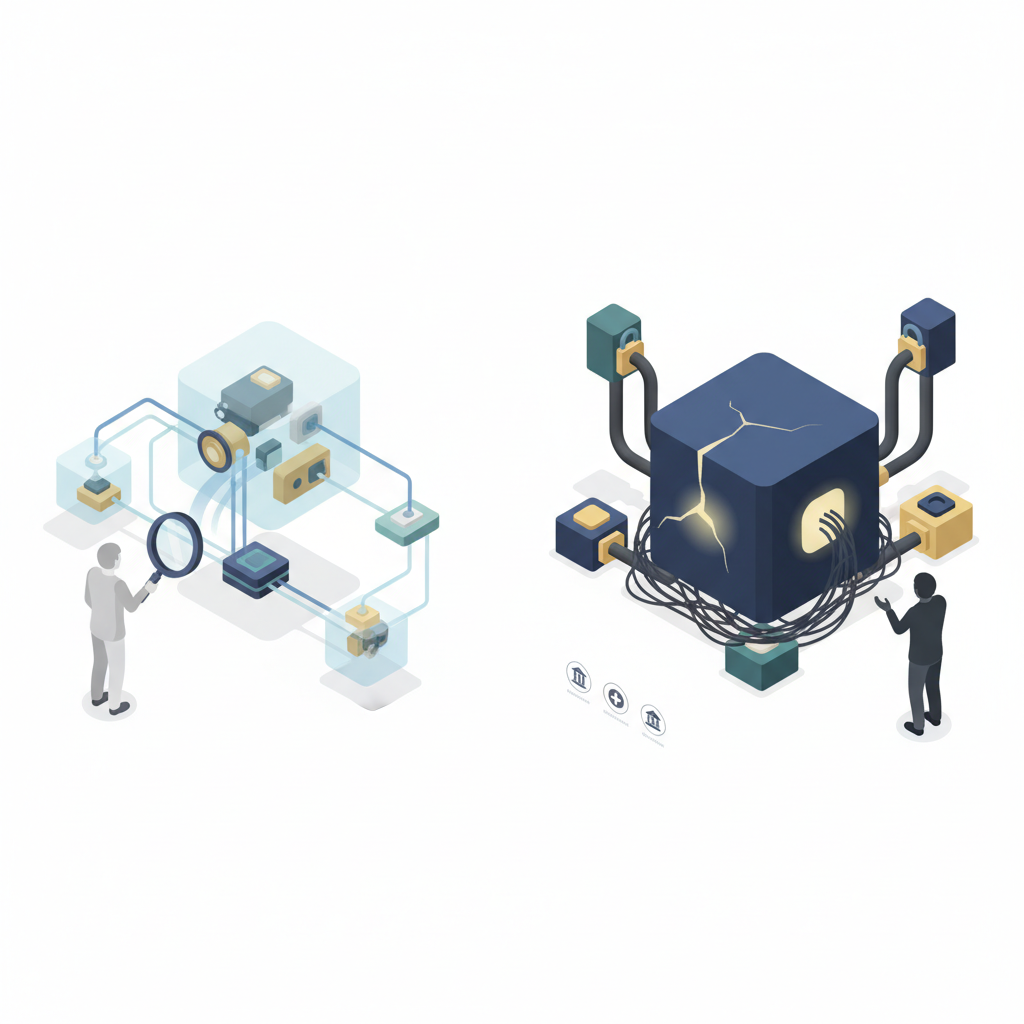

中身がブラックボックス化し、デバッグがつらくなる

今までは、

- 「このif文でこのLLM呼んでる」

- 「このプロンプトでこの結果が返ってきている」

という形で、最低限ロジックは人間の側にありました。

3.1 Pro のようにモデル側で計画〜実行までかなりやりきるようになると、

- どのタイミングでどのツールを選んだのか

- その判断に使った情報は何だったのか

- どの時点でミスったのか

が、外から見えにくくなります。

これは特に、

- 金融・医療などの規制産業

- 監査が必要なワークフロー

- 「なぜこう判断したのか」を説明しなければいけない業務

ではかなり重たい問題になります。

「自律エージェント」はコスト地獄になりやすい

「自分で働くAI」は、裏を返せば、

- 自分で何度もツールを叩き

- 自分で長いコンテキストを積み上げ

- 自分で試行錯誤を繰り返す

存在です。

つまり、放っておけば コール回数・トークン量・実行時間が際限なく膨らむ リスクがあります。

正直、「なんか裏でずっと考えてて、気づいたら請求が爆増していた」という未来はかなり現実的です。

予算リミットやタイムアウト、レート制限を最初から設計に入れておく必要があります。

「なんでも一体型エージェント」に突っ込みたくなる誘惑

3.1 Pro を触ると、たぶんこう思うはずです。

- 「これ、もう会社の業務ぜんぶ一匹のエージェントにやらせればいいのでは?」

正直、その誘惑は分かりますが、

これは ほぼ確実に失敗するパターン だと思っています。

- 業務プロセスには

- ハードな制約

- 人による最終承認

- 組織ごとの暗黙知

- が山ほどあるので、「なんでも屋エージェント」では表現しきれません。

現実的には、

- カスタマーサポートの一次トリアージ

- 営業リストの作成と一次メール案作成

- 月次レポートのドラフト生成

など、範囲が明確で評価しやすいところから、ちょっとずつ置き換えていくのが無難です。

プロダクションで使うか?正直、まだ「局所投入+様子見」が妥当

エンジニアとして、かつプロダクト側の責任も見ている立場からの結論をまとめると、

「本番ゼロベースリプレースに使うのは時期尚早。ただし “小さな本番タスク” からは今すぐ試す価値がある」

くらいの温度感です。

今やるべきだと思うこと

- 1〜2個の 小さくて評価しやすいワークフロー を選ぶ

- 例: JS/フロント系リポジトリのビルド失敗自動調査ボット

- 例: 定型レポートの下書き生成+人間レビュー

- 2〜5個程度のツールをGemini 3.1 Proに渡して

- ざっくりしたゴールだけを指示

- 成功率・コスト・実行時間を計測

- 並行して

- ログとツール呼び出し履歴をちゃんと残す

- 失敗ケースを人間が冷静にレビューする

この「小さな実戦投入」で、「これまでの LLM + 手作りオーケストレーション」と比べて

- 実装量

- 保守コスト

- 品質(成功率)

がどう変わるかを見ていくのが現実的です。

まだやるべきでないこと

- 社内のワークフローをいきなり「Geminiエージェント1本」に寄せる

- 既存の堅い業務ロジック(承認フローなど)をLLMの判断に丸投げする

- 「とにかく最新だからGemini 3.1 Pro に全部切り替えよう」とする

特に既存の仕組みを捨てる系のリプレースは、

モデル側の挙動が安定しきっていない現時点ではギャンブルに近いです。

まとめ:Gemini 3.1 Pro は「方向性としては正しい」。でも、信頼は段階的に育てるべき

個人的な評価を整理すると、

- 方向性:

- 「ただのチャットボット」から「実務をこなすワーカー」へのシフトは、間違いなく正しい進化方向だと思います。

- 技術的インパクト:

- オーケストレーションをモデル側に押し込めることで、アーキテクチャ設計の前提が変わるレベルの変化です。

- 競合との関係:

- OpenAI との競争軸は「精度」から「誰が一番“現実の業務”をオートメーションできるか」に移りつつあります。

- 懸念:

- ベンダーロックイン

- ブラックボックス化

- コスト暴走

- 不安定な周辺ツール(「APIモデルを追加中」の地獄など)

が、今のところはっきり見えています。

正直に言えば、

「Gemini 3.1 Pro だけに会社の業務を丸投げできる」段階には、まだ来ていない

と思っています。

ただし、

「面倒なLLMワークフローをちょっとずつ “コンテナ化” して任せていく」ための、かなり有望な一歩

であることも間違いない。

最初のDockerコンテナを本番に出したときの、あの半信半疑な感じを思い出しつつ、

小さなところから現場に投げてみて、本当に“働ける”のかを自分のユースケースで見極める。

そのくらいの距離感で、Gemini 3.1 Pro と付き合っていくのが、今いちばん現実的な選択だと感じています。

コメント