結論(忙しい方向け)

- 全面移行より、工程別に試験投入(評価指標つき)が現実的

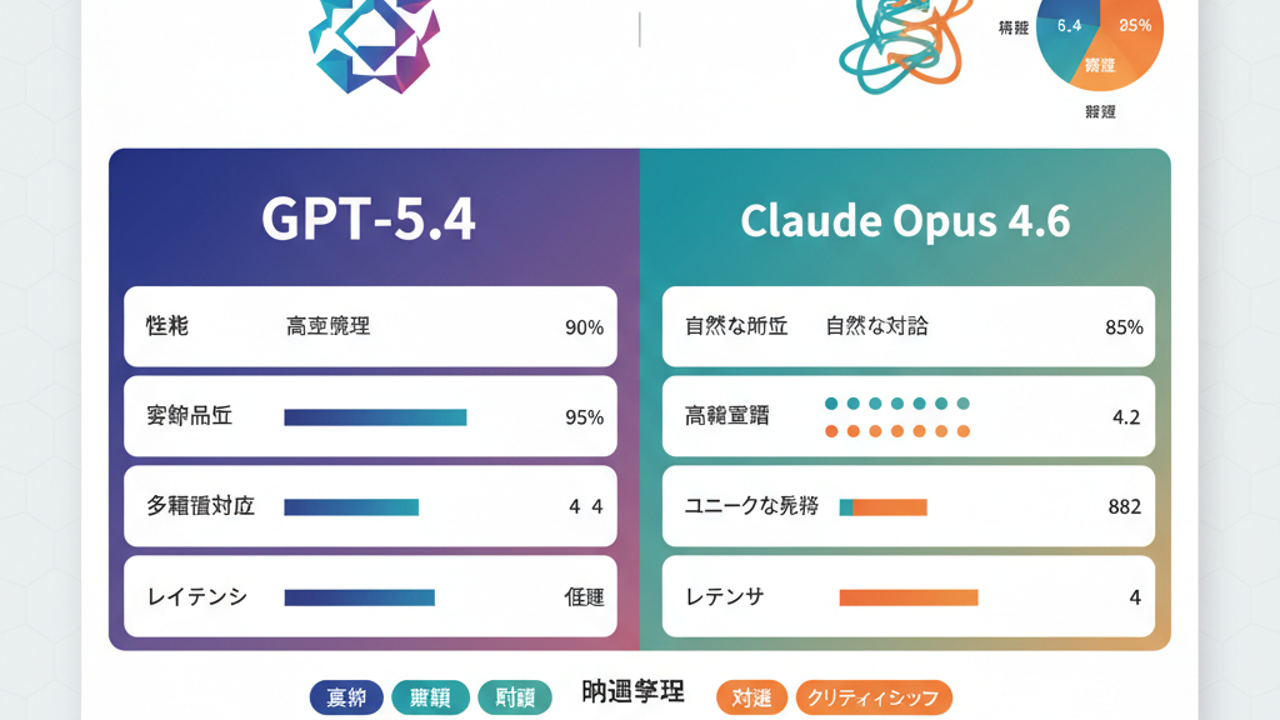

- コード生成/リファクタ寄りは GPT‑5.4、仕様読解/設計レビュー寄りは Opus 4.6

- コスト/監査/ロックインの落とし穴があるので、メトリクス化+モデル抽象レイヤを先に置く

想定読者:実務で AI コーディング支援や仕様レビューを使っているエンジニア/EM/プロダクト側の意思決定者

「AI に任せて書かせたコード、後で自分がメンテするとき地獄を見る」――そんな経験、ありませんか?

- 生成されたコードは一見動くけど、設計がちぐはぐ

- 既存コードへの組み込みがつらくて、結局ほぼ書き直し

- テストは「それっぽいけど現場の文脈をまったく分かってない」

正直、この1〜2年の「AI コーディングアシスタント」は、

デモとしては最高だけど、プロダクションでは「最後は人間が全部面倒を見る前提」から抜け出せていませんでした。

そこに出てきたのが GPT-5.4 と Claude Opus 4.6。

X では「GPT-5.4 のプログラミングがやばい」「Opus 4.6 の長文理解が別物」といった断片的な声が飛び交っていますが、

実務エンジニア目線で見ると、この2つは「同じレベルアップ」ではありません。

本稿ではニュースの要約ではなく、実務エンジニア兼コラム書きとしての視点から、

- 何が本当に変わったのか

- どこに期待すべきで、どこを冷静に疑うべきか

- 5.4 と 4.6 をどう使い分けると現場の生産性が最大化するか

を整理してみます。

一言でいうと:GPT-5.4 は「GPT-3.5 的ジャンプ」、Opus 4.6 は「GPT-4 の安定版」

一言で例えるなら、

GPT-5.4 は「GPT-3 → GPT-3.5 で“デモ用”から“実務用”に変わったときのジャンプ」に近く、

Claude Opus 4.6 は「GPT-4 の“ちゃんと考える”感を、さらに堅くした安定アップデート」です。

- GPT-5.4:

- コーディング、とくに既存コードを読んでリファクタ・設計提案まで含めて一気にやるところが段違い

-

「AI に任せると後片付けが大変」だったゾーンが、かなり“任せてもいい”ゾーンに近づいた印象

-

Claude Opus 4.6:

- 長文仕様・議事録・要件定義の読解・矛盾検出・構造化がさらに鉄板になった

- コードも書けるけど、「設計意図の読み取り」や「仕様の穴を突く」ほうが本領

ぶっちゃけ、どちらも API 互換で「モデル名を差し替えれば動く」系のマイナーリリースに見えるのですが、

開発フローに与えるインパクトは“小数点アップデート”の顔をしたメジャー級です。

GPT-5.4:ついに「中堅エンジニアの相棒」ラインに乗ってきた

何がそんなに変わったのか(コード寄りのジャンプ)

噂の「GPT-5.4 はプログラミングがすごい」は、

単に「精度5%アップしました」という話ではなく、挙動が工程レベルで変わっているのがポイントです。

観測ベースで感じるのは、次の3つの複合効果です。

- 1. コンテキストを“設計レベル”で理解しはじめた

- ディレクトリ構成、レイヤ、責務分割を前提に、

「このサービスクラスは責務持ちすぎですね。ここで分割しましょう」といった提案が筋がいい -

バグレポート+スタックトレース+該当ファイルを投げると、

単にバグ行を指摘するだけでなく、「そもそもこの状態遷移の設計が…」に踏み込んでくる -

2. リファクタリングと設計レビューが“そこそこ頼れる”

- 変数名の整合性、責務の分割、テストの観点まで含めた一貫した方針提案が出てくる

-

「junior ではなく“まあまあ経験ある中堅”のレビュー」に近づいた感覚がある

-

3. テストコード生成が“仕事になるレベル”に到達しつつある

- 仕様テキスト+コードから、境界値・例外・並列系など

人間が見逃しがちなケースをそこそこ拾ってくる - もちろん完璧ではないですが、「ゼロから人間だけで考えるよりは確実にマシ」なラインを超えている

正直、このレベルになると、

「アーキテクト 1人+GPT-5.4」で MVP を組む、という構図がかなり現実味を帯びてきます。

それでも“魔法のエンジニア”ではない

とはいえ、誤解してはいけないのは、GPT-5.4 が万能フルスタックエンジニアになったわけではないという点です。

- 環境依存のバグ(特定クラウド設定や、古いライブラリとの相性など)は相変わらず弱い

- コンテキスト制限の現実は残り、巨大リポジトリは RAG やコード検索との組み合わせが前提

- 「それっぽいけど、現場運用を知らない」提案もまだまだ出てくる

むしろ懸念しているのは、「あまりに自然なので、レビューが油断しやすい」という点です。

- 5.4 の出すコードは、命名も設計も「それなりに筋が通っている」ため、

- レビューする人間が「まあ AI が言ってるし…」と深追いせず、

エッジケースや本番運用での罠を見落とすリスクが上がります。

実装タスクをある程度置き換えつつあるからこそ、

“AI が出したものを疑うスキル”の重要度が一段上がったとも言えます。

Claude Opus 4.6:上流工程の「相棒」が一段階進化した

コードではなく「仕様と思考」に振り切った強み

一方の Claude Opus 4.6 は、

「コードも書ける GPT-5.4」と正面から殴り合う方向ではなく、

長文・仕様・思考の深さに寄せてきた印象です。

- 要件定義書、仕様書、議事録をドカッと投げて:

- 整合性チェック

- 仕様の抜け漏れ

- 「この前のミーティングで言ってたことと矛盾してない?」的な指摘

- これらが、かなり安定して返ってきます。

興味深いのは、コードレビューでも

「スタイル」より「仕様との整合性」や「安全性」にフォーカスする傾向です。

- 「このバリデーションだと、仕様書 3.2 節で挙げている例外ケースがカバーできていません」

- 「この設計だと、将来の多言語展開時に XXX の部分がボトルネックになります」

といった、一段メタな視点が出てきやすい。

日本語長文の安定性も相変わらず高く、

日本語でだらっと仕様を書いた議事録でも、

論旨を壊さずに構造化して返してくれるのはかなり実務的です。

Opus 4.6 の「正しそうな間違い」は別種の怖さがある

Opus 4.6 にも懸念はあります。

GPT-5.4 が「自然すぎるコードの誤り」が怖いのに対して、

Opus 4.6 は 「体系的で説得力のある間違い」が怖い。

- 仕様レビューのコメントが論理的・丁寧・一貫しているため、

多少間違っていても議論のベースになってしまう - 結果として、「AI のコメントを前提に人間同士で議論を進めてしまう」ことがあり、

元の前提が誤っていたと気づくまでのコストが大きくなり得ます。

要するに、会議で一番論が立つ人が必ずしも正しくない問題を、AI 版で再現してしまう可能性があるわけです。

ここでもやはり、「AI が提示するロジックの前提を疑う」メタ認知が必要になります。

実務的インパクト:誰が脅かされ、何が“壊れる”のか

コーディングアシスタント系は再定義を迫られる

GPT-5.4 / Opus 4.6 クラスが出てくると、

「独自モデルでコード支援します」系のスタートアップはかなり厳しくなります。

- モデルそのもので勝負するのはほぼ不可能

- 差別化できるのは:

- IDE との統合体験

- 組織向けのセキュリティ・監査ログ

- リポジトリ全体に最適化された RAG / インデックス設計

- チームワークフロー(レビュー、承認フロー)への組み込み

要するに、「裏側のモデルは誰のでもいいが、それをどう現場に馴染ませるか」が勝負どころになります。

GitHub Copilot も、

「古いモデル+ちょい補完」から、

「GPT-5.4 / Opus 4.6 ベースのフルフロー支援」との競争に晒される形です。

要件定義・ドキュメント解析 SaaS も “薄い UI” では生き残れない

長文ドキュメント解析系の SaaS も同様です。

- Opus 4.6 に仕様書を突っ込めば、かなりのレベルまで

「要約・構造化・矛盾検出・抜け漏れ指摘」が素のモデルでできてしまう - そこに単に UI をかぶせただけの SaaS は、

コスト的にも機能的にも差別化が難しくなる

ここも同じく、「ドメイン固有のワークフローとの統合」が鍵になります。

- チケットシステムとの連携

- 承認プロセス

- 規制産業向けの監査ログと証跡

“ただ Claude をいい感じにラップしました”だけのサービスは埋もれると見ています。

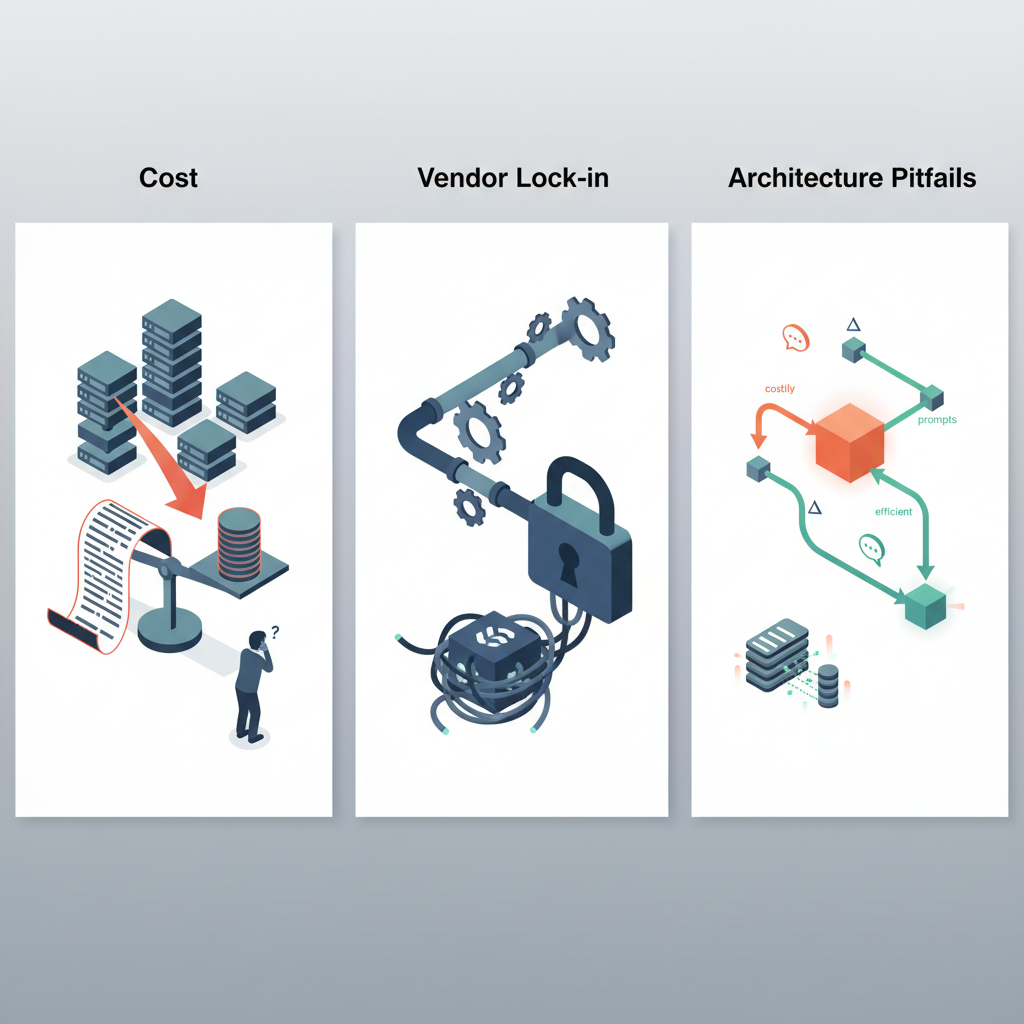

「ただ入れ替えればOK」ではない、3つの落とし穴

どちらも API 互換で「モデル名を変えるだけ」で動作するのは事実ですが、

そのまま本番に突っ込むと痛い目を見るポイントが少なくとも3つあります。

コスト:クラウド費用が「エンジニア人件費級」になる懸念

高性能モデルをガンガン呼ぶと、

中〜大規模プロダクトでは本当に人件費級のクラウド請求が飛んできます。

- 開発フェーズでは「とりあえず 5.4 / 4.6 を使おう」となりがち

- しかし本番運用で毎リクエストでフルコンテキスト+高性能モデルを使うと一気に破綻

現実的には、

- 軽量モデルとの切り替え(ルーティング)

- 差分プロンプト(毎回フル文書を投げない)

- 事前インデックス/RAG で必要部分だけ投げる

といったアーキテクチャ側の工夫が必須になります。

ベンダーロックイン:ワークフローごと縛られる

GPT-5.4 前提でワークフローを組むと、

「後で他社モデルに差し替え」が相当つらくなります。

- プロンプトチューニング

- 自動評価(eval)の基準

- エラーケースの扱い

これらが全部「そのモデルの癖込み」で最適化されるからです。

Opus 4.6 でロングフォーム分析フローを組んだ場合も同じです。

対策としては、「モデル抽象レイヤー」を最初から作ることを強くおすすめします。

- 自前のアダプタインターフェース

- モデル別の設定を外出し

- 評価用スイッチを用意(モデル A/B テスト)

をやっておかないと、数年後に確実に技術負債になります。

チームスキル分布の変化:ミドルクラスの役割が変わる

GPT-5.4 が「そこそこできる実装者」を部分的に代替し始めると、

ミドルクラスのエンジニアの立ち位置が変わります。

- 仕様があればそれなりに実装できます、というスキルだけでは差別化しづらくなる

- 代わりに、

- AI の提案をレビューし、

- 設計として整合性を取り、

- チーム内のコンテキストに落とし込む

といった「編集・統合・判断」のスキルが価値を持つようになる。

Opus 4.6 が仕様・設計のレビューを強化することで、

要件の曖昧さや漏れもより可視化されやすくなります。

- 仕様を詰めるのが苦手な組織ほど、

- 「AI がこう言っているけど、本当にそうか?」

- 「この仕様を現場に落とし込んだとき何が起きるか?」

を考えるメタスキルが求められるようになります。

実務者向け「結論」と「当面の付き合い方」

結論:プロダクションで“全面移行”するか?正直、まだ様子見です

個人的な結論はこうです。

- プロダクションの中核ロジックを、いきなり 5.4 / 4.6 前提で作り変えるのは、正直まだ様子見

- ただし、開発フロー全体に試験投入する価値はかなり高い

とくにおすすめしたいのは次の使い分けです。

こう使い分けると現場でハマりにくい

- GPT-5.4 を使うべきタスク

- 既存コードのリファクタ、責務分割の提案

- バグ修正(ログ+該当コードをまとめて投げるパターン)

- テストコード生成(人間レビュー前提)

-

小〜中規模の MVP 実装(アーキテクト監督付き)

-

Claude Opus 4.6 を使うべきタスク

- 要件定義書・仕様書・議事録の要約・構造化

- 仕様の抜け漏れ・矛盾の指摘

- 変更仕様の影響範囲分析(既存仕様・チケット・議事録を横断)

- 設計レビュー(設計意図・将来拡張性の観点)

要するに、

コード寄りの「手を動かす作業」には GPT-5.4、

思考寄りの「何を作るべきか・どこが危ないか」を考える作業には Opus 4.6、

という棲み分けが現時点では一番しっくりきます。

今すぐやるべき“現実的な一歩”

- 既存で GPT-4.x / Claude 3 を使っているなら:

- まずは PoC 環境でモデルだけ 5.4 / 4.6 に差し替え

- コスト・品質・レイテンシをメトリクス化して比較

-

「ここは 5.4 を使う価値がある」「ここは旧モデル/軽量モデルで十分」を切り分ける

-

新規で導入するなら、最初から:

- モデル抽象レイヤー(アダプタ)

- E2E テストとは別のAI 専用 eval

- コストモニタリング

をセットで設計しておくと、数カ月後に後悔しにくいです。

まとめ:これは「AI エンジニアの失業」ではなく、「役割の再定義」のフェーズ

GPT-5.4 と Claude Opus 4.6 の登場で、

AI コーディングアシスタントは「実験フェーズ」から常用フェーズに一段ギアが上がりました。

ただしこれは、

- エンジニアが要らなくなる、という話ではなく、

- エンジニアが

- 何を AI に任せ、

- どこで AI を疑い、

- どうやってチームの知識や文脈を AI と共有するか

を設計する役割にシフトしていく、という話です。

正直、ここ1〜2年で

「AI をどう使うか設計できるエンジニア」と「ただ自分の手だけで書けるエンジニア」の間には、

かなり明確な差がつくと思っています。

GPT-5.4 と Claude Opus 4.6 は、その分岐点を少し早めてしまったアップデートです。

- 「AI をどう賢く疑うか」

- 「どの工程をどのモデルに任せるか」

この2つを意識しながら、

まずは小さな範囲で 5.4 / 4.6 を実戦投入してみる。

それが、今のところ一番“現実的でリターンの大きい”付き合い方だと考えています。

FAQ:導入判断でよくある質問

Q. まずどの業務から試すのが安全?

本番の中核ロジックをいきなり置き換えるより、バグ修正・テスト追加・既存コードのリファクタ提案や、仕様書/議事録の要約・矛盾検出のように「人間がレビューして戻せる」工程からが安全です。

Q. GPT‑5.4 と Opus 4.6 の使い分けは?

ざっくり言うと、手を動かすコード作業(既存コード読解→修正→テスト)に寄せるなら GPT‑5.4、仕様・意図・矛盾の読み解きに寄せるなら Opus 4.6 がハマりやすいです。

Q. コストが跳ねるのが怖い。どう抑える?

高性能モデルを常時フルコンテキストで呼ぶのは危険です。軽量モデルとのルーティング、差分プロンプト、RAG/インデックスで必要箇所だけ投入、そして「どのケースでどれだけ品質が上がるか」をメトリクス化するのが現実解です。

Q. ベンダーロックイン対策は何を最低限やるべき?

モデル抽象レイヤ(アダプタ)と、モデル別設定の外出し、A/B 切替、AI 用 eval(自動評価)を用意しておくと、数カ月〜数年後の差し替えコストが激減します。

Q. セキュリティ/監査の観点で注意点は?

入力データの取り扱い(PII/機密)、ログの保存、プロンプト/出力の監査証跡が鍵です。組織利用なら監査ログ・権限・データ保持まで含めて「製品として」設計しないと、後で止まります。

コメント