結論(忙しい方向け)

- 学習の主戦場は「文法→ワークフロー」へ:AIに委譲できる領域(写経・一次調査など)は早めに捨て、成果物を回す。

- 人間が握るコアは「要件・設計・品質判断」:レビュー/テスト設計で“わかった気”を潰す。

- 個人最適よりチーム設計:コスト・セキュリティ・責任範囲(AI生成物の扱い)をガイドライン化して運用する。

想定読者:AIを使い始めたが学習順序に迷うエンジニア/育成・採用・開発フローを見直したいリード/CTO

関連:

GPT‑5.4発表(1Mコンテキスト+PC操作)/

GPT‑5.4 Thinkingの使いどころ/

Claude Code Review(常駐レビュー)

「エンジニアの勉強、これで本当に合ってるんだろうか?」

ChatGPTなりClaudeなりを横に置きつつ、UdemyもCS本も積み上がっていく──ここ1〜2年、そんなモヤモヤを抱えている人は相当多いはずです。

- AIを使えば、チーム人数を減らしても回る

- でも「AIに頼るとバカになるのでは?」という不安もある

- 10年ロードマップを信じて良いのか、自分の投資が陳腐化しないか怖い

こういう「見えない不安」に、正面から設計し直そうとしているのが「AI時代エンジニア学習ロードマップ 2026年版」です。

単なる「次はこの教材をやりましょう」ではなく、「エンジニア像そのもののOSアップデート」に近い提案になっている。

この記事では、中身の紹介だけでなく、「このロードマップをどう読むべきか」「どこまで乗るべきか」を、現場目線で意見多めに語ります。

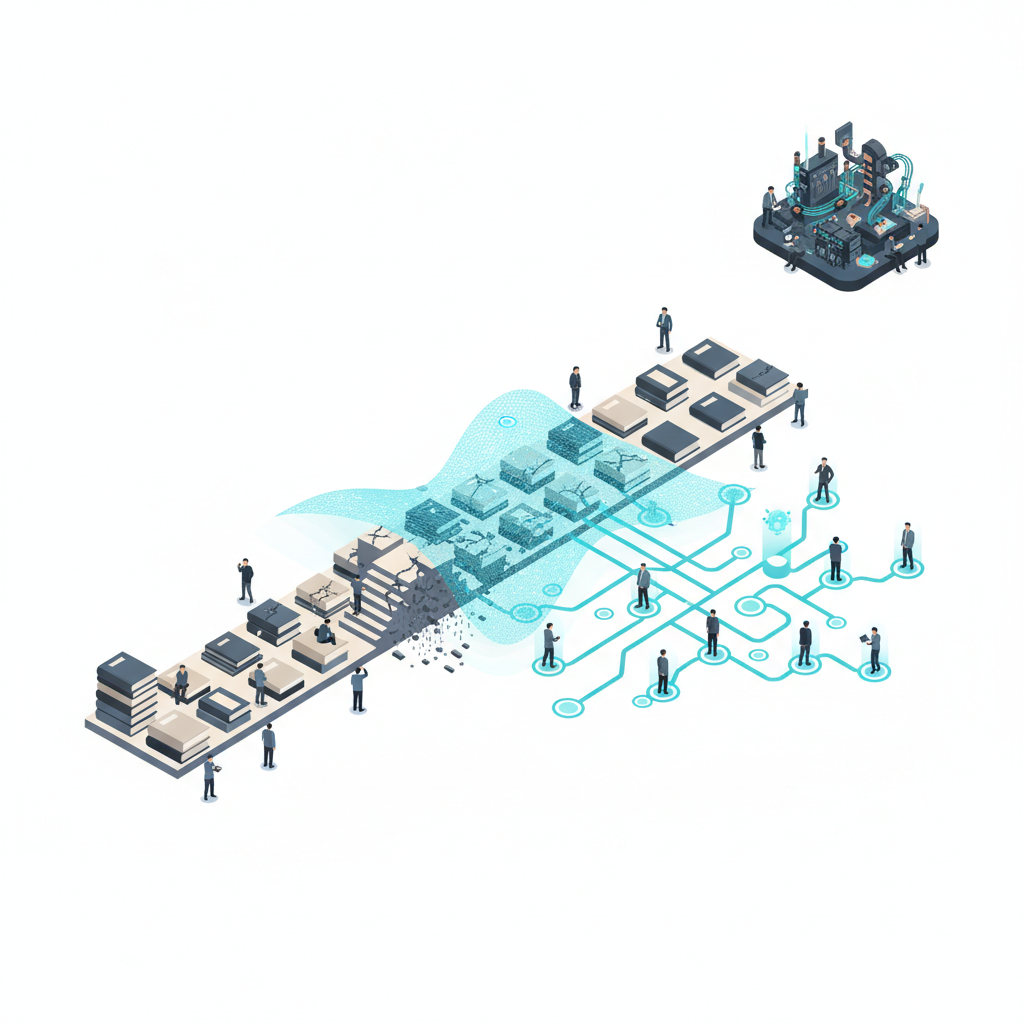

一言で言うと「VimよりGitが大事になった」時期が、AIでもう一回来た

このロードマップを一言で言い表すなら、

「AI界の“Git・CI/CD シフト”版ロードマップ」

です。

昔は「Vimを極めた猛者」が生産性の象徴でしたが、

その後、価値の中心は Git・GitHub・CI/CD・クラウドに移り、

- 早くタイプできる人

よりも - チーム開発フローを設計できる人

の方が圧倒的に重宝されるようになりました。

今回の「3層アーキテクチャによるAI時代ロードマップ」は、まさにその再来です。

- L1: AIリテラシー & プロンプト設計

- L2: ソフトウェア工学 & CS基礎

- L3: AI統合・自動化(エージェント / ワークフロー)

という3層に分解して、

「エディタ(手で全部書くコーディング)を極めるより、

AIを前提にした設計・レビュー・ワークフローを極めろ」

と宣言している。

正直、これはかなり妥当な方向転換です。

AI抜きでの「写経力」を積み増しても、2026年以降の価値は確実に逓減します。

3層モデルの何が新しいか:「何を捨てるか」がやっと明文化された

このロードマップの本当の新規性は、「3層で整理したこと」そのものではなく、

- どこまでAIに投げていいか

- どこから先は人間が握り続けるべきか

をかなり具体的に線引きしている点です。

-1. AIに“気持ちよく”投げていいと宣言している領域

- 文法の暗記・コーディングの写経

- API仕様の1次調査・概要理解

- サンプルコード・テストコードのたたき台生成

ここはほぼ「AIに委譲する前提」でロードマップが描かれています。

「AIに仕事を奪われないエンジニア」ではなく、

「AIを使って10倍生産性を出すエンジニア」を前提にしているのがポイントで、

ぶっちゃけ、「全部自力で書けます」はもう評価軸ではない

と割り切っている。

-2. それでも人間が持つべき“中核”として残したもの

逆に「ここはAI時代でも人間が握るしかない」と明言しているのが、

- 要件定義・ドメインモデリング

- アーキテクチャ設計

- 品質・セキュリティ・パフォーマンスの判断

- 「どこにAIを組み込むか」のワークフロー設計

この整理が出てきたことで、ようやく

「何を捨てて、何を守るか」

の話が、感情論ではなく設計論として語れるようになりました。

正直、ここをはっきり言い切っただけでも、このロードマップには存在価値があります。

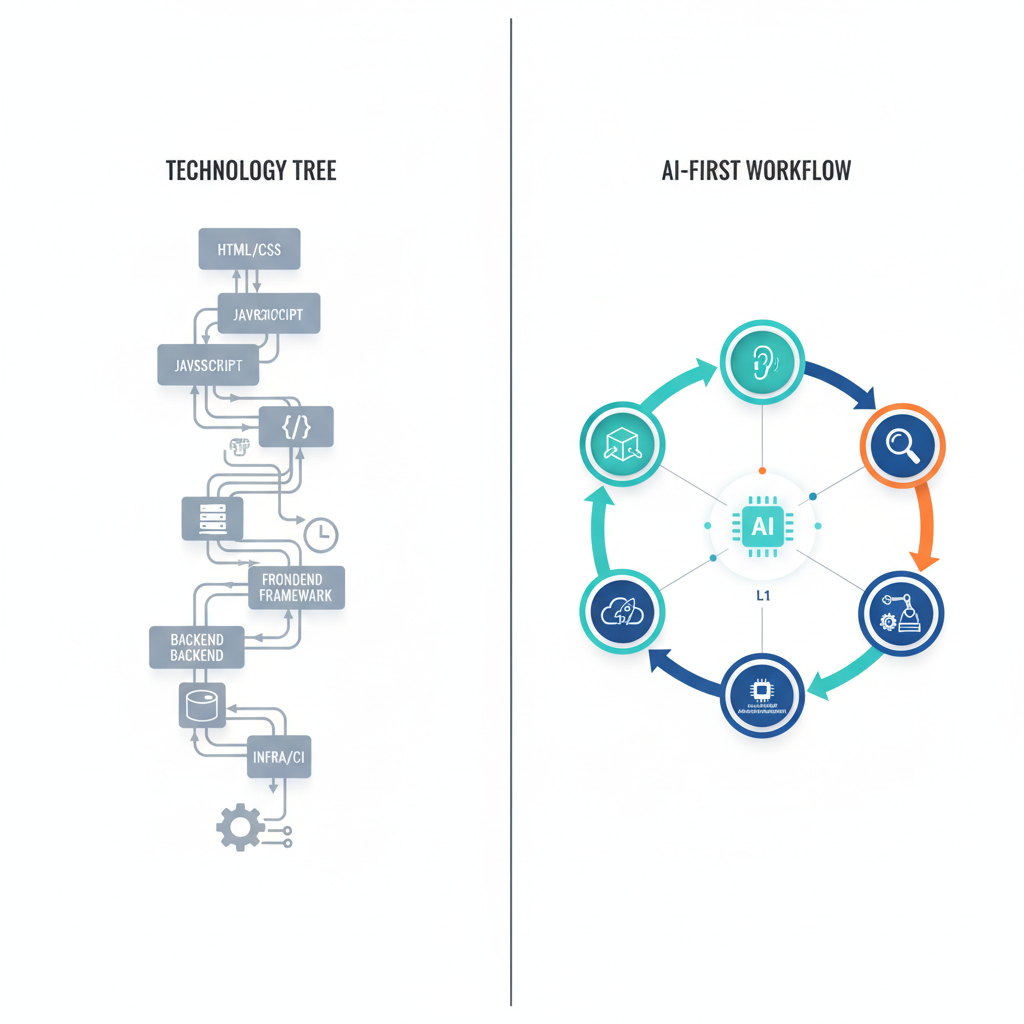

従来ロードマップと何が違うか:

「技術ツリー型」 vs 「AI前提ワークフロー型」

従来のWebエンジニア学習ロードマップは、だいたいこんな形でした。

- HTML/CSS

- JavaScript

- フロントエンドフレームワーク(React / Vue / Next…)

- サーバーサイド(Rails / Laravel / Node / Django…)

- DB、インフラ、CI/CD…

いわゆる「技術ツリー」を横一列に並べたスタイルです。

このスタイルの問題は、AIの登場で一気に露呈しました。

- 学習期間が1〜2年と長い

- 学んでいる途中でツールもフレームワークも変わる

- 「どこをショートカットしていいのか」が分からない

結果、「Progate完全制覇 → 動画チュートリアル → でも実務に繋がらない」という“チュートリアル地獄”が量産される。

-1. 今回のロードマップは「ワークフロー単位」で整理している

対して、今回のAI時代版ロードマップは、

- 要件ヒアリング

- モデリング

- AIを絡めた設計・実装

- テスト・レビュー

- デプロイ

- AIを組み込んだ自動化

という開発フロー単位でスキルを置いています。

そこに、

- L1: AIリテラシー(仕様調査〜たたき台コード生成)

- L2: ソフトウェア工学(設計原則・データ構造・テスト・Git)

- L3: AI統合(LLM API・エージェント・スクリプト・ワークフロー)

を重ねている形です。

ここが従来ロードマップとの一番の決定的な差で、

「まずこの言語の文法を完璧に」ではなく

「まずAIを使いながら、小さな自動化を一つ流し切る」

をスタート地点に置いている。

実務に近い順番で学べるし、成果物も早く出るので、途中離脱も減る構造になっています。

コミュニティがザワついている論点:

「10年ロードマップ」と「AIの変化速度」のギャップ

この手の2026年版ロードマップが出ると、必ず炎上…まではいかないにせよ、議論が荒れます。

今回も例外ではなく、コミュニティの温度感はかなり「Mixed + やや不安強め」です。

代表的な対立軸はこんな感じです。

-1. 「10年かけてCSを固めろ」派 vs 「そんな悠長なことしてたらツールが変わる」派

- 「エンジニアになるなら10年スパンで基礎から覚悟を決めよう」

- 「でもLLMの進化速度を考えると、10年固定のロードマップは現実的じゃない」

この対立は、どちらも一理あります。

私の立場をはっきり言うと、

「10年かけて“土台となる考え方”は鍛えるべきだが、

10年固定の“教材リスト”を信じるのはやめた方がいい」

です。

AI時代では、

- 「何を学ぶか」より「どう学ぶか」

- 「どの言語か」より「どのワークフローで実務に繋げるか」

の方が圧倒的に重要になります。

だからこそ、今回のような「3層アーキテクチャ」「AI連携」を軸にした抽象レベルでのロードマップは、10年ものとしてまだ耐えうる。

逆に「このフレームワークを3年やれ」は、もはや賞味期限が短すぎて危険です。

-2. 「AIはエンジニアを置き換えるのか?」論争

コミュニティでは、

- 「AIが12ヶ月でソフトウェアエンジニアを置き換える」という極論

- 「いやいや、現場を見ていると全部置き換えは無理」という冷静な反論

がぶつかっています。

ただ、実務経験者ほど、

「少人数+AIの方が、生産性で勝つ」

「AIを活用できるエンジニアの価値は確実に上がる」

という点では、かなり認識が揃ってきています。

「Claude Codeを使う4人チーム(2026) > Claude Codeを使っていない5〜6人チーム(2022)」

という例えは、割とリアルな感覚です。

つまり、

- エンジニアという職業が“完全に消える”とは思えない

- ただし、人数は減るし、AIを扱えない人の席は先に消える

というのが現実的な見立てでしょう。

このロードマップは誰を脅かすのか:

「AIを端役にしている学習コンテンツ」はかなり厳しい

競合といってもライブラリではなく、「他の学習パラダイム」です。

一番ダメージを受けるのは、おそらくこのあたりです。

-1. 「AIほぼ無視」の従来型学習コンテンツ

- Progate完全制覇

- ドットインストール総ざらい

- Railsチュートリアル完走

- その後にやっと実務

こういう「一本道・技術ツリー型の静的ロードマップ」は、

学習者に「古いワークフロー」を教え込んでしまうリスクが出てきました。

AIを「最後にちょっと触ってみよう」程度の扱いにしている教材は、

2026年以降、かなり厳しい立場になると思います。

-2. 「AI一切無視のアルゴリズム特化ロードマップ」

CSやアルゴリズムが不要になった、とは一切思っていません。

ただ、

「LLMがある世界で、人間はどこまでアルゴリズムを常備しておくべきか?」

という問いに答えないロードマップは、

現場エンジニア向けとしては現実味を失いつつあります。

- 研究者・一部のハイエンドポジション

- コンパイラ・DBエンジン・分散システムを自作する層

には依然として重要ですが、

一般的なWeb / 業務系エンジニアには、もう少し「AI補助前提での最適レベル」が設計されるべきです。

今回の3層ロードマップはそこに踏み込んでいるので、

「CSを全部やるか、まったくやらないか」の二択から、やっと解放される印象があります。

ただし「隠れた落とし穴」もかなりある

ここまで割と好意的に書いてきましたが、懸念も少なくありません。

-1. 「理解していないのに、わかった気になれるリスク」

AI時代特有の問題として、

- LLMがそれっぽいコードや設計案を返してくれる

- それをコピペして動いてしまう

- でも「なぜ動くのか」「なぜその設計が良いのか」が分からない

という状態になりやすい。

ぶっちゃけ、「クソみたいなコード」を書くのはAIだけではありません。

数年経験を積んでも、設計力・レビュー力が弱ければ人間も普通に書きます。

違いは、

- 人間のクソコード:

書いた本人がなんとなく責任を感じていて、経験とともに改善される可能性がある - AIのクソコード:

「AIが言うなら正しいだろう」というバイアスで、検証なく量産されがち

という点です。

このロードマップは「レビュー力・テスト設計」を人間のコアスキルとして重視しているものの、

実際の学習者がどこまでそこに踏み込めるかは、運用次第です。

-2. ベンダーロックイン&コストが地味に重い

ロードマップ自体は特定ベンダー名を強く推していませんが、

現実のワークフローはどうしても「特定LLMモデルの癖」に依存します。

- モデルの料金改定

- 利用規約の変更

- APIの仕様変更

が、そのままチームの生産性とコストに直撃します。

さらに、

- 開発時は「ChatGPT月額+α」で済んでいるように見える

- でもプロダクションに載せると、

LLM APIコールが新たなインフラコストとして積み上がる

という構造もあります。

実はこのロードマップ、

「コスト最適化(キャッシュ・要約戦略・モデル選定)」の話はかなり薄い。

Zennの別記事には、FAISSやRAG、バッチAPI呼び出しといった実装例もありますが、

学習ロードマップ側にその観点が十分組み込まれているとは言いにくい。

AI前提の学習設計としては、ここは次のアップデートで必ず補強してほしいポイントです。

-3. チーム開発・ガバナンス観点が弱い

今回のロードマップは、基本的に「個人スキル」の話にフォーカスしています。

現実の現場では、

- プロンプトテンプレートの共有

- コード生成ポリシー(どこまで自動生成を許可するか)

- セキュリティ・プライバシーポリシー(機密情報をLLMに投げない規定)

- コードオーナーシップ(AI生成コードの責任の所在)

といった組織的なガバナンスを決めないと、

簡単にインシデントや品質ばらつきが発生します。

「Claude Codeを使った4人チーム」の話が象徴的ですが、

本当に生産性が上がるのは、

「個々人がAIをうまく使える」だけでなく、

「チームとしてAIの使い方を設計できる」

ときです。

ここはロードマップとは別に、

「AI利用ガイドライン」「チームAIフロー設計ガイド」みたいな2ndドキュメントが必要だと感じます。

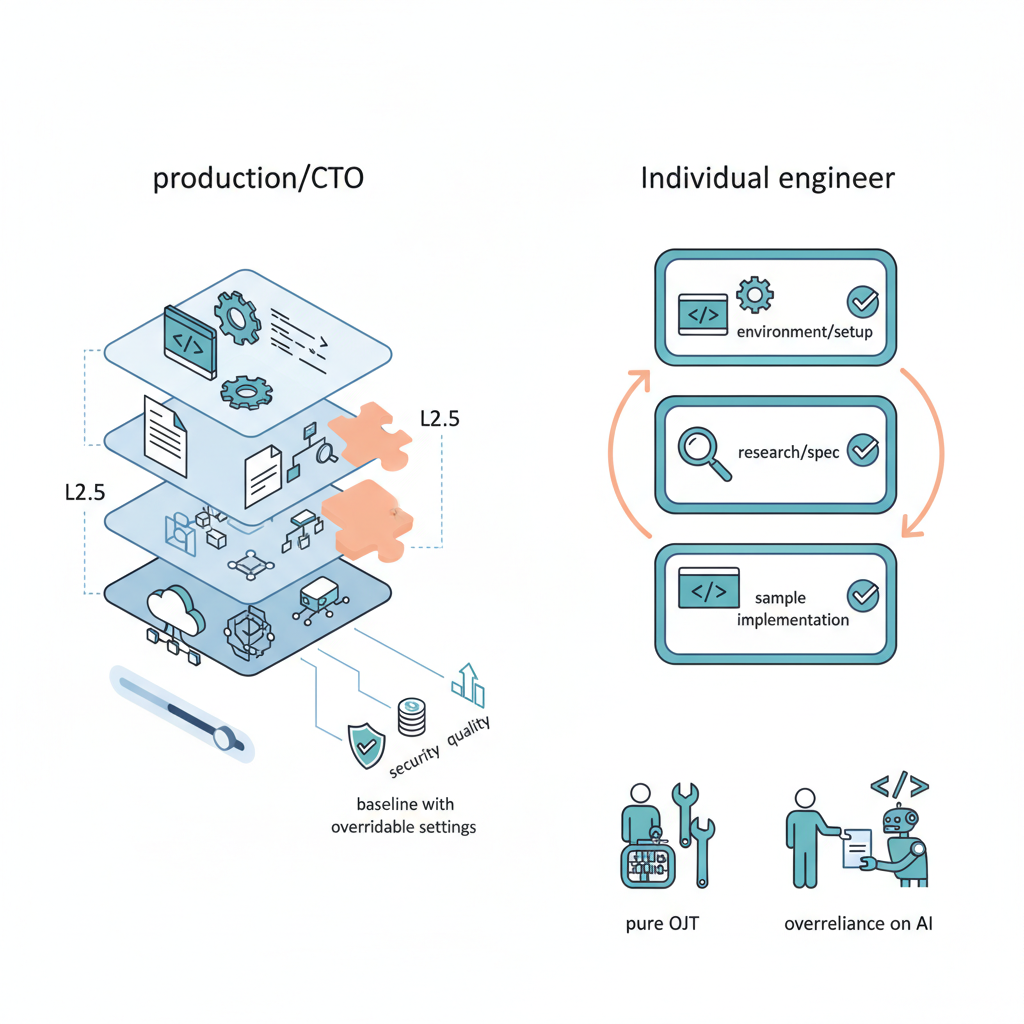

じゃあ、プロダクション&自分のキャリアでどう使うか?

最後に、「で、これをどう扱うのが現実的か?」という話を。

-1. 技術リーダー / CTOとしての結論

「プロダクションで“全面採用”するか?」という問いに対しては、

正直、「ベースラインとして採用しつつ、組織の事情で上書きする」が妥当

だと思っています。

- 3層アーキテクチャ(L1〜L3)はそのまま採用

- 自社に必要なドメイン知識・レガシー技術を「L2.5」「L3.5」として差し込む

- AI利用ガイドライン(コスト・セキュリティ・品質)を別途定義してセット運用

という形です。

「AIを一切使わないOJT」は、

もはや新人を旧世代のワークフローに縛り付けるだけなので、

どこかのタイミングで見直した方がいい。

一方で、「全部AIに投げて、人間は結果だけ見る」は、

デバッグ不能エンジニアの量産コースなので避けるべきです。

-2. 個人エンジニアとしての使い方

個人としては、ロードマップを「静的な地図」ではなく、

L1〜L3の“チェックリスト”+“動的アップデート前提”

として使うのがいいと思います。

- L1: 「AIで環境構築+仕様調査+サンプル実装」まで自走できるか

- L2: 自分のコードをAIにレビューさせ、その意図を説明できるか

- L3: 業務フローにAIやスクリプトを組み込み、工数10倍削減レベルの自動化を一つ設計できるか

この3つを中期目標にしつつ、

具体的な技術(TypeScript / Python / REST / GraphQL / RDB / 認証など)は、

AIに「2026年時点で最適なスタック」をその都度聞きながら上書きしていく。

学習ロードマップそのものも、

Gitのリポジトリのように「バージョン管理する」イメージで付き合うと良いはずです。

最後に:これは「エンジニア育成のOSアップグレード」であって、

「勉強しなくていい免罪符」ではない

AI時代のロードマップが出ると、どうしても極端な解釈が出ます。

- 「もうAIが全部やってくれるから、勉強は要らない」

- 「AIに負けないために、AIなしでCSを極め続けるべきだ」

正直、どちらも現実的ではありません。

今回の「AI時代エンジニア学習ロードマップ 2026年版」は、

- AIを前提インフラとして扱う

- でも、人間が握るべき中核スキルを明示する

- 学習プロセスそのもののアーキテクチャを刷新する

という意味で、「エンジニア育成OSのアップデート」に近い提案です。

AI依存のリスクも、コストも、ガバナンス課題もあります。

それでも、「AIを前提にしたエンジニア像」を言語化したフレームワークとしては、

2026年の時点でかなり筋が良い部類に入ると感じています。

- 「AIを使わずに学ばせている部分は、本当にAI抜きでやる必要があるか?」

- 「AIを使ってもなお、人間が深く理解しておくべきコアはどこか?」

- 「チームとしてAI利用ルールを定義しているか?」

この3つの問いを、自分のチーム・自分のキャリアに当てて見直す。

そのための「たたき台」として、このロードマップを使うのが、一番健全な付き合い方だろうと思います。

導入チェックリスト(チーム/CTO向け)

- AI利用ガイドライン:機密情報の扱い、プロンプト/テンプレの共有範囲、AI生成コードの責任分界(Owner)を明文化する

- 品質ゲート:テスト設計→レビュー→セキュリティ(依存・秘密情報・権限)→本番投入までの“止めどころ”を作る

- コスト設計:モデル選定、キャッシュ/要約、バッチ処理、評価指標(品質×コスト)をセットで運用する

よくある質問(FAQ)

Q. AIに頼ると基礎力が落ちませんか?

落ちるリスクはあります。対策は「AIに任せる領域(写経/一次調査)」と「人が握る領域(要件/設計/品質判断)」を分け、後者はレビュー・テスト設計で必ず説明責任を取る運用にすることです。

Q. まずL1〜L3のどこから始めるのが現実的?

最短はL1で“作業を一つ流し切る”(環境構築→小さな実装→テスト)を作り、その直後にL2のテスト/設計原則を当てて改善する流れです。L3は「自動化の1本」を設計できる段階で乗せるのが安全です。

Q. チームでAIを使うとき、最初に決めるべきことは?

機密情報の取り扱い(入力禁止範囲)、生成物の責任者(Owner)、レビュー/テストの必須条件の3点を先に決めると、品質のばらつきと事故が減ります。

Q. ベンダーロックインやコスト増はどう考える?

「モデルを差し替えられる設計(抽象化)」「キャッシュ/要約で呼び出し回数を制御」「評価指標を持って選び直せる状態」を作るのが現実解です。

コメント