「LLMに道具を10個つないだら、オーケストレーターのコードが本体より長くなった」——そんな経験、ありませんか?

結論(先に要点)

- GPT‑5.4 + Agentsは『モデル更新』ではなく、オーケストレーションをプラットフォームに寄せる転換点

- いきなり全面採用より、5.4-miniへの移行+非クリティカル領域でAgents検証が現実解

- 導入前に、ロックイン/可観測性(デバッグ)/コスト上振れの3点にガードレールを置く

想定読者:LLMアプリを本番運用している開発/プロダクト責任者、AI基盤チーム

- どのツールをいつ呼ぶかを if 文で書きまくる

- JSON がちょっと崩れるたびにパースエラーで落ちる

- モデル名が

4oだの4.1だの増えすぎて、どれを本番にすべきか分からない

正直、ここ1〜2年の「LLMアプリ開発」は、プロダクトより糊付けコード(glue code)の方がつらかったはずです。

そこに出てきたのが、今回の OpenAI GPT‑5.4 と Agent 機能です。単なる「モデル入れ替え」ではなく、「オーケストレーションをどこまでプラットフォーム側に寄せるか?」という構図が変わり始めたタイミングだと感じています。

一言でいうと:LLM界の「Kubernetes っぽいもの」が、ようやく公式に出てきた

GPT‑5.4 と新しい Agent 機能を、一言でラベル付けするとこうだと思っています。

一言で言うと、LLM アプリ開発界の “Kubernetes 1.0 リリース” みたいなものです。

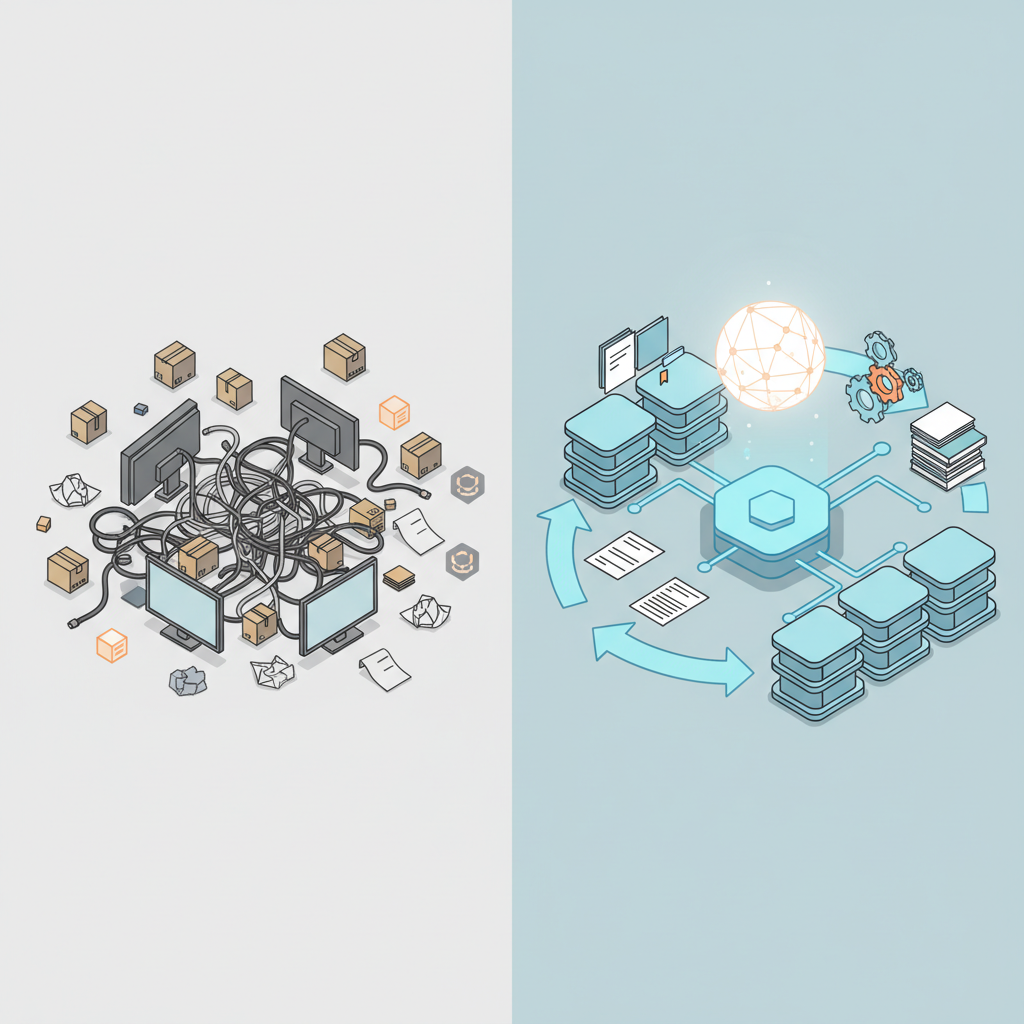

Kubernetes が出る前、みんな Docker コンテナを:

- systemd で雑に動かす

- 自前スクリプトでヘルスチェックと再起動

- 監視もログも全部バラバラ

みたいな状態で頑張っていました。

それが Kubernetes で「宣言的に Desired State を書いたら、あとの面倒はプラットフォームが見る」という世界にシフトした。

今回の GPT‑5.4 + Agents も、同じ匂いがしています。

- 以前:

- LLM 呼び出し

- ツール選択

- ステップ分解

-

状態管理

→ ぜんぶアプリ側で頑張る -

これから(5.4 Agents):

- 「この Agent はこういうことができて、ツールはこれ、知識源はこれ」と宣言

→ 実際のプランニングとツール呼び出しループは、モデル+Agent に任せる

もちろん Kubernetes ほど成熟しているわけではありませんが、「オーケストレーションそのものを製品化した」という意味で、かなり大きな分岐点だと思います。

何が本当に変わったのか:5.4 ファミリーと Agent の中身

技術的なアップデート自体は公式ドキュメントに譲るとして、「エンジニア目線で本当に効いてくるポイント」だけに絞って整理します。

モデルラインナップがやっと “まとも” になった

5.4 で一番嬉しいのは、性能云々よりラインナップと行儀が揃ったことです。

- 新フラグシップ

gpt-5.4gpt-5.4-mini- Reasoning / Agent 向け

gpt-5.4-reasoninggpt-5.4-reasoning-mini- 旧世代は段階的にサンセット

gpt-4o,gpt-4.1,gpt-4.1-miniなど

名前も挙動もバラバラだった 4o / 4.1 / omni-* 系から、

- 「とりあえずこれ使っておけ」の

5.4-mini - 高精度用の

5.4 - ガッツリ agent / tool 用の

5.4-reasoning

という、だいぶ筋のいい整理に変わりました。

正直、「モデル選定会議」が毎回発生していた組織には、これだけでだいぶ救いです。

Reasoning モデルが「一等市民」になった

gpt-5.4-reasoning / -reasoning-mini は、単に「ちょっと賢いけど遅いモデル」ではなく、

- 複数ツールのマルチステップ利用

- 長いコンテキストを使ったプランニング

- Agent 的なワークフロー全体

を前提にチューニングされたモデルです。

ぶっちゃけ、今までの「LLM エージェント」は、

- 開発者が LangChain や自前コードでプランニングロジックを書き

- モデルは「一手一手の思考」を担当するだけ

という構造がほとんどでした。

5.4 の Reasoning モデルは、プランナーとしてモデルを正式に使うことを想定している、というのが大きな違いです。

Agent レイヤー:ツール呼び出しから「エージェント定義」へ

以前の「function calling」は、単に「関数の JSON スキーマを渡して、モデルに選ばせる」レベルでした。

5.4 世代では、これがかなり変わります。

- Agent として宣言できるもの

- instructions(役割・性格・ルール)

- tools(関数、ブラウザ、コード実行など)

- knowledge sources(ファイル、URL、ドキュメント群)

開発者は、

「この Agent はこういう知識と道具を持っていて、こう動いてほしい」

という「設定ファイル」を書くイメージに近くなります。

そのうえで、

- どのツールをどの順番で使うか

- 何ステップかけて問題を分解するか

- コンテキストをどう保持するか

といったオーケストレーション部分はモデル+Agentが握る、という設計です。

正直、ここが Kubernetes アナロジーの一番強いところだと思います。

「Desired State(こういう Agent がほしい)を書くと、Operational Complexity(実行ステップ)が向こう側に隠れる」構造だからです。

なぜ重要か:競合との比較で見える「OpenAI の本気度」

Anthropic Claude 3.5 との違い:モデル vs プラットフォーム

性能だけの話をすると、Anthropic の Claude 3.5 Sonnet 系は、

- 分析力

- チェーン・オブ・ソート

- テキスト品質

でかなり強いですし、「どっちがちょっと賢いか」を巡る議論はいつまで経っても終わりません。

でも今回の GPT‑5.4 で重要なのは、「モデルの賢さ勝負から、プラットフォーム勝負に軸足を移した」ことです。

- OpenAI:

5.4-mini/5.4/5.4-reasoningと用途ごとのラインナップ- ファーストパーティな Agent 抽象

- ファイル・ナレッジ・ツールを束ねた「Agent プラットフォーム」

- Anthropic:

- モデル単体としての強さ(特に推論・解釈)

- Tool Use はあるが、Agent という統合概念はまだ薄い(現時点)

つまり、

- 「LLM を1個差し替えたいだけ」の世界 → Claude もかなり良い選択肢

- 「Agent 中心の SaaS / 内製 Copilot を作る」世界 → OpenAI 5.4 のほうが “バッテリー同梱” 感が強い

という構図が、かなりはっきりしてきたと感じます。

LangChain や RAG 特化 Vector DB へのインパクト

正直、一番インパクトが大きいのは、サードパーティのオーケストレーション・フレームワーク群です。

- LangChain / LlamaIndex など:

- これまでの「エージェント・ツール呼び出し・RAG のラッパーとしての価値」が、OpenAI の Agent でかなり置き換えられてしまう

-

ただし、マルチベンダー対応・オンプレなどでは引き続き必要

-

Vector DB ベンダー(特に “RAG 入門用” のところ):

- 「とりあえず PDF 上げたら QA できます」系ユースケースは、Agent+ファイル連携でかなり OpenAI に吸われる

- ちゃんとした検索・監査・権限管理込みの RAG は、引き続き別レイヤーが必要

ここでポイントなのは、「全部死ぬ」という話ではなく、

「ライト〜ミドルなユースケースは、OpenAI 純正に吸われていく」

という現実です。

ぶっちゃけ、スタートアップ側からすると「わざわざ LangChain を本番インフラに載せるほどでもない」レベルのアプリは、5.4 Agents で完結してしまうパターンがかなり出てくると思います。

ただし、懸念点もはっきりしている

ここまでわりと好意的に書きましたが、正直「全部のせ最高!」という話でもありません。

5.4 + Agents は、かなり強力である一方、それなりに重めのリスクとトレードオフも連れてきます。

ベンダーロックインは一段階ギアが上がる

以前は「モデル名を env で切り替えれば他社モデルにも逃げられるよね」という幻想が、一応は成り立っていました。

Agents を本気で使い始めると、この幻想はだいぶ崩れます。

- Agent に埋め込まれるもの

- ツールのインターフェース定義

- OpenAI 固有のファイル / ナレッジ連携の前提

gpt-5.4-reasoningの挙動に依存したプロンプト設計

ここまで握られると、

「じゃあ来月から Anthropic に乗り換えますか」

→ Agent の構造とツール呼び出しプロトコルから作り直し

という世界になりがちです。

「LLM を差し替えられる設計」にこだわりたい組織ほど、5.4 Agents には慎重になった方がいいと思います。

ブラックボックス化とデバッグの難しさ

オーケストレーションをプラットフォームに寄せれば寄せるほど、なぜその決定が行われたのかが見えにくくなります。

- 「なぜこのツールを選んだのか?」

- 「なぜここでループをやめたのか?」

- 「なぜ再試行しなかったのか?」

これまでは、自分で書いたプランニングコードに print デバッグを仕込めば済んでいましたが、Agent では:

- 内部ステップをログとして取る仕組みを自前で整える

- それを可視化するダッシュボードを作る

- 意図しない振る舞いをプロンプトや設定で調整する

といった“LLM 時代の New Relic / Datadog 仕事”が必要になります。

正直、ここをサボると「たまに変なことをする謎の黒箱」が1個増えるだけです。

コスト構造が読みづらくなる

5.4-mini 自体の単価はかなり攻めていて、「4.1-mini からの移行先」としては素直にアリです。

ただ、Agent を組み合わせると話が少し変わります。

- 一回のユーザーアクションで

- 何ステッププランニングするか

- 何回ツールを叩くか

- どれくらい長いコンテキストを維持するか

が、かなりモデル側の判断に委ねられるため、

ペイロードは軽いのに、トークン数とツール呼び出し回数が積もって「結果的に高い」

ということは普通に起こりえます。

「ツール呼び出し上限」や「1リクエストあたりの最大ステップ数」など、予算ガードレールをアプリ側で設計するのは避けられないと思います。

モデル・バージョンアップのたびに「Agent 再評価」が走る

5.4 への移行もそうですが、今後も 5.5 / 5.6… と出てくるたびに、

- Reasoning 挙動の微妙な変化

- ツール選択ポリシーの違い

- システムプロンプトの解釈の違い

が効いてきます。

LLM を素のチャットボットとして使うだけなら「テキスト品質チェック」で済んでいたところが、Agent ベースになるとワークフロー全体のリグレッションテストが必要になってきます。

正直、「年に数回の大規模リグレッション+コンプライアンスレビュー」を回す体力がない組織には、あまり重い Agent を本番のコアロジックに据えるのはつらいだろうな、という懸念があります。

では、プロダクションで使うか?正直まだ “段階的導入” が現実的

最後に、自分だったらどう使うか、という観点でまとめます。

既存の 4.x / 4o ユーザー

- モデル名は早めに

gpt-5.4-mini/gpt-5.4に寄せるべきです。 - ハードコード禁止、コンフィグで切り替えられるようにする

- 特に

4o/4.1はデプリケーション日付をチェックしておく - 移行の最初のターゲットはほぼ確実に

gpt-5.4-miniです。 - 「まずは mini に乗せて、どうしても足りないところだけ 5.4 / 5.4-reasoning」に上げる戦略がコスパ良いです。

Agent はどこから試すか

正直、いきなり本番のクリティカルパスを書き換えるのはおすすめしません。

- まずは 社内向け Copilot 的なツールから:

- ドキュメント QA

- リサーチ補助

- サポートオペレーターの支援

- 「ちょっと変な挙動をしても死なない領域」で、5.4-reasoning + Agent を回し、

- 内部ステップのログ

- ツール選択の傾向

- トークン・コストのプロファイル

を観察する

ここで「挙動のクセ」と「運用コスト感」を掴んだ上で、徐々に外向きプロダクトやクリティカルな業務フローに展開するのが、現実的な順番だと思います。

どこまでオーケストレーションを預けるか

個人的なスタンスとしては、

- ビジネスロジックの境界までは自分たちで握る

- その内側の「情報収集」「要約」「下調べ」「案出し」などを Agent に委ねる

くらいの切り分けがちょうどいいと考えています。

- 支払い処理をするかどうか

- 顧客にメールを本当に送信するかどうか

- ワークフローをどの分岐に進めるか

といった「不可逆でリスクの高い決定」は、人間か、少なくとも自前コードでガードし続けるべきです。

一方で、

- どのドキュメントを読んで要約するか

- どの SQL を試しに投げてみるか

- どの API を組み合わせて候補プランを作るか

といった、「やり直しがきく探索フェーズ」は、5.4-reasoning のような Agent 向けモデルにどんどん任せてしまって良いと思います。

まとめ:5.4 は「派手なデモ」ではなく、アーキテクチャを変える一歩目

GPT‑5.4 と Agent 機能は、

- ベンチマーク上の数パーセントの精度向上

- ちょっと安くなりました、ちょっと速くなりました

といったレベルのニュースではなく、

「LLM アプリのどこまでをプラットフォームに任せるか」

という設計の前提を揺さぶるリリース

だと感じています。

- 良い意味では:

- Glue code 地獄からの脱出路

- エージェント開発の参入コストの大幅な低下

- 悪い意味では:

- ロックインとブラックボックス化の加速

- コストと挙動の予測可能性の低下

ぶっちゃけ、「これで全部解決!」というフェーズには全然届いていません。

ただ、「Kubernetes 0.9 くらいのものがようやく公式に出てきた」くらいには、大きなマイルストーンだと思います。

プロダクションにいきなり全面採用するよりも、

- モデルは

5.4-miniベースに移行 - Agent は社内ツールや非クリティカル領域で実験

- ログ・コスト・挙動を見ながら、任せる範囲を少しずつ広げる

という三段階で付き合っていくのが、2026年時点の現実解かな、というのがエンジニアとしての率直な結論です。

「LLM アプリのオーケストレーションをどこまで任せるか?」

自分たちのプロダクトにとっての答えを、そろそろ本気で決めるタイミングが来ています。

関連記事

- OpenAI GPT‑5.4 リリースまとめ:エージェント基盤化の要点と導入判断

- GPT-5.4 Computer Use 実践レポート

- GPT‑5.4 Computer Use API:UI操作エージェントはRPAを変える?(使いどころ/リスク/導入判断)

FAQ(導入判断でよくある質問)

AgentsはLangChain等を置き換える?

ライト〜ミドルなユースケースは置き換えが進みやすい一方、マルチベンダー運用やオンプレ、権限/監査が強い領域では引き続き別レイヤーが必要になりがちです。

まずどのモデルから移行すべき?

最初はコスト/性能のバランス的にgpt-5.4-miniが無難です。足りない箇所だけgpt-5.4やgpt-5.4-reasoningに段階的に上げるのが安全です。

コストが読めなくなる問題はどう扱う?

1リクエストあたりの最大ステップ数・ツール呼び出し上限・コンテキスト長などをアプリ側で上限設定し、ログ/メトリクスで上振れ検知できるようにします。

本番のクリティカルパスに入れて良い?

不可逆な意思決定(送金/メール送信/重要ワークフロー分岐など)は人間/自前コードでガードし、Agentsは情報収集・要約・下調べなど「やり直しが効く探索」に寄せるのが現実的です。

コメント