AI関連

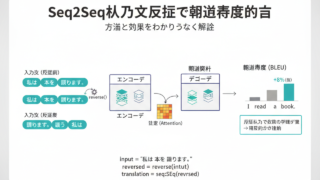

AI関連 Seq2Seq入力文反転で翻訳精度向上の解説記事

「LSTMで機械翻訳組んだけど、長文になると一気に劣化してBLEUが伸びない…」そんな経験、ありませんか?学習率いじっても、レイヤー増やしても、勾配クリッピングしても、どうにもならないやつです。その問題を「前処理1行」である程度マシにしてし...

AI関連

AI関連  AI関連

AI関連  AI関連

AI関連  AI関連

AI関連  AI関連

AI関連  AI関連

AI関連  AI関連

AI関連